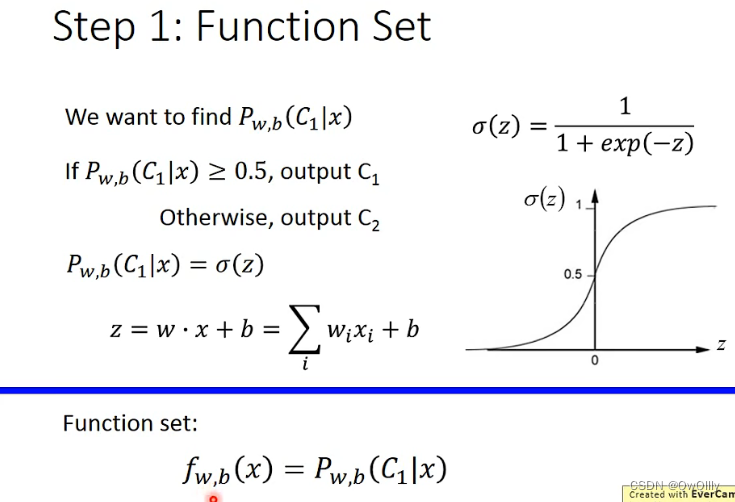

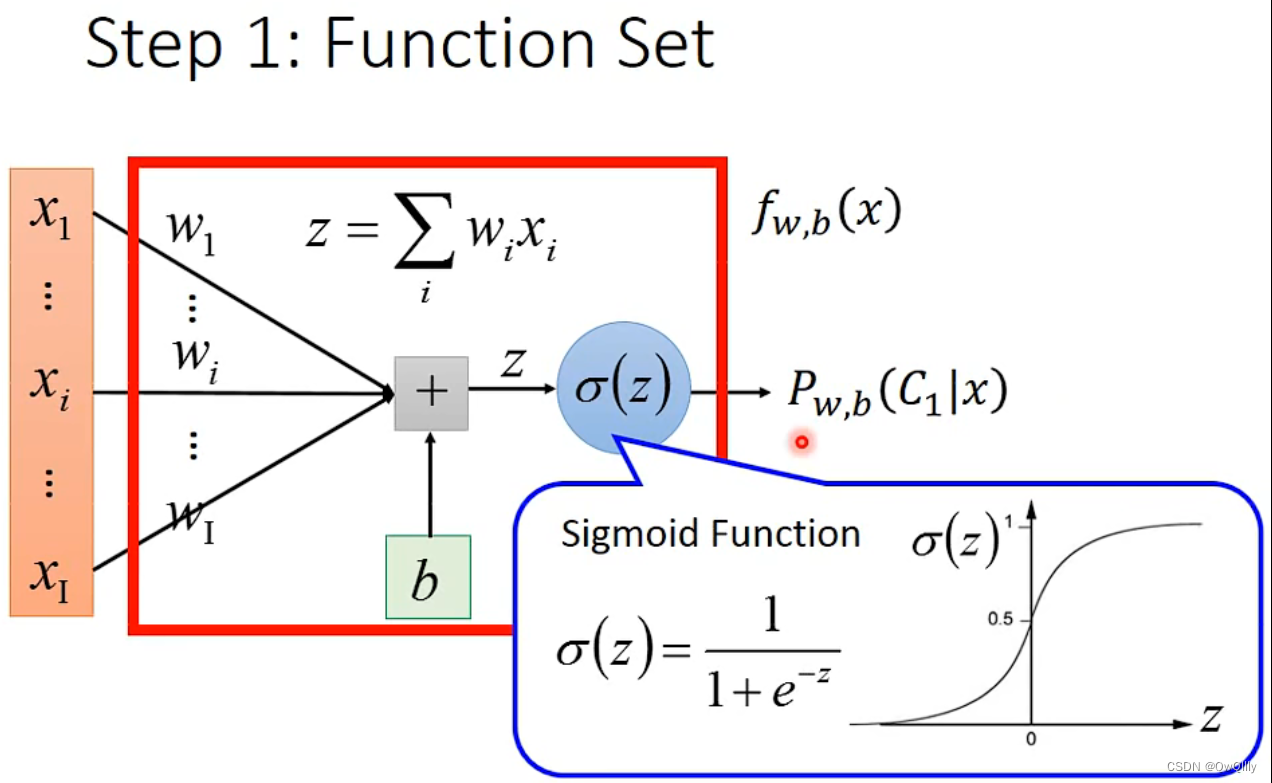

一、确定函数组

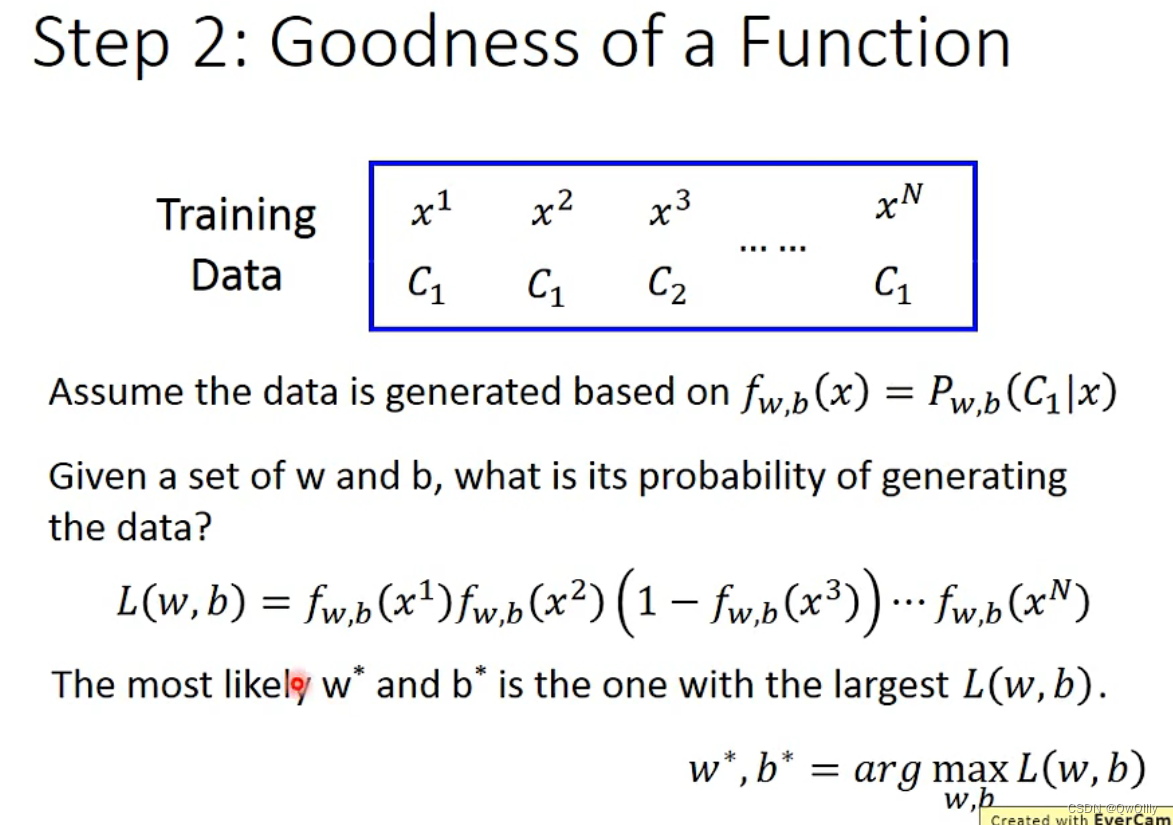

二、函数的优劣

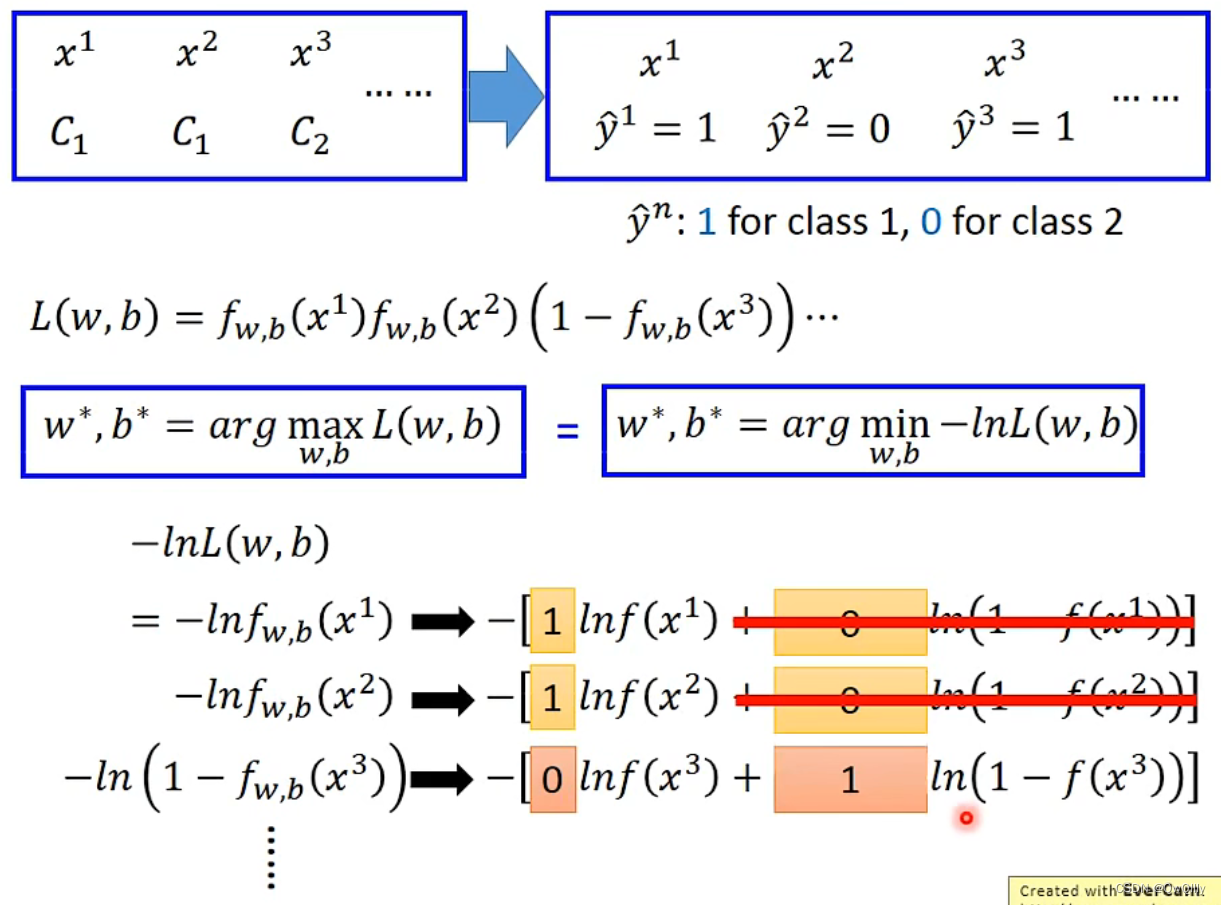

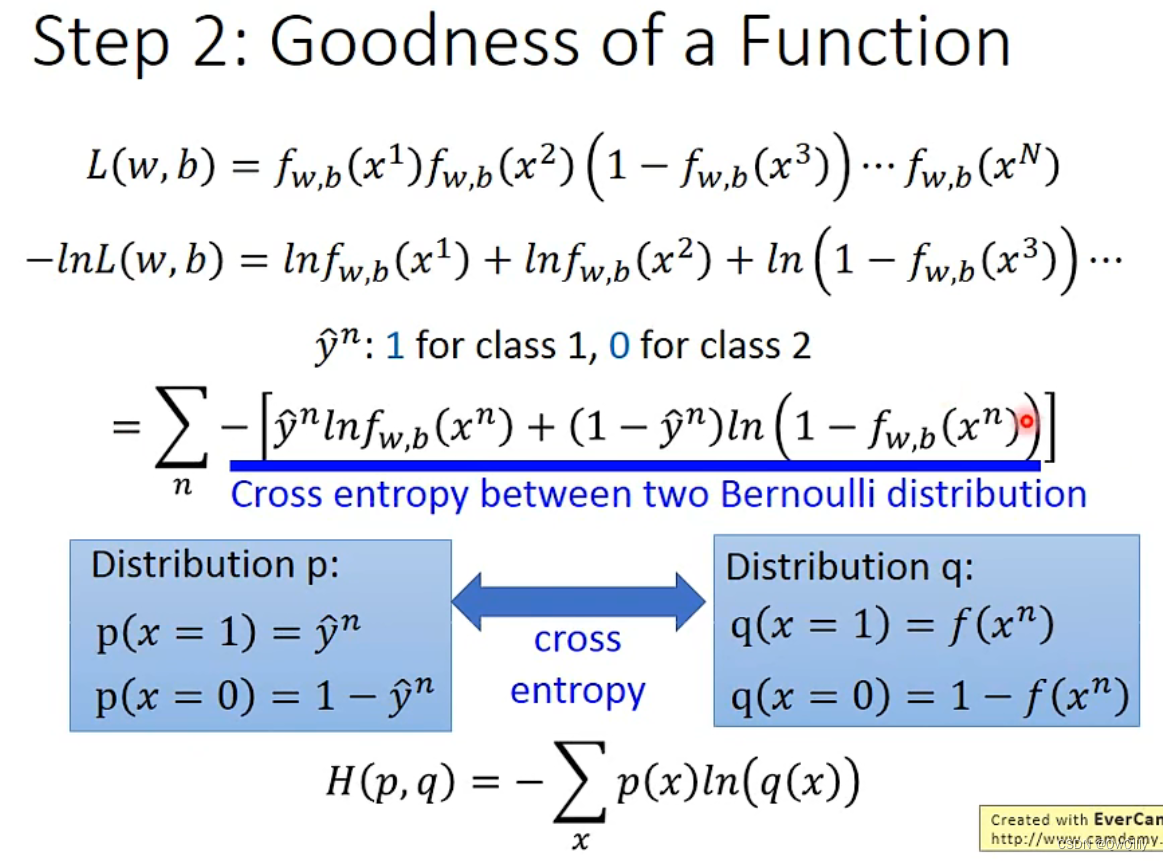

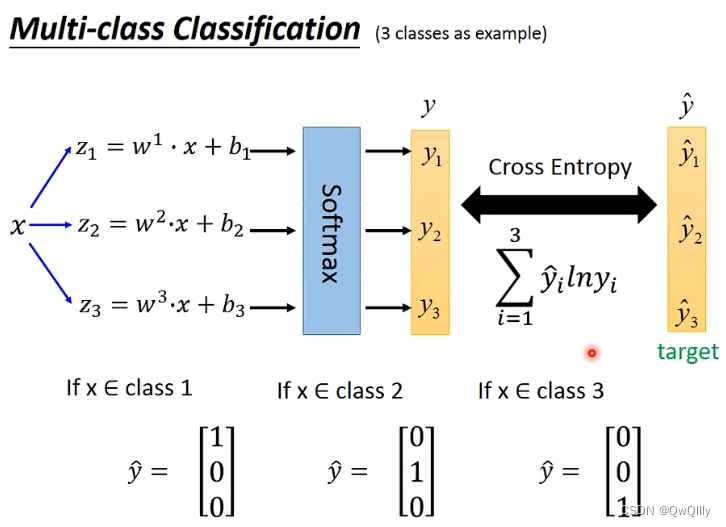

找一组(w,b)最大化 L (此处表示likelihood)

简化后可以看出这里其实就是交叉熵

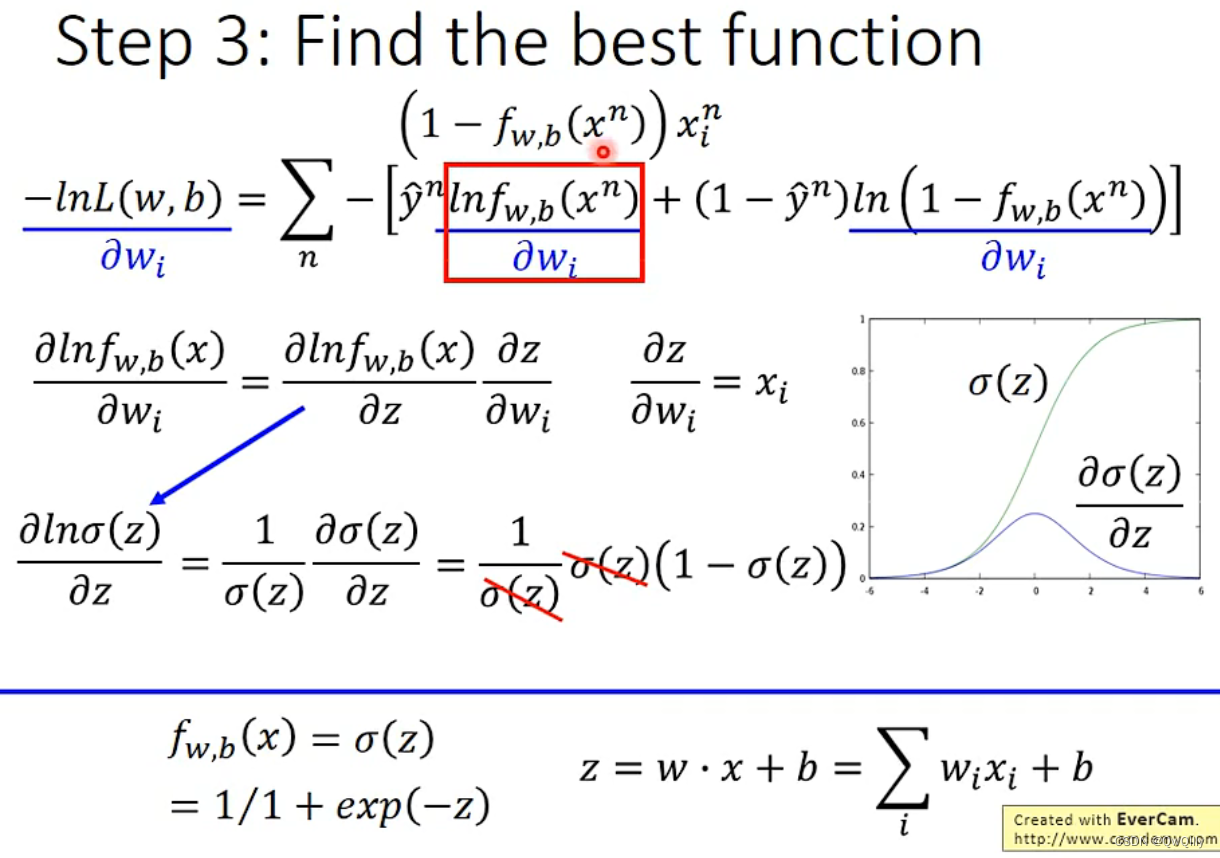

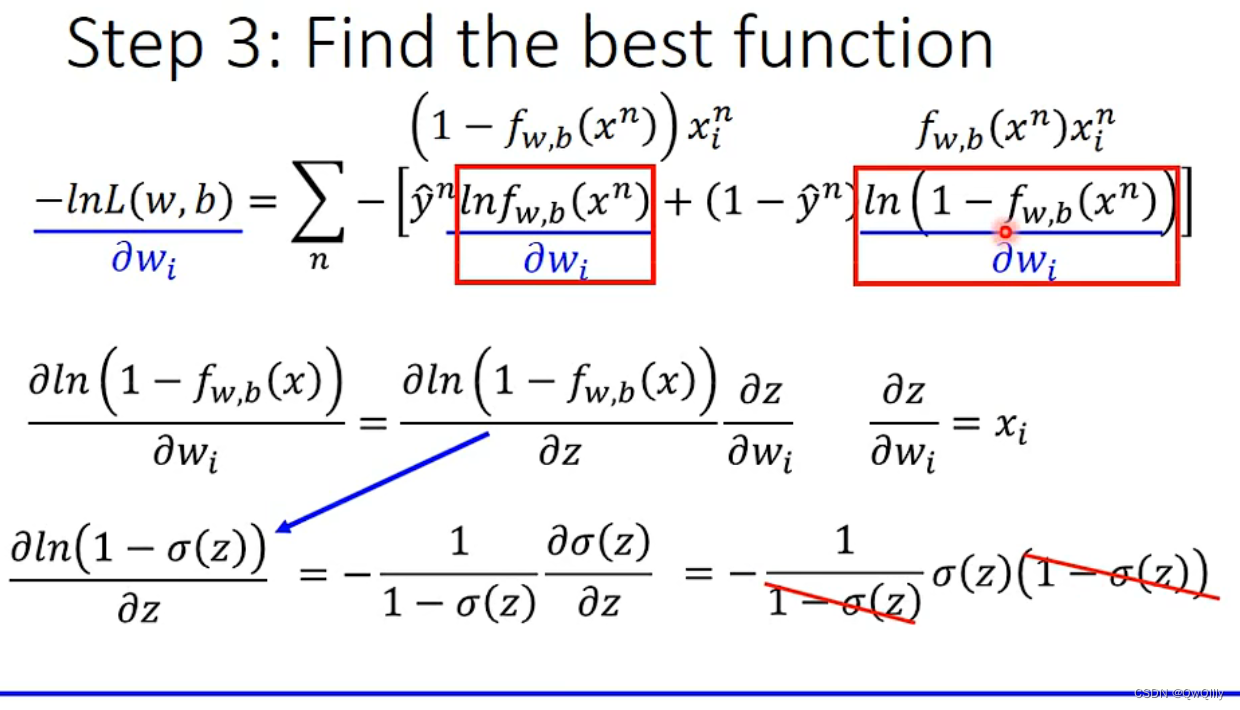

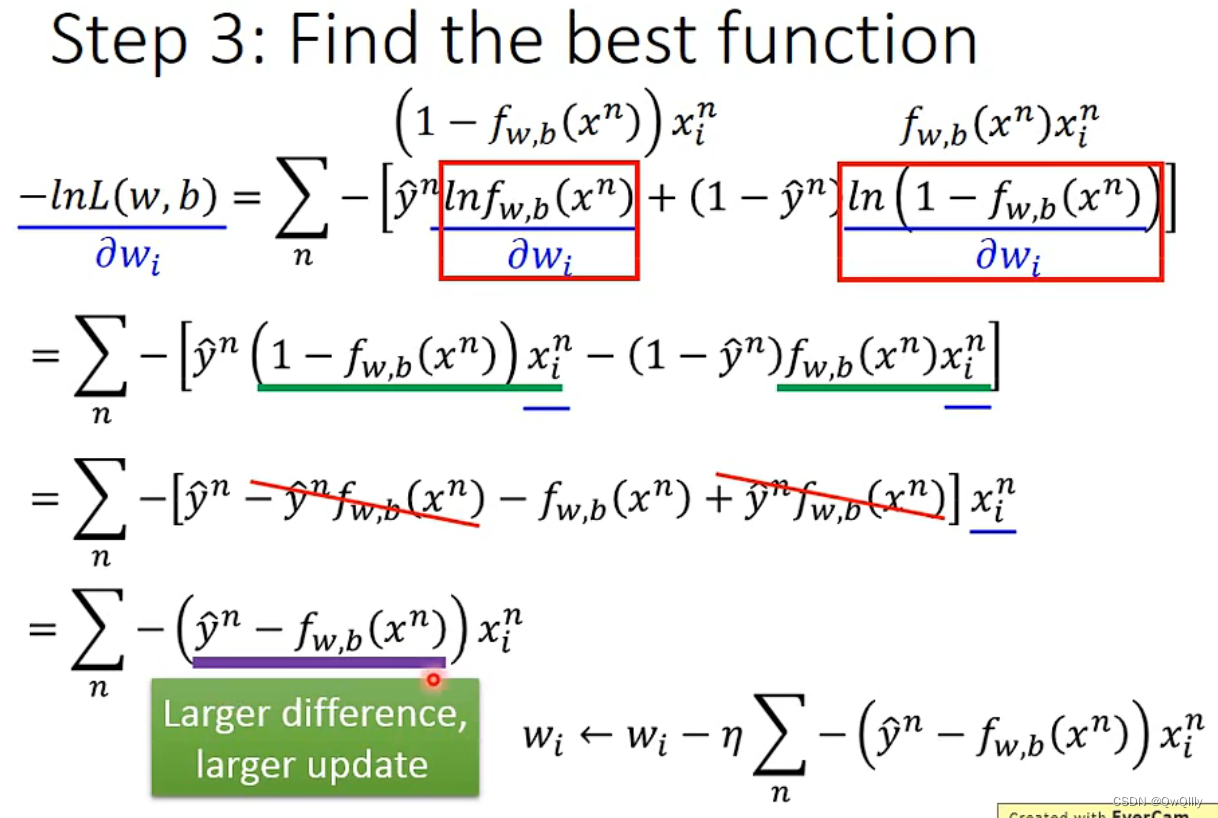

三、寻找最好的函数

左边项

右边项

最后推导出的这个结果看起来也很合理,就是要实际值和预测值差距最小。

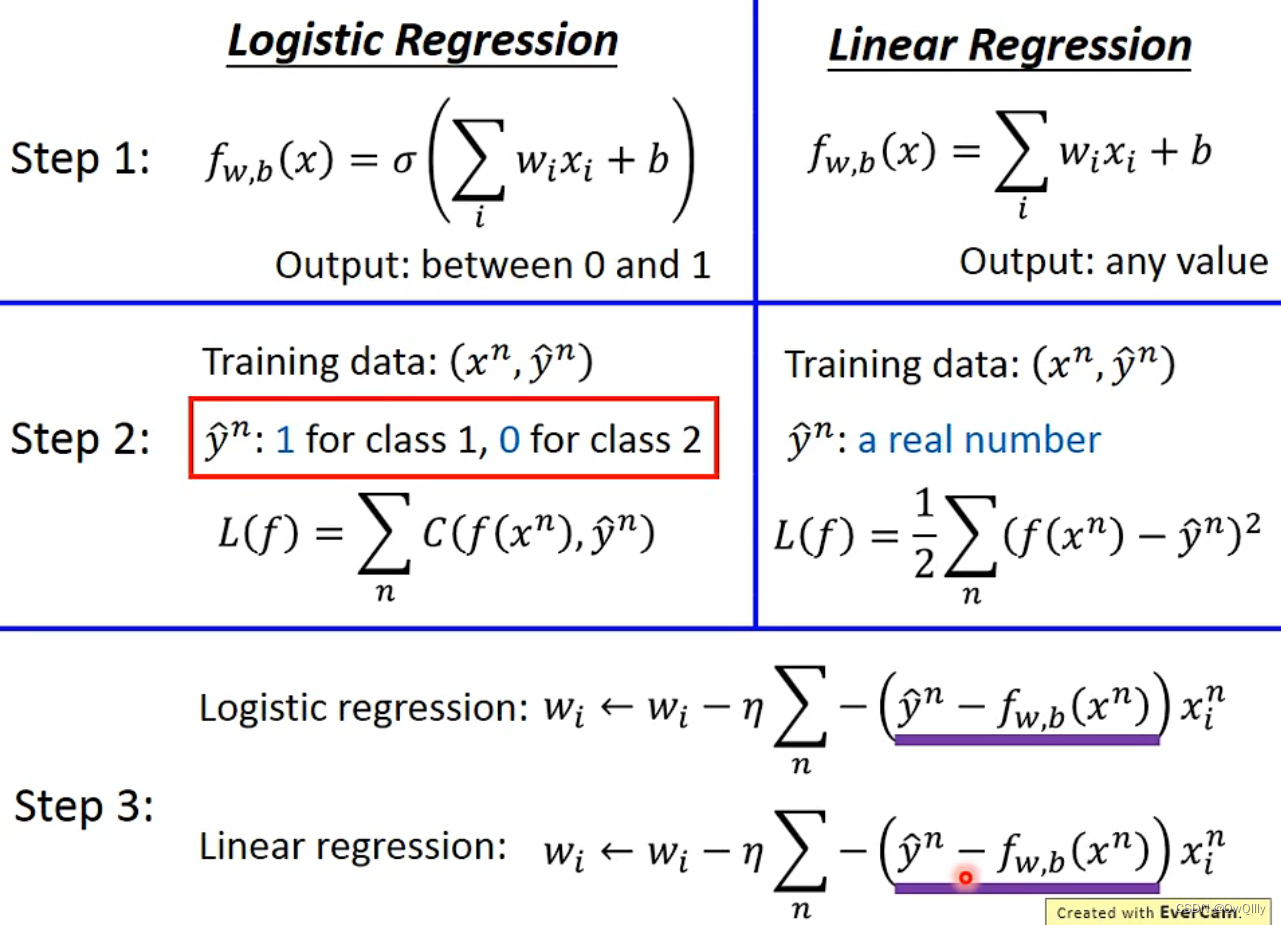

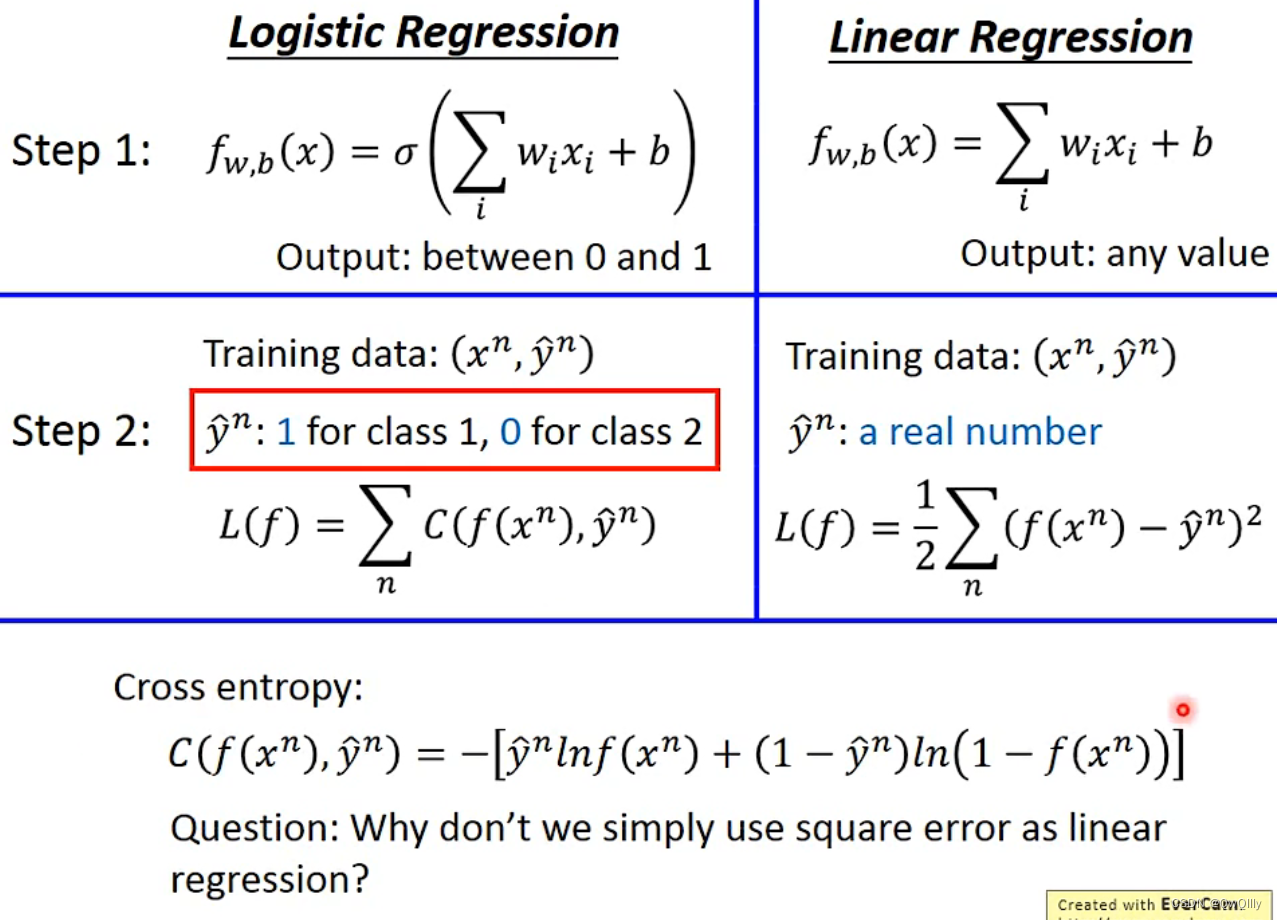

四、总结(逻辑与线性的对比)

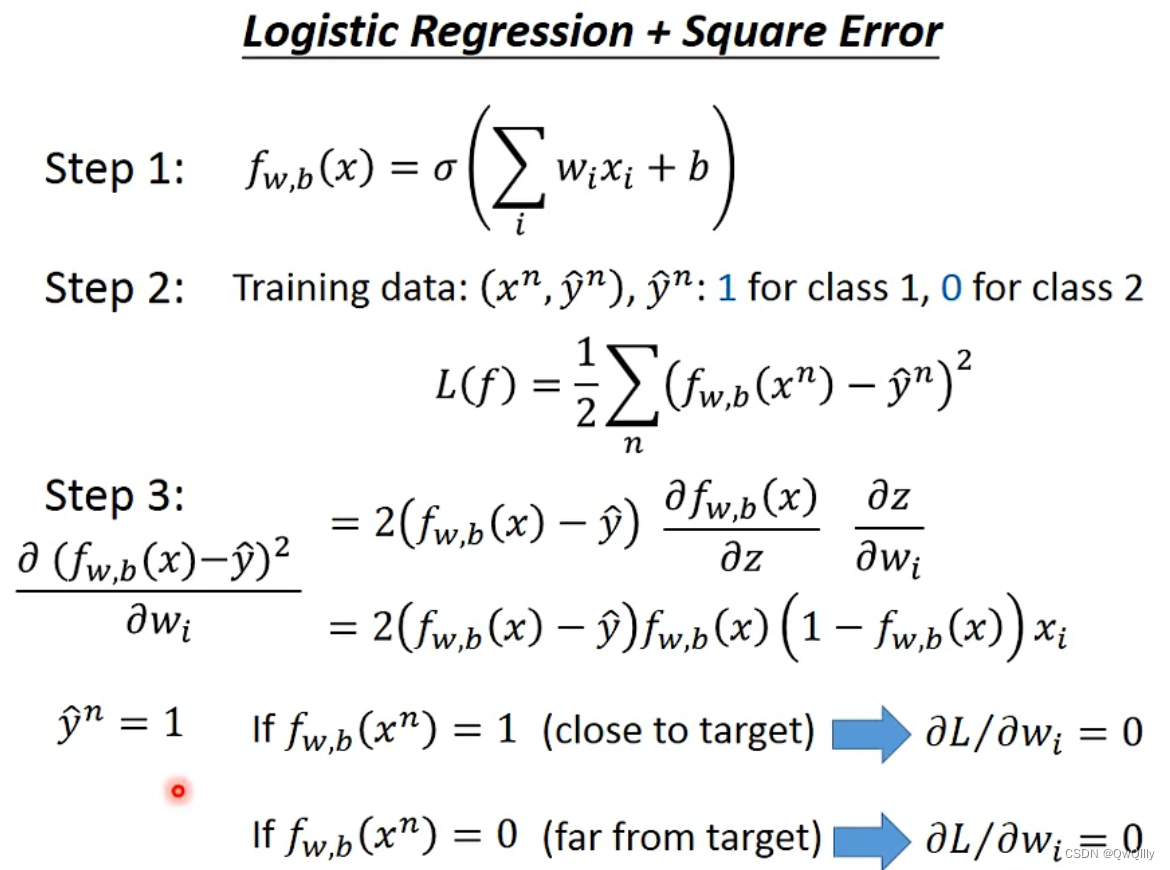

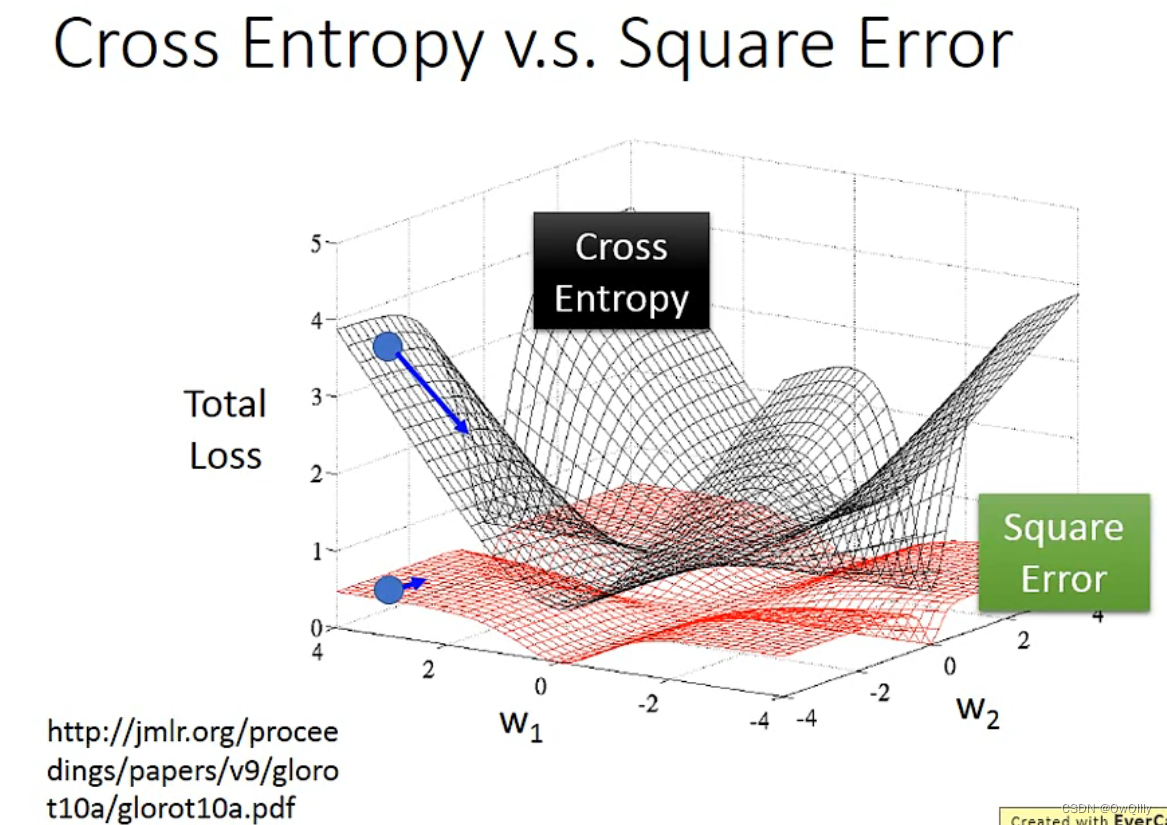

交叉熵和MSE的区别

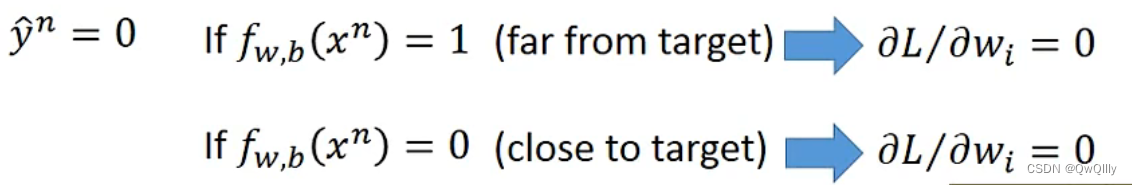

如果 逻辑回归+平方差的损失公式 ,会出现以下问题。求导后出现导数=0时有两种情况,此时如果不是正确的那类,会卡死!!同时,在错误0两侧时的步进会非常小,效率很慢。

当距离目标远的时候,微分还是很小,这样步进会非常慢。还可能会出现参数卡死的情况(微分=0)。

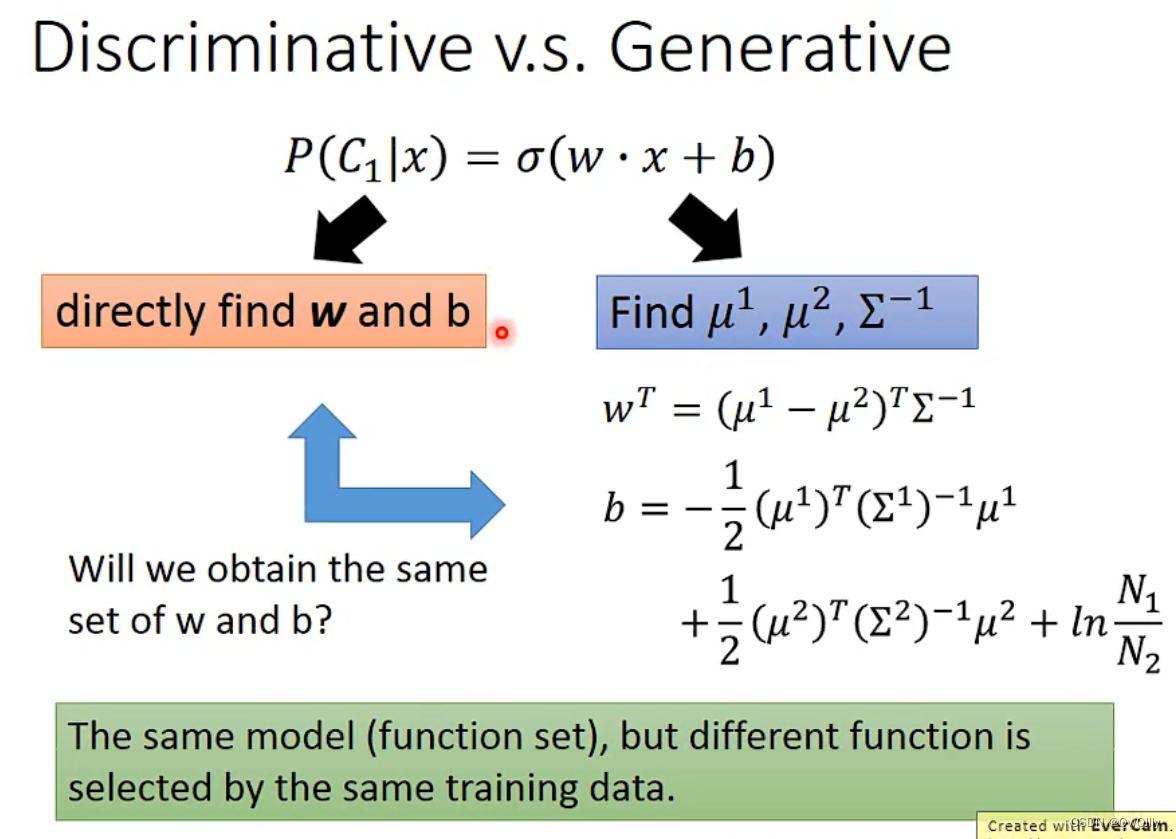

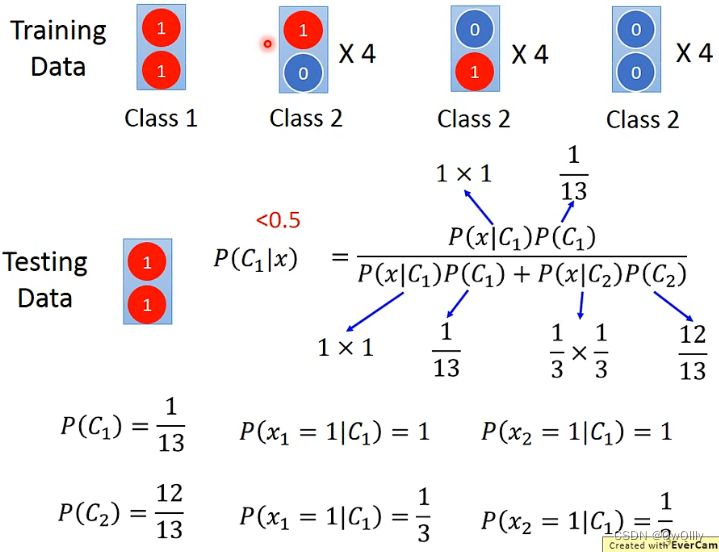

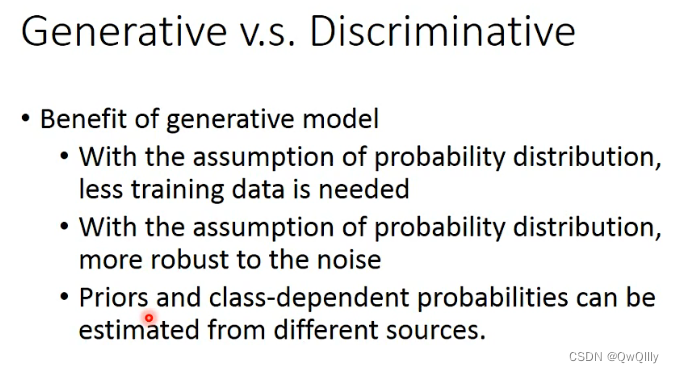

五、鉴别式与生成式

把这两种方式成为鉴别式(函数角度)和生成式(概率角度)

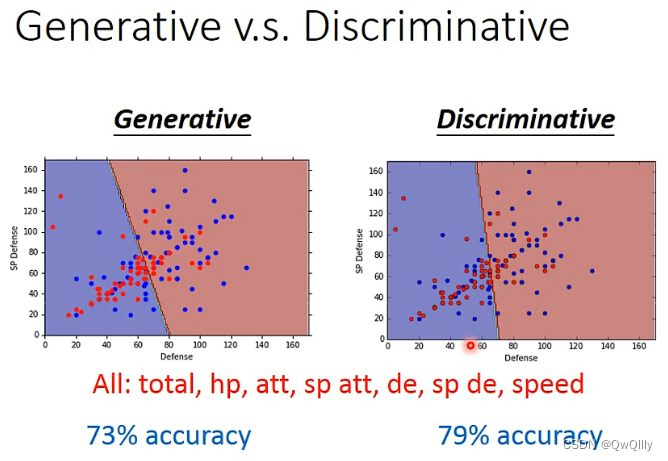

结果可以分析,鉴别式角度精确度更高,这是由于问题没有经过转换,直接求的,没有过预估。

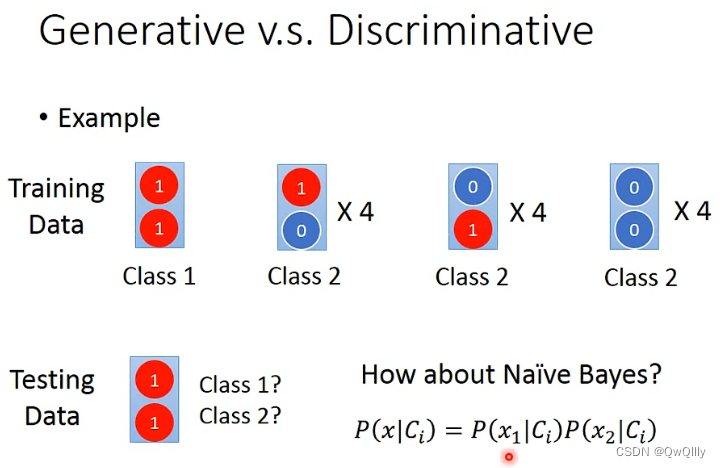

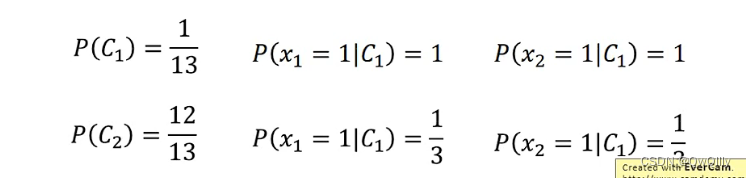

示例:

最右边两个写错了,是C2

最右边两个写错了,是C2

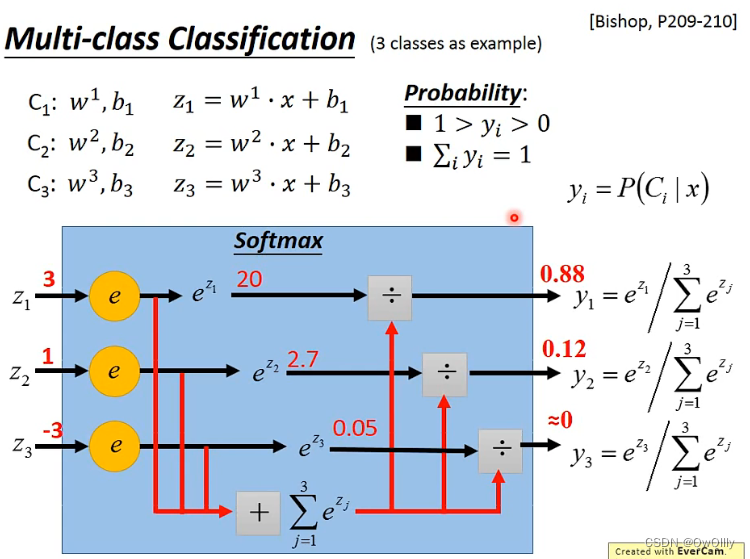

六、多分类问题

经过softmax层后的一些操作

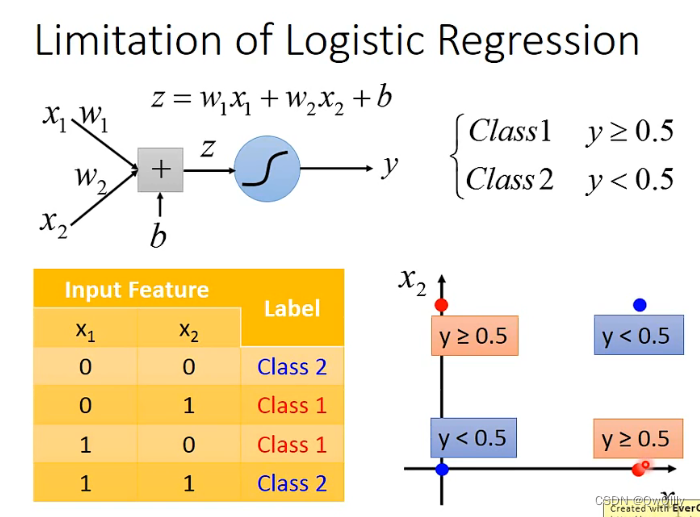

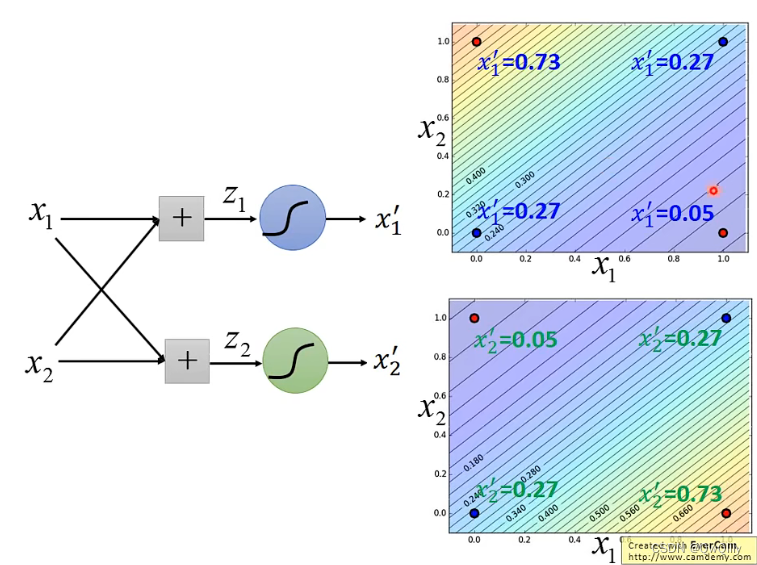

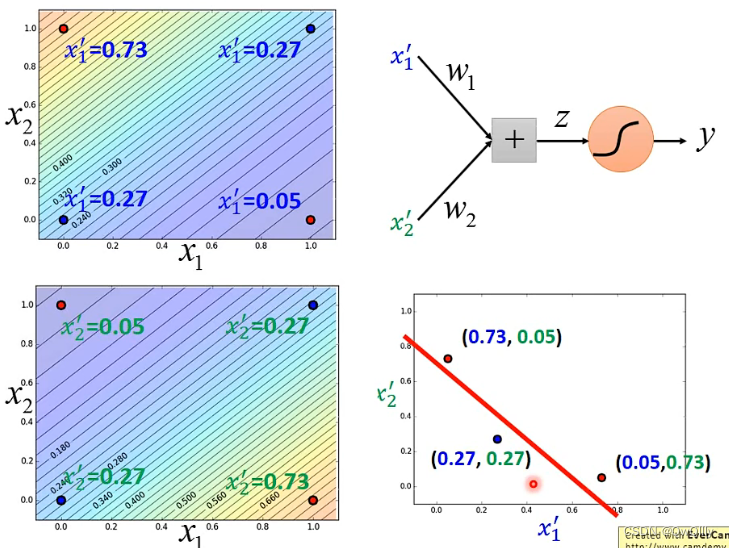

七、逻辑回归的限制及解决方法

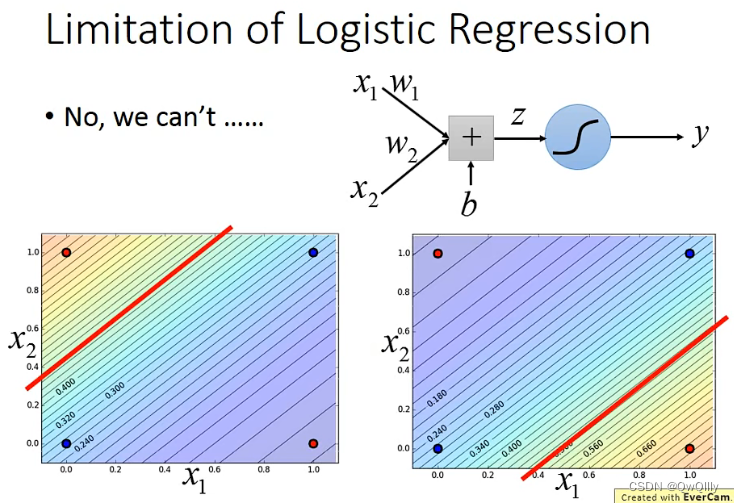

有一些特殊情况无法使用逻辑回归

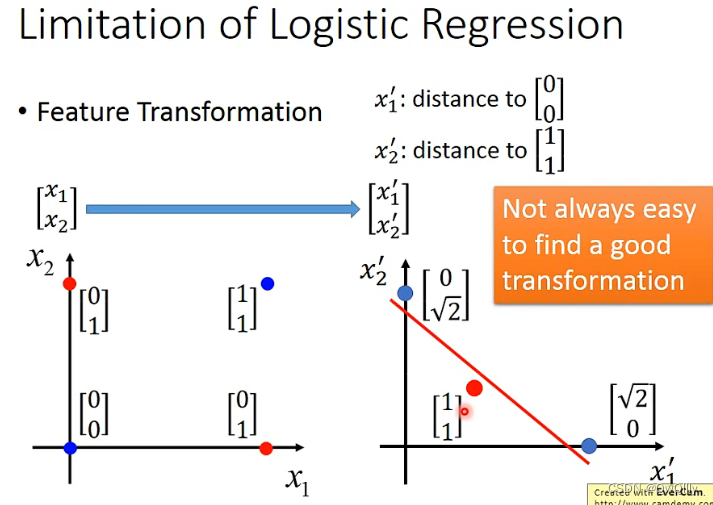

方法:做特征转换 ,用其他的意义表示原始数据后,找到了分界线!

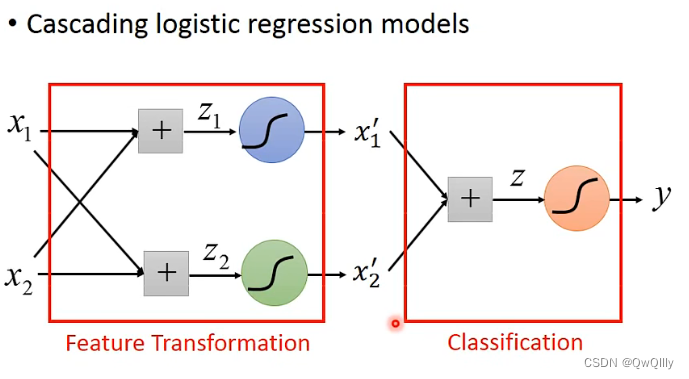

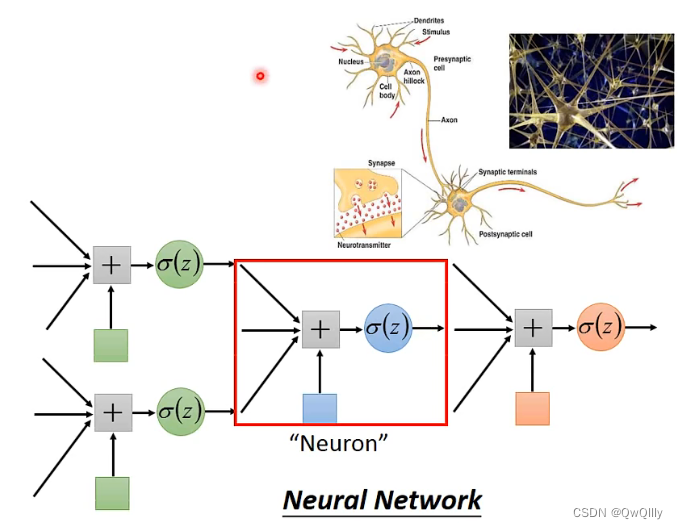

转换后找到了线性的分界线。这也就是神经网路的雏形。

通俗来说,就是做转换,不断多次深层次转换,变成到能够线性区分为止。

49

49

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?