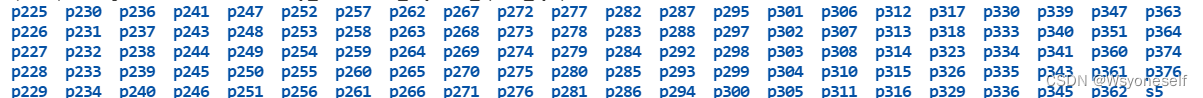

- 下载vctk数据集(下载路径:https://datashare.ed.ac.uk/download/DS_10283_3443.zip),下载后根据说话人分文件夹放置截图(110个人):

- vctk数据集理解:

- CSTR VCTK语料库包括110名英语使用者使用不同口音发出的语音数据。每个演讲者朗读大约400个句子,这些句子选自一份报纸、rainbow文章和一段用于语音重音档案的启发段落。

- 文本是根据贪婪算法选择的,贪婪算法可以增加上下文和语音覆盖率。

- 所有语音数据均使用相同的录音设置进行录音:一个全向麦克风(DPA 4035)和一个小振膜电容麦克风,带宽非常宽(Sennheiser MKH 800),采样频率为96kHz,24位,位于爱丁堡大学的半消声室中。

- 所有记录均转换为16位,降采样至48 kHz

- 该语料库最初用于基于HMM的文本到语音合成系统,尤其是基于说话人自适应HMM的语音合成,该合成使用多个说话人的平均语音模型和说话人自适应技术。该语料库也适用于基于DNN的多说话人文语合成系统和波形建模。**这里的思想和PCA提取人脸特征加上平均人脸来合成指定人脸的思想类似**

- VCTK语料库有几种变体:

- 语音增强:用于训练语音增强算法和TTS模型的噪声语音数据库,音频被人为地向VCTK添加了各种类型的噪声:http://dx.doi.org/10.7488/ds/2117

- 混响语音数据库,用于训练语音去混响算法和TTS模型,VCTK中人为添加了各种类型的混响http://dx.doi.org/10.7488/ds/1425

- 用于训练语音增强算法和TTS模型的噪声混响语音数据库http://dx.doi.org/10.7488/ds/2139

- 设备记录VCTK,其中VCTK语料库的语音信号被回放,并使用相对便宜的消费设备在办公环境中重新记录http://dx.doi.org/10.7488/ds/2316

- Microsoft可伸缩噪声语音数据集(MS-SNSD)https://github.com/microsoft/MS-SNSD

- ASV和反欺骗:

- 欺骗和反欺骗(SAS)语料库,是由九种技术产生的合成语音信号的集合,其中两种是语音合成,七种是语音转换。所有这些都是使用VCTK语料库构建的。http://dx.doi.org/10.7488/ds/252

- 自动说话人验证欺骗和对策挑战(ASVspoof 2015)数据库。该数据库由十种技术产生的合成语音信号组成,已用于第一次自动说话人验证欺骗和对抗挑战(ASVspoof 2015)http://dx.doi.org/10.7488/ds/298

- ASVspoof 2019:第三个自动说话人验证欺骗和对策挑战数据库。该数据库已用于第三次自动说话人验证欺骗和对策挑战(ASVspoof 2019)https://doi.org/10.7488/ds/2555

- 使用语料库需要增加的引用:

Christophe Veaux, Junichi Yamagishi, Kirsten MacDonald, "CSTR VCTK Corpus: English Multi-speaker Corpus for CSTR Voice Cloning Toolkit", The Centre for Speech Technology Research (CSTR), University of Edinbur

3428

3428

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?