活动地址:CSDN21天学习挑战赛

学习的最大理由是想摆脱平庸,早一天就多一份人生的精彩;迟一天就多一天平庸的困扰。各位小伙伴,如果您:

想系统/深入学习某技术知识点…

一个人摸索学习很难坚持,想组团高效学习…

想写博客但无从下手,急需写作干货注入能量…

热爱写作,愿意让自己成为更好的人…

学习目标:

跟着 大佬 GoatGui 学习

下面内容参考自 大佬在微信群发的内容。由于大佬没在csdn发,无法引链接,sorry!!!

大佬是一个人美声甜的小姐姐!!!

甜不甜美不美的小姐姐无所谓 ,主要是喜欢学习罢了!!!(口是心非)

还有的内容参考自 平台 、李宏毅大佬 等等

学习日记

1.学习知识点 – 回归分析

- 回归分析的理解

- 回归分析的运用场景

- 过拟合和欠拟合

- 模型的评价

- 正则项

a.回归分析的理解

回归分析(Regression Analysis) 是一种 统计学上分析数据的方法,用于了解两个或多个变量间是否相关、相关方向以及强度,来预测研究者感兴趣的变量。

常见分类: 线性回归、非线性回归、对数几率回归(主要用于分类)、自回归模型(AR模型:自己预测自己)

y=f(x) ,

Dx为训练集,x可为1维,也可为多维

R(f)即为结果集

f为训练的模型,起到函数映射的作用

因此,确定映射规则中除自变量x以外的参数与常数就是主要任务。

b.回归分析的运用场景

主要作用: 预测,用已知数据得到有用经验,预测未来 或 未发现的规律

常见场景:

预测股票/房价

城镇居民生活消费水平回归分析与预测

生活方式与高血压关系的Logistic回归分析

…

c.回归分析的运用场景

具体参考 大佬博客

难点 😦

不懂不懂,等死等死

- 对梯度下降法的理解

- 对于函数的参数的理解 即 (y=w1x1+w2x2+w3x3+…+wnxn+b ),如何理解这些 wi 和 偏置项b ? 那什么时候可以不必考虑b ?

- 线性回归有几种方式

- 为什么可以使用梯度下降法

- 如何证明梯度下降法可以优化损失函数

- 得到局部最优解而不是全局最优解该怎么办 (即如何逃离非最值的鞍点 )

- 如何自己写代码求函数的偏导?

- 那如果对于函数来说偏导不存在,那应该怎么自己估计偏导

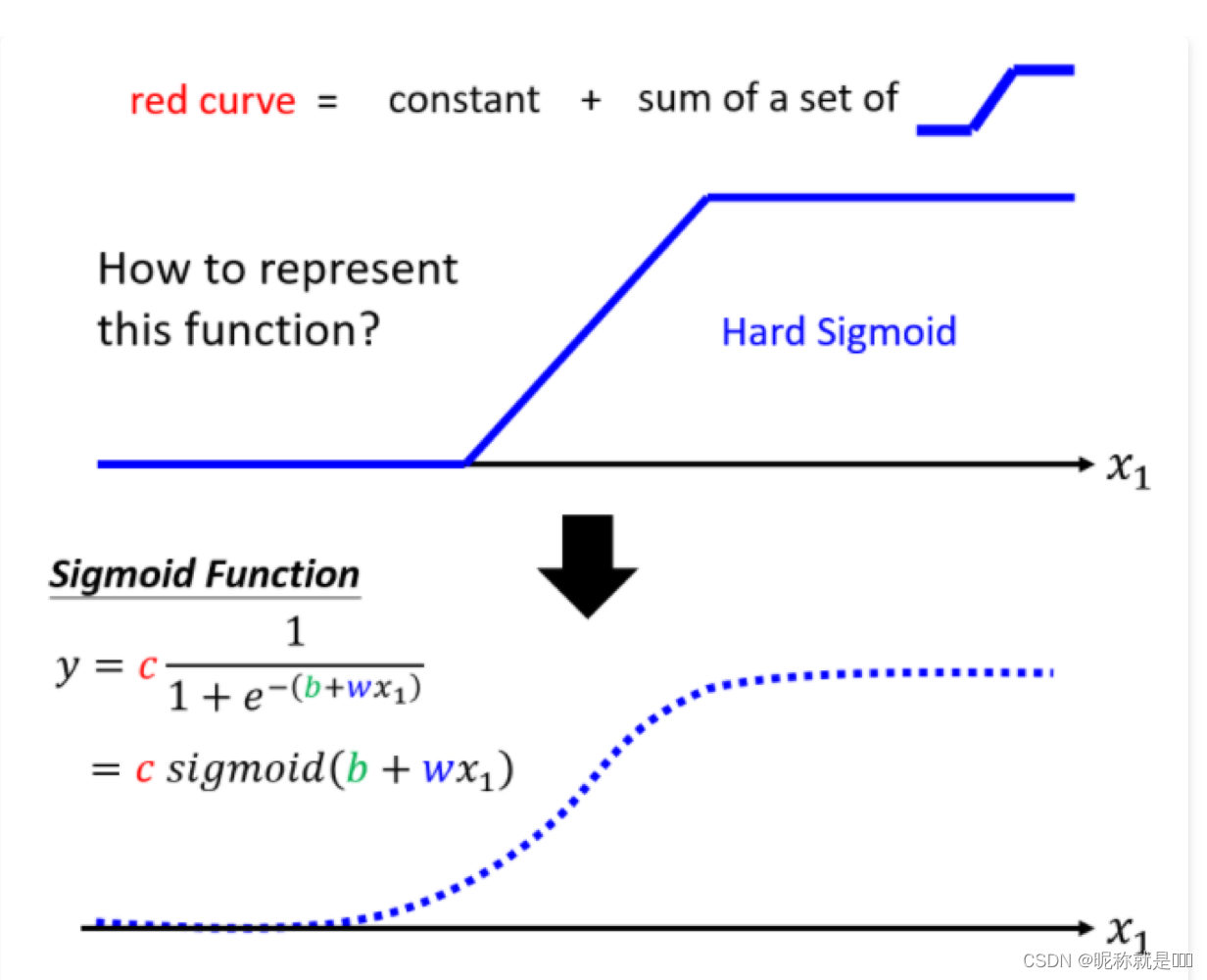

- 对于非线性 或者 分段函数 如何进行拟合 (下面三张图来自参考李宏毅大佬)

图1: 用多条直线y=wx+b表示分段函数

图2:上面的折线还是太过僵硬,变成下面的更好

图3:结合上面两图的情况

d.过拟合和欠拟合

过拟合和欠拟合 感觉没有分界点,本质上与具体的训练集和测试集得到的结果有关。但在更多情况下,更倾向于结果是平滑的曲线。

过拟合 :

- 训练数据集样本不足(覆盖不全面)

- 训练数据中噪声干扰过大(干扰过强)

- 模型过于复杂 (死记硬背,泛化能力差)

欠拟合:

由于模型学习能力较弱,而数据复杂度较高 或 数据量不足,此时模型由于学习能力不足,无法学习到数据集中的“一般规律”。

常见过拟合解决办法:

- 数据集增强

通过增加训练集的额外样本来增加训练集的大小,进而改进模型的泛化能力。- 降低模型复杂度

对于模型的设计而言,我们应该选择简单、合适的模型解决复杂的问>题。- Early stopping(提前终止)

即在模型对训练数据集迭代收敛之前停止迭代来防止过拟合。- 降低特征的数量

对于一些特征工程而言,可以降低特征的数量。- 使用正则化

在目标函数之后加上对于模型参数 W 的范数。在机器学习中一般使用 L2 正则化。L2 范数是指向量各元素的平方和然后求平方根。

常见欠拟合解决办法:

- 增加新特征 (增加维度 )

可以考虑加入新特征来增大假设空间- 添加多项式特征

可以将线性模型通过添加二次项或者三次项使模型泛化能力更强- 减少正则化参数

模型出现了欠拟合需要减少正则化参数- 调整模型的容量 (增加数据量)

可以适当增加模型的容量

e.模型的评价

常见评价方式有:

- 均方误差(MSE 即 Mean Squared Error) :

最常见,且比较适用- 均方根误差(RMSE 即 Root Mean Squared Error)

容易受异常点(误差很大的点影响)- 平均绝对误差(MAE 即 Mean absolute Error)

由于导数是常数,不利于梯度下降法迭代更新,且在为 0 处 值为 0- 平均绝对百分比误差(MAPE 即 Mean Absolutely Error Percentage)

数据点不能存在0值

e.正则项

很模糊,很玄学 (~~待学习)

2.学习遇到的问题(待学习项)

- 对正则化的知识点不清楚

- 对于矩阵求导不了解

- 线性回归对数据有什么要求,以及如何正确清除噪音

- 线性回归为什么用平方差形式的损失函数,有没有上面依据

- 线性回归有没有上面使用的前提

- 周志华大佬的 二分类学习 以及 多分类学习内容 没看懂

欢迎批评!!!

4646

4646

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?