在 InternLM Studio 上部署茴香豆技术助手

教程链接:Tutorial/huixiangdou/readme.md at camp2 · InternLM/Tutorial (github.com)

主要操作步骤:

1. 类似于第二课作业的环境配置,首先从官方环境复制运行 InternLM 的基础环境,命名为 InternLM2_Huixiangdou:

studio-conda -o internlm-base -t InternLM2_Huixiangdou2. 使用conda env list命令列出当前所有的conda环境,第二课作业中创建的demo环境还在,因为开发机的文件没有删除。

3. 使用conda activate <name_of_env>激活刚建好的conda环境,后续所有操作都在InternLM2_Huixiangdou环境中进行。重启开发机或打开新命令行后要重新激活环境。

conda activate InternLM2_Huixiangdou4. 下载运行茴香豆所需的模型文件:在/root/models下创建软链接指向开发机上下载好的InterLM-chat-7B模型和BCE模型。软链接的操作可以参考:Linux 软链接的增、删、改、查_软链接删除后看能否使用命令-CSDN博客

5. 下载安装茴香豆:首先pip install茴香豆所需的依赖环境,然后从官方代码仓库下载茴香豆。

6. 修改配置文件:将/root/huixiangdou/config.ini文件中的大模型和BCE模型地址改为我们刚才创建的软链接地址。

7. 创建基于茴香豆技术文档的知识库,从而实现在不重新训练的情况下使茴香豆具备回答技术文档相关内容的能力。另外,创建两个分别表示接受回答的问题和拒绝回答的问题的知识库,使茴香豆能够更精确地判断哪些问题需要作答,避免回答无关问题造成群内消息过多和资源浪费。在这一步中,通过编辑good_questions.json文件,在其中添加了一系列希望茴香豆作答的问题。

8. 基于建立的知识库,运行针对技术文档的茴香豆知识助手。

# 填入问题

sed -i '74s/.*/ queries = ["huixiangdou 是什么?", "茴香豆怎么部署到微信群", "今天天气怎么样?"]/' /root/huixiangdou/huixiangdou/main.py

# 运行茴香豆

cd /root/huixiangdou/

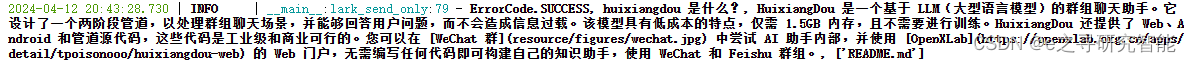

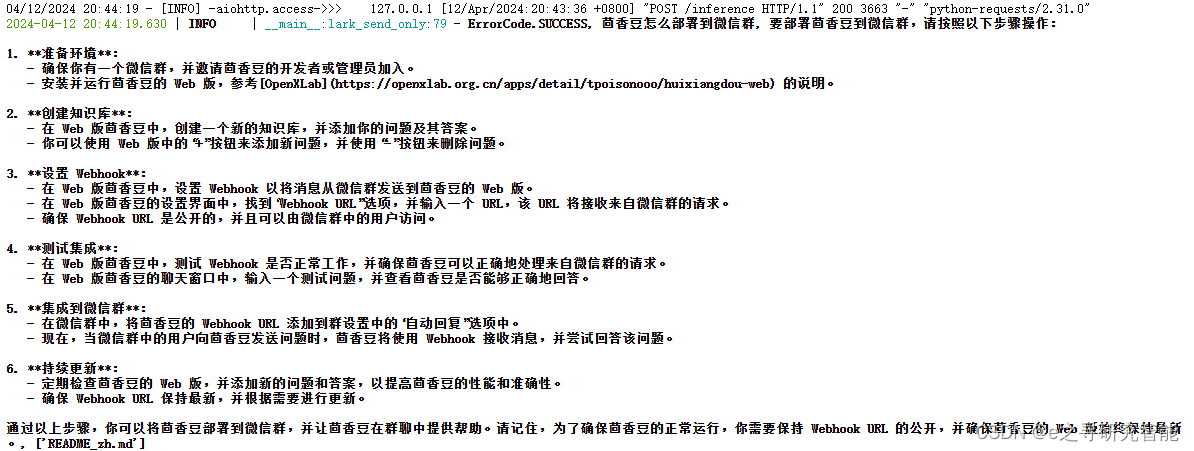

python3 -m huixiangdou.main --standalone这一步运行了三个问题:“huixiangdou是什么?”、“茴香豆怎么部署到微信群”以及“今天天气怎么样”。运行结果显示,针对前两个问题,茴香豆给出了回答:

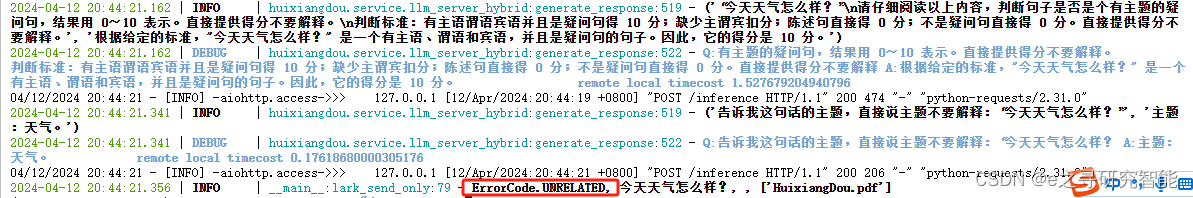

而对于最后一个问题,茴香豆判断为不相关问题,因此不给出回答:

403

403

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?