ELK 是一个流行的日志管理解决方案,它由 Elasticsearch、Logstash 和 Kibana 组成,用于收集、存储、搜索和可视化日志数据。下面是使用 ELK 解决日志管理问题的一般步骤:

- 安装和配置:

- 安装 Elasticsearch、Logstash 和 Kibana。这些组件可以单独安装,也可以使用 Elastic Stack 或者 Elastic Cloud 进行安装和管理。

- 配置 Elasticsearch,包括索引设置、分片和备份策略等。

- 配置 Logstash,设置数据收集、过滤和转发规则。

- 数据采集:

- 使用 Logstash 或者 Beats(如Filebeat、Metricbeat等)收集日志数据。Logstash 可以用于处理和转发结构化数据,而 Beats 更适合轻量级数据收集。

- 设置适当的输入插件和过滤器,确保从各种来源收集的日志能够被正确解析和标准化。

- 数据存储和索引:

- 数据被传输到 Elasticsearch 中进行存储和索引。

- 配置索引模板以确保数据被正确分片和存储。

- 搜索和分析:

- 使用 Kibana 创建仪表板、图表和报告,以便对日志数据进行搜索、可视化和分析。

- 利用 Elasticsearch 的强大搜索功能来执行复杂的查询和聚合操作。

- 安全和监控:

- 配置访问控制和安全策略,确保日志数据的安全性和隐私性。

- 监控系统性能和日志数据的完整性,及时发现和解决潜在的问题。

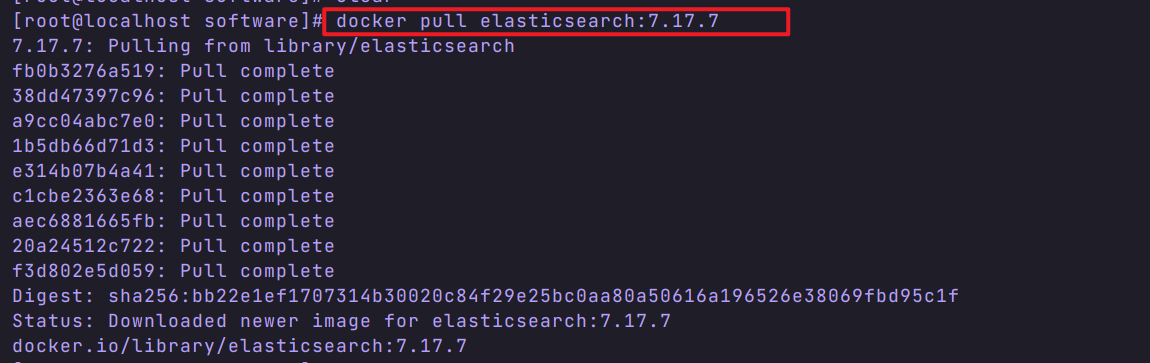

首先是搭建ElasticSearch

先拉取镜像

docker pull elasticsearch

接下来进行文件配置

[root@localhost elasticsearch]# mkdir conf

[root@localhost elasticsearch]# mkdir data

[root@localhost elasticsearch]# mkdir plugins

并且在conf文件夹下面创建elasticsearch.yml,修改权限777

[root@localhost elasticsearch]# cd conf/

[root@localhost conf]# touch elasticsearch.yml

[root@localhost conf]# chmod 777 elasticsearch.yml

创建运行容器

docker run -itd \

--name es \

--privileged \

--network docker_net \

--ip 172.18.12.70 \

-p 9200:9200 \

-p 9300:9300 \

-e "discovery.type=single-node" \

-e ES_JAVA_OPTS="-Xms4g -Xmx4g" \

-v /usr/local/software/elk/elasticsearch/conf/elasticsearch.yml:/usr/share/elasticsearch/config/elasticsearch.yml \

-v /usr/local/software/elk/elasticsearch/data:/usr/share/elasticsearch/data \

-v /usr/local/software/elk/elasticsearch/plugins:/usr/share/elasticsearch/plugins \

elasticsearch:7.17.7

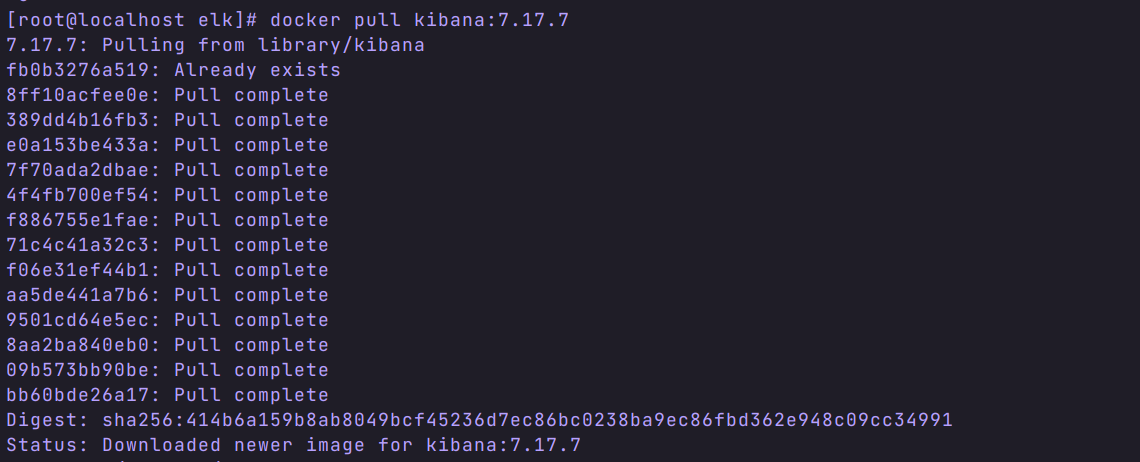

接下来进行安装kibana

首先拉取镜像

docker pull kibana

接下里进行容器运行

docker run -it \

--name kibana \

--privileged \

--network wn_docker_net \

--ip 172.18.12.71 \

-e "ELASTICSEARCH_HOSTS=http://192.168.201.6:9200" \

-p 5601:5601 \

-d kibana:7.17.7

TICSEARCH_HOSTS=http://192.168.201.6:9200"

-p 5601:5601

-d kibana:7.17.7

1337

1337

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?