夕小瑶科技说 原创

作者:谢年年

想必大家都知道,CV大神何恺明将在24年加入MIT EECS(电子工程和计算机科学系),而就在近日,何恺明在个人主页上官宣招收研究实习生和博士后,打算为团队注入新的血液。

个人主页链接:

https://kaiminghe.github.io/

未来三年研究重点:视觉自监督学习

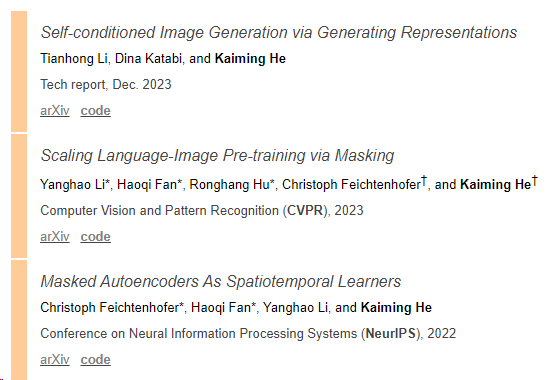

检索何恺明近两年发表的论文可以看到,多为表示学习、自监督学习、自编码器等方向。

何恺明也在个人主页中表示,他希望通过研究计算机视觉的问题,从复杂世界中学习表征,并应用到不同领域的通用方法。

我的研究涵盖了计算机视觉和深度学习领域的广泛话题。通过研究计算机视觉的问题,我希望开发出可以应用到不同领域的通用方法。我目前的研究重点是构建能够从复杂世界中学习表征和智能的计算机模型。我研究的长远目标是用更强大的人工智能来增强人类智能。

何恺明去年在香港中文大学参加一个讲座过程中也透露出:未来三年的研究重点是在CV领域复制自监督学习NLP中的成功。

怎么样才算成功呢?何恺明希望看到与语言模型相同的规模效应:只是增加模型的大小、数据量,就能看到视觉模型具有更强大的能力。

在自然语言处理中,句子词汇中已经包含了一些语义知识,而在图像中像素只是RGB,实际上不包含任何语义知识,这也是语言与视觉之间的根本区别。现在的视觉系统缺乏来自环境的反馈,这可能是视觉自监督学习的下一个研究主题。

所以,对该方向同样感兴趣的同学抓紧时间试一试,鼓起勇气发份简历,抱紧大佬的大腿!

恺明大神的邮箱在此:

kaiming@mit.edu

欢迎大家加入DLer-计算机视觉技术交流群!

大家好,群里会第一时间发布计算机视觉方向的前沿论文解读和交流分享,主要方向有:图像分类、Transformer、目标检测、目标跟踪、点云与语义分割、GAN、超分辨率、人脸检测与识别、动作行为与时空运动、模型压缩和量化剪枝、迁移学习、人体姿态估计等内容。

进群请备注:研究方向+学校/公司+昵称(如图像分类+上交+小明)

👆 长按识别,邀请您进群!

136

136

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?