本文从数据分布的角度研究了可转移性,并假设将图像从原始分布推离可以增强对抗可转移性,具体来说,将图像移除其原始分布,使得不同的模型很难对图像进行正确的分类,这样有利于非目标攻击,将图像拖入目标分布,则会误导模型将图像归类为目标类,这有利于目标攻击。为此,我们提出了一种新的方法,通过操纵图像的分布来制作对抗的例子。我们对多个dnn进行了全面的可转移攻击,以证明所提出方法的有效性。我们的方法可以显著提高精心设计的攻击的可移植性,并在无目标和有目标的场景中实现最先进的性能,在某些情况下超过之前的最佳方法高达40%。总之,我们的工作为研究对抗转移性提供了新的视角,并为未来的对抗防御研究提供了强有力的对应物。

作者借鉴分数匹配生成(score-matching generative models)的思想,提出估计真实数据分布的梯度并通过Langevin动力学,使用真实数据的估计梯度迭代地生成特定分布的图像。先前的工作都利用梯度来最大(或者最小化)模型的输出的交叉熵,在非目标(或者目标)攻击下。为了估计迁移攻击中真实数据分布的梯度,作者微调代理分类器以匹配模型条件密度的梯度和真实数据分布的梯度。 因此,微调模型的梯度可以近似于真实数据分布的梯度,并且微调模型的梯度生成对抗样本的过程可以近似于 Langevin 动力学的过程,这使能够操纵图像的分布。将使用微调模型将图像推离原始分布同时生成对抗样本的攻击称之为Distribution-Relevant Attack (DRA)。 更重要的是,DRA兼容现有的迁移攻击,可以大大提高这些攻击的性能。

文章的主要贡献:

- •我们从数据分布的角度对对抗性可移植性提供了新的理解,主张通过将图像从其原始分布中推开来增强对抗性可移植性。

- •我们引入了一种方法来匹配模型的梯度和数据分布的梯度,这使我们能够使用模型的梯度将图像推离其原始分布。

- •大量实验证明,我们的DRA在无目标和有目标攻击场景下都优于最先进的方法(在大多数情况下甚至高达40%)。

方法

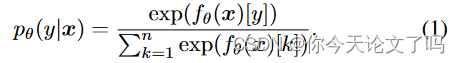

总类别:n :代表最后一层的第k个输出

条件概率密度:

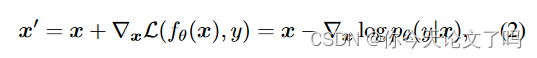

非目标攻击的目标是最小化条件概率密度:

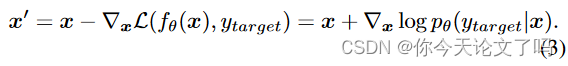

有目标攻击的目标是使条件概率密度最大化:

迁移攻击的目标是使用代理模型生成的对抗样本来误导目标模型。

现有的转移攻击很难成功地进行有针对性的攻击,并且缺乏解释为什么最小化代理模型的pθ(y|x)也可以欺骗与代理模型不同的模型参数和架构的目标模型。

在本文中,我们提出从数据分布的角度来理解和改进对抗可转移性,这建立在机器学习方法中的经典假设之上,即深度模型可以正确地分类与训练数据集独立且同分布的验证数据,但很难分类非分布的示例。具体而言,该模型倾向于将与pD(x|y)同分布的图像的标签预测为y,而不能很好地处理非分布图像。我们假设将图像移出其原始分布可以实现高的非目标对抗性转移,将图像拖入目标分布pD(x|ytarget)可以实现高的目标对抗性转移。挑战来自于如何将图像从其原始分布中推出,因为我们无法访问地面真相类条件数据分布pD (x|y)。

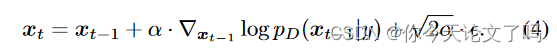

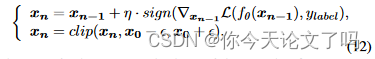

作者利用score-matching generative models来估计真实数据的分布,并借助Stochastic Gradient Langevin Dynamics (SGLD)将原始分布 的图像推到目标分布

当,

相当于从

中真实采样点,按照

的相反方向更新SGLD可以将图像原理分布

。故而,数据分布的梯度可以用于通过迭代方法操纵输入图像的分布。

本文,将正常对抗攻击梯度的条件密度根据真实数据类别的条件分布

进行匹配。

Decreasing the Distance Between Gradients

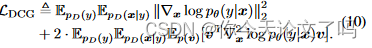

我们将log条件密度梯度与log地面真值类条件数据分布(DCG)梯度之间的距离定义为:

第一项是常数,因为不依赖模型的参数 。中间项是好处理的,因为没有涉及跟真实数据分布相关的分数。而最后一项是无法直接计算的,因为真实数据的分布是不清楚的

我们对式(5)中的最后一项进行分部积分:

经过一系列数学推导后:

相关的损失函数为:

作者通过使用Hutchinson技巧,最终确定DCG的损失函数为:、

在实践中,我们可以调整样本的数量v来平衡估计的性能和计算成本。参考现有的方法],我们在训练过程中对每个输入单独采样一个随机向量v。式(10)中的第一项可以通过一次反向传播计算。第二项涉及Hessian,但它是Hessian向量积的形式,可以在O(1)反向传播内计算。因此,式(10)的计算不依赖于数据的维数,并且在高维数据集上训练深度模型是可扩展的。

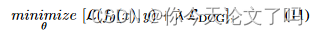

我们提出通过在训练过程中共同优化分类损失和DCG损失来对代理模型进行微调。优化目标可表示为:

Distribution-Relevant Attack

我们使用与分布相关的微调代理模型将这种攻击命名为与分布相关的攻击(DRA)。

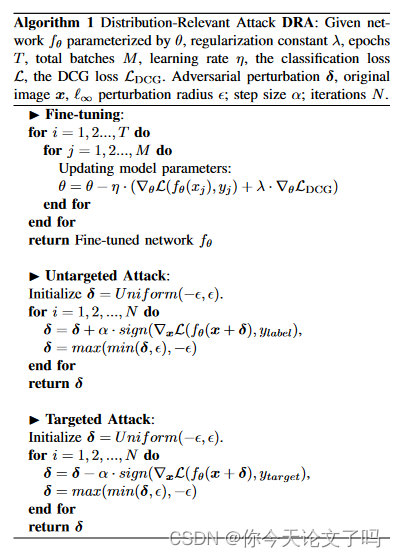

DRA包括两个步骤:

- 对代理模型进行微调以减小模型梯度与地面真相数据分布梯度之间的距离

- 使用微调代理模型在地面真相分布近似梯度的引导下产生对抗性扰动。

我们联合优化了DCG损耗LDCG和分类损耗L,对代理模型进行了微调。这个优化过程鼓励代理模型的梯度方向与地面真实数据分布的梯度方向相匹配。我们提出的微调方法旨在使攻击者能够使用模型的梯度将图像从其原始分布中推离。

算法:

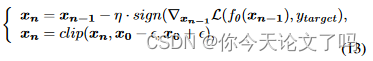

从而得到有目标和无目标攻击的公式:

无目标攻击:

有目标:

596

596

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?