1、启动hdfs集群,在node01上执行:

start-dfs.sh(hdfs集群)

start-yarn.sh(yarn服务)

或者执行start-all.sh全部启动

2、启动zookeeper,在所有机器上执行(配置了环境变量的):

zkServer.sh start(启动zookeeper服务)

zkServer.sh status(查看zk集群状态,两个follower,一个leader)

未配置环境变量,在ZOOKEEPER_HOME/bin 下执行:

./zkServer.sh start(启动zookeeper服务)

./zkServer.sh status(查看zk集群状态)

此时的进程:

3、启动hive数仓(我的配置下的启动顺序):

①node02上执行:hive --service metastore

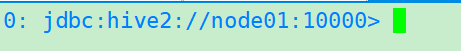

②node01上 执行:hiveserver2

③node03上执行:beeline -u jdbc:hive2://node01:10000 -u root

3921

3921

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?