1、Transformer

LSTM 和 transformer可以互相替代。

Long term dependency 是 rnn/lstm-based models 的主要问题。以及串行计算的高时间复杂度。shallow model,只在时间维度上deep,纵向的角度是浅层的。

Linear computation 是时序模型的通病。

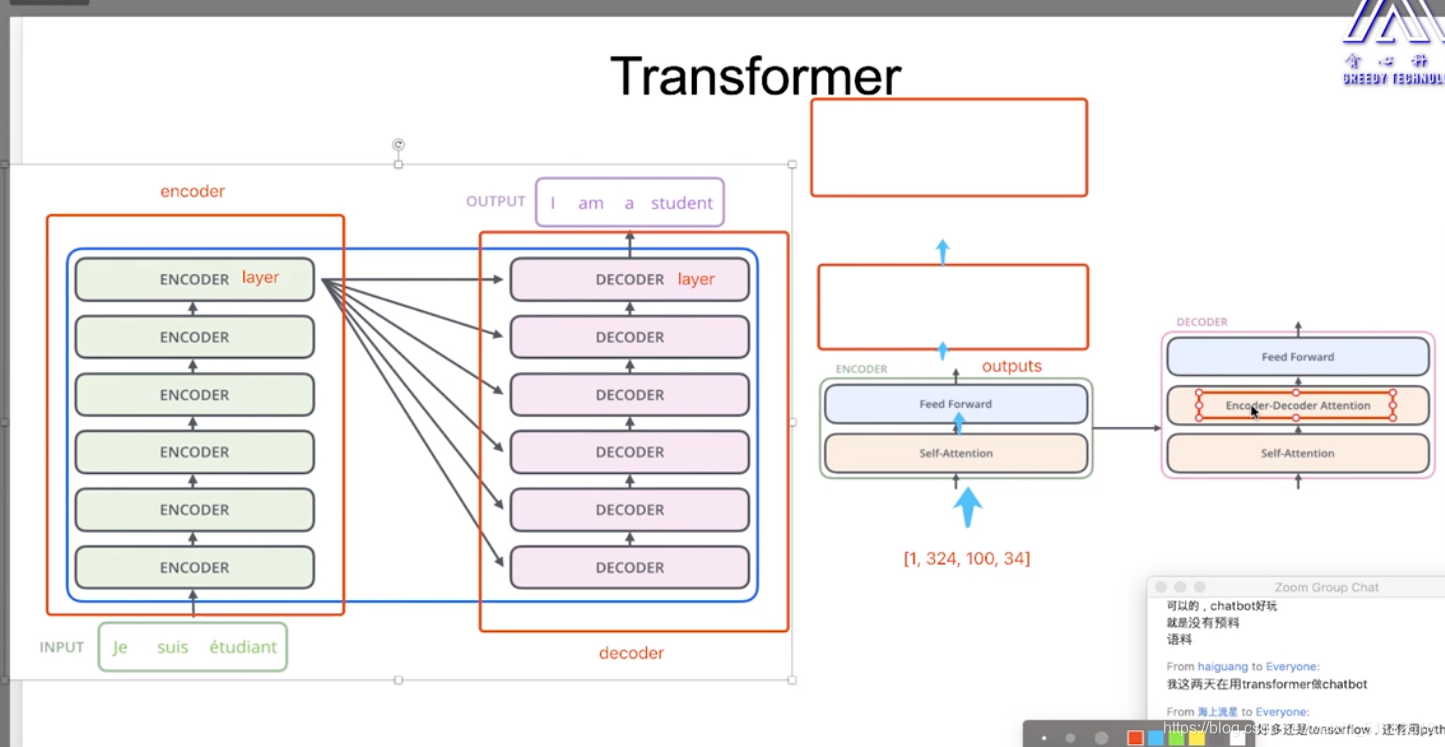

1.2 Transformer的结构

encoder+decoder: 每个部分都是deep的

每个encoder:self-attention+feed forward

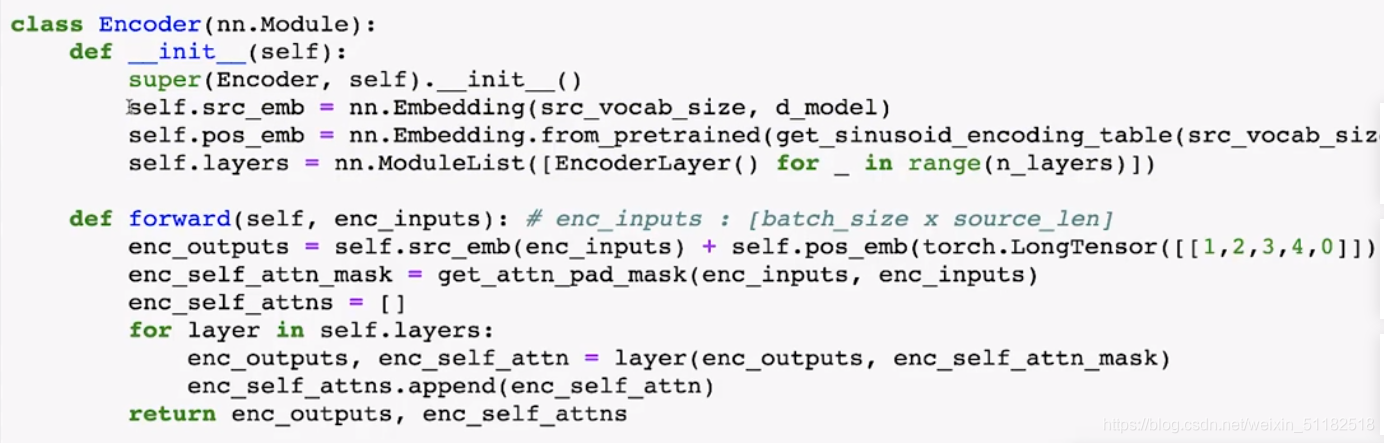

1.3 Encoder结构

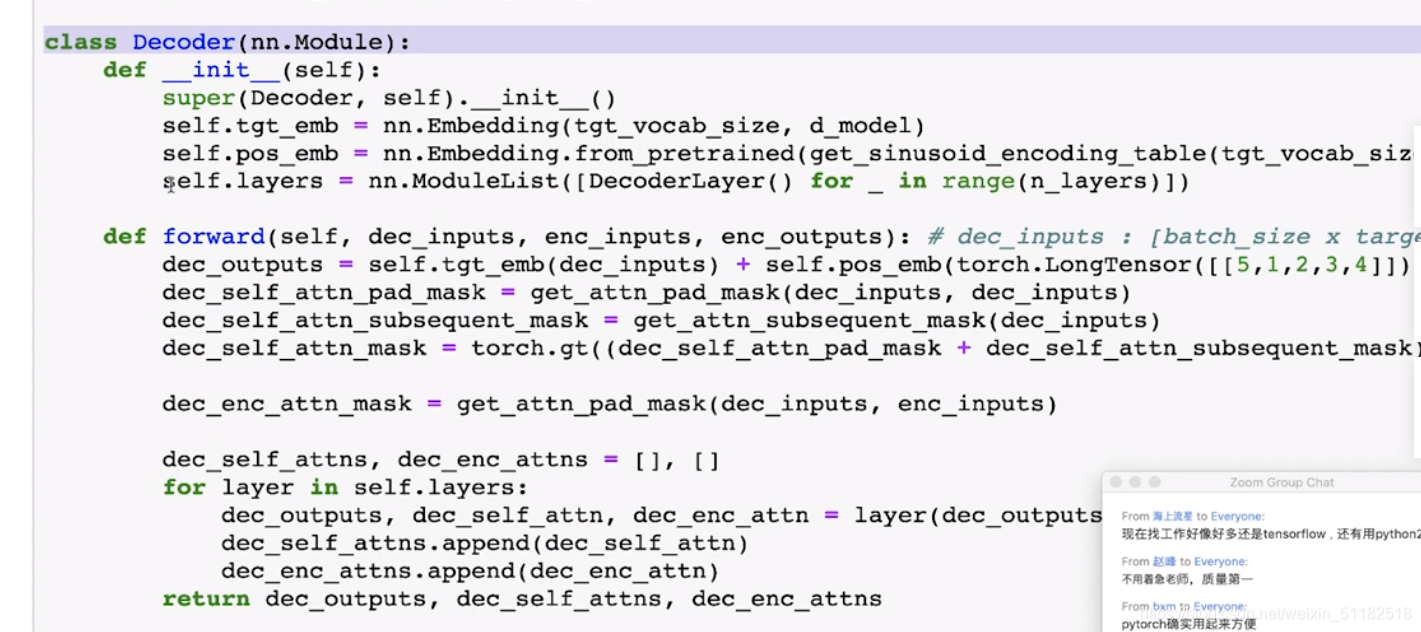

1.4 Decoder 结构

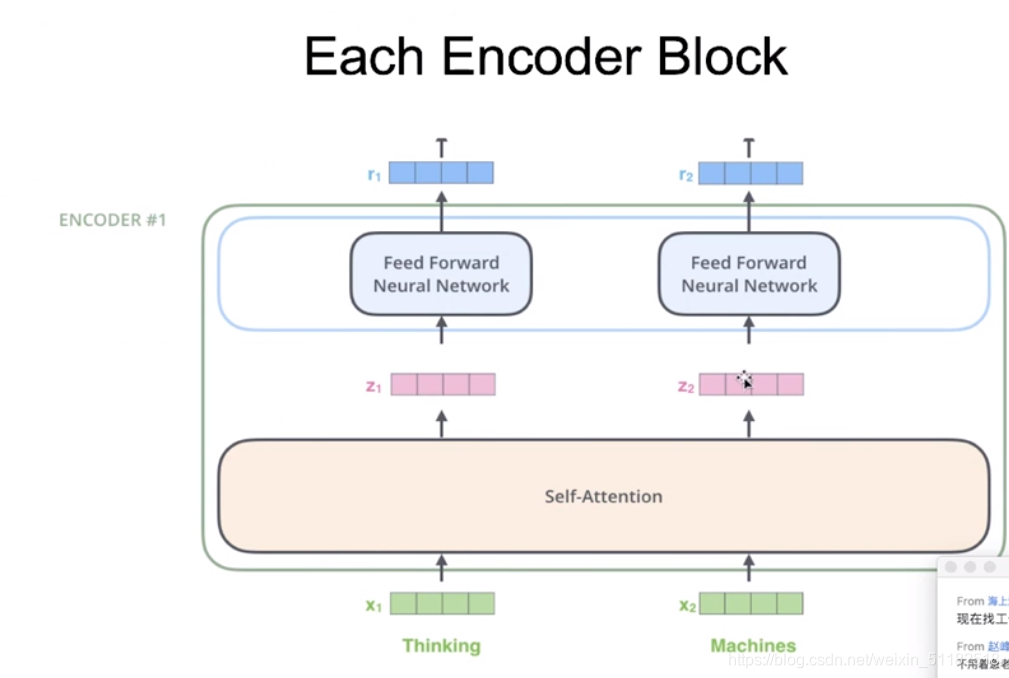

1.5 Each encoder block

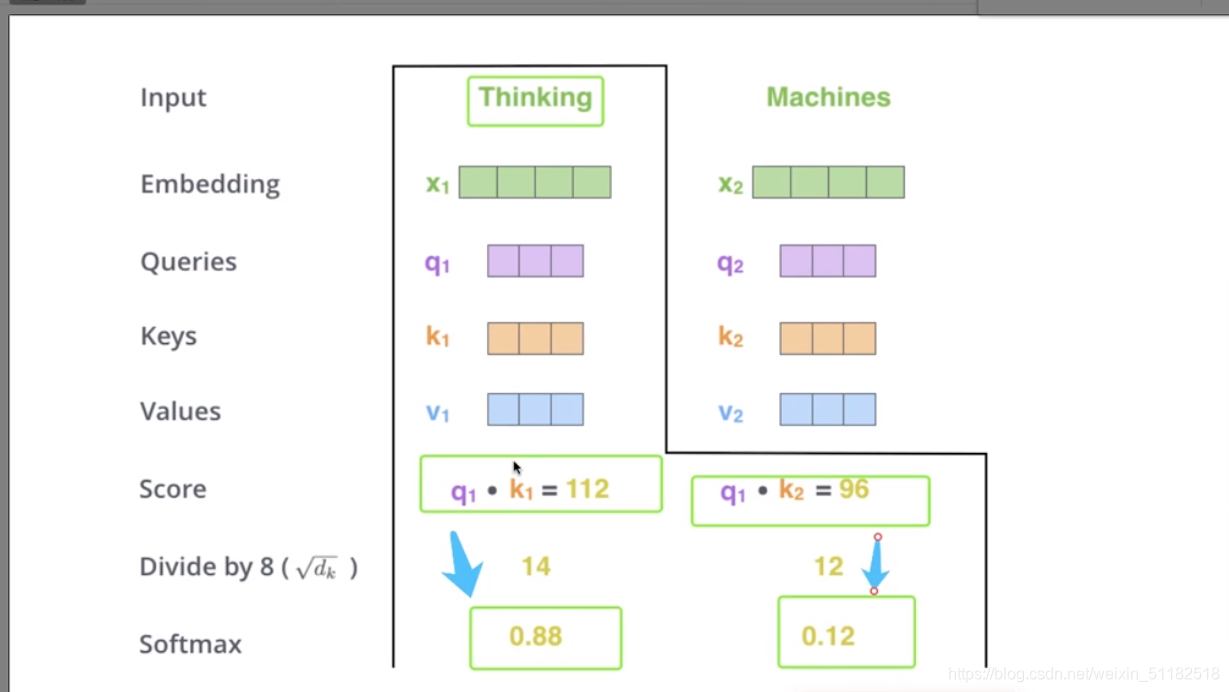

Self-attention:q,k,v

针对thinking这个单词,计算每个词对于它的依赖性的权值的过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

52

52

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?