本文重点主要有:

- 向量

- 欧式距离

- 曼哈顿距离

- 切比雪夫距离

理解向量

向量本质上就是一维数组。这里需要注意不要将向量的“维度”与待求解问题的维度混淆,即使待求解问题有10个输入通道,它依然是一个向量。向量始终是一维数组。

在人工智能算法中,向量通常用来存储某个具体实例的数据。

计算向量距离

两个向量之间的距离代表着二者的相似程度。

欧式距离

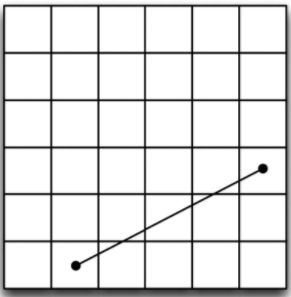

欧式距离度量是基于两个向量间实际的二维距离的,也就是说,如果把两个数据点画在纸上的话,欧式距离就是用直尺测量处理的两点间的偏差(距离)。二维距离的理论基础是毕达哥拉斯定理也就是勾股定理。

这个方法在比较长度为2的向量的时候效果很好,但实际上大多数向量长度都不止为2。所以要计算欧式距离的话我们需要用勾股定理的推广形式。

欧氏距离度量在机器学习中很常用,在比较相同长度的两个向量这种任务上十分高效。假设有a、b、c这3个向量,a、b之间的欧氏距离为10, a、c之间的欧氏距离为20,此时向量a代表的数据较之与向量c的匹配程度,就与向量b更为接近。

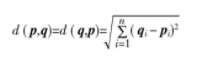

上面这个公式给出了p、q两个向量间的欧氏距离d,同时也指出了d(p, q)和d(q, p)是等价的,这就意味着欧氏距离仅取决于两个端点,与把哪个点作为起点无关。欧氏距离的计算过程不过是对向量中对应元素之差的平方逐个求和,然后取求和结果的平方根。这个平方根就是要求的欧氏距离。

伪代码如下:

function euclidean(position1,position2){

sum =

本文重点主要有:向量欧式距离曼哈顿距离切比雪夫距离理解向量向量本质上就是一维数组。这里需要注意不要将向量的“维度”与待求解问题的维度混淆,即使待求解问题有10个输入通道,它依然是一个向量。向量始终是一维数组。在人工智能算法中,向量通常用来存储某个具体实例的数据。计算向量距离两个向量之间的距离代表着二者的相似程度。欧式距离欧式距离度量是基于两个向量间实际的二维距离的,也就是说,如果把两个数据点画在纸上的话,欧式距离就是用直尺测量处理的两点间的偏差(距离)。二维距离的理论基础是毕达哥拉

本文重点主要有:向量欧式距离曼哈顿距离切比雪夫距离理解向量向量本质上就是一维数组。这里需要注意不要将向量的“维度”与待求解问题的维度混淆,即使待求解问题有10个输入通道,它依然是一个向量。向量始终是一维数组。在人工智能算法中,向量通常用来存储某个具体实例的数据。计算向量距离两个向量之间的距离代表着二者的相似程度。欧式距离欧式距离度量是基于两个向量间实际的二维距离的,也就是说,如果把两个数据点画在纸上的话,欧式距离就是用直尺测量处理的两点间的偏差(距离)。二维距离的理论基础是毕达哥拉

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1670

1670

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?