计算机视觉:聚类算法(K-Means)实现图像分割

什么是K-means聚类?

K-means聚类是一种无监督学习算法,用于将一组数据划分为K个不同的类别或簇。它基于数据点之间的相似性度量,将数据点分配到最接近的聚类中心。K-means算法的目标是最小化数据点与其所属聚类中心之间的平方距离和。

K-means聚类在图像分割中的应用

在图像分割中,K-means聚类可以用于将图像中的像素点分为不同的区域或对象。每个像素点可以表示为具有不同特征值的数据点。例如,可以使用像素的颜色值作为特征来执行基于颜色的图像分割。

使用K-means算法进行图像分割的步骤

- 图像预处理:在应用K-means算法之前,通常需要对图像进行预处理。预处理步骤可以包括图像大小调整、颜色空间转换、滤波等操作,以提取图像中的关键特征并减少噪音。

- 数据表示:将图像转换为适合K-means算法处理的数据表示形式。常见的表示形式包括每个像素的颜色特征向量或像素的位置特征向量。

- 选择聚类数:根据实际需求选择合适的聚类数K。聚类数决定了分割后的图像区域数量。

- 运行K-means算法:将图像数据输入K-means算法,并迭代更新聚类中心,直到算法收敛或达到预定的迭代次数。

- 分割结果可视化:根据聚类结果,将图像中的像素分配到不同的聚类簇,并使用合适的颜色或灰度级别将不同区域进行可视化展示。

实现代码

import numpy as np

import cv2

def preprocess_image(image):

# 将图像转换为浮点型,并进行归一化

normalized_image = image.astype(np.float32) / 255.0

# 调整图像大小(可根据需要调整)

resized_image = cv2.resize(normalized_image, (500, 500))

# 进行模糊处理,以减少噪音

blurred_image = cv2.GaussianBlur(resized_image, (5, 5), 0)

return blurred_image

def kmeans_segmentation(image, num_clusters):

# 将图像转换为一维向量

pixel_values = image.reshape(-1, 3).astype(np.float32)

# 运行K-means算法

criteria = (cv2.TERM_CRITERIA_EPS + cv2.TERM_CRITERIA_MAX_ITER, 100, 0.1)

_, labels, centers = cv2.kmeans(pixel_values, num_clusters, None, criteria, 10, cv2.KMEANS_RANDOM_CENTERS)

# 将每个像素分配到最近的聚类中心

segmented_image = centers[labels.flatten()].reshape(image.shape)

return segmented_image

# 加载图像

image = cv2.imread('ex5/animal.jpg')

# 预处理图像

processed_image = preprocess_image(image)

# 对图像进行K-means分割

num_clusters = 100 # 设置聚类簇的数量

segmented_image = kmeans_segmentation(processed_image, num_clusters)

# 显示原始图像和分割结果

cv2.imshow('Original Image', image)

cv2.imshow('Segmented Image', segmented_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

实验结果

原图

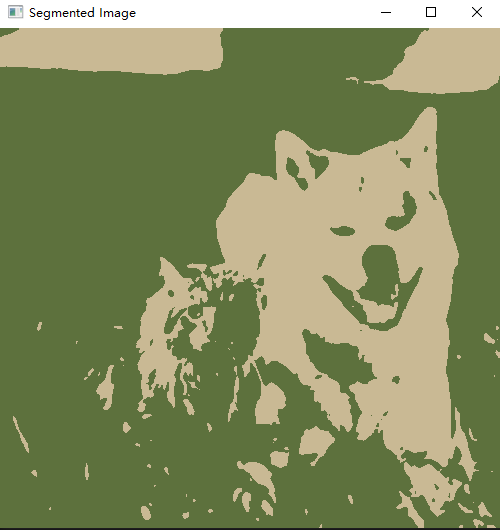

k=2

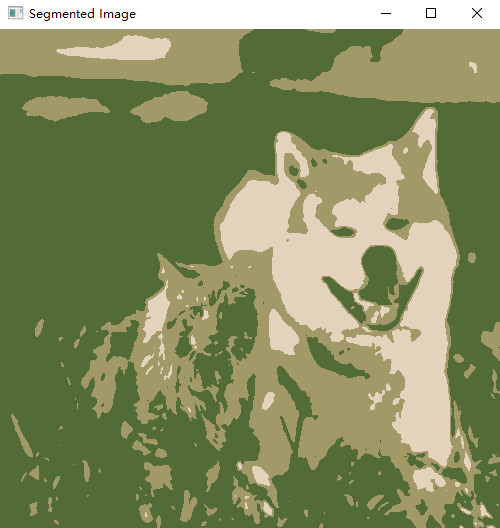

k=3

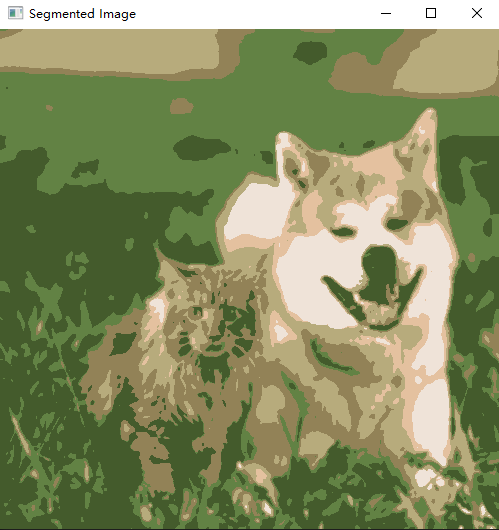

k=6

分析

K-means算法根据像素的颜色相似性将图像分割成不同的区域。分割结果展示了图像中不同区域的颜色聚类,相似颜色的像素被分配到同一个聚类簇中。通过分割结果可以清晰地看到图像中的不同物体或区域被分割出来,每个区域具有相似的颜色特征。

聚类簇数量选择会影响分割结果。较少的聚类簇数量可能导致细节丢失,将多个不同的物体或区域合并在一起;较多的聚类簇数量可能导致过细的分割,将一个物体或区域细分成多个部分。因此,选择合适的聚类簇数量对于获得良好的分割结果非常重要。即较小的K值可能导致合并和丢失细节,较大的K值可能导致过度细分。选择适当的聚类数量是实现准确图像分割的关键。

文章介绍了K-Means聚类算法,一种无监督学习方法,如何用于图像分割。通过预处理、数据表示、选择聚类数、运行算法和结果可视化等步骤,将图像像素按颜色相似性分组。实验展示了不同聚类数(k=2,3,6)对分割效果的影响,强调选择合适K值的重要性。

文章介绍了K-Means聚类算法,一种无监督学习方法,如何用于图像分割。通过预处理、数据表示、选择聚类数、运行算法和结果可视化等步骤,将图像像素按颜色相似性分组。实验展示了不同聚类数(k=2,3,6)对分割效果的影响,强调选择合适K值的重要性。

1028

1028

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?