引言

小红书是一个集社区和电商于一体的平台,用户可以分享各类生活经验和商品推荐。对于数据分析师和市场研究员而言,从小红书抓取图片和相关内容可以为研究提供丰富的数据资源。本文将介绍如何使用Python脚本从小红书抓取图片,并对这些图片进行处理和保存。

环境准备

首先,确保你的开发环境中已经安装了以下Python库:

selenium:用于模拟浏览器行为。beautifulsoup4:用于解析HTML和XML文档。requests:用于发起网络请求。PIL(Pillow):用于图像处理。

selenium确实有点慢,但有时候为了不处理加密用它也省很多事。

一些防止指纹检测的基本配置,没什么好说的,每次用都带上得了。

格式化保留关键词的位置,然后因为cookie有加密

脚本功能概述

本脚本的主要功能是:

- 使用Selenium打开小红书网站,并搜索特定关键词。

- 模拟用户滚动页面以加载更多内容。

- 使用BeautifulSoup解析页面,提取图片链接。

- 使用requests库下载这些图片,并保存到本地。

详细步骤解析

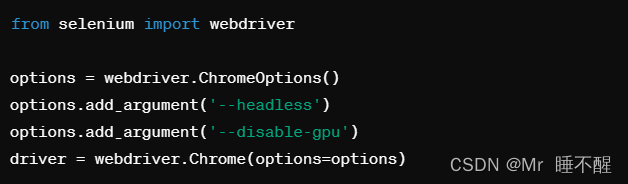

步骤1: 配置Selenium和WebDriver

首先需要配置Selenium的WebDriver,这通常涉及设置浏览器的参数,如是否以无头模式运行,以及如何处理网页上的图片加载等:

步骤2: 打开小红书并搜索关键词

通过Selenium打开小红书的搜索结果页面,输入用户提供的关键词:

步骤3: 页面滚动与数据加载

为了加载足够的内容,脚本将模拟用户滚动页面:

步骤4: 解析页面并提取图片链接

使用BeautifulSoup解析更新后的页面内容,并找出所有图片的链接:

步骤5: 下载并保存图片

提取到的链接将被用来下载图片,并使用PIL库保存到本地:

结论

通过本文的指导,你可以构建一个自动化工具来从小红书获取大量图片,这些图片可以用于后续的数据分析或机器学习项目。记得在使用爬虫技术时,要遵守目标网站的使用条款,合理合法地使用数据。

注意事项

- 需要考虑网站的反爬虫策略,合理设置请求频率和模式。

- 确保遵守数据的版权和隐私政策。

这篇文章提供了从小红书网站抓取图片的完整步骤和代码示例,可以帮助你开始你的数据采集项目。如果你有任何问题或需要进一步的帮助,请在评论区留言或直接联系我们。

1575

1575

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?