课程链接:InternLM/Tutorial at camp2 (github.com)

课程录播链接:书生·浦语大模型全链路开源体系_哔哩哔哩_bilibili

InternLM2技术报告:arxiv.org/pdf/2403.17297.pdf

1.书生浦语模型家族

2.从基座模型到大模型应用的过程

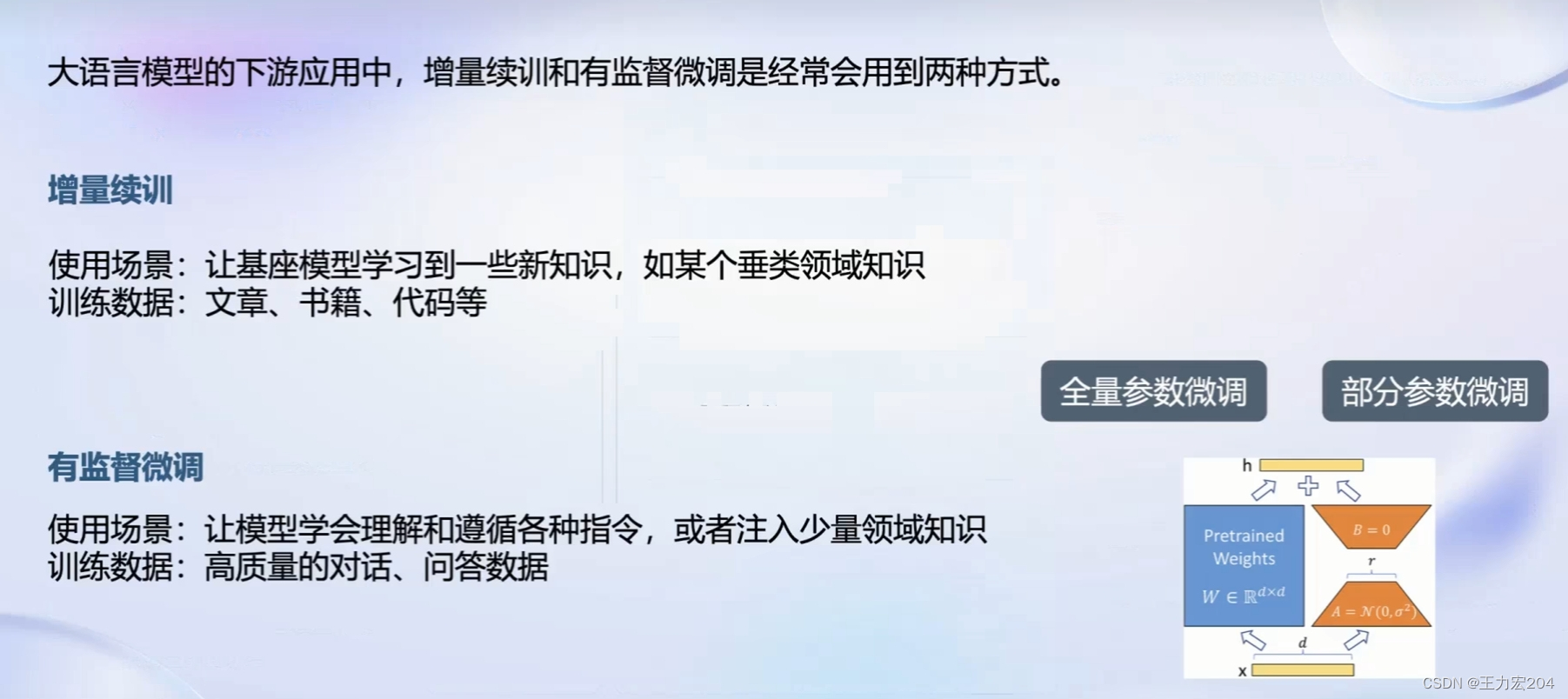

根据自身业务场景结合自身算力,选择合适参数规模的基座模型与微调方法,例如在jetson Nano上部署时,由于显存只有4GB,可选择1.8B模型作为基座模型。

3.书生浦语开发工具集

提供数据集->预训练->微调->部署->评测->应用全套工具。

3.1书生万卷:GitHub - opendatalab/WanJuan1.0: 万卷1.0多模态语料

3.2InternLM-Train:

只需修改配置文件,即可实现不同模型、不同数据集下的训练。

3.3XTuner:

内置Lora、QLora等多种微调算法.

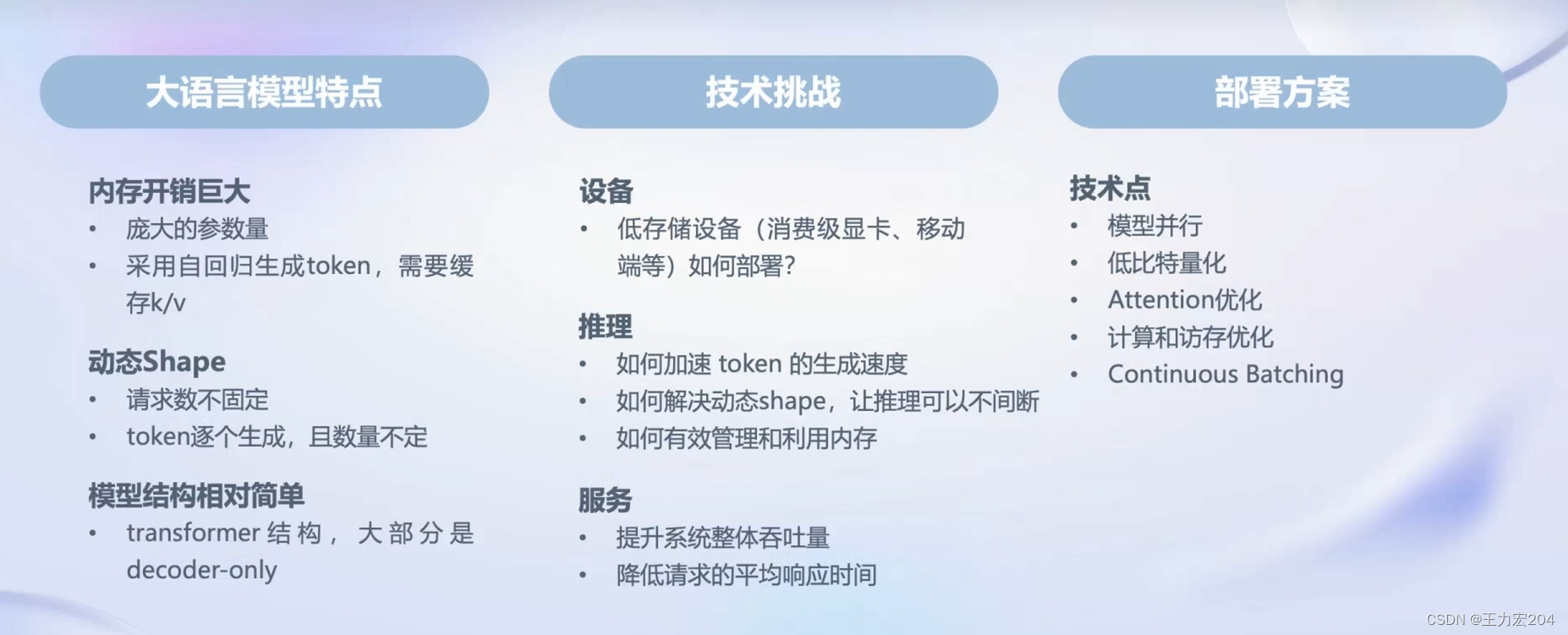

3.4LMDeploy:

支持高效部署,内置INT4、INT8量化实现。GitHub - InternLM/lmdeploy: LMDeploy is a toolkit for compressing, deploying, and serving LLMs.

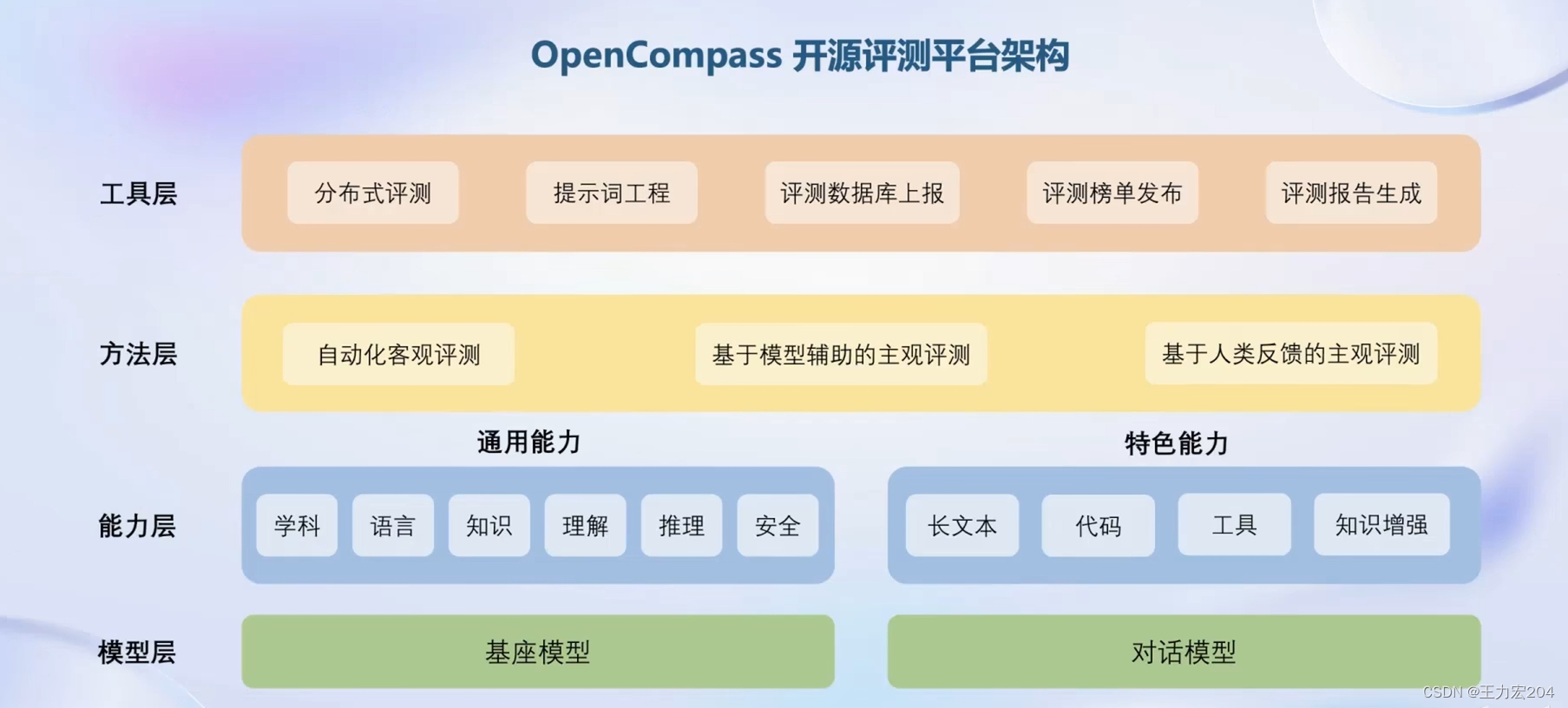

3.5OpenCompass:https://github.com/open-compass/opencompass

提供非常全面的评测体系。被Meta推荐。

3.6Lagent:GitHub - InternLM/lagent: A lightweight framework for building LLM-based agents

智能体构建工具包,构建智能体查询外部资料如网站、文档等,提高模型回答准确性与可靠性。同时支持图像、文字、语音等多种模态。

770

770

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?