1.Windows上模型部署

根据之前所述的deepseek部署教程,在性能较好的windows电脑上进行本地模型部署。

主要完成:

1.下载ollama并安装

2.修改模型存放路径

3.下载自己所需的ollama模型

2.Windows上配置说明

在完成上述操作后,我们就可以完成在本地调用ollama模型了;为了完成远程调用,需要对我们完成第一步的电脑进行一些配置:

a.设置环境变量

为了让局域网内的其他设备能够访问Ollama服务,需要设置环境变量

OLLAMA_HOST,使其监听局域网的IP地址。具体步骤如下:

- 右键点击“此电脑”或“计算机”,选择“属性”。

- 在左侧点击“高级系统设置”。

- 在弹出的窗口中,点击“环境变量”。

- 在“系统变量”部分,点击“新建”。

- 在“变量名”输入框中输入

OLLAMA_HOST,在“变量值”输入框中输入0.0.0.0,然后点击“确定”。- 同理,添加OLLAMA_ORIGINS,变量值:*,然后全部点击确定。

- 设置完成后,关闭并重新打开命令行窗口与ollama软件,使新的环境变量生效。

b. 开放防火墙端口

为了使其他设备能够访问Ollama服务,还需要在Windows防火墙中开放Ollama服务使用的端口(例如11434)。可以通过图形界面或命令行来完成设置。图形界面设置步骤如下:

- 打开“控制面板”,搜索并选择“Windows Defender 防火墙”。

- 在左侧点击“高级设置”,进入高级防火墙设置页面。

- 在左侧菜单中,点击“入站规则”,然后在右侧点击“新建规则”。

- 选择“端口”作为规则类型,然后点击“下一步”。

- 选择“TCP”,并在“特定本地端口”一栏中输入11434,然后点击“下一步”。

- 选择“允许连接”,点击“下一步”。

- 根据需求选择应用的网络类型(域、专用或公用),点击“下一步”。

- 为这条规则命名(如“Allow Ollama Port 11434”),然后点击“完成”。

完成上述设置后,Ollama服务应该可以通过局域网中的其他设备访问。

3.同一局域网下访问设备设置

以自己性能较差的电脑作为访问设备对模型进行访问,完成远程调用,这里依然是在同一局域网下操作。

如何测试两台设备处于统一局域网,参考:

如何判断两台设备是否在同一局域网内_如何判断两个设备在同一局域网-CSDN博客![]() https://blog.csdn.net/guojunxiu/article/details/88778766

https://blog.csdn.net/guojunxiu/article/details/88778766

a.下载Chatbox

在我们自己需要提问的电脑上进入chatbox官网下载chatbox软件并安装。

b.软件设置

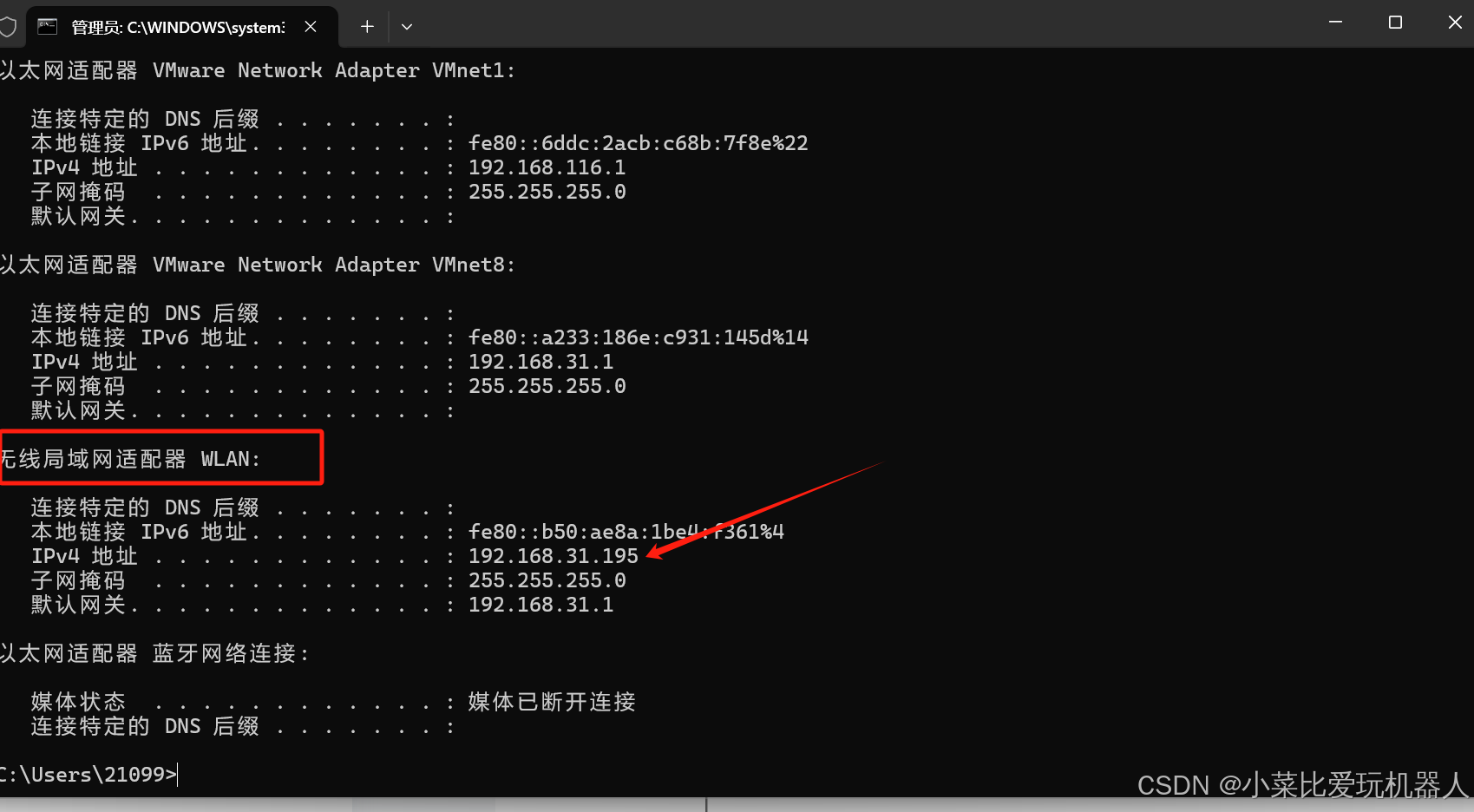

(1)首先获取完成了步骤一电脑的局域网络ip地址,这里确保两台设备在同一网络的前提下,使用Win+R输入cmd打开终端,使用ipconfig来查询该电脑的ip地址。如图,我这里使用wifi故ip地址为192.168.31.195。

(2)下载完成后chatbox后如图所示,选择模型提供方为OLLAMA API,将API域名处中间的127.0.0.1修改为刚才查询到的ip地址。此时就可以选择模型了,这里选择到的模型就是之前电脑上的模型。

此时,就可以进行测试了,测试参考:

4.不同网络下访问设备设置

1. 安装Cpolar

要实现Ollama的外网访问,可以使用Cpolar进行内网穿透。首先,从Cpolar的官方网站注册一个账号,并下载最新版本的Cpolar安装程序。安装完成后,使用Cpolar账号登录。

2. 配置Cpolar隧道

登录Cpolar后,在Web配置界面中创建一个新的隧道。具体步骤如下:

- 登录Cpolar的Web UI管理界面。

- 点击左侧仪表盘的“隧道管理”——“创建隧道”。

- 填写隧道名称(可自定义),选择协议,并设置本地地址为Ollama服务的端口(例如11434)。

- 选择域名类型为二级子域名,并设置地区为中国VIP。

- 复制并保留生成的二级子域名。

3. 配置Ollama服务

在Windows上,还需要配置Ollama服务以支持外网访问。具体步骤如下:

- 点击“控制面板”,进入编辑系统环境变量。

- 在系统变量下新建名为

OLLAMA_ORIGINS的环境变量,值为*。- 确保

OLLAMA_HOST环境变量的值仍为0.0.0.0。- 重启Ollama服务。

4. 测试外网访问

完成上述配置后,可以通过Cpolar生成的公网地址访问Ollama服务。在浏览器中输入公网地址和端口号(如

http://<cpolar生成的二级子域名>:11434),如果服务成功启动,页面应显示Ollama API的相关信息。

1453

1453

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?