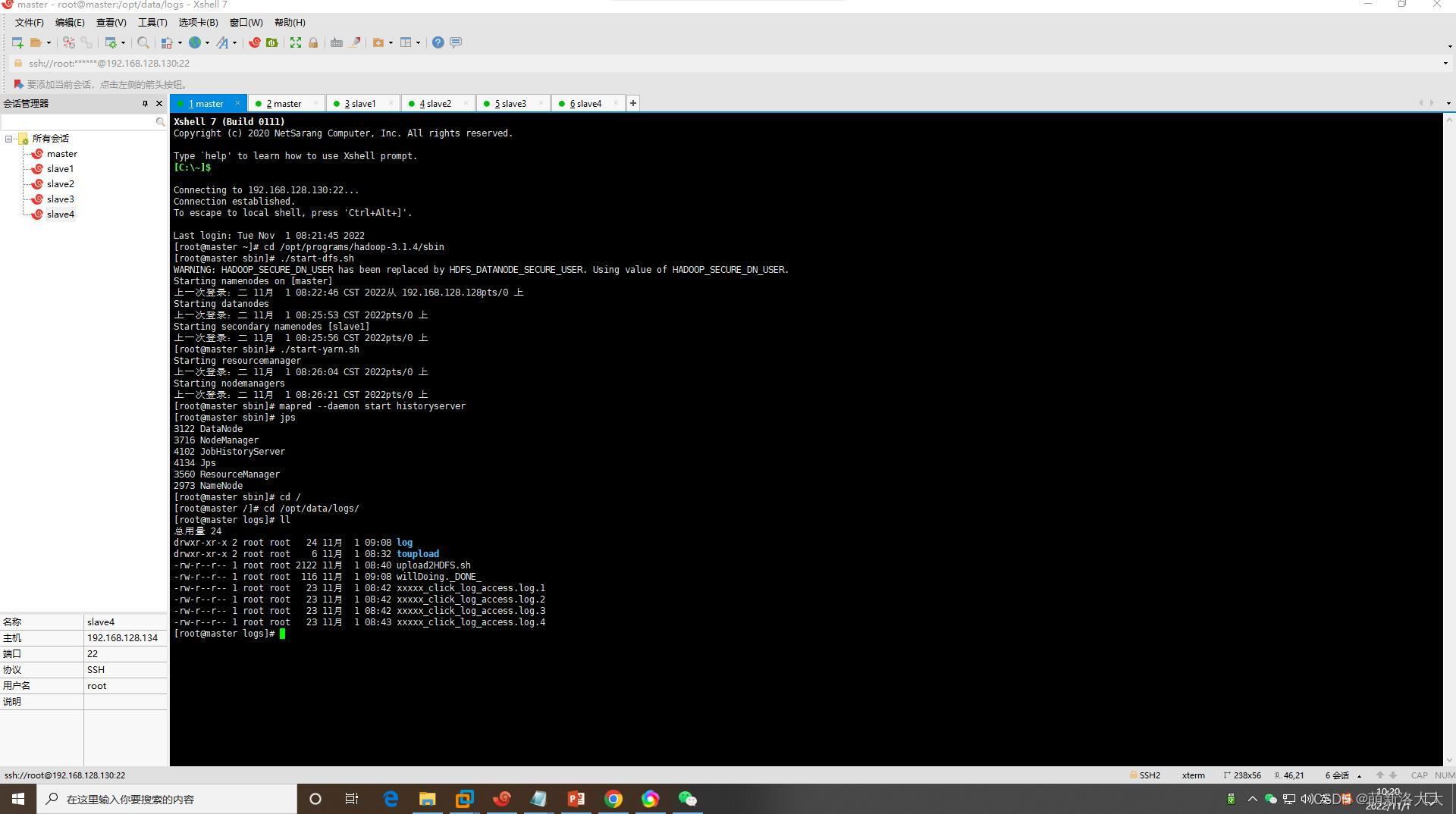

先开集群,在logs目录底下创脚本文件upload2HDFS.sh(vim upload2HDFS.sh)

脚本内容:

#!/bin/bash 脚本开头,固定格式

#JAVA_HOME环境变量设置

export JAVA_HOME=/usr/java/jdk1.8.0_171-amd64

export PATH=$PATH:$JAVA_HOME/bin

#HADOOP_HOME环境变量设置

export HADOOP_HOME=/opt/programs/hadoop-3.1.4

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

#日志文件存放的目录

log_src_dir=/opt/data/logs/log/

#待上传文件存放的目录

log_toupload=/opt/data/logs/toupload/

#设置日志文件上传的路径

#设置日期

date1=$(date -d last-day +%Y_%m_%d)

#日志文件上传到hdfs的根路径

hdfs_root_dir=/data/clicklog/$date1/

#打印环境变量信息<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

720

720

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?