摘要

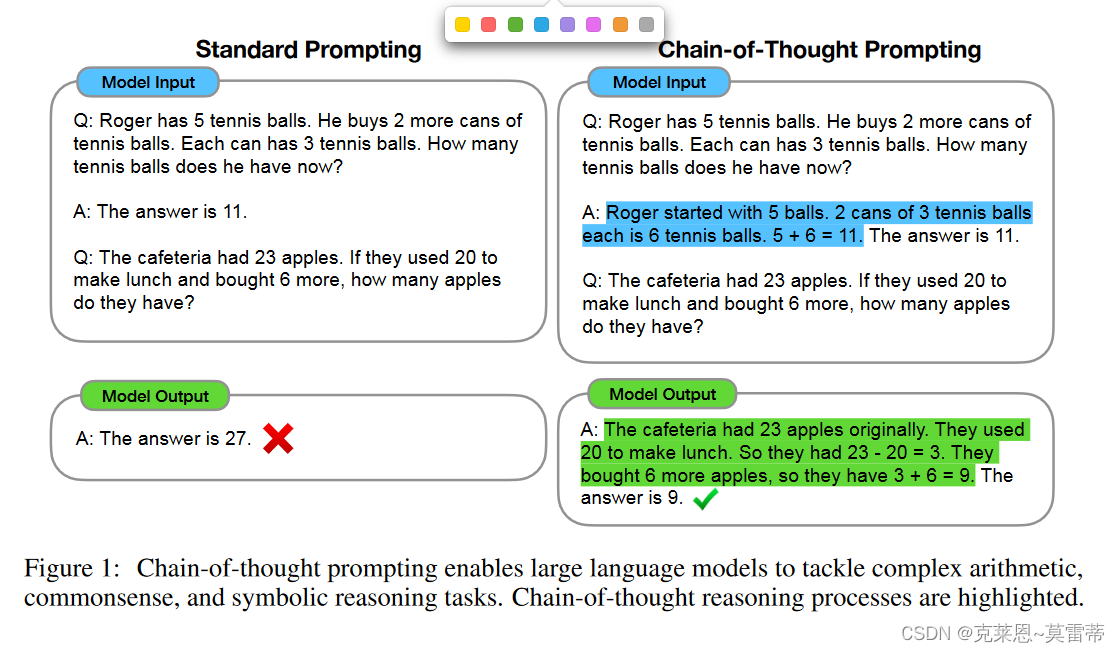

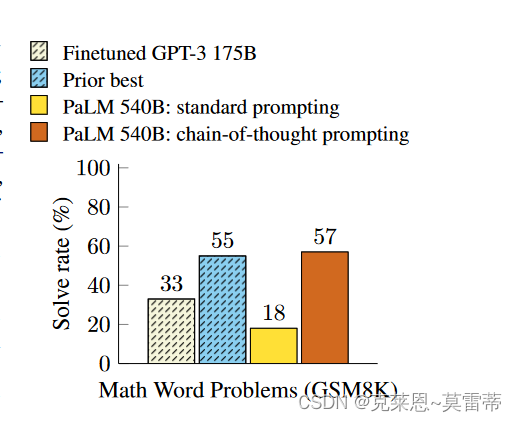

我们探索生成一条思想链(一系列中间推理步骤)如何显着提高大型语言模型执行复杂推理的能力。特别是,我们展示了这种推理能力如何通过一种称为COT的简单方法在足够大的语言模型中emergent,其中提供了一些思维链演示作为提示的范例。对三种大型语言模型的实验表明,思维链提示可以提高一系列算术、常识和符号推理任务的表现。经验收益可能是惊人的。例如,仅用八个思维链示例来提示 PaLM 540B,即可在数学应用题的 GSM8K 基准上达到最先进的精度,甚至超过带有验证器的微调 GPT-3。

下图是COT的直观展示

引言

扩大语言模型的规模可以带来一系列好处,例如提高性能和样本效率。然而,事实证明,仅扩大模型大小不足以在算术、常识和符号推理等具有挑战性的任务上实现高性能。

作为促进语言模型推理的方法,思维链提示具有几个有吸引力的特性。

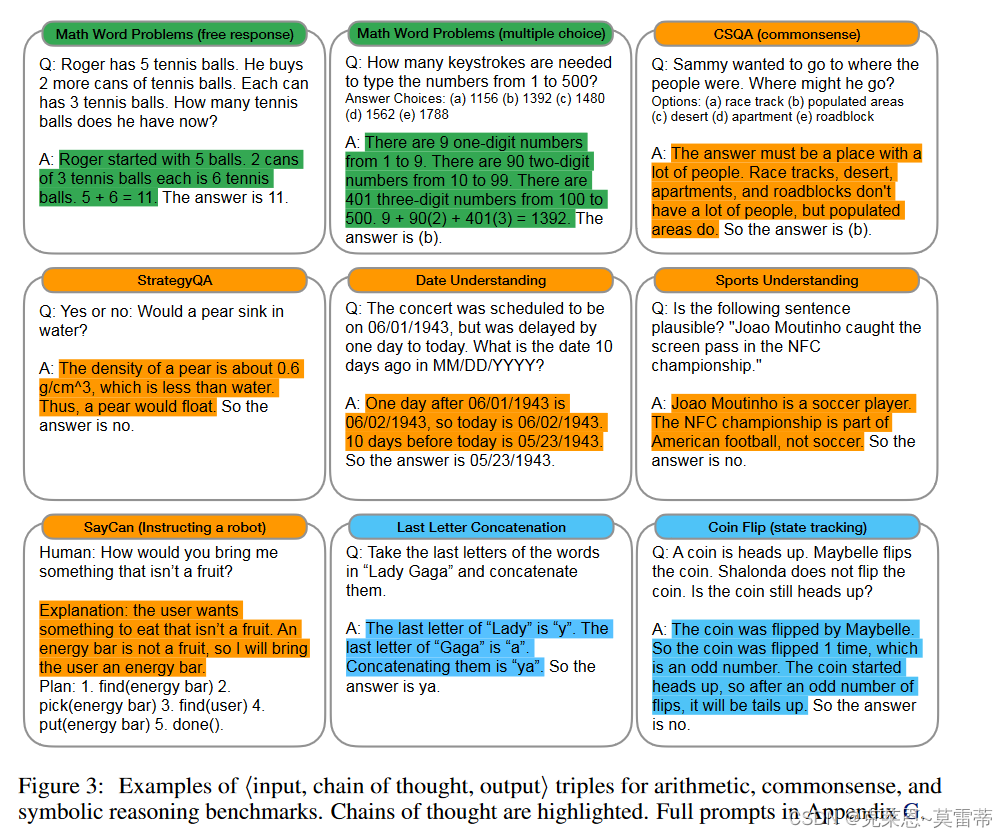

1.首先,思想链原则上允许模型将多步骤问题分解为中间步骤,这意味着额外的计算可以分配给需要更多推理步骤的问题。

2. 其次,思想链为模型的行为提供了一个可解释的窗口,表明模型如何得出特定的答案,并提供调试推理路径出错的地方的机会(尽管充分描述了支持模型的计算的特征)答案仍然是一个悬而未决的问题)。

3. 第三,思想链推理可用于数学应用题、常识推理和符号操作等任务,并且可能适用于(至少原则上)人类可以通过语言解决的任何任务。

4. 最后,只需将思维链序列的示例包含到少样本提示的范例中,就可以在足够大的现成语言模型中轻松引发思维链推理。

实验

以上是cot产生的prompt的示例

上图是结果。在算术题数据集上。

1220

1220

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?