一、提升算法概论

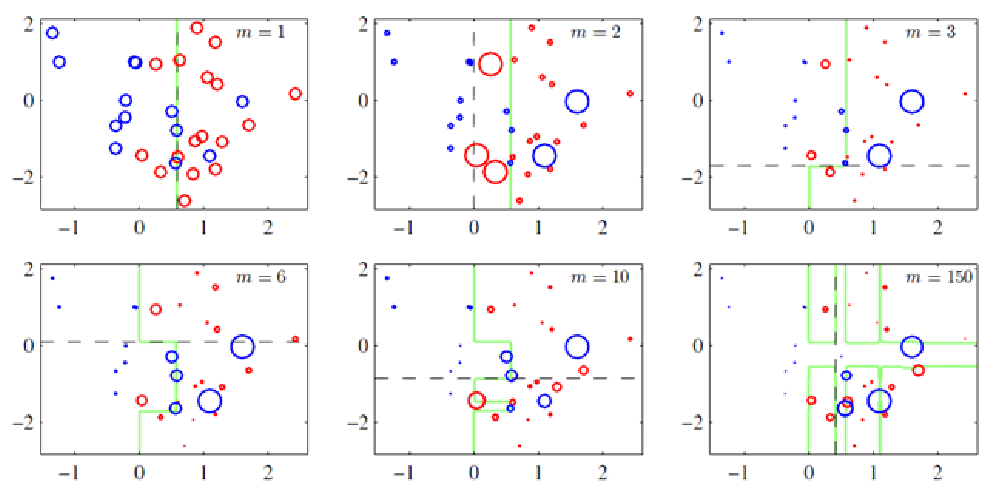

Boosting(提升)是一族可将弱学习器提升为强学习器的算法。提升算法基于这样一种思想:对于一个复杂的任务,将多个专家的判断总和得出的结果要比任何一个专家单独的判断好。这族算法的工作机制类似:先从初始训练集训练出一个基学习器,再根据基学习器表现对训练样本分布进行调整,是的先前基学习器做错的样本在后续收到更多关注(赋予做错的样本更大的权值),然后基于调整后的样本分布来训练下一个基学习器,一直反复进行,直到达到指定值。对样本加权的过程如下:

上图中被放大的点是被加权的样本,样本加权后,在下一次的学习中就会收到更多的关注。

也就是说提升算法对分类错误的样本更为关注,通过改变错误样本所占的权值来改变分类边界,从而一步步提升算法的准确度。

二、AdaBoost算法

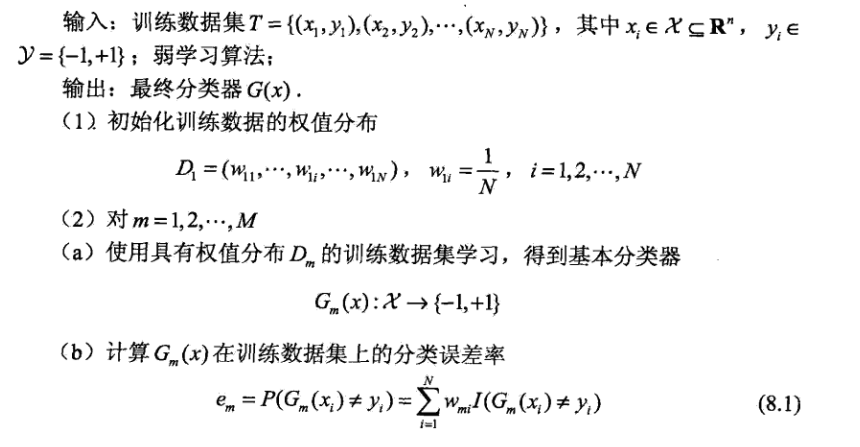

AdaBoost算法是提升算法中最具代表性的。正如上面所说的,在AdaBoost算法中会提高前一轮分类器分类错误的样本的权值,而降低那些被分类正确样本的权值。对于弱分类器的组合,AdaBoost算法采取加权多数表决的方法。具体的说就是加大分类误差率小的弱分类器的权值,使其在表决中起到较大的作用;减小分类误差率大的弱分类器的权值,使其在表决中起较小的作用。下面具体说一下AdaBoost算法的流程。

本文介绍了提升算法的基本原理,详细讲解了Adaboost、Gradient Boosting (GB)、GBDT以及XGBoost这四种常用的提升算法。Adaboost通过调整错误样本权重来提升算法准确度;GB通过迭代选择负梯度方向的基函数逼近损失函数最小值;GBDT结合决策树,利用伪残差数据训练;XGBoost则在目标函数中引入正则项,提高了模型的泛化能力。

本文介绍了提升算法的基本原理,详细讲解了Adaboost、Gradient Boosting (GB)、GBDT以及XGBoost这四种常用的提升算法。Adaboost通过调整错误样本权重来提升算法准确度;GB通过迭代选择负梯度方向的基函数逼近损失函数最小值;GBDT结合决策树,利用伪残差数据训练;XGBoost则在目标函数中引入正则项,提高了模型的泛化能力。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?