论文地址:Identity Mappings in Deep Residual Networks

在上一篇文章中,对MSRA何凯明团队的ResNet进行了介绍(地址),那篇文章中提到了,1202层的ResNet出现了过拟合的问题,有待进一步改进。第二年,何的团队就发表了“Identity Mappings in Deep Residual Networks”这篇文章,分析了ResNet成功的关键因素——residual block背后的算法,并对residual block以及after-addition activation进行改进,通过一系列的ablation experiments验证了,在residual block和after-addition activation上都使用identity mapping(恒等映射)时,能对模型训练产生很好的效果,通过这项改进,也成功的训练出了具有很好效果的ResNet-1001。

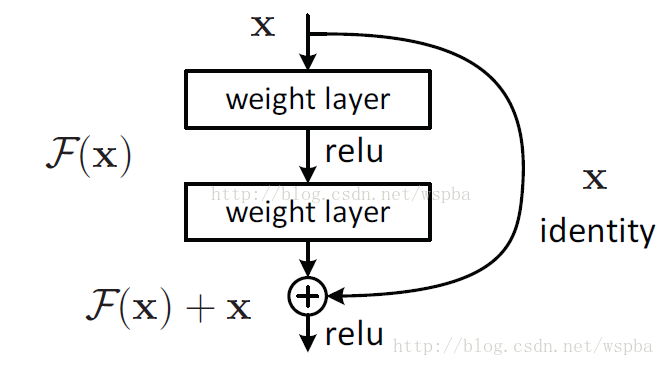

在原始的ResNet中,对于每一个residual building block:

可以表现为以下形式:

yl=h(xl)+F(xl,Wl),xl+1=f(yl),

其中 h(xl) 为一个恒等映射, f(yl) 代表ReLU激活函数。

而本文提出了,如果h(x)和f(y)都是恒等映射,即 h(x

本文深入探讨了ResNet中Identity Mappings在深度残差网络中的关键作用,指出其简化训练并防止梯度消失。通过实验比较不同形式的跳跃连接和激活函数位置,证明预激活全连接(full pre-activation)的ResNet-1001能有效避免过拟合,推动了深层网络的发展。

本文深入探讨了ResNet中Identity Mappings在深度残差网络中的关键作用,指出其简化训练并防止梯度消失。通过实验比较不同形式的跳跃连接和激活函数位置,证明预激活全连接(full pre-activation)的ResNet-1001能有效避免过拟合,推动了深层网络的发展。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

840

840

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?