目录

声明:本文部分图文来自《老饼讲解-机器学习》https://ml.bbbdata.com

一、逻辑回归模型介绍

逻辑回归是一种广义的线性回归分析模型,常用于数据挖掘,疾病自动诊断,经济预测等领域。它通过一个非线性的sigmoid函数,将线性回归模型得到的结果映射到[0,1]之间取值范围的值,并设置阈值为0.5,通过与阈值的比较达到二分类的效果。

1.1.逻辑回归模型的数学表达式

逻辑回归的模型表达式如下

逻辑回归模型先用wx+b 作为综合值的评估,再套用 sigmoid 函数将综合评估值转为概率。所以,逻辑回归本骨子里还是线性模型。

1.2 关于sigmoid函数

逻辑回归模型简单来说就是一个线性模型套上一个sigmoid函数,

sigmoid函数是一个S型函数,它的取值范围为(0,1),如下:

Sigmoid函数是一种在生物学中常见的S型函数,也称为S型生长曲线。在信息科学中,由于其单增以及反函数单增等性质,常被用作将变量映射到0,1之间。

1.3 逻辑回归模型的损失函数

逻辑回归模型的损失函数为交叉熵损失函数,它的目的是最大化似然函数,

逻辑回归模型的损失函数表达式如下:

需要注意的是,逻辑回归的损失函数是针对二分类问题的。对于多分类问题,可以使用one-vs-rest方法进行扩展。

逻辑回归更详细的原理与公式推导见:

二、逻辑回归模型判断乳腺癌类别

2.1.乳腺癌数据介绍

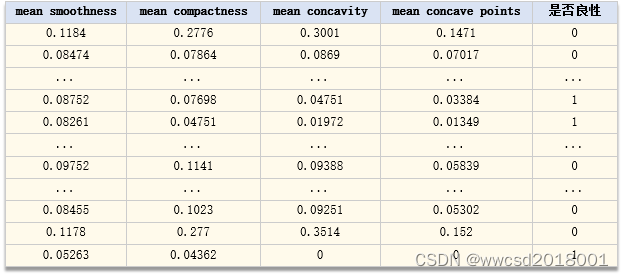

乳腺癌数据如下:

数据共150个样本,包含四个特征和乳腺癌类别

四个特征分别为:平均平滑度、平均紧凑度、平均凹面、平均凹点,

类别:0-恶性、1-良性

下面我们训练一个逻辑回归,用于预测乳腺癌是良性还是恶性

2.2.逻辑回归模型实现代码

使用乳腺癌数据,构建逻辑回归模型,在python中实现代码如下:

from sklearn.datasets import load_breast_cancer

from sklearn.linear_model import LogisticRegression

import numpy as np

#----数据加载------

data = load_breast_cancer()

X = data.data[:,4:8]

y = data.target

np.random.seed(888)

#-----训练模型--------------------

clf = LogisticRegression(random_state=0)

clf.fit(X,y)

#------打印结果------------------------

print("模型参数:"+str(clf.coef_))

print("模型阈值:"+str(clf.intercept_))

pred_y = clf.predict(X) # 预测类别

print( "模型准确率:",(pred_y== y).sum()/len(y))运行结果如下:

模型参数:[[-0.53024026 -3.48636783 -6.89132654 -4.37965412]]

模型阈值:[1.80112869]

模型准确率: 0.8260105448154658

从结果可以看到,模型的预测准确率为82.6%,效果已经极为不错

进一步的,还可以用predict_proba查看模型对每个样本的预测概率

pred_prob_y = clf.predict_proba(X)[:,1] # 预测属于1类的概率运行后结果如下:

编写不易,点赞收藏鼓励一下吧!

464

464

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?