机器学习实战——支持向量机

1 模型介绍

假设给定一个样本集 D = { ( x 1 , y 1 ) , ( x 2 , y 2 ) , . . . , ( x m , y m ) } , y i ∈ { 1 , − 1 } D=\{(x_1,y_1),(x_2,y_2),...,(x_m,y_m)\},y_i\in\{1,-1\} D={

(x1,y1),(x2,y2),...,(xm,ym)},yi∈{

1,−1},在下图中,我们可以找到很多把样本划分为 { 1 , − 1 } \{1,-1\} {

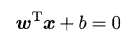

1,−1} 两类的超平面,但没办法判定哪一个是最好的。支持向量机的分类模型就是在样本集 D D D 中找到最合适的分离超平面,使模型具有较高的分类准确率。分离超平面可以用如下的公式表示:

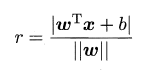

则样本空间中任意一点到分离超平面的距离可以表示成如下形式:

我们可以把分类问题转化为求点到直线的距离问题,距离超平面越远的点越容易被正确划分,可以进一步把问题转为求距离分离超平面最近的点的最大距离。

函数间隔:定义超平面 ( w , b ) (w,b) (w,b) 关于样本点 ( x i , y i ) (x_i,y_i) (xi,yi) 的函数间隔为 y i ( w T x i + b ) y_i(w^Tx_i+b) y

本文深入探讨了支持向量机(SVM)的概念,包括模型介绍、几何间隔和函数间隔、SMO算法及其在sklearn中的实现。SVM通过寻找最优超平面最大化几何间隔来进行分类,SMO算法用于解决SVM的优化问题。在sklearn中,SVC、NuSVC和LinearSVC是SVM的分类实现,而SVR、NuSVR和LinearSVR用于回归。参数如C、kernel、gamma等对模型性能有重要影响。

本文深入探讨了支持向量机(SVM)的概念,包括模型介绍、几何间隔和函数间隔、SMO算法及其在sklearn中的实现。SVM通过寻找最优超平面最大化几何间隔来进行分类,SMO算法用于解决SVM的优化问题。在sklearn中,SVC、NuSVC和LinearSVC是SVM的分类实现,而SVR、NuSVR和LinearSVR用于回归。参数如C、kernel、gamma等对模型性能有重要影响。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

383

383

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?