前文已经介绍了决策树分类示例,接下来需要的看下决策树回归:

分类决策树的可视化案例见我之前的文章:

https://blog.csdn.net/wzk4869/article/details/126248859?spm=1001.2014.3001.5501

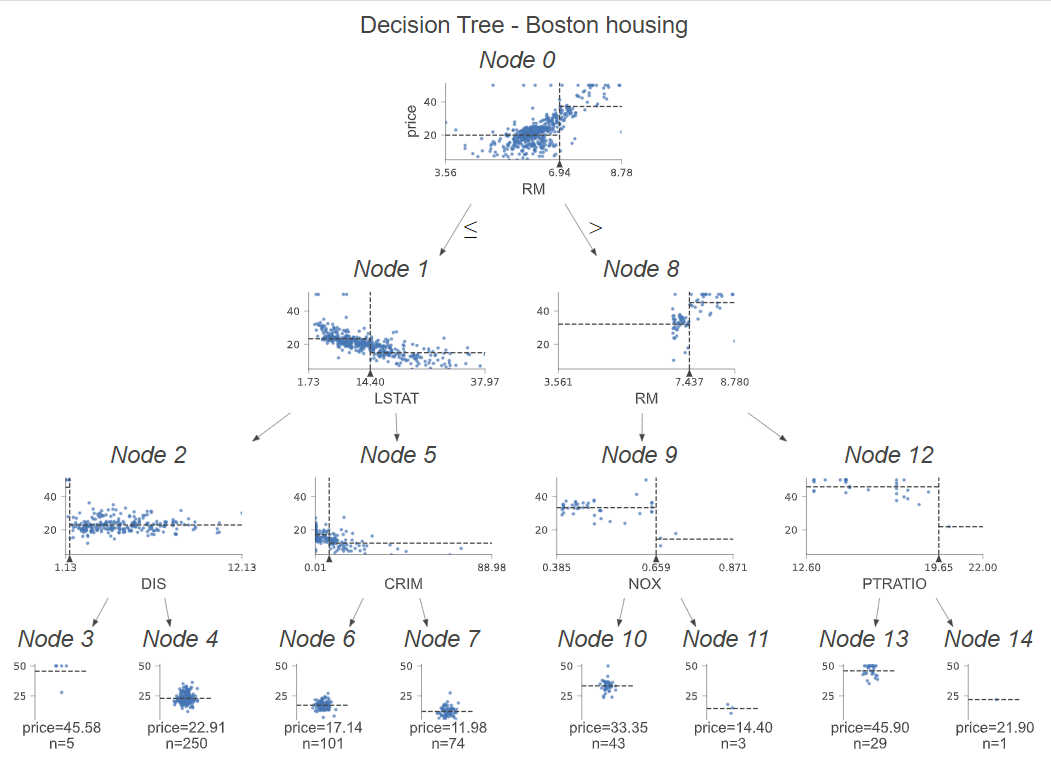

from sklearn import tree

from sklearn.datasets import load_boston

from dtreeviz.trees import dtreeviz

boston = load_boston()

graph = tree.DecisionTreeRegressor(max_depth=3)

graph.fit(boston.data, boston.target)

viz = dtreeviz(graph,

x_data=boston.data,

y_data=boston.target,

target_name='price',

feature_names=boston.feature_names,

title="Decision Tree - Boston housing",

show_node_labels=True)

viz.save('dtreeviz.svg')

我们研究下分类树和回归树之间的区别。这一次不是直方图,而是检查用于分割和目标的特征散点图。我们在这些散点图上,看到一些虚线。其解释如下:

1.水平线是决策节点中左右边的目标平均值。

2.垂直线是分割点。它与黑色三角形表示的信息完全相同。

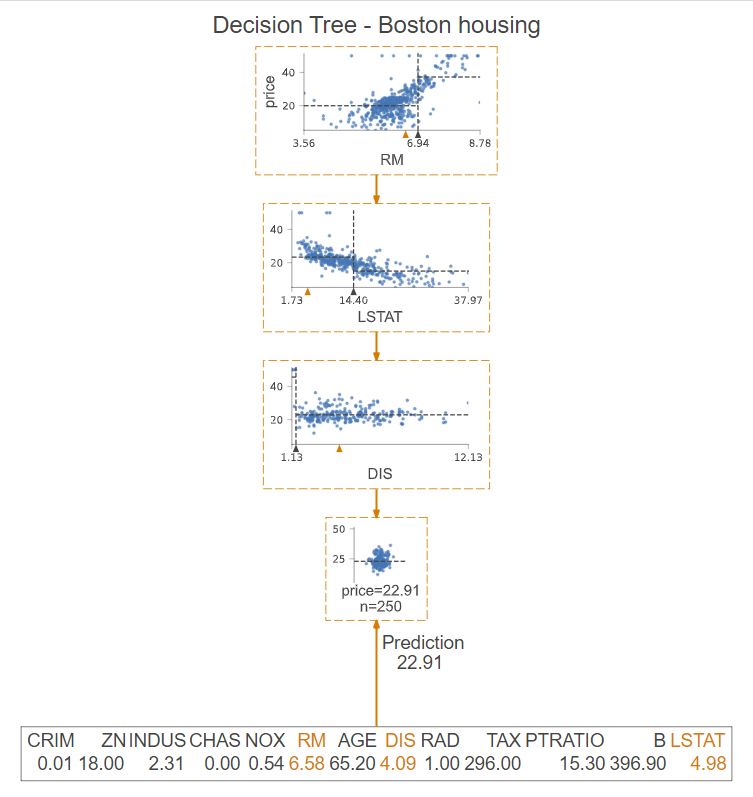

在叶节点中,虚线表示叶内目标的平均值,这也是模型的预测。我们可以更进一步,只绘制用于预测的节点。为此,我们指定show_just_path=True。下图仅显示上面树中选定的节点。

1441

1441

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?