文章目录

一篇好文:https://gombru.github.io/2018/05/23/cross_entropy_loss/

1 前言

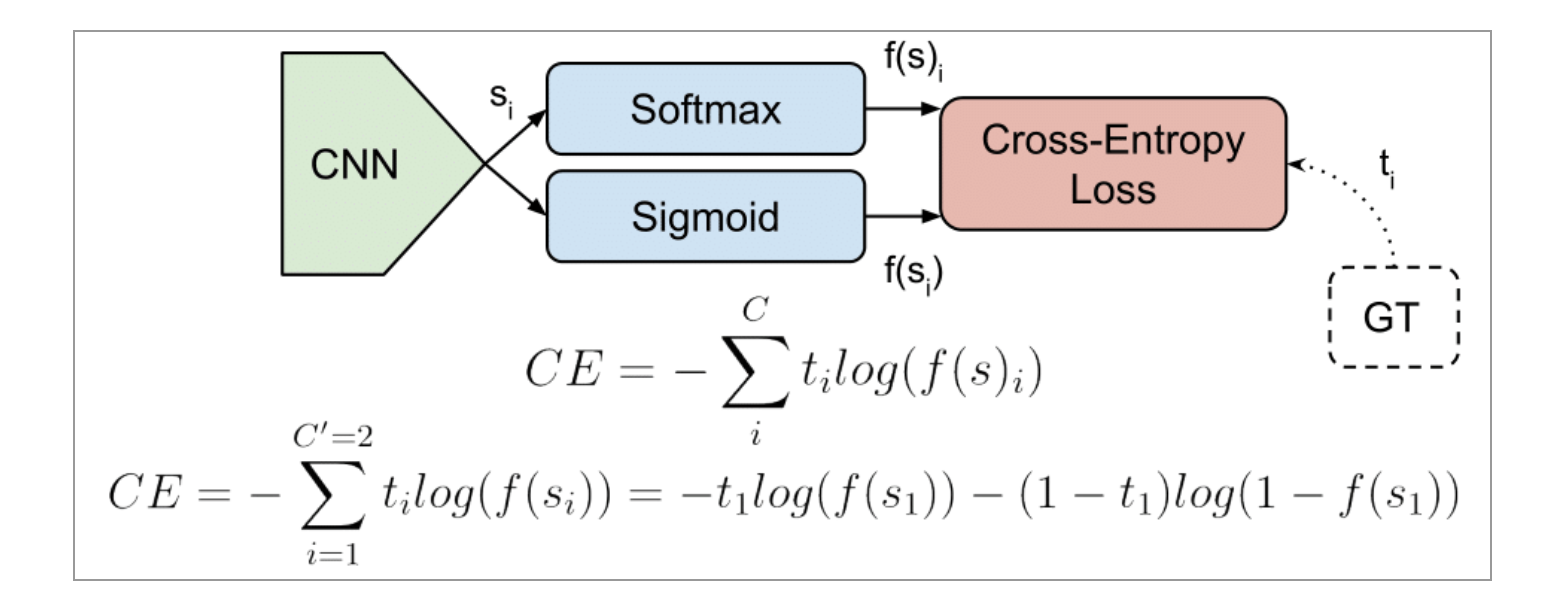

计算CE Loss 之前需要加softmax层,适用于多类预测 Multi-Class Classification,类间存在竞争关系。softmax层是一种激活函数,使得所有输出加和是1,softmax层不是损失函数。

如果是二分类任务,则需要在CE Loss 之前需要加sigmoid层。

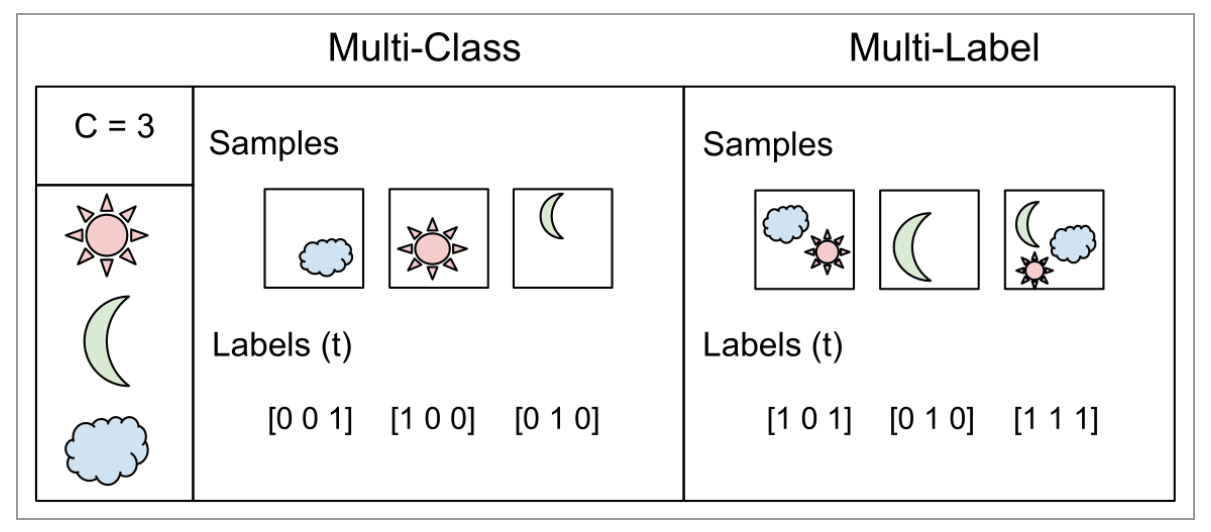

Multi-Class Classification任务 和 Multi-Label Classification任务区别:

2 sigmoid激活函数 与 Softmax激活函数

激活函数泛指讲输入非线性映射

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?