逻辑回归是一个用于二分类的算法。

计算机中表示一张图片:

为了把这些像素值放到一个特征向量中,我们需要把这些像素值提取出来,然后放入一个特征向量x.

把图片中所有的红、绿、蓝像素值都列出来。如果图片的大小为 64x64 像素,那么向量 𝑥 的总维度,

将是 64 乘以 64 乘以 3,这是三个像素矩阵中像素的总量。在这个例子中结果为 12,288。现在我们用𝑛𝑥 = 12,288,来表示输入特征向量的维度.

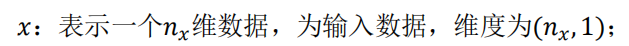

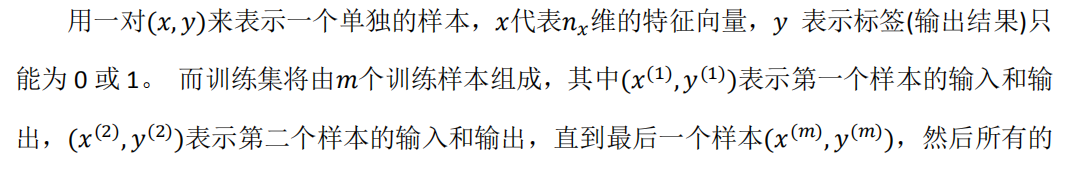

符号定义 :

逻辑回归:

sigmoid函数:

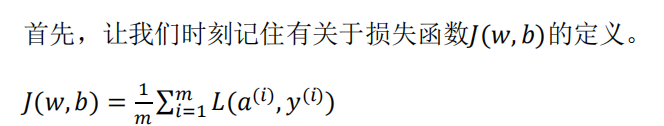

逻辑回归的代价函数:

损失函数:

梯度下降法:

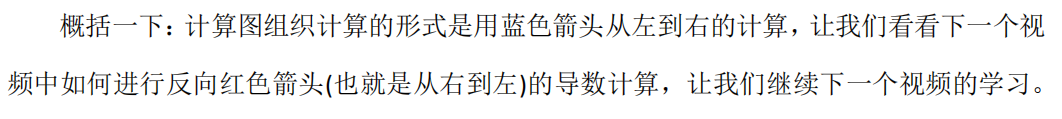

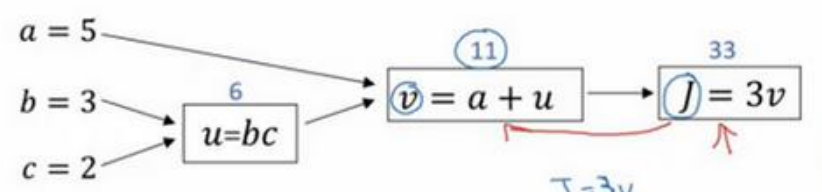

计算图:

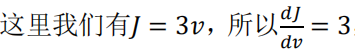

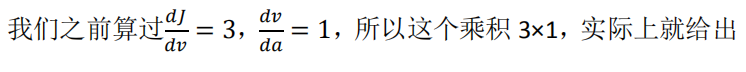

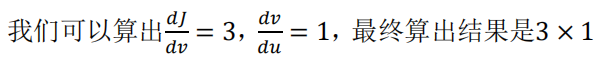

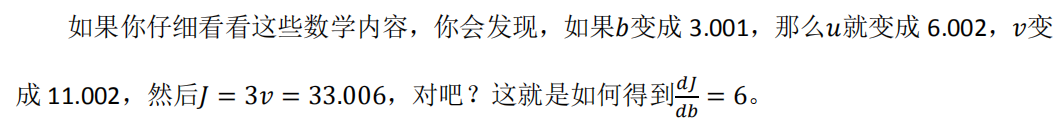

使用计算图求导数:

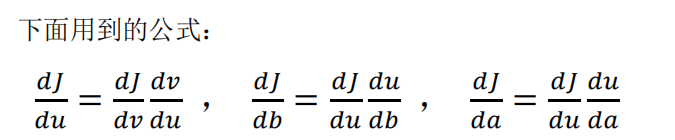

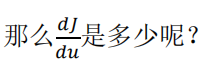

链式法则公式:

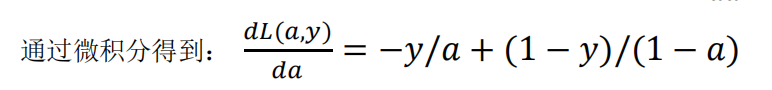

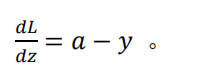

逻辑回归中的梯度下降:

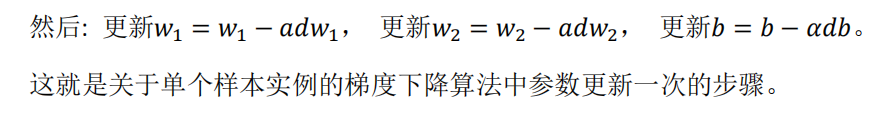

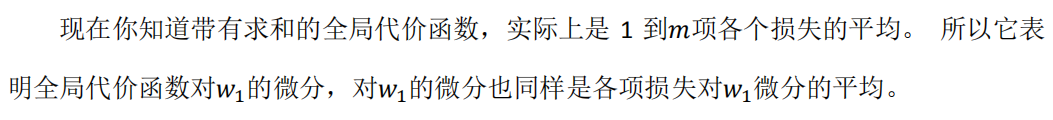

m 个样本的梯度下降:

向量化:

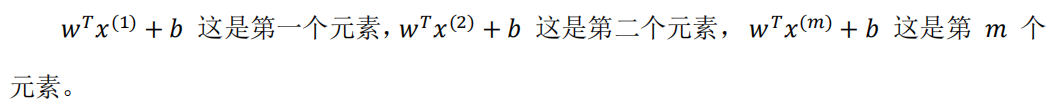

向量化逻辑回归:

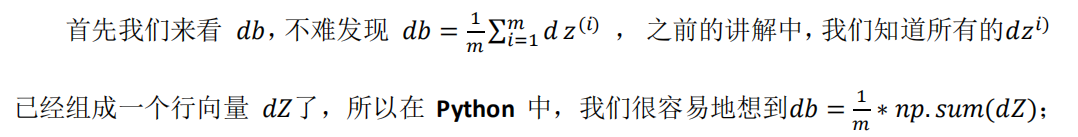

向量化计算反向传播:

神经网络:

神经网络的计算:

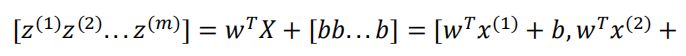

多样本向量化:

在上一个视频,了解到如何针对于单一的训练样本,在神经网络上计算出预测值。

激活函数:

为什么需要非线性激活函数:

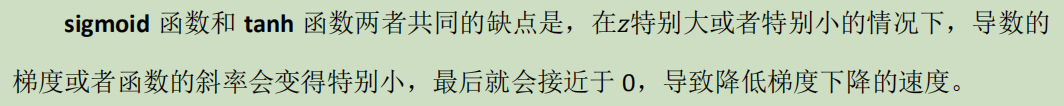

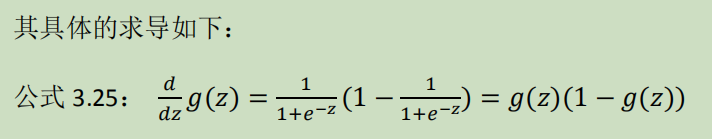

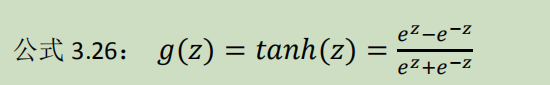

激活函数的导数:

神 经 网 络 的 梯 度 下 降:

随机初始化:

深层神经网络:

核对矩阵的维数:

为什么使用深层表示:

搭建神经网络块:

偏差,方差:

正则化:

为 什 么 正 则 化 有 利 于 预 防 过 拟 合 呢:

dropout (随机失活)正则化:

np.random.rand:

本函数可以返回一个或一组服从“0~1”均匀分布的随机样本值。随机样本取值范围是[0,1),不包括1。

np.random.rand(n,m):返回n行m列的服从“0~1”均匀分布的随机样本值矩阵。

dl = np.random.rand(al.shape[0],al.shape[1]) < keep_prob:

该矩阵化为true/false,也就是0、1矩阵,0表示删除,1表示不删除。

理解 dropout:

归一化输入:

梯度消失:

梯度检验:

Mini-batch 梯度下降:

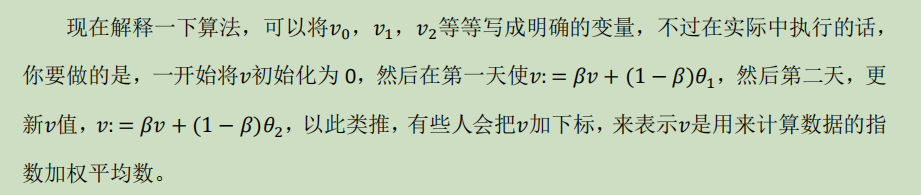

指数加权平均数:

指 数 加 权 平 均 的 偏 差 修 正:

动量梯度下降法:

RMSprop:

Adam 优化算法:

学习率衰减:

局部最优的问题:

超 参 数 调 试:

归一化网络的激活函数:

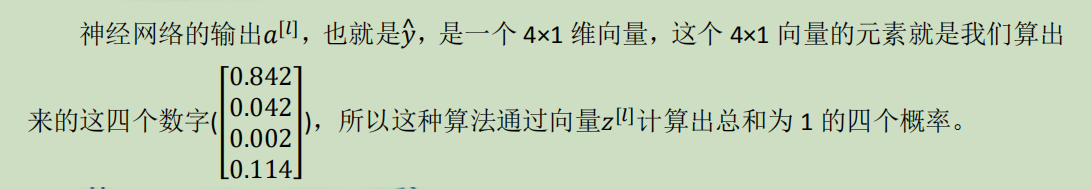

Softmax 回归:

深度学习框架:

TensorFlow:

638

638

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?