起步发展期:1943年—20世纪60年代

应用发展期:20世纪80年代

人工智能走入应用发展的新高潮。专家系统模拟人类专家的知识和经验解决特定领域的问题,实现了人工智能从理论研究走向实际应用、从一般推理策略探讨转向运用专门知识的重大突破。而机器学习(特别是神经网络)探索不同的学习策略和各种学习方法,在大量的实际应用中也开始慢慢复苏。

平稳发展期:20世纪90年代—2010年

蓬勃发展期:2011年至今

同时,OpenAI发表了论文《Improving Language Understanding by Generative Pre-training》

从论文里可以了解到,GPT-1具有1.17个参数,采用了12层的Transformer 解码器结构,使用5GB的无标注文本数据,在8个GPU上训练了一个月,然后再进行人工监督的微调。

不过,GPT-1并不是当年的明星,因为同年,Google的BERT大模型也发布了(当时的Google就是强啊)。

CLIP是一个多模态模型,用来判断文字和图像两个不同"模态"信息的关联匹配程度。

-

1943年,美国神经科学家麦卡洛克(Warren McCulloch)和逻辑学家皮茨(Water Pitts)提出神经元的数学模型,这是现代人工智能学科的奠基石之一。

-

1950年,艾伦·麦席森·图灵(Alan Mathison Turing)提出“图灵测试”(测试机器是否能表现出与人无法区分的智能),让机器产生智能这一想法开始进入人们的视野。不了解图灵测试的小伙伴可以看看这个视频----->什么是图灵测试?_哔哩哔哩_bilibili

-

1950年,克劳德·香农(Claude Shannon)提出计算机博弈。

-

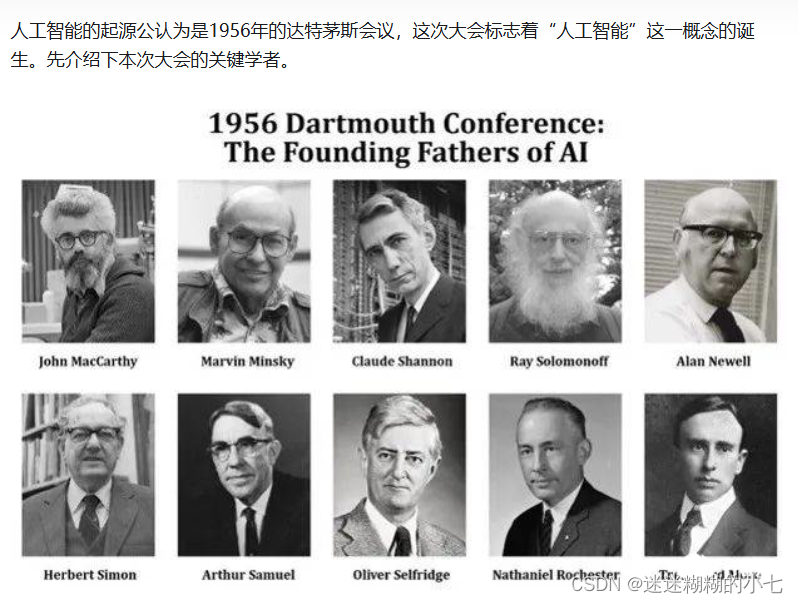

1956年,达特茅斯学院人工智能夏季研讨会上正式使用了人工智能(artificial intelligence,AI)这一术语。这是人类历史上第一次人工智能研讨,标志着人工智能学科的诞生。

-

1957年,弗兰克·罗森布拉特(Frank Rosenblatt)在一台IBM-704计算机上模拟实现了一种他发明的叫做“感知机”(Perceptron)的神经网络模型。

-

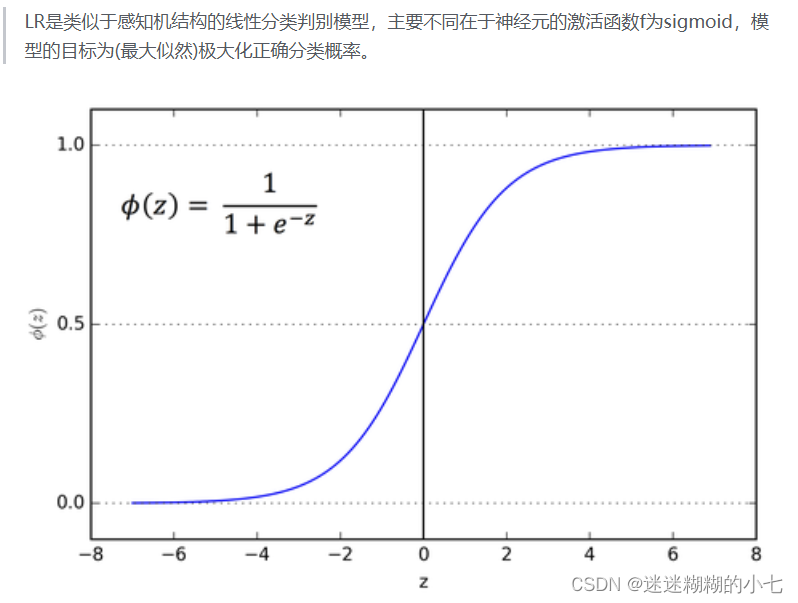

1958年,David Cox提出了logistic regression。

-

1959年,Arthur Samuel给机器学习了一个明确概念:Field of study that gives computers the ability to learn without being explicitly programmed.(机器学习是研究如何让计算机不需要显式的程序也可以具备学习的能力)。

-

1961年,Leonard Merrick Uhr 和 Charles M Vossler发表了题目为A Pattern Recognition Program That Generates, Evaluates and Adjusts its Own Operators 的模式识别论文,该文章描述了一种利用机器学习或自组织过程设计的模式识别程序的尝试。

-

1966 年,麻省理工学院科学家Joseph Weizenbaum 在 ACM 上发表了题为《ELIZA-a computer program for the study of natural language communication between man and machine》文章描述了ELIZA 的程序如何使人与计算机在一定程度上进行自然语言对话成为可能,ELIZA 的实现技术是通过关键词匹配规则对输入进行分解,而后根据分解规则所对应的重组规则来生成回复。

-

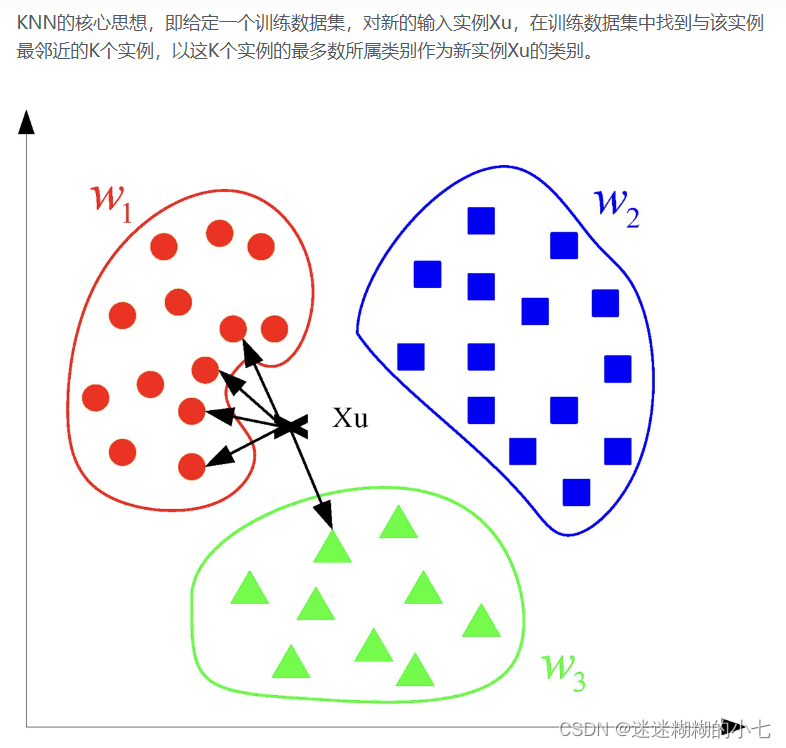

1967年,Thomas等人提出K最近邻算法(The nearest neighbor algorithm)。

-

反思发展期:20世纪70年代

人工智能发展初期的突破性进展大大提升了人们对人工智能的期望,人们开始尝试更具挑战性的任务,然而计算力及理论等的匮乏使得不切实际目标的落空,人工智能的发展走入低谷。

-

1974年,哈佛大学沃伯斯(Paul Werbos)博士论文里,首次提出了通过误差的反向传播(BP)来训练人工神经网络,但在该时期未引起重视。

-

1975年,马文·明斯基(Marvin Minsky)在论文《知识表示的框架》(A Framework for Representing Knowledge)中提出用于人工智能中的知识表示学习框架理论。

-

1979年,汉斯·贝利纳(Hans Berliner)打造的计算机程序战胜双陆棋世界冠军成为标志性事件。(随后,基于行为的机器人学在罗德尼·布鲁克斯和萨顿等人的推动下快速发展,成为人工智能一个重要的发展分支。格瑞·特索罗等人打造的自我学习双陆棋程序又为后来的强化学习的发展奠定了基础。)

-

1980年,在美国的卡内基梅隆大学(CMU)召开了第一届机器学习国际研讨会,标志着机器学习研究已在全世界兴起。

-

1980年,德鲁·麦狄蒙(Drew McDermott)和乔恩·多伊尔(Jon Doyle)提出非单调逻辑,以及后期的机器人系统。

-

1981年,保罗(R.P.Paul)出版第一本机器人学课本,“Robot Manipulator:Mathematics,Programmings and Control”,标志着机器人学科走向成熟。

-

1982年,马尔(David Marr)发表代表作《视觉计算理论》提出计算机视觉(Computer Vision)的概念,并构建系统的视觉理论,对认知科学(CognitiveScience)也产生了很深远的影响。

-

1982年,约翰·霍普菲尔德(John Hopfield) 发明了霍普菲尔德网络,这是最早的RNN的雏形。霍普菲尔德神经网络模型是一种单层反馈神经网络(神经网络结构主要可分为前馈神经网络、反馈神经网络及图网络),从输出到输入有反馈连接。它的出现振奋了神经网络领域,在人工智能之机器学习、联想记忆、模式识别、优化计算、VLSI和光学设备的并行实现等方面有着广泛应用。参考视频:【人工智能教程】9.5 - Hopfield 网络_哔哩哔哩_bilibili

-

1985年,朱迪亚·珀尔提出贝叶斯网络(Bayesian network),他以倡导人工智能的概率方法和发展贝叶斯网络而闻名,还因发展了一种基于结构模型的因果和反事实推理理论而受到赞誉

-

1986年,辛顿(Geoffrey Hinton)等人先后提出了多层感知器(MLP)与反向传播(BP)训练相结合的理念(该方法在当时计算力上还是有很多挑战,基本上都是和链式求导的梯度算法相关的),这也解决了单层感知器不能做非线性分类的问题,开启了神经网络新一轮的高潮。

-

1986年,昆兰(Ross Quinlan)提出ID3决策树算法

-

1989年,George Cybenko证明了“万能近似定理”(universal approximation theorem)。简单来说,多层前馈网络可以近似任意函数,其表达力和图灵机等价。这就从根本上消除了Minsky对神经网络表达力的质疑

-

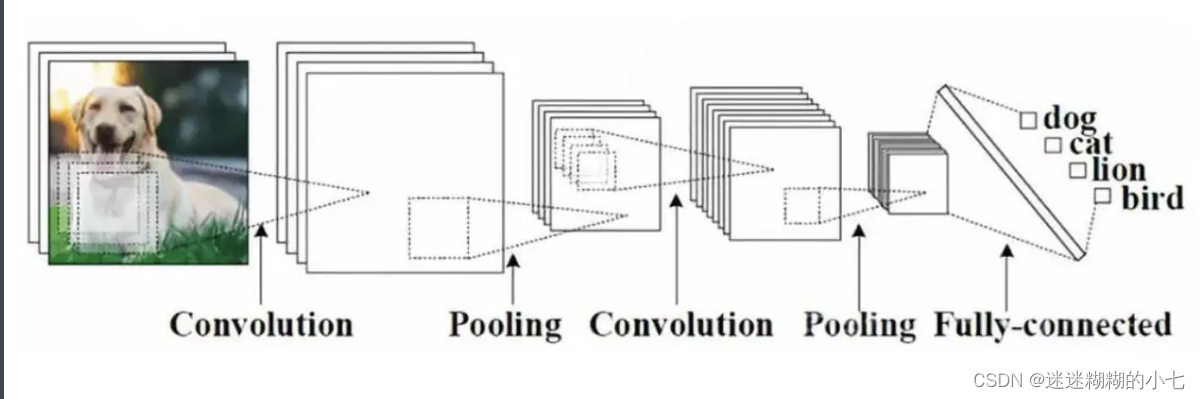

1989年,LeCun (CNN之父) 结合反向传播算法与权值共享的卷积神经层发明了卷积神经网络(Convolutional Neural Network,CNN),并首次将卷积神经网络成功应用到美国邮局的手写字符识别系统中。

-

专家系统智能有限,AI进入第二次低谷期。专家系统性能受知识获取的限制,主要依托规则与知识库,需人工编写大量规则,同时升级难度高、维护成本居高不下,缺乏灵活性与推理能力;当时计算机处理能力受限,无法处理大规模数据与复杂模式识别任务。

-

1995年,Cortes和Vapnik提出联结主义经典的支持向量机(Support Vector Machine),它在解决小样本、非线性及高维模式识别中表现出许多特有的优势,并能够推广应用到函数拟合等其他机器学习问题中。

-

1995年, Freund和schapire提出了 AdaBoost (Adaptive Boosting)算法。AdaBoost采用的是Boosting集成学习方法——串行组合弱学习器以达到更好的泛化性能。另外一种重要集成方法是以随机森林为代表的Bagging并行组合的方式。以“偏差-方差分解”分析,Boosting方法主要优化偏差,Bagging主要优化方差。

-

1997年国际商业机器公司(简称IBM)深蓝超级计算机战胜了国际象棋世界冠军卡斯帕罗夫。深蓝是基于暴力穷举实现国际象棋领域的智能,通过生成所有可能的走法,然后执行尽可能深的搜索,并不断对局面进行评估,尝试找出最佳走法。

-

1997年,Sepp Hochreiter 和 Jürgen Schmidhuber提出了长短期记忆神经网络(LSTM)。

-

1998年,万维网联盟的蒂姆·伯纳斯·李(Tim Berners-Lee)提出语义网(Semantic Web)的概念。其核心思想是:通过给万维网上的文档(如HTML)添加能够被计算机所理解的语义(Meta data),从而使整个互联网成为一个基于语义链接的通用信息交换媒介。换言之,就是构建一个能够实现人与电脑无障碍沟通的智能网络。

-

2001年,John Lafferty首次提出条件随机场模型(Conditional random field,CRF)。 CRF是基于贝叶斯理论框架的判别式概率图模型,在给定条件随机场P ( Y ∣ X ) 和输入序列x,求条件概率最大的输出序列y *。在许多自然语言处理任务中比如分词、命名实体识别等表现尤为出色。

-

2001年,布雷曼博士提出随机森林(Random Forest)。 随机森林是将多个有差异的弱学习器(决策树)Bagging并行组合,通过建立多个的拟合较好且有差异模型去组合决策,以优化泛化性能的一种集成学习方法。多样差异性可减少对某些特征噪声的依赖,降低方差(过拟合),组合决策可消除些学习器间的偏差。

-

2003年,David Blei, Andrew Ng和 Michael I. Jordan于2003年提出LDA(Latent Dirichlet Allocation)。LDA是一种无监督方法,用来推测文档的主题分布,将文档集中每篇文档的主题以概率分布的形式给出,可以根据主题分布进行主题聚类或文本分类。

-

2005 年,波士顿动力公司推出一款动力平衡四足机器狗,有较强的通用性,可适应较复杂的地形。

-

2006年,杰弗里·辛顿以及他的学生鲁斯兰·萨拉赫丁诺夫正式提出了深度学习的概念(Deeping Learning),开启了深度学习在学术界和工业界的浪潮。2006年也被称为深度学习元年,杰弗里·辛顿也因此被称为深度学习之父。

-

2011年,IBM Watson问答机器人参与Jeopardy回答测验比赛最终赢得了冠军。Waston是一个集自然语言处理、知识表示、自动推理及机器学习等技术实现的电脑问答(Q&A)系统。

-

2012年,Hinton和他的学生Alex Krizhevsky设计的AlexNet神经网络模型在ImageNet竞赛大获全胜,这是史上第一次有模型在 ImageNet 数据集表现如此出色,并引爆了神经网络的研究热情。

2012年Google的托马斯·米科洛夫(Tomas Mikolov)带领研究团队发表了论文《Efficient Estimation of Word Representations inVector Space》,提出了Word2Vec。

Word2Vec可以根据给定的语料库,通过优化后的训练模型可以快速有效地将一个词语表达成高维空间里的词向量形式,为自然语言处理领域的应用研究提供了新的工具。

-

2014年,聊天程序“尤金·古斯特曼”(Eugene Goostman)在英国皇家学会举行的“2014图灵测试”大会上,首次“通过”了图灵测试。

-

2014年,Goodfellow及Bengio等人提出生成对抗网络(Generative Adversarial Network,GAN),被誉为近年来最酷炫的神经网络。

-

2015年,Microsoft Research的Kaiming He等人提出的残差网络(ResNet)在ImageNet大规模视觉识别竞赛中获得了图像分类和物体识别的优胜。

-

2015年,谷歌开源TensorFlow框架。它是一个基于数据流编程(dataflow programming)的符号数学系统,被广泛应用于各类机器学习(machine learning)算法的编程实现,其前身是谷歌的神经网络算法库DistBelief。

-

2015年,马斯克等人共同创建OpenAI。它是一个非营利的研究组织,使命是确保通用人工智能 (即一种高度自主且在大多数具有经济价值的工作上超越人类的系统)将为全人类带来福祉。其发布热门产品的如:OpenAI Gym,GPT等。

-

2016年,谷歌提出联邦学习方法,它在多个持有本地数据样本的分散式边缘设备或服务器上训练算法,而不交换其数据样本。

-

2016年,AlphaGo与围棋世界冠军、职业九段棋手李世石进行围棋人机大战,以4比1的总比分获胜。

-

-

2017年,中国香港的汉森机器人技术公司(Hanson Robotics)开发的类人机器人索菲亚,是历史上首个获得公民身份的一台机器人。索菲亚看起来就像人类女性,拥有橡胶皮肤,能够表现出超过62种自然的面部表情。其“大脑”中的算法能够理解语言、识别面部,并与人进行互动。 有兴趣的朋友可以去看看:【细思极恐】机器人公民索菲亚做客肥伦秀,对答如流吓呆肥伦,深情合唱say something让人潸然泪下_哔哩哔哩_bilibili

-

-

2017年1月,Facebook人工智能研究院(FAIR)开源了PyTorch。PyTorch和tensorFlow从此成为了当今两大主流深度学习框架。

-

2018年,OpenAI发布了第一版的GPT(Generative Pre-training Transformers)系列模型 GPT-1。

-

2019年,OpenAI发布了GPT-2。GPT-2有48层Transformer结构,使用40GB文本数据训练,参数量突破到了15亿。

-

2020年,OpenAI发布了GPT-3。GPT-3的初始版本在内部代号为"davinci",使用45TB文本数据训练,有1750亿参数。根据公开信息,模型的训练费用是1200万美金。因为太贵,只训练了一次。

-

2021年,Open AI开源了新的深度学习模型 CLIP(Contrastive Language-Image Pre-Training)。

-

2021年4月,华为的盘古NLP大模型发布,号称是中国第一个千亿参数语言大模型

-

2022年,ChatGPT 发布

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?