弱监督深度目标检测网络(2016)

摘要

提出一种弱监督的深度检测结构,使其在图像级别上运行,同时进行区域选择和分类。

在PASCAL-VOC数据上隐式学习优于其他弱监督检测系统的目标检测器。

该模型是一个简单的端到端架构,在图像级分类方面也优于标准的数据增强和微调技术。

缺陷:单图同类单个

一.介绍

本文提出了一种新的端到端的弱监督目标检测方法,称之为弱监督深度检测网络(WSDDN),如下图:

首先ImageNet数据上预训练CNN,然后在最后一个卷积层上添加RPN,进行区域定位,然后将不同大小候选区域进行SPP池化。

然后对网络进行分支,从汇集的区域级特征中提取两个数据流。第一个流将类分数φc(x;R)单独地关联到每个区域,执行识别。第二流通过计算区域上的概率分布φd(x;R)来比较区域,获得区域定位;其中R是包含最显著图像结构的区域,有待检测是否存在。然后融合两个数据流,对所有区域的识别和检测分数进行分类,来预测整个图像的类别,然后在学习过程中注入图像级监督。

*********注******************

SPP空间金字塔池化(论文Spatial Pyramid Pooling in Deep Convolutional Networks for Visual Recognition)

实现在任意的输入size和scale下,得到固定size和scale的输出特征

多尺度池化,更好鲁棒性

结构如上图,利用bin块实现,相当于将图像分割成不同的块,分别分成4*4,2*2,1*1个子图,滤波器为256,

然后对这些子图进行Pooling,

然后将这些特征拼接成(16+4+1)*256的特征向量,这就是最后池化的结果,不管输入,输出都固定。

**********end***************

将此方法与多实例学习(MIL)[7]进行比较。MIL交替选择图像中哪些区域看起来像感兴趣的对象,并使用所选区域估计对象的外观模型。因此,MIL使用原模型本身进行区域选择。而本论文技术的区域是由网络中的一个专用并行检测分支选择的,独立于识别分支。这样,有助于避免MIL的一个缺陷,即方法陷入局部最优的趋势。

此方法与Lin等人方法关系不大[22]。他们提出一种“双线性”体系结构,通过在相应的空间位置取特征向量的外积(笛卡尔积),将两个并行网络流的输出组合起来。关键区别在于他们两个流是完全对称的,因此无法相信一个流执行分类,另一个流执行检测;相反,在此方案中,检测分支被显式地设计为比较区域,从而打破对称性。还要值得注意的是,他们没有执行WSD,也没有评估对象检测性能。

实验表明,当微调PASCALVOC训练集时,该架构可以在PASCAL数据上实现最新的弱监督对象检测,在仅使用CNN下,取得当前最先进的结果,由于是端到端的训练,因此十分高效。

二.相关工作

当前WSD方法主要是MIL,但此方法导致一个非凸优化问题,求解者往往陷入局部最优解,使得解的质量很大程度上依赖于初始化。有几篇论文关注于各种初始化策略的开发[19,5,32,4]和优化问题的正则化[31,1]。Kumar等人[19] 提出一种自我进度的学习策略,该策略在训练时从较难的样本逐步增加到一小部分初始样本。Deselaers等人[5] 根据对象性得分初始化对象位置。Cinbis等人[4] 建议对训练数据进行多重分割,以避开局部操作。Song等人[31]将Nesterov的平滑技术[23]应用到潜在的SVM公式中,来增强对不良初始化的鲁棒性。Bilen等人[1] 提出一个平滑的MIL版本,该版本可以柔和地标记对象实例,而不是选择得分最高的实例。另外,他们的方法基于对称性和互斥原理,通过惩罚不太可能的结构来调整潜在目标的位置。

WSD的另一个研究方向[31,32,36]是基于识别图像部分之间的相似性的思想。Song等人。[31]提出了一种基于判别图的算法,该算法选择窗口的子集,使得每个窗口在正图像中与其最近的邻居相连。在[32]中,同样的作者扩展了这个方法来发现多个共现零件配置。Wang等人。[36]提出了一种迭代技术,该技术在正样本窗口上应用基于潜在语义分析(pLSA)的潜在语义聚类,并根据分类性能为每个类选择最有争议的聚类。Bilen等人。[2] 提出了一种联合学习判别模型并通过判别凸聚类算法实现目标区域相似性的公式。

三.方法

总体思路包括三个步骤:

1. 得到一个预先训练了大规模的图像分类任务的CNN。

2.构建WSDDN作为CNN的一个修改架构。

3.在目标数据集上对WSDDN进行训练/微调(使用图像级标注)。

1.预训练网络

数据只有图像级标注,在实验部分给出CNN架构细节。

2.WSDDN

结构基本如下图:

给定预训练CNN,转换为WSDDN。

首先,将紧跟在最后一个卷积块的ReLU层(relu5)之后的最后一个池化层(pool5)替换为实现SPP的层。产生以下函数,以图像x和区域(边界框)R作为输入,并产生一个特征向量φ(x;R)作为输出。

![]()

φrelu5(x)只需要对整个图像计算一次,φSPP(·;R)对于任何给定区域R计算都很快。实际上,SPP被配置为与网络的第一完全连接层(即fc6)兼容。请注意,SPP被实现为网络层,如[11]所示,以允许端到端地训练系统(提高效率)。

如上图,首先给定图像x,候选区域列表R=(R1...Rn)是通过区域定位机制获得,本论文选择两种方法:SSW,EB。

修改SPP层,使其不接受单个区域,而是接受完整的列表R;φ(x;R)被定义为φ(x;R1)...φ(x;R1),变成四维,因为原单独φ(x;R)是三维张量)。

在体系结构上,区域级特征由两个完连接层φfc6和φfc7进行处理,每个层包括一个线性映射和一个ReLU。在最后一个全连接层的输出中,分出两个数据流。

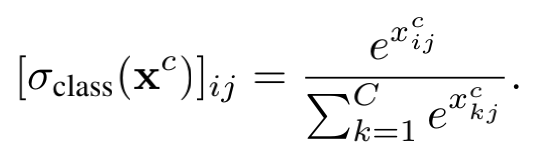

分类数据流:将每个区域映射到类分数的C维向量来形成单个区域的分类,假设系统经过训练来检测C个不同的类。通过一个线性映射φfc8c来实现的,得到一个包含每个区域的类预测分数的数据xc∈RC×| R |矩阵。然后通过softmax传递,如下:

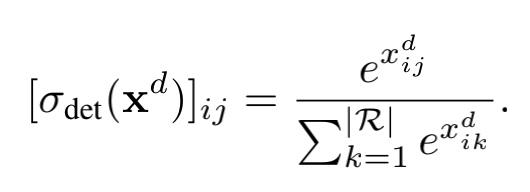

检测数据流:对一个区域和另一个区域进行评分。在类的基础上通过二次线性映射φfc8d实现,也得到了分数矩阵xd∈RC×| R |。然后通过另一个softmax,如下:

结合区域得分和检测:每个区域的最终得分是通过两个得分矩阵的卷积得到xR=σclass(卷积)σdet(xd)。然后,区域得分排序,然后执行NMS,只留下可能性大的区域。

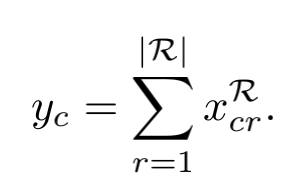

图像级分类分数:WSDDN已经计算了区域级别的分数xR。图像级类别预测得分中通过区域上的求和进行转换:

注意,这两个yc都是| R |区域上SoftMax最大标准化分数的元素乘积之和,因此它在(0,1)的范围内。因此不执行Softmax,因为允许图像包含多个对象类(而区域只包含单个类)。

3.训练WSDDN

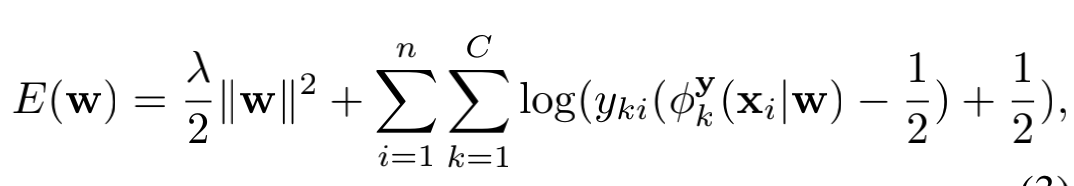

代价函数:

可能不太准确:由于φyk(xi | w)在(0,1)的范围内,可以认为是图像xi中存在k类的概率。例如,p(yk i=1),当 ground-truth为正标签时,损失为log(p(yki=1)),否则为log(1-p(yki=1))。

4.Spatial Regulariser

由于WSDDN是针对图像级进行优化的,因此它不能保证任何空间平滑度,因此如果某区域获得高分,则具有高重叠的相邻区域也将会具有高分。因此采用软规则化策略,在训练期间惩罚得分最高区域和IoU至少为60%的区域之间的featuremap差异:

四.实验

实验数据:ImageNet 和ILSVRC 2012挑战数据

三个预训练模型:

1.VGG-CNN-F[3],类似AlexNet[18]但是减少了卷积因子的数量。把这个网络称为S,代表小型网络。

2.相同深度的VGG-CNN-M-1024,但在第一卷积层的步幅较小。称为“M”。

3.deep VGG-VD16型号,称为“L”。

659

659

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?