基于贝叶斯定理和特征条件独立假设的分类方法,朴素贝叶斯的基本假设是条件独立性

4.1 朴素贝叶斯法的学习和分类

4.1.1 基本方法

设输入空间是一个n维向量的集合,输出空间是类标记集合,输入为特征向量x,输出为类标记y,X是定义在输入空间的随机向量,Y是定义在输出空间的随机变量。P(X,Y)是X和Y的联合概率分布。

朴素贝叶斯法通过训练数据集学习联合概率分布。

具体的学习先验概率分布和条件概率分布。

先验概率分布:

条件概率分布:

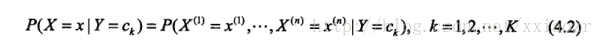

朴素贝叶斯对条件概率分布做了条件独立性的假设,具体的:

条件独立假设等于是说用于分类的特征在类确定的条件下都是条件独立的。

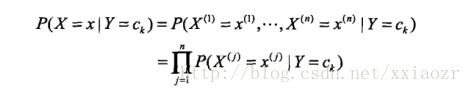

朴素贝叶斯分类时,对给定的输入x,通过学习到的模型计算后验概率P(y=c|X=x),将后验概率最大的类作为x的类输出。

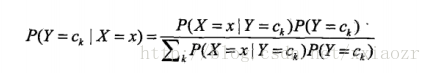

后验概率根据贝叶斯定理进行:

即

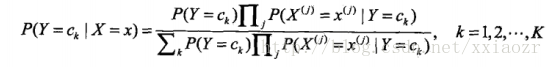

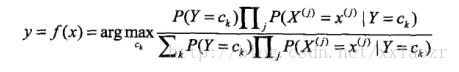

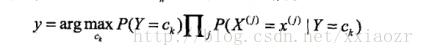

所以贝叶斯分类器可以表示为:

4.1.2 后验概率最大化的含义

等价于期望风险最小化

4.2 朴素贝叶斯法的参数估计

4.2.1 极大似然估计

朴素贝叶斯法中需要学习的是

先验概率的极大似然估计是

条件概率的极大似然估计是

4.2.2 学习和分类的方法

4.2.3 贝叶斯估计

用极大似然估计可能会出现估计的概率值为0,这时会影响到后验概率的计算结果,这时需要使用贝叶斯估计,条件概率的贝叶斯估计是:

统计学习方法:朴素贝叶斯方法

最新推荐文章于 2022-10-09 17:31:26 发布

974

974

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?