声明:文中所用截图及相关知识来自B站up霹雳吧啦Wz

目录

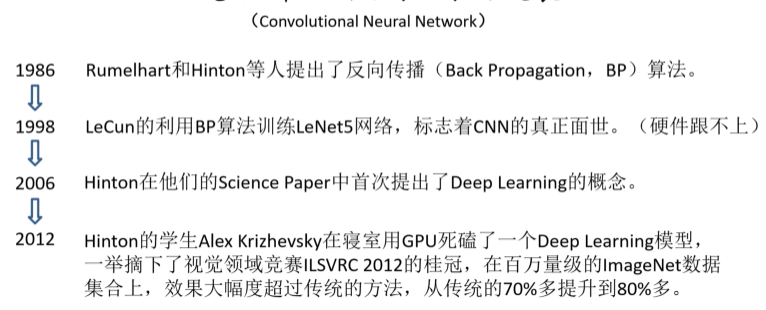

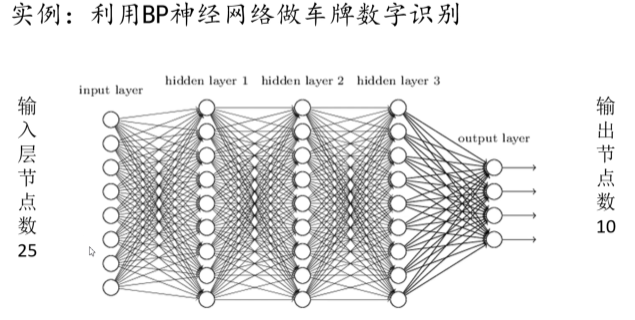

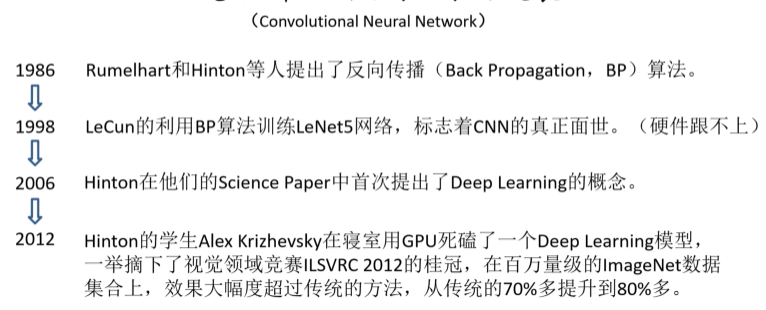

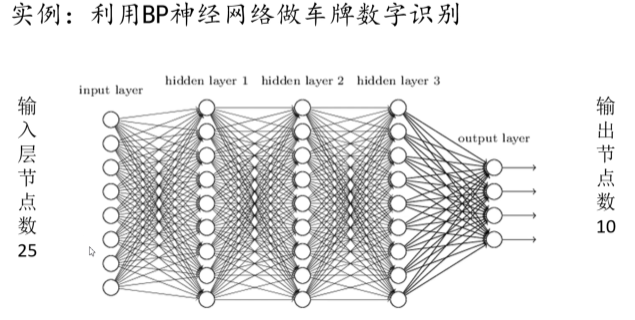

一、卷积神经网络(CNN)的发展

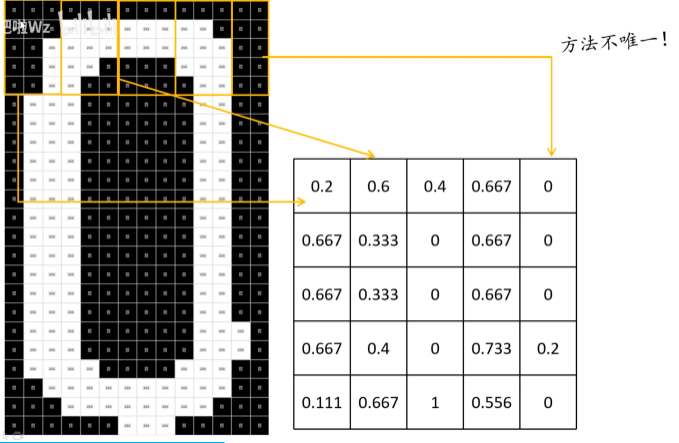

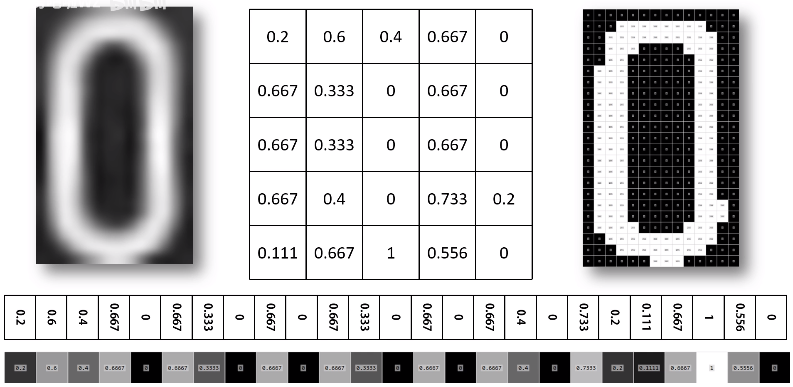

二、全连接层

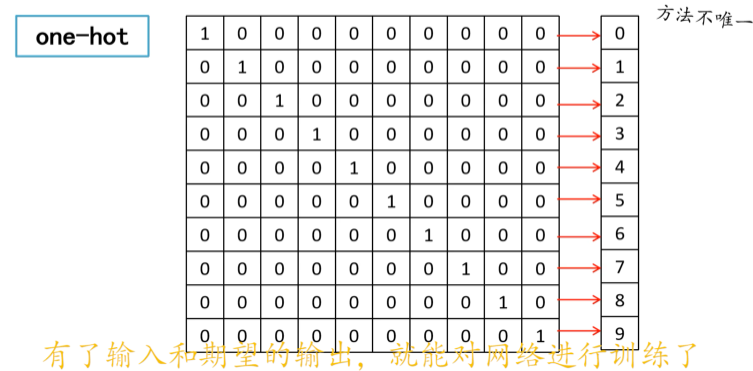

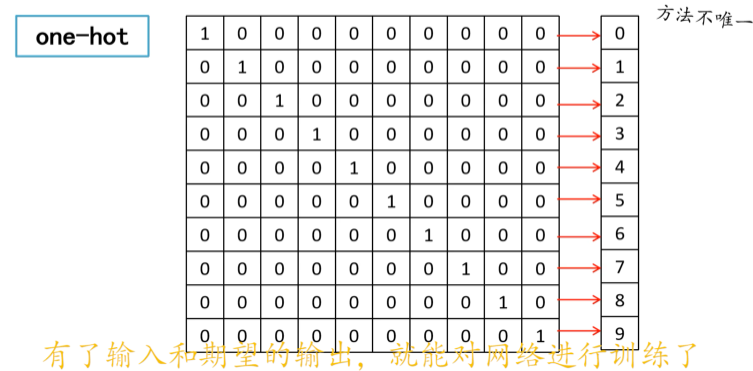

输出层。

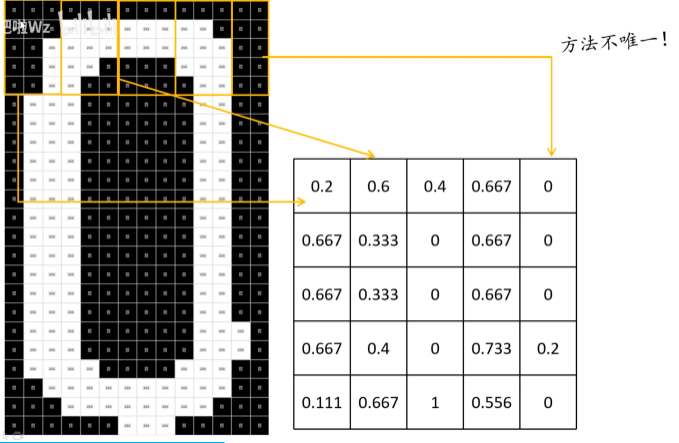

输入层。

声明:文中所用截图及相关知识来自B站up霹雳吧啦Wz

目录

输出层。

输入层。

3928

3928

672

672

36万+

36万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?