卷积神经网络通俗理解

。

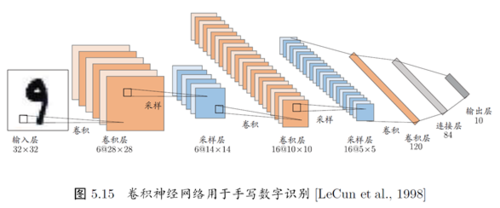

卷积神经网络(ConvolutionalNeuralNetworks,CNN)是一类包含卷积计算且具有深度结构的前馈神经网络(FeedforwardNeuralNetworks),是深度学习(deeplearning)的代表算法之一。

卷积神经网络具有表征学习(representationlearning)能力,能够按其阶层结构对输入信息进行平移不变分类(shift-invariantclassification),因此也被称为“平移不变人工神经网络。

卷积神经网络算法是什么?

一维构筑、二维构筑、全卷积构筑AI爱发猫 www.aifamao.com。

卷积神经网络(ConvolutionalNeuralNetworks,CNN)是一类包含卷积计算且具有深度结构的前馈神经网络(FeedforwardNeuralNetworks),是深度学习(deeplearning)的代表算法之一。

卷积神经网络具有表征学习(representationlearning)能力,能够按其阶层结构对输入信息进行平移不变分类(shift-invariantclassification),因此也被称为“平移不变人工神经网络&#x

卷积神经网络(CNN)是深度学习的重要代表,具有表征学习和平移不变性。其稀疏连接和权重共享特性降低了过拟合风险,广泛应用于图像识别、人脸识别和模式分类。全连接层用于特征的最后提纯,便于分类。

卷积神经网络(CNN)是深度学习的重要代表,具有表征学习和平移不变性。其稀疏连接和权重共享特性降低了过拟合风险,广泛应用于图像识别、人脸识别和模式分类。全连接层用于特征的最后提纯,便于分类。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?