1、tf.truncated_normal与tf.random_normal

- 1

从截断的正态分布中输出随机值。

生成的值服从具有指定平均值和标准偏差的正态分布,如果生成的值大于平均值2个标准偏差的值则丢弃重新选择。

在正态分布的曲线中,横轴区间(μ-σ,μ+σ)内的面积为68.268949%。

横轴区间(μ-2σ,μ+2σ)内的面积为95.449974%。

横轴区间(μ-3σ,μ+3σ)内的面积为99.730020%。

X落在(μ-3σ,μ+3σ)以外的概率小于千分之三,在实际问题中常认为相应的事件是不会发生的,基本上可以把区间(μ-3σ,μ+3σ)看作是随机变量X实际可能的取值区间,这称之为正态分布的“3σ”原则。

在tf.truncated_normal中如果x的取值在区间(μ-2σ,μ+2σ)之外则重新进行选择。这样保证了生成的值都在均值附近。

参数:

- shape: 一维的张量,也是输出的张量。

- mean: 正态分布的均值。

- stddev: 正态分布的标准差。

- dtype: 输出的类型。

- seed: 一个整数,当设置之后,每次生成的随机数都一样。

- name: 操作的名字。

- 1

从正态分布中输出随机值。

参数:

- shape: 一维的张量,也是输出的张量。

- mean: 正态分布的均值。

- stddev: 正态分布的标准差。

- dtype: 输出的类型。

- seed: 一个整数,当设置之后,每次生成的随机数都一样。

- name: 操作的名字。

代码

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

指定seed之后,a的值不变,b的值也不变,值得是重复生成随机数时其随机数没有改变。

2、placeholder函数

tensorflow中又一保存数据的利器,placeholder(type,strucuct…)它的第一个参数是你要保存的数据的数据类型,大多数是tensorflow中的float32数据类型,后面的参数就是要保存数据的结构,比如要保存一个1×2的矩阵,则struct=[1 2]。它在使用的时候和前面的variable不同的是在session运行阶段,需要给placeholder提供数据,利用feed_dict的字典结构给placeholdr变量“喂数据”,具体使用如下:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

运行结果:

3、tf.nn.softmax_cross_entropy_with_logits的用法

在计算loss的时候,最常见的一句话就是tf.nn.softmax_cross_entropy_with_logits,那么它到底是怎么做的呢?

首先明确一点,loss是代价值,也就是我们要最小化的值

tf.nn.softmax_cross_entropy_with_logits(logits, labels, name=None)

除去name参数用以指定该操作的name,与方法有关的一共两个参数

:

第一个参数logits:就是神经网络最后一层的输出,如果有batch的话,它的大小就是[batchsize,num_classes],单样本的话,大小就是num_classes

第二个参数labels:实际的标签,大小同上

具体的执行流程大概分为两步:

第一步是先对网络最后一层的输出做一个softmax,这一步通常是求取输出属于某一类的概率,对于单样本而言,输出就是一个num_classes

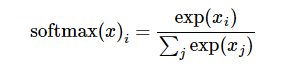

softmax的公式是:

至于为什么是用的这个公式?这里不介绍了,涉及到比较多的理论证明

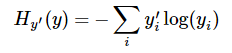

第二步是softmax的输出向量[Y1,Y2,Y3...]和样本的实际标签做一个交叉熵,公式如下:

其中

softmax的输出向量[Y1,Y2,Y3...]

显而易见,预测

注意!!!这个函数的返回值并不是一个数,而是一个向量,如果要求交叉熵,我们要再做一步tf.reduce_sum操作,就是对向量里面所有元素求和,最后才得到

tf.reduce_mean操作,对向量求均值!

理论讲完了,上代码

输出结果是:

我们的输出是符合公式逻辑的

4、tf.argmax函数

tf.argmax(input, axis=None, name=None, dimension=None)

- input:输入Tensor

- axis:0表示按列,1表示按行

- name:名称

- dimension:和axis功能一样,默认axis取值优先。新加的字段

4、range()函数的用法

详细记录python的range()函数用法

使用python的人都知道range()函数很方便,今天再用到他的时候发现了很多以前看到过但是忘记的细节。这里记录一下range(),复习下list的slide,最后分析一个好玩儿的冒泡程序。

这里记录一下:

>>>

range

(

1

,

5

)

#代表从1到5(不包含5)

[

1

,

2

,

3

,

4

]

>>>

range

(

1

,

5

,

2

)

#代表从1到5,间隔2(不包含5)

[

1

,

3

]

>>>

range

(

5

)

#代表从0到5(不包含5)

[

0

,

1

,

2

,

3

,

4

]

|

tf.constant(value,dtype=None,shape=None,name=’Const’)

创建一个常量tensor,按照给出value来赋值,可以用shape来指定其形状。value可以是一个数,也可以是一个list。

如果是一个数,那么这个常亮中所有值的按该数来赋值。

如果是list,那么len(value)一定要小于等于shape展开后的长度。赋值时,先将value中的值逐个存入。不够的部分,则全部存入value的最后一个值。

a = tf.constant(2,shape=[2])

b = tf.constant(2,shape=[2,2]) c = tf.constant([1,2,3],shape=[6]) d = tf.constant([1,2,3],shape=[3,2]) sess = tf.InteractiveSession() print(sess.run(a)) #[2 2] print(sess.run(b)) #[[2 2] # [2 2]] print(sess.run(c)) #[1 2 3 3 3 3] print(sess.run(d)) #[[1 2] # [3 3] # [3 3]]

8237

8237

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?