实验目的

在学完判别模型中感知机,逻辑回归,软间隔支持向量机等算法之后我们我们首次接触到了生成模型中的朴素贝叶斯算法。

实验原理

1.朴素贝叶斯法是典型的生成学习方法。

生成模型:学习得到联合概率分布P(x,y),即特征x和标记y共同出现的概率,然后求条件概率分布。能够学习到数据生成的机制。

判别模型:学习得到条件概率分布P(y|x),即在特征x出现的情况下标记y出现的概率。

数据要求:生成模型需要的数据量比较大,能够较好地估计概率密度;而判别模型对数据样本量的要求没有那么多。

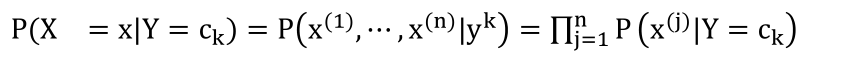

2.朴素贝叶斯法的基本假设是条件独立性。

3.朴素贝叶斯法利用贝叶斯定理与学到的联合概率模型进行分类预测

实验过程

用的GaussianNB是高斯朴素贝叶斯分类器的scikit-learn实现。

import numpy as np

from sklearn.naive_bayes import GaussianNB

X=np.array([[-1,-1],[-2,-1],[-3,-2],[1,1],[2,1],[3,2]])

Y=np.array([1,1,1,2,2,2])

clf=GaussianNB()

clf.fit(X,Y)

print(clf.predict([[-0.8,-1]]))

print(clf.predict_proba([[-0.8,-1]]))

实验结果

[1]

[[9.99999949e-01 5.05653254e-08]]

[[-5.05653266e-08 -1.67999998e+01]]

| 批阅人 | |

|---|---|

| 分数 | |

| 时间 | 2021年12月31日 |

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?