Learning Multiple Adverse Weather Removal via Two-stage Knowledge Learning and Multi-contrastive Regularization: Toward a Unified Model

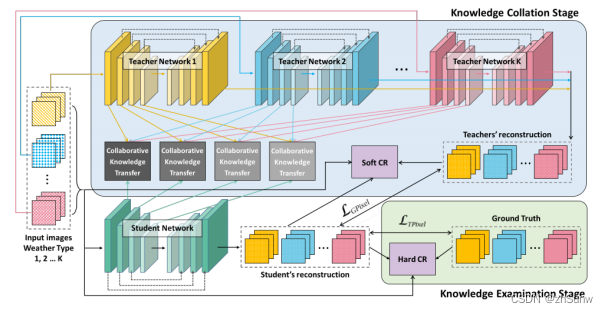

在know ledgedistillation基础上设计了Two-stage Knowledge Learning (Collation-Examination)并引入contrastive learning的方法。

Method

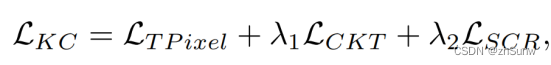

Collaborative Knowledge Transfer(CKT)

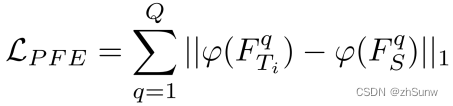

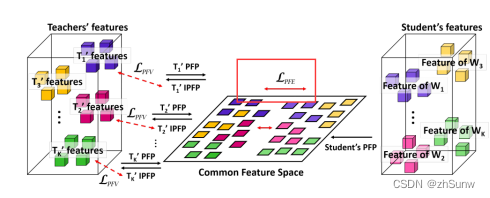

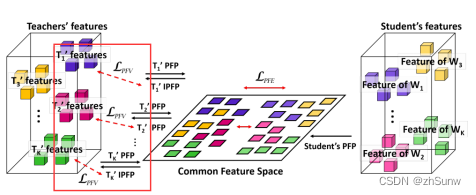

Progressive Feature Projector(PFP)

将教师和学生网络的特征投影到一个共同的特征空间中,计算两个投影特征的L1损失:Q表示编码层数,Ti表示第i个教师网络,S表示学生网路

投影通过几个步幅为1的卷积块和ReLU激活函数组成的小网络实现

Bidirectional Feature Matching

将教师网络的投影特征投影回原始输入空间,计算两个特征的L1损失保证投影的有效性

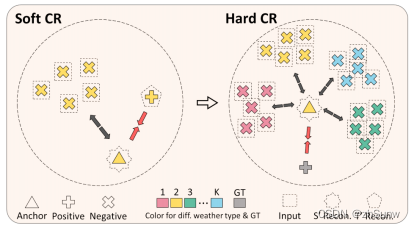

Multi-contrastive Regularization(Two-stage Knowledge Learning)

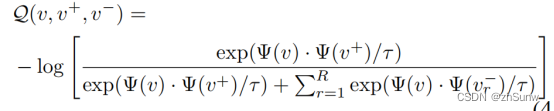

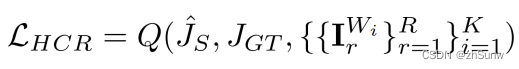

Contrastive Regularization:v,v+,v-分别表示预测样本,正样本(目标样本),负样本;Ψ表示使用VGG-19提取的特征;R为负样本的个数.

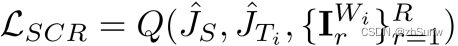

Soft Contrastive Regularization.(Knowledge Collation (KC).)

Soft:使用教师的预测结果作为正样本避免前期学习的挑战性

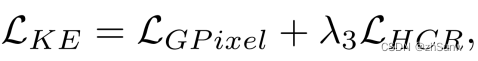

Hard Contrastive Regularization.(Knowledge Examination (KE).)

Hard:训练一段时间后直接将groundtruth作为正样本学习

2724

2724

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?