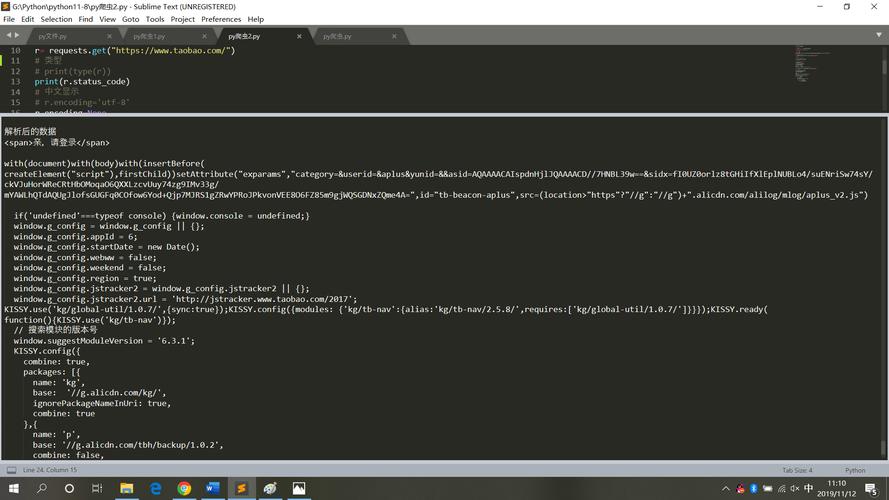

大家好,小编为大家解答怎么用python爬取网络页面的数据类型的问题。很多人还不知道怎么用python爬取网络页面的数据源,现在让我们一起来看看吧!

# Python爬取网页的三种方法之一: 使用urllib或者urllib2模块的getparam方法

import urllib

fopen1 = urllib.urlopen('http://www.baidu.com').info()

fopen2 = urllib2.urlopen('http://www.sina.com').info()

print fopen1.getparam('charset')

print fopen2.getparam('charset')

#----有些网站有反爬虫技术,需要如下办法----

url = 'http://www.qiushibaike.com/hot/page/1'

user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)'

headers = { 'User-Agent' : user_agent }

request = urllib2.Request(url,headers = headers)

c_res=urllib2.urlopen(request).info()

print c_res.getparam('charset')

# Python爬取网页的三种方法之二 : 使用chardet模块 ---感觉比方法一速度慢一点

import chardet

import urllib

#先获取网页内容

data1 = urllib.urlopen('http://www.baidu.com').read()

#用chardet进

3867

3867

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?