这两天读了论文1《Hierachical Attention Networks for Document Classification》

和论文2《Bidirectional Long Short-Term Memory Networks for Relation Classification》

为啥会读这两篇文章呢,是因为在10号整理最近所读的文章的时候查到了我的方向的中文论文,有一篇提及是由上述两篇文章所引申而来的。加上一直想实现一个稍复杂的LSTM的分类任务(已经实现了一个很小的例子,想进一步的了解相关知识),顿时就有了兴趣。

论文1:

本文贡献

- 本文提出了类似于,词-句子-文章结构的层次模型。

- 本文提出了用用在单词和句子上面的注意力机制,使得在构成句子和文章表示的时候,可以区分不同的重要度。

借鉴意义

- 这篇文章的实验部分对数据集的介绍比较详细,有详细的对比实验和说明

- Model configuration and training 部分,稍稍详细,对实验或由帮助。但遗憾的是,没有部分代码的共享(哈哈)。

- 本文的baseline也是比较多的,实验部分的对比,可以作为一个借鉴。

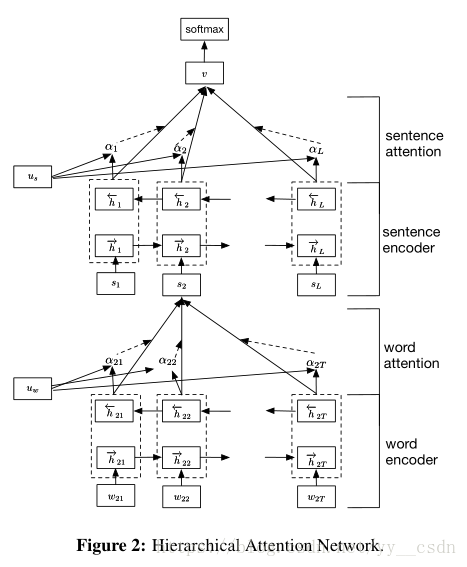

模型

上模型图:

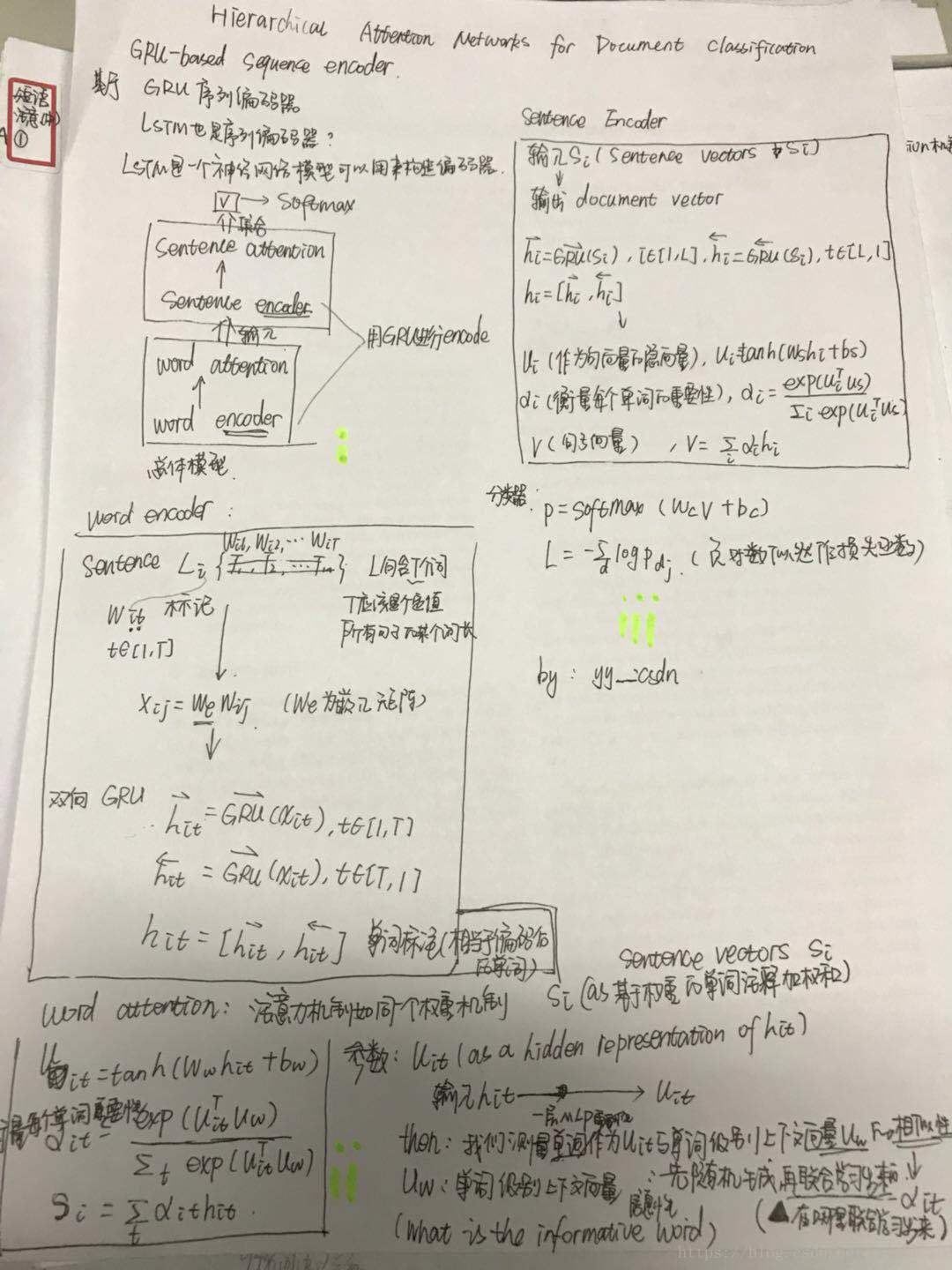

上我的理解图:

顺序为i,ii,iii

encode部分用的是基于GRU的序列编码器

关于lstm和gru的区别:

参考,找个时间完善这篇文章。

https://blog.csdn.net/u012223913/article/details/77724621

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?