前言

介绍

SD(Stable Diffusion)中,ControlNet绝对是一个绕不开的神器!它不仅能让你生成的图片更符合预期,还能控制线条、姿势、色彩等多种细节,真正做到“所想即所得”。

今天这篇文章,一图流展示ControlNet的各种控制类型和效果。简单易懂,帮你快速掌握ControlNet控制类型!

文章有点长,建议码住。

温馨提示🔔:

本节生图时均用基础大模型且没有添加复杂文本提示词,只为展示各控制类型效果,便于小白也能跟着实操!

线条控制

在controlnet中用于线条控制的有Canny边缘检测、M-LSD边缘检测、Lineart动漫线条提取和softedge_hed边缘检测。接下来我们就分别来看一下这些功能。

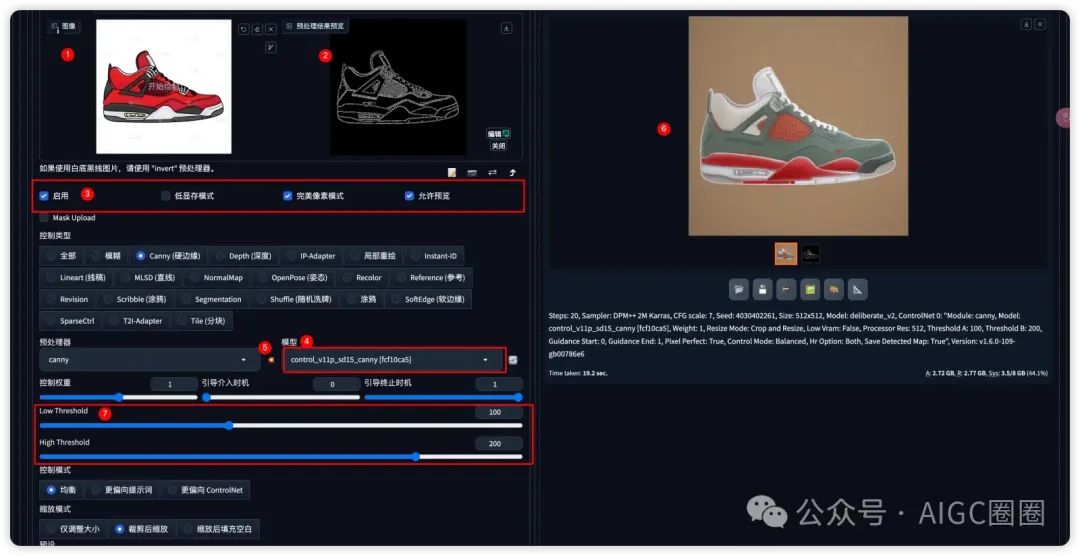

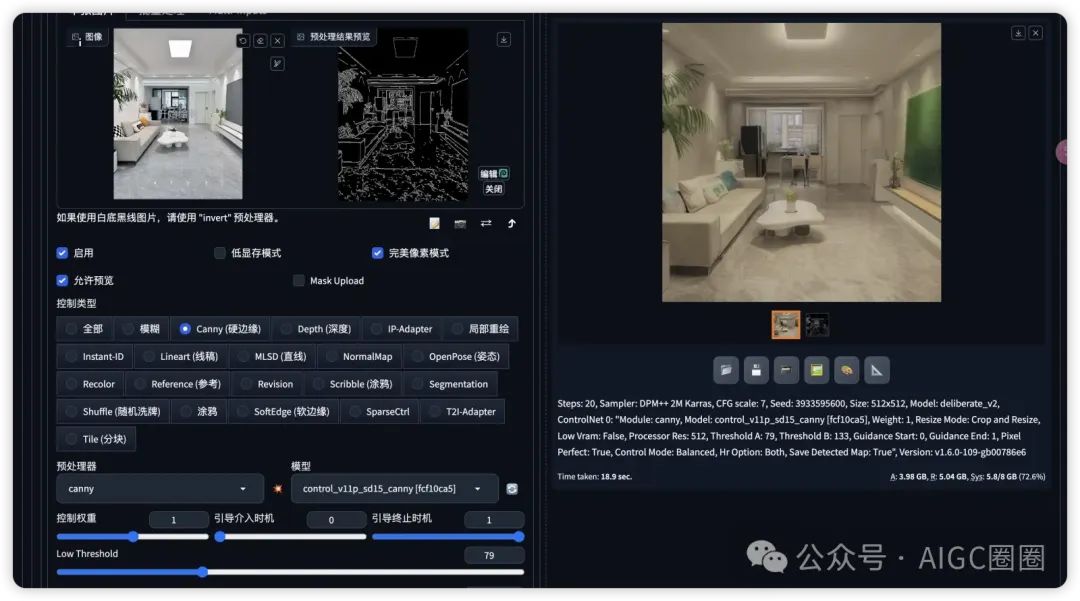

1.Canny边缘检测

可以做到比较精准的边缘检测

启用流程,我们直接一图流来看一下⬇️

将源图拖入序号1️⃣内,功能区序号2️⃣内启用这几个功能,然后控制类型选择Canny,对应的预处理器和模型记得调整匹配的(不然点击生图后没有效果)。参数都调整完以后,点击序号5️⃣的小爆炸图标,可以完成预览效果。就会提取源图的线条,新生成的图就会受这些线条的控制。最后生图效果如序号6️⃣图。

序号7️⃣Low Threshold和High Threshold(即高低阈值),这个主要是用来调整,线条控制的细节度的,为什么是两个阈值,圈圈在网上也查了一下关于这个的介绍,包括我个人学习过的课程,基本没有讲的太准确的。要理解清楚这个就必须了解一下canny算法的一些底层逻辑,而这不是应用级的内容,如果想理解就继续看下面框内的介绍,不想理解可以略过,这个内容不做强求。

一般的边缘检测算法都是单阈值的,即设置一个阈值来和边缘像素点做对比,如果比这个值大就认为是强边缘点,(就认为是边缘了),否则这个点就被抑制掉了(认为非边缘)。

而canny采用了双阈值,即大于High Threshold的边缘像素点被标记为强边缘点,大于Low Threshold的且小于High Threshold的被标记为弱边缘点,小于Low Threshold的才会被抑制掉。

而其中这个弱边缘点,在从强边缘点出发过滤时如果一直是相连接的就保留,否则就被抑制掉。是不是有点理解边缘是怎么检测出来的了。所以这个东西不是随便调的,有一 定的关联性的,低阈值再怎么调也要比高阈值低,且推荐的高低阈值最佳配比是2:1或者3:1.

所有的AI设计工具,模型和插件,都已经整理好了,👇获取~

如果不想看,用默认的设置就可以,太多太少的线条控制都不太好。

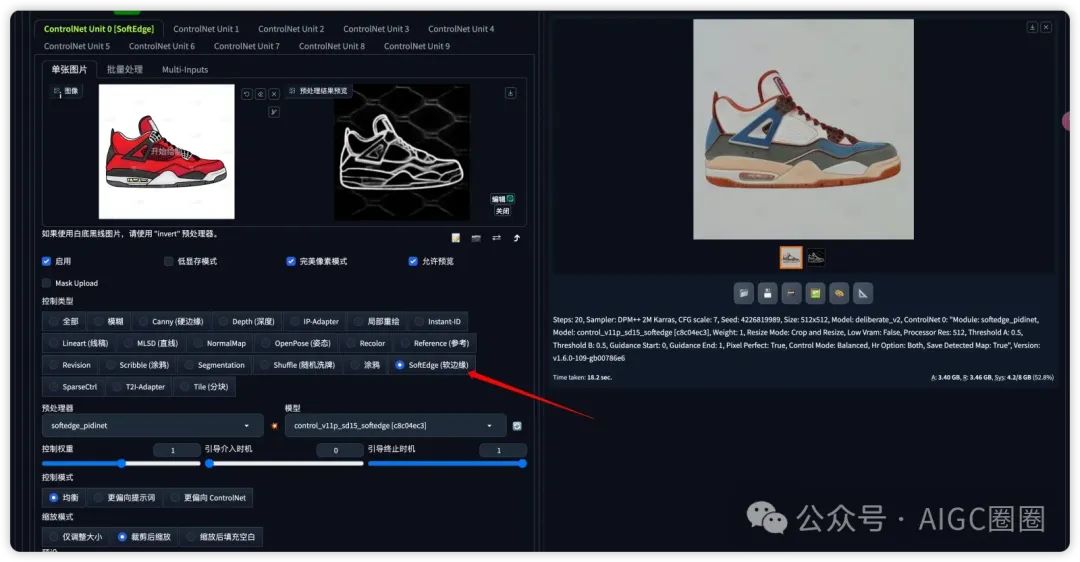

2.SoftEdge(软边缘)

主要保留轮廓的细节,一般不用于太复杂的画面,具体大家可以在实操的时候多换着用,来感受。

选择控制类型为softEdge,点击小爆炸预览下效果(如图),然后看下生成效果图⬆️。

都是和上面一样的操作,主要带大家看下预览效果和生图效果。

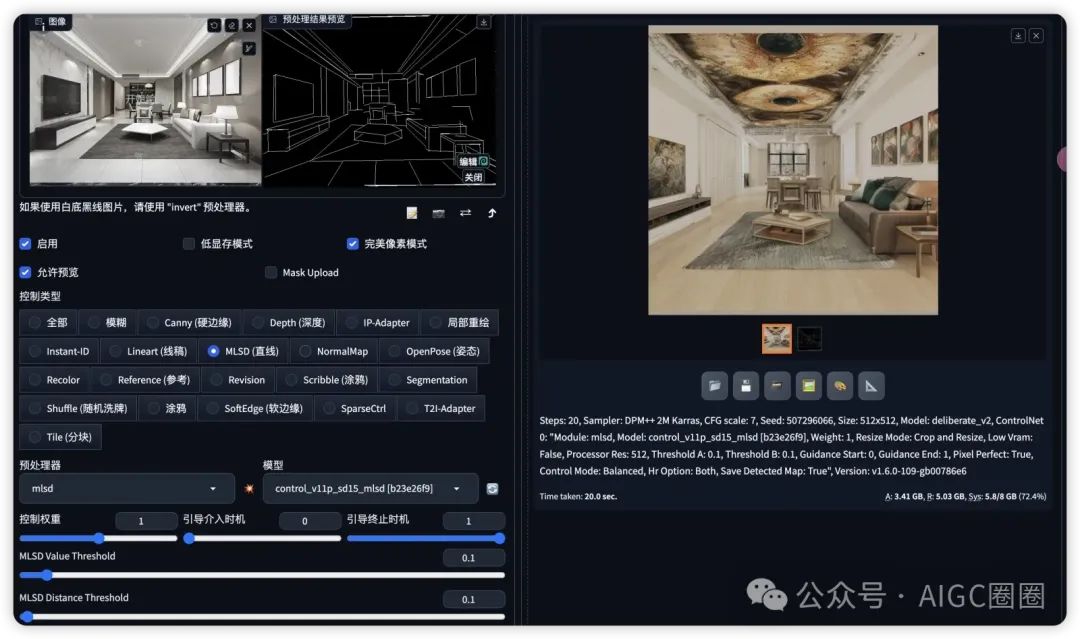

3.M-LSD边缘检测

结构性线条检测,比较适合建筑、室内设计时的出图控制。

你看这种图,如果用了MLSD边缘检测,就检测不出来。⬇️

这时候如果我们给他一个室内设计的图,检测效果和出图效果都很好⬇️

到这里你在网上看到的很多用sd做室内设计的都是以这个为基础点来搞的!

⬆️图中的参数介绍:

MLSD Value Threshold:

调节画面线条的工具,数值越大,画面线条越少。

MLSD Distance Threshold:

对远距离线条的处理,数值越大,远距离线条越少。

需要我们实际应用时,边调整边预览边看效果。

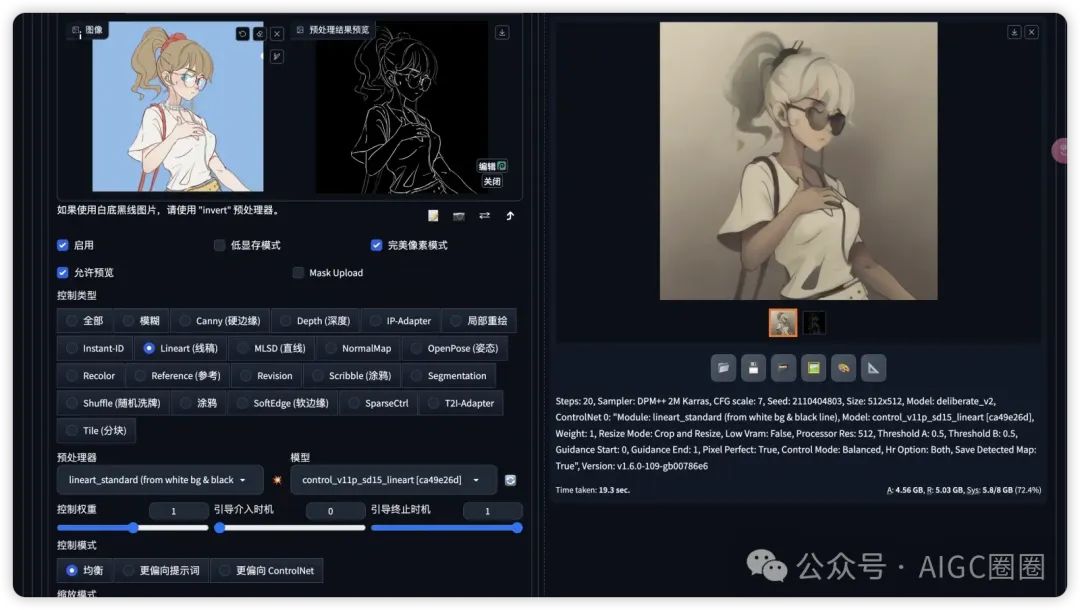

4.Lineart线条检测

比较适合动漫的线条提取

一图流展示如下⬇️,注意留意预览图和生成效果的控制

注⚠️:开篇已经说明,本节生图全是默认模型且不添加复杂文本提示词,方便新手操作,所以生图结果只看控制效果,自己实操的时候可以选择模型和添加提示词来调整出图效果!

姿势控制

在controlnet中通过OpenPose来进行姿势控制,后面我们还会讲一个核心插件3D OpenPose控制更细节,这里先来看一下controlnet中的。

OpenPose(姿势)

一图流如下,可以看到预览图可以识别出角色的骨骼图,来对生图进行姿势约束。

你可以点击编辑来对骨骼节点等进行编辑。

可供选择的预处理器如下,根据下图的中文翻译根据你生图要控制的部分来选择就可以!

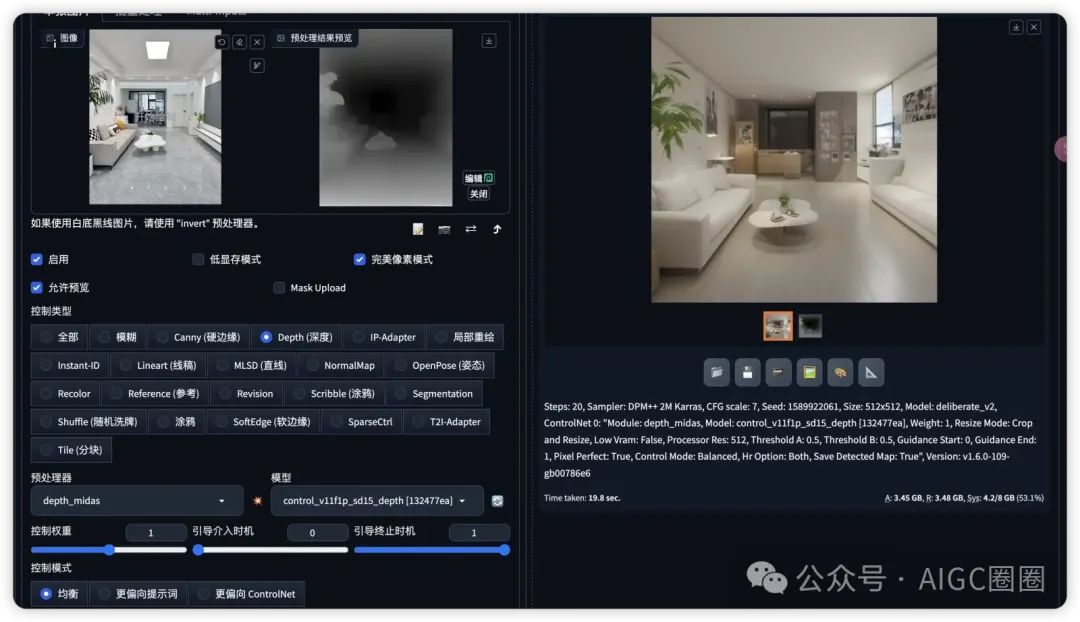

深度控制

它可以探测图片生成深度图,然后在生图时会基于图像深度进行控制来渲染目标图片。

一图流如下⬇️,控制类型选择Depth就可以使用,生成的预览图,越靠前越白,越靠后越黑,基于此控制生成的效果图就会被深度约束。

这时候,肯定有小伙伴会对其控制效果表示怀疑,那么women用canny来控制这张图片来看下效果,看看在深度感上有什么不同

很明显第一张图的深度感更强烈。

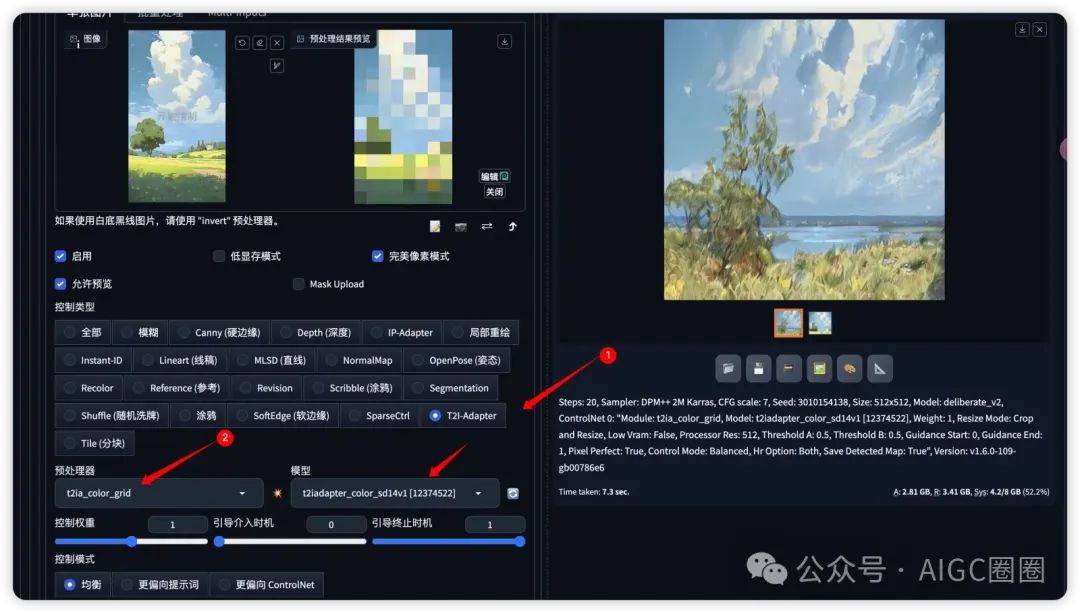

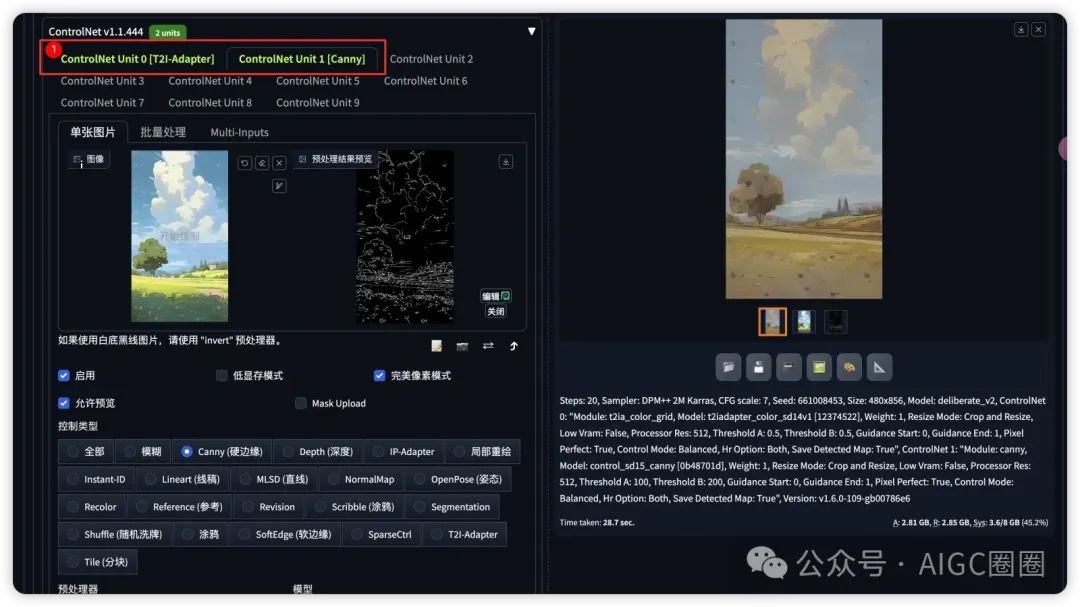

色彩控制

参考原图的色彩来约束生图。

一图流如下⬇️,需要选择控制类型T2I,然后预处理器选择color对应的,模型可以看到这个前缀不是control而是t2iadapter,前文我们开篇介绍文件命名时可以知道如果不是control开头的这个就是个非官方模型,生图效果会被原图的色彩所约束。

我们可以再加一个控制单元,比如线条控制,两个control来一起控制生图(如下图序号1️⃣),注意两个通道的control都要启用,同时控制线条和颜色来看下效果(色彩不太像,主要是因为大模型用的默认的,这里启发大家可以多开几个通道一起控制)

风格控制

用过Midjourney应该知道–sref这个参数,就是用来风格控制的,我们来看看SD中的效果

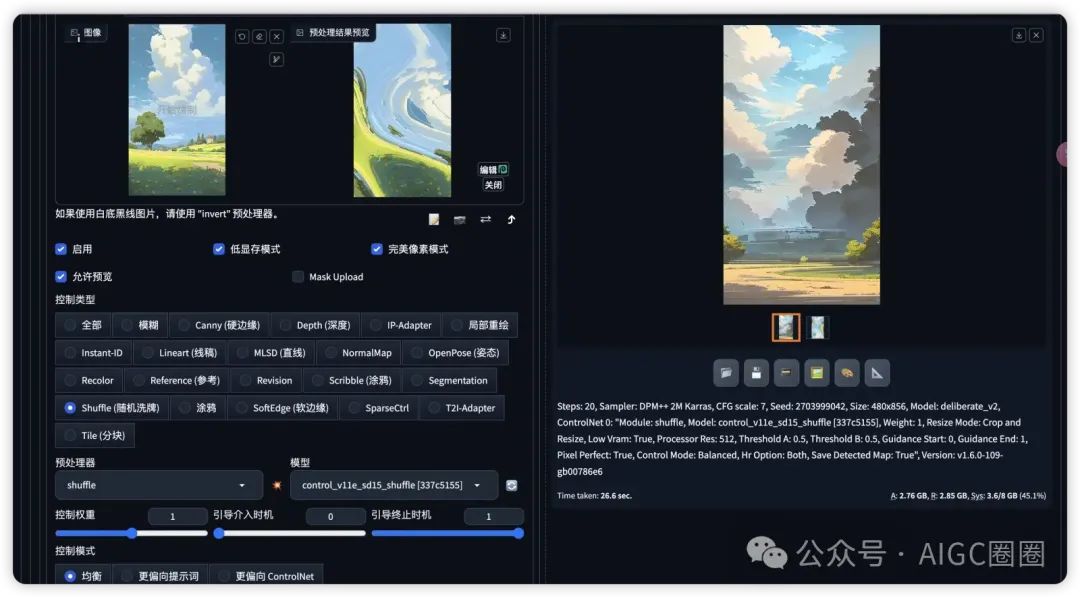

shuff(随机洗牌)

可以提取图片风格,一图流如下下

物品控制

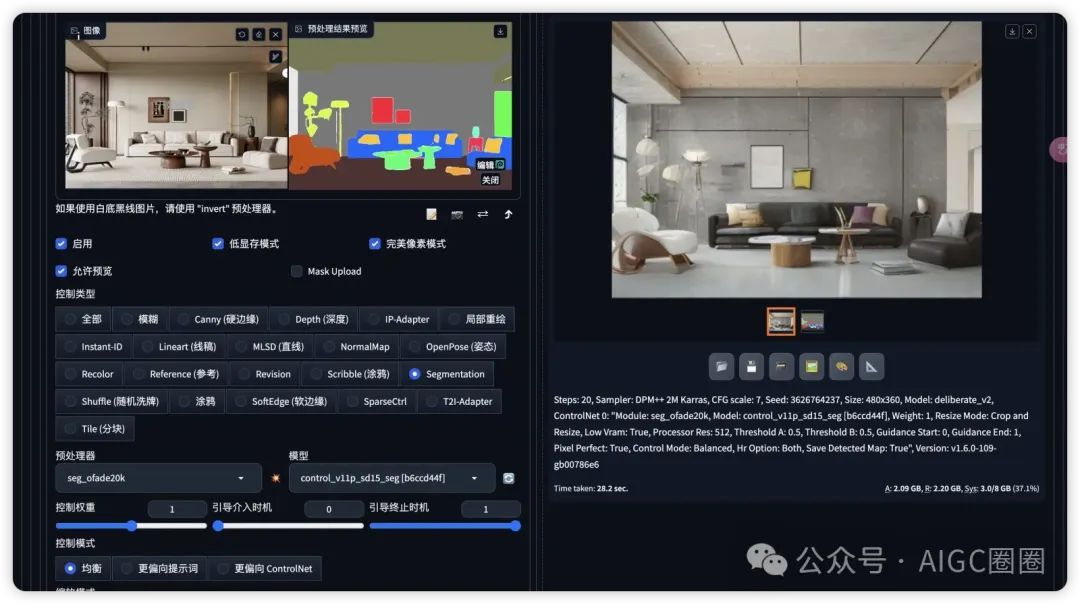

seg语义分割

它会将物品进行分割,有点像前面介绍的segment anything,而且每种色彩都有对应的物品。

一图流如下⬇️,可以从预览图中看出,对不同物品进行了颜色的区分,在生图时就会生成对应的物品。

其他控制

由于ControlNet更新很快,后续肯能会出更多的控制效果,此篇内容均来自圈圈小报童专栏,感兴趣在文章最后可以了解一下。

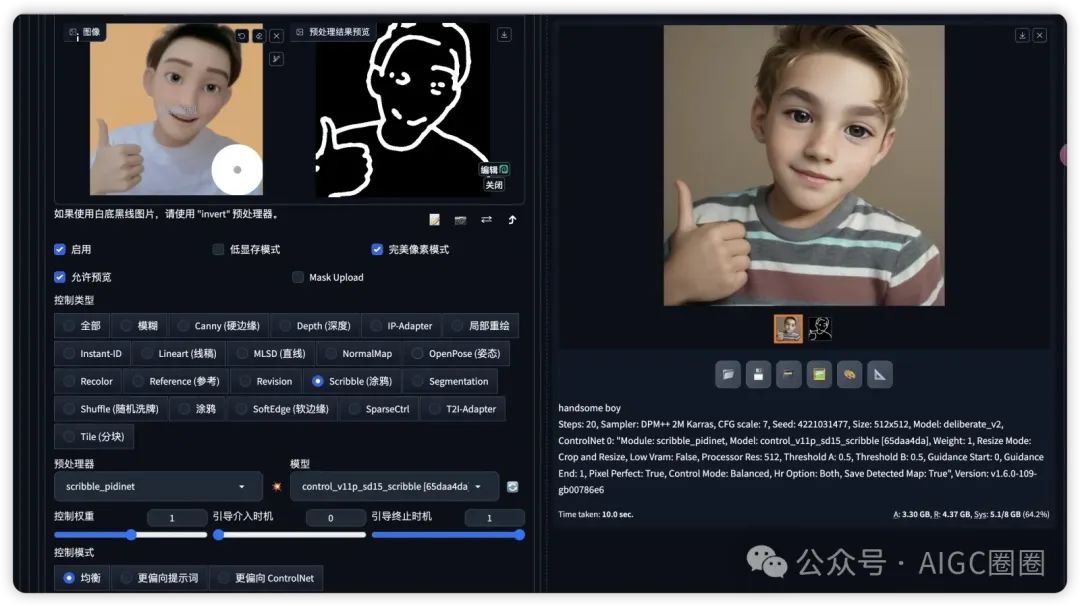

1.Scribble(涂鸦)

可以上传图片,一图流如下。

💡Tips:也可以自己创建空白画布自己涂鸦来生图,如果还不知道怎么创建空白画布,圈圈专栏有讲)

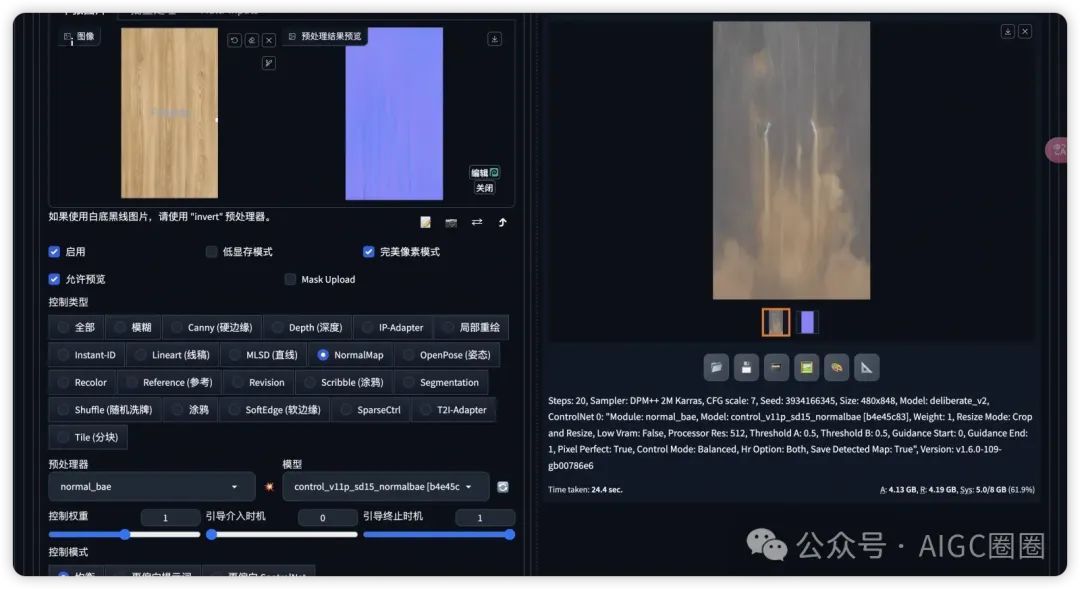

2.Normal法线

这个通常用于参考图中材质的约束,比如木纹材质等各种材质,如果你比较中意原图的材质感可以启用这个控制。

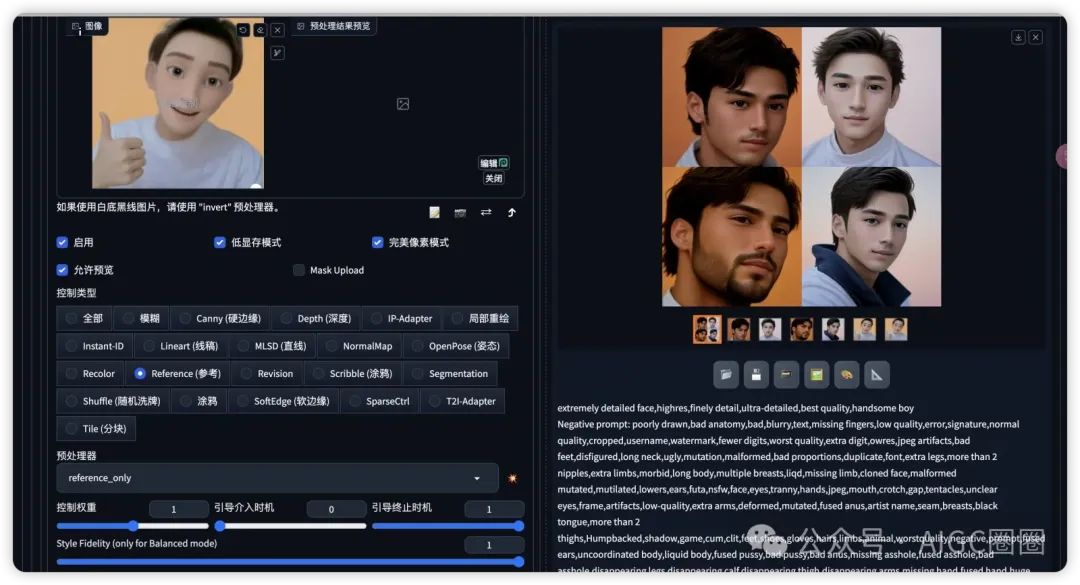

3.Reference(参考)

这个有点类似Midjourney中的–cref角色一致性控制

一图流如下

Style Fidelity(仅用于均衡模式):风格保真度。

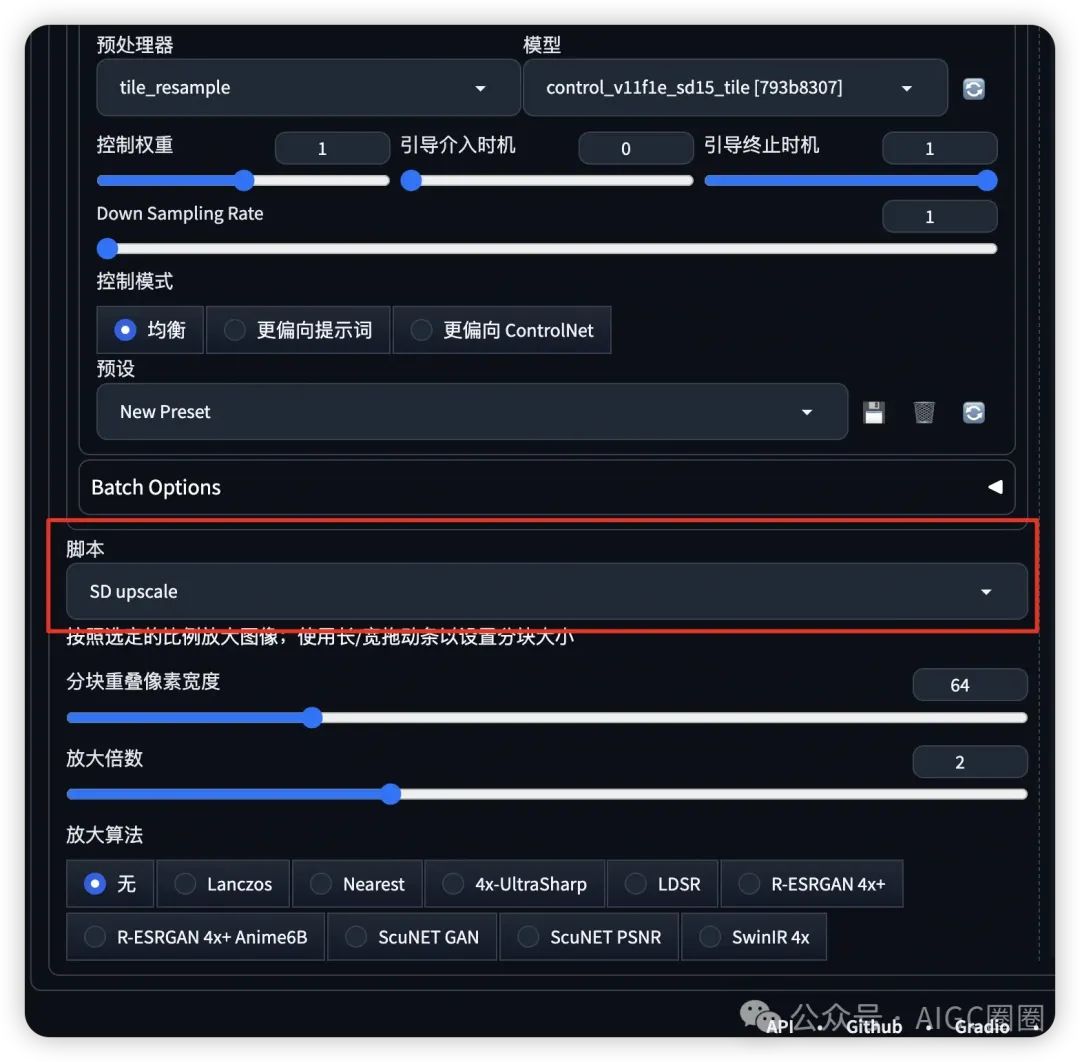

4.Tile(分块)

可以补充细节以及颜色修复

我们用图生图功能,看一下效果

💡Tips:仔细观察瞳孔和睫毛的一些细节,放到PS中对比会更明显。这个通常会结合放大使用,下面会介绍

Tile设置⬇️

结合upscale放大使用来高清细节化图片。脚本那里选择SD upscale设置放大倍数后再生图就可以,搭配Tile使用效果很好!

参数⬇️

Tile 模型专属参数 Down Sampling Rate,意思是向下缩放取样系数。作用是系数越大,得到的参考图越小,取值细节越小,最终得到的效果图随机细节越多,与原图的关系越小。

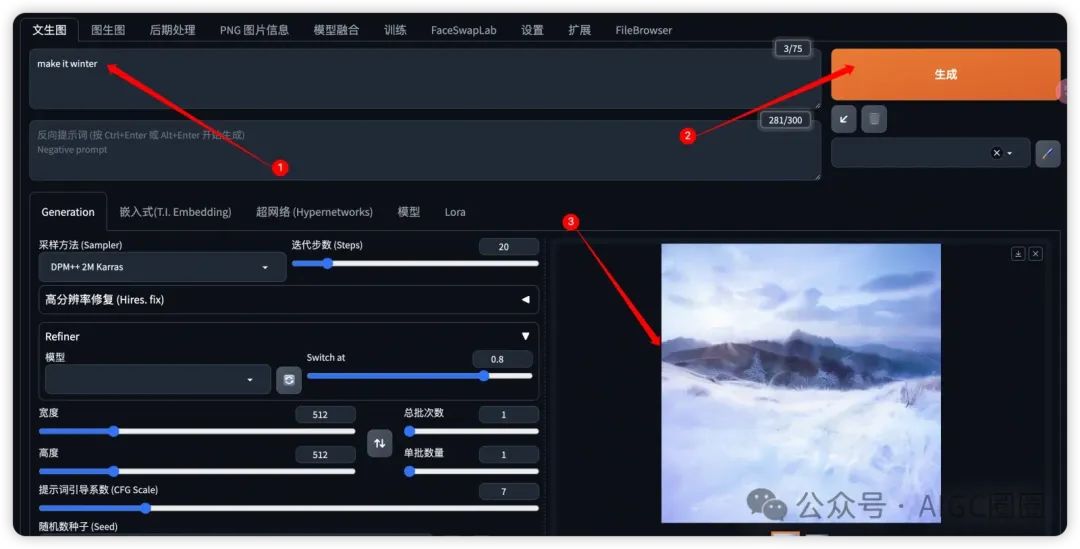

5.IP2P(make it ***)

有个固定用法,在提示词中输入make it xxx(中文就是使它变成什么什么)比如我们可以让一张春天的场景变成冬天的场景。

导入一张风景照

提示词中输入 make it winter(意思是使它变成冬天),看下效果

这个东西当有人像在图中时效果不是很好,常应用在场景图上面。

送资料

本节带大家预览来几乎所有controlnet的控制类型,及其生图效果,绝对不是随便码个教程来应付,如果你觉得本文对你有所帮助,辛苦点个赞和在看!

这里直接将该软件分享出来给大家吧~

1.stable diffusion安装包

随着技术的迭代,目前 Stable Diffusion 已经能够生成非常艺术化的图片了,完全有赶超人类的架势,已经有不少工作被这类服务替代,比如制作一个 logo 图片,画一张虚拟老婆照片,画质堪比相机。

最新 Stable Diffusion 除了有win多个版本,就算说底端的显卡也能玩了哦!此外还带来了Mac版本,仅支持macOS 12.3或更高版本。

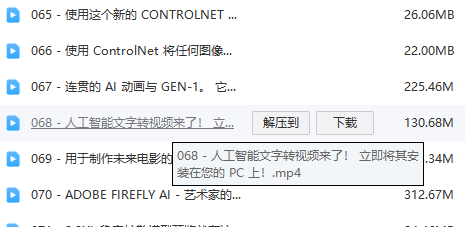

2.stable diffusion视频合集

我们在学习的时候,往往书籍源码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,一步步带你入坑stable diffusion,科学有趣才能更方便的学习下去。

3.stable diffusion模型下载

stable diffusion往往一开始使用时图片等无法达到理想的生成效果,这时则需要通过使用大量训练数据,调整模型的超参数(如学习率、训练轮数、模型大小等),可以使得模型更好地适应数据集,并生成更加真实、准确、高质量的图像。

4.stable diffusion提示词

提示词是构建由文本到图像模型解释和理解的单词的过程。可以把它理解为你告诉 AI 模型要画什么而需要说的语言,整个SD学习过程中都离不开这本提示词手册。

5.SD从0到落地实战演练

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名SD大神的正确特征了。

这份完整版的stable diffusion资料我已经打包好,需要的点击下方插件,即可前往免费领取!

1542

1542

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?