CoT 来自google团队2022年论文《Chain-of-Thought Prompting Elicits Reasoning in Large Language Models》

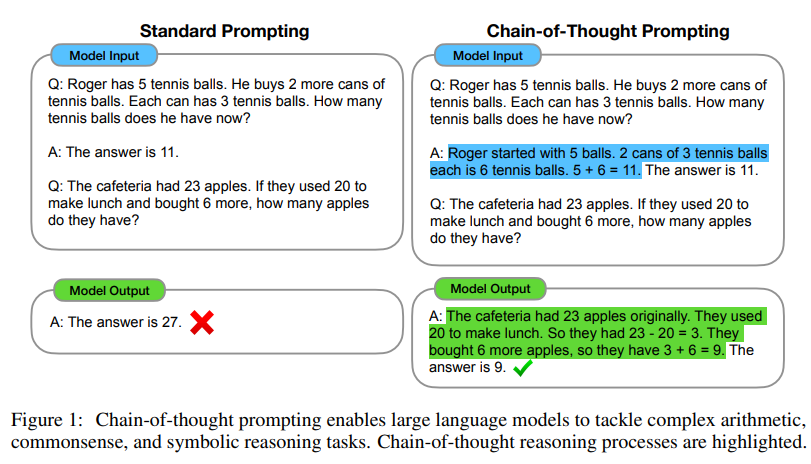

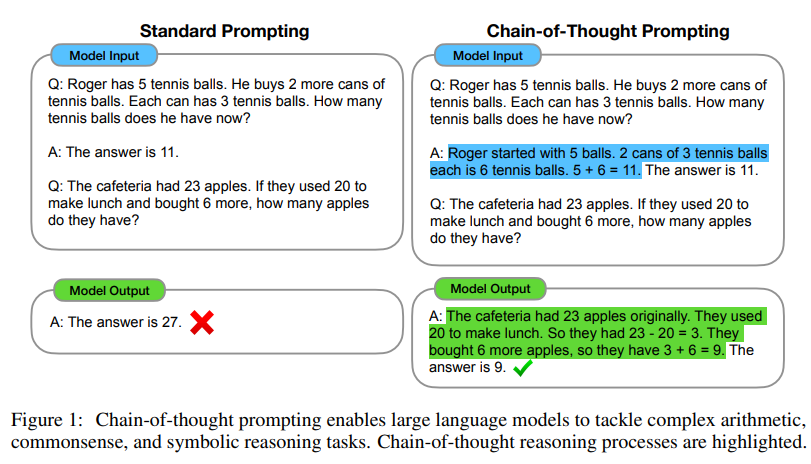

单纯的增加模型规模发现不能够很好的解决数学、常识、符合推理等问题。所以提出了chain of thought (CoT)想法。主要是修改提示词为:<input, chain of thought, output>.让模型有些中间推理步骤。如下图所示:

CoT 来自google团队2022年论文《Chain-of-Thought Prompting Elicits Reasoning in Large Language Models》

单纯的增加模型规模发现不能够很好的解决数学、常识、符合推理等问题。所以提出了chain of thought (CoT)想法。主要是修改提示词为:<input, chain of thought, output>.让模型有些中间推理步骤。如下图所示:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?