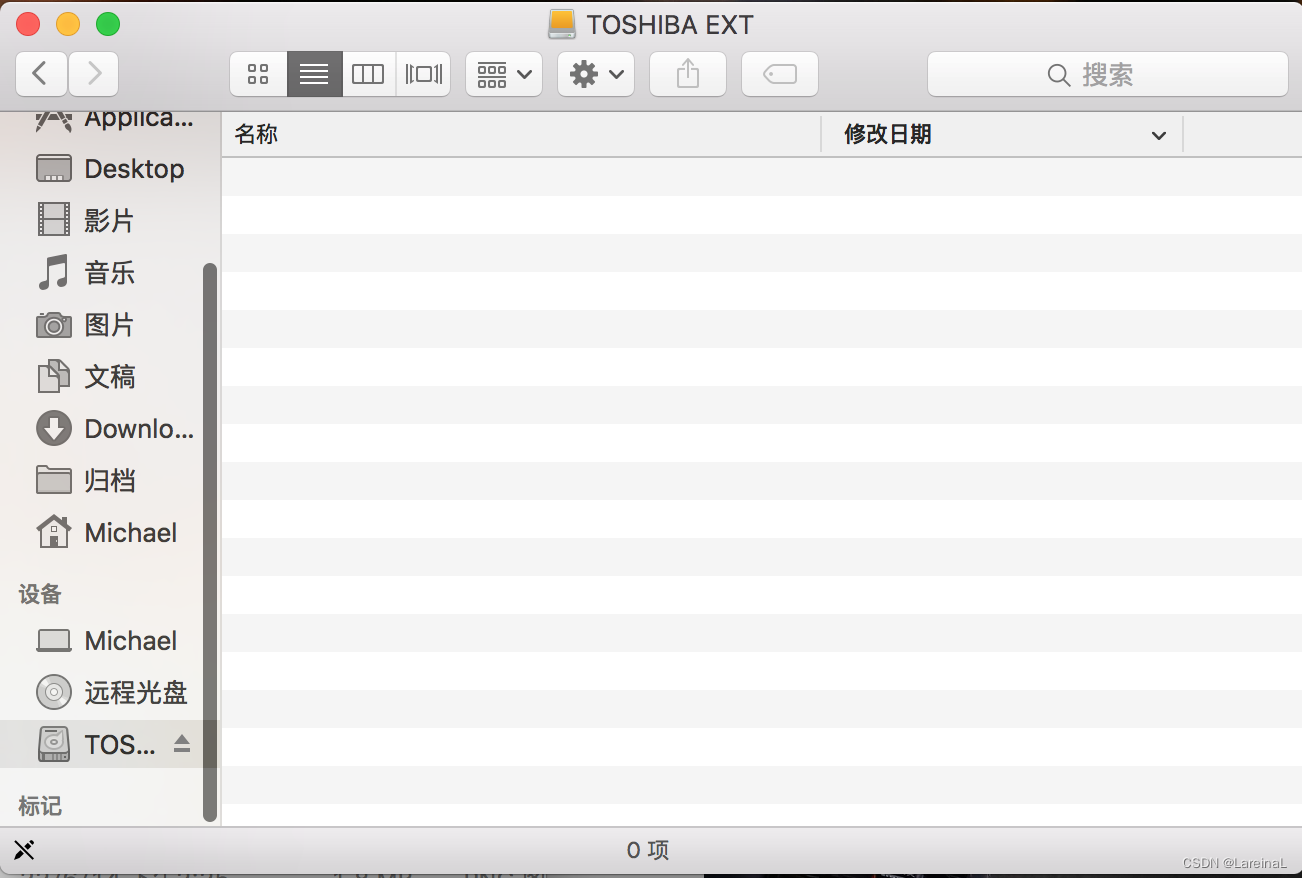

刚入手了一块新的移动硬盘,Mac电脑插上却发现一片空白无法使用,这是什么情况呢?

原来一般一块新的大容量移动硬盘刚入手时,默认是NTFS格式,这是Windows的一种特有硬盘格式,但是Mac上只能读取不能写入。

Mac和Windows上通用的格式是FAT系列,包括FAT16、FAT32、exFAT,FAT16单个文件最大为2G,FAT32单个文件最大为4G,考虑到目前的高清视频、安装包等动辄10G,因此要用exFAT格式。

无论Mac还是Windows都提供了硬盘格式化工具,这里介绍Mac系统如何操作:

提醒一下,如果是新盘不需要备份,如果里面有数据的话需要备份一下,格式化的话数据就都没有了。

选择磁盘工具→点击对应盘符→点击右上方【抹掉】→弹出对话框中的格式选择为exFAT→抹掉→完成。 *如果弹出对话框(是否迁移或是否备份),选择不使用。

首先,选择磁盘工具

硬盘连接到mac上,就会显示在左侧列表中。

NTFS格式在mac下只能读,不能写。为了在mac和Windows上通用,果断更改为exFAT吧。

接下来,点击选择对应盘符→点击右上方【抹掉】→ 弹出对话框中的格式选择为exFAT

→抹掉

*如果弹出对话框(是否迁移或是否备份),选择不使用。

→完成,格式化成功

这样新的移动硬盘就格式化成exFAT格式了,可以在Mac和Windows上通用使用了。

/) /)

ฅ(• - •)ฅ ~ ~ ฅ’ω’ฅ

本文指导如何在Mac上将新购的NTFS格式移动硬盘转换为exFAT,以便跨平台使用,包括格式化步骤和注意事项。

本文指导如何在Mac上将新购的NTFS格式移动硬盘转换为exFAT,以便跨平台使用,包括格式化步骤和注意事项。

1602

1602

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?