什么是ChatGPT?什么是GPT-4?Bard和PaLM又是什么?它们有什么关系?它们对我们有什么影响?

AI技术第一次这么密集地冲击着非从业者们,身处变革之中的我们或许会迷茫,但这本来就是工业革命之后的常态,我们要做的就是像九十年代学习计算机一样拥抱未来。

在ChatGPT刚出的时候,我对未来的知识创作是抱着悲观态度的。我认为个人创作者会被ChatGPT挤兑,或者直接投降借助ChatGPT来创作。久而久之,知识会陷入到封闭的循环当中,知乎也会沦为一个ChatGPT版公众号的聚集地,所以有一段时间我卸载了知乎。但是不久之后,我就发现自己这样的想法就和1900年的保皇派一样,看似是看清了变革的方向,实际却是裹足不前。

对于一个新事物,体系性的学习是理解和掌握它的必要途径,也是最便捷的方式。如果只是试图从公众号庞杂的文章中了解,无异于管中窥豹。

大模型是什么

首先,大模型这个词是建立在神经网络模型上的。

神经网络是一种在过去二十年得到广泛研究的人工智能方法,我们试图使用这样的模型模拟人类的思维和决策。神经网络的本质是在每个人工神经元(图1a的圆形)上设定一些可以调节的参数,并能够根据这些参数对输入到该神经元的数据进行加权求和 Σ 和非线性变换 𝑓 ,使其能够借助学习/优化算法实现从输入值 𝑥 到输出值 𝑦 的映射 𝑦=𝐹(𝑥)。

这个描述映射关系的函数 𝐹 是图1a中众多小 𝑓 们和加权求和函数叠加作用的结果,它在早些年(21世纪初)还是一门玄学,但是之后就有很多针对神经网络的可解释性工作,试图揭开这背后的隐秘。

图1 神经网络

这种映射关系的作用十分广泛,你可以用特定的数据(一些提前制作好的输入-输出对)作为它的训练数据,用学习算法来调节网络参数,使其实现类似于训练数据的映射关系。广义上来说,给它什么样的训练数据,就能通过神经网络建立什么样的映射关系。例如,

- 动物的图片 -- 动物的类别

- 中文 -- 对应的英文翻译

- 语音 -- 对应的文字内容

- 视频 -- 视频中的事件描述

- 机器人的视觉反馈 -- 机器人下一步的动作

听起来是十分美好的,仿佛我们可以借助神经网络构建万物之间的联系、帮助我们更好地理解世界。

但是这其实并不容易,映射关系建立的好与坏通常受到以下几种条件的影响:

- 模型架构

- 训练数据的数量

- 训练数据的质量

- 学习算法

- 计算硬件算力

训练数据的数量和质量在这二十年间已经得到了长足的发展,很多TB级别的数据集被开源出来作为模型的测试基准。这不得不感谢东南亚及印度的廉价数据标注工人,在资本温柔的剥削下,他们做着这个世纪最伟大的事情。

有了大量的数据以及英伟达一年翻一倍的硬件算力,学术界更聚焦在如何设计出一个美妙的模型架构。我们找到了很多好用的基础模型,也设计过很多眼花缭乱的网络架构,但最后发现还是大力出奇迹---好的基础模型的大量堆叠就能出现意想不到的效果。

图1b展示了一个大一点的神经网络,它会被叫做深度神经网络,但还不值得被称为大模型。

大模型的模型参数量达到了亿的级别,近期的研究成果基本在百亿到千亿的范围。当然这不会是终点,大模型的神经元数量和相关参数量必定会朝着远超人类大脑神经元数量的方向发展。这既体现了现有人工神经网络方法的低效性(当然是比不过地球亿万年的进化),也彰显着人类的雄心。

相信至此,你已经对大模型中的大和模型都有了一定的了解,那么我们就可以回答一开始的问题了。

- ChatGPT是美国著名AI研究所/公司---OpenAI的一款AI在线问答产品。之所以能够火出圈,是因为实在效果太震撼了。你可以以一种全新的、交互式的方式获取之前需要搜索引擎查找的信息。同时,这些信息是由模型生成出来的,也就意味着它们在这之前是并不完全地存在于互联网(以及人类知识库)中的。它基于的技术就是一种叫做 Generative Pre-trained Transformer (GPT, 生成式预训练Transformer) 的模型。以上面的方式简单来讲,ChatGPT以一种更加玄学的方式构建了你的问题和你可接受的答案之间的映射。

- 很明显,GPT-4就代表了GPT这种模型的第四版(更大地参数量、更多的模型优化)。

- Bard呢,是谷歌公司的竞品,也是在线问答,可以做表格也可以写文案,总体来说略逊于ChatGPT。它背后的技术也在不断地迭代,从LaMDA到最近刚发布的PaLM2。

大模型的优势

那么为什么模型越大,构建映射的能力就越强了呢?

尽管这看起来是很理所当然的事情,也可以从生物演化的角度来解释,但是总归是一种无法描述的玄学感。近期的一些工作将模型大的优势解释为大模型所带来的涌现能力和思维链构建能力。

涌现

涌现还确实是个生物演化的概念。它描述的是一种现象,即复杂系统具有某些组成它的小系统所不具备的特性。

这种现象在自然界比较常见,例如,水分子在构建成雪花时普遍呈现出的六角型状态,生物能够由基本粒子构成却具备高级生物功能的神奇现象,以及生物群体能够自发形成秩序社会的复杂行为。这些都暗示着大模型的成功背后具备着某种自然界的神秘力量,一种我们暂时还没有能力解析的混沌系统。但我相信,随着大模型的发展,这种解析并不遥远。

思维链

大模型涌现能力的直接结果就是能够构建出思维链,这是一种推理能力。

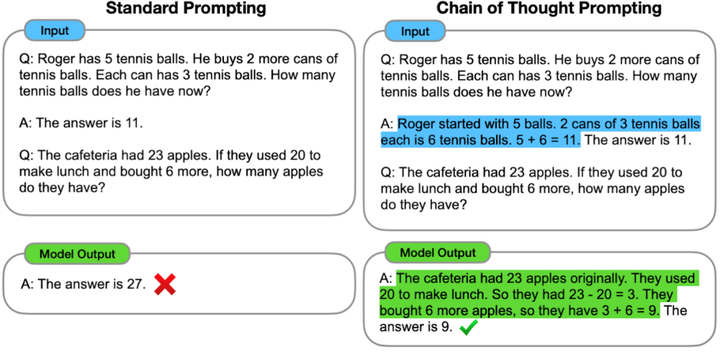

下图就是思维链这篇论文给出的例子

如果只是单纯的文本生成,大模型在简单的加减法上都会有很大的问题,因为这里隐含着逻辑推理的能力,并非单纯的文本。但是如果我们同时将问题的解题思路描述给大模型,就会得到有理有据的正确结论。

通过这样的方式训练的大模型,就具备了将一个问题拆解成许多子问题的能力,从而提升了答案的可靠性。这种能力将在机器人操作中大放异彩,会成为促进机器人应用落地的重要一环。我之后会专门就机器人大模型和决策大模型的研究现状与光明前景写一篇文章,感兴趣的小伙伴可以关注我的知乎哦。

参考文献

- Emergent Abilities of Large Language Models

- Chain-of-Thought Prompting Elicits Reasoning in Large Language Models

大语言模型(LLM)族谱

上文一直在使用大模型一词,实际上大模型已在短短四年间发展壮大成为一个人工智能的主流研究方向。大模型的发展最初是伴随着自然语言处理技术的不断发展的,这是由于文本数据的数据量更大且更容易获取。所以目前大模型最大的分类还是大语言模型,近两年衍生出一些语言与其他形式融合的大模型,例如,文字生成音乐(MusicLM)、文字生成图像(DALL-E2, Midjourney)、文字图像生成机器人动作(RT-1)等。

大模型包括但不限于以下几类:

- 大语言模型

- 视觉大模型

- 多模态大模型

- 决策大模型

- 机器人大模型

下图是我绘制的大语言模型从2019-2023的发展路径。

目前大多数的大语言模型都是建立在一个叫做 Transformer 的基础模型之上的(下一篇会介绍)。而根据使用的 Transformer 的方式不同,LLM的构建就被分为三条研究路径:编码器-解码器结构、只使用解码器、只使用编码器。绿色标注的是开源可用的模型,部分模型后有相应的参数量(以B--十亿为单位)。

大语言模型(实时更新)

上图在实时更新中。

参考文献

- Harnessing the Power of LLMs in Practice: A Survey on ChatGPT and Beyond

- Holistic Evaluation of Language Models

多模态大模型(MLM)族谱

绿色为开源模型。部分基础模型例如ViT和MAE等并非视觉语言模型,而是单纯的视觉模型,这里列出是出于其重要性的考虑。

如何与大模型共生

我们有一个无法摆脱的命运,那就是和技术共生。田园牧歌的生活只会逐渐成为奢望,我们在不断被迫接受着过量的信息和超出认知的技术革新,否则就会处于被革新的尴尬境地。那么大模型也一样,我们要寻求共生之道。我在这个回答中给出了一个理想主义的答案,即在大模型等技术的支撑下,我们能够从劳作中解脱出来,可以有更多的精力探寻人存在的价值。

但这终究是个过分理想的叙事角度,不难想象,在不久的将来,我们会在高频迭代的AI技术的逼促下,更辛苦地劳作以赶上时代的发展(毕竟我就在加班看大模型论文),或者彻底屈服于其下做一个便宜稳定的数据源。所以看起来,路子只有一条,了解它并学会使用它,就像学会使用电脑为我们创造价值一样。

现在还不晚,还来得及拥抱未来。

免费资料包

另外还有免费的AI大模型学习资料包,供你学习。点击下面的卡片就可以免费领,具体有:

👉AI大模型学习路线汇总👈

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

6057

6057

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?