本系列文章由 @yhl_leo 出品,转载请注明出处。

文章链接: http://blog.csdn.net/yhl_leo/article/details/51559490

在使用OpenCV以及其他开源库时,往往一个容易忽略的问题就是使用默认参数,尤其是图像处理,会导致内存中的图像数据变换后被不同程度上被修改!

下面给出几个示例,帮助理解。

1. warpAffine

warpAffine是图像仿射变换函数,函数定义为:

C++: void warpAffine(

InputArray src,

OutputArray dst,

InputArray M,

Size dsize,

int flags=INTER_LINEAR,

int borderMode=BORDER_CONSTANT,

const Scalar& borderValue=Scalar())其中,

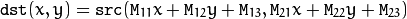

- M是一个2x3的转换矩阵,关于获取方法,可使用getRotationMatrix2D()函数:

flags是一个标识符,结合了内插方法(interpolation methods)和可选项WARP_INVERSE_MAPINTER_LINEAR- a bilinear interpolation (used by default)

本文探讨了OpenCV中图像处理函数的默认参数如何影响图像数据,特别是图像变换、读取和存储过程。默认使用双线性插值可能导致非预期效果,对于特定应用如二值图像旋转,最邻近插值可能更合适。同时,图像读取默认为3通道,存储图像的默认压缩设置可能影响质量和文件大小。建议根据实际需求调整参数。

本文探讨了OpenCV中图像处理函数的默认参数如何影响图像数据,特别是图像变换、读取和存储过程。默认使用双线性插值可能导致非预期效果,对于特定应用如二值图像旋转,最邻近插值可能更合适。同时,图像读取默认为3通道,存储图像的默认压缩设置可能影响质量和文件大小。建议根据实际需求调整参数。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

22万+

22万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?