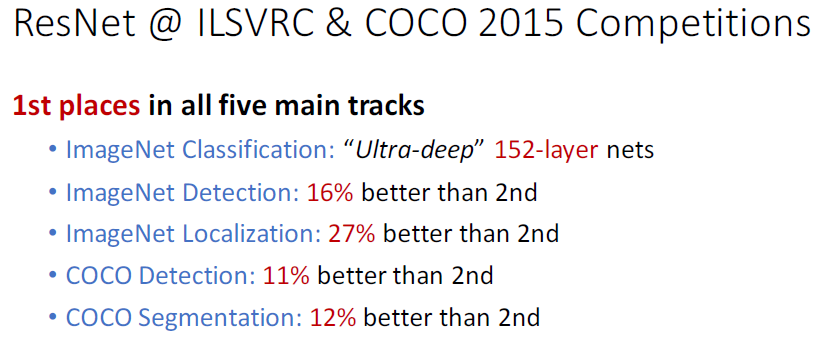

Kaiming 的ResNet在2015年横扫各大视觉主流比赛榜单,对工业界和学术界都产生了巨大而深远的影响,论文拿下了CVPR2016的best paper award。首先来看看ResNet的威力:

不仅拿了第一,还超过第二一大截。我们就来看看ResNet的神奇之处。

Is learning better networks as easy as stacking more layers

近些年来,有句口号叫“We need go deeper”,所以问题来了,“Is learning better networks as easy as stacking more layers?” ,当然不是,就单纯的go deeper并没有用,因为更深的网络意味着更多的参数,更大的计算量,需要更多的计算资源,还需要防止过拟合的风险,网络越深,越难训练。除此之外,有研究发现,随着网络深度的增加,准确率会趋于饱和,并且快快速下降,可能很多人会以为这是onverfitting,模型太复杂了,但是出人意料的是并不是这样,因为加深某些模型反而会增加训练误差&#

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1227

1227

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?