回归分析是数据挖掘中最基本的方法,其中基于普通最小二乘法的多元线性回归要求模型中的特征数据不能存在有多重共线性,否则模型的可信度将大打折扣。但是就是技术而言,如何确定模型中的各各特征之间是否有多重共线性呢?

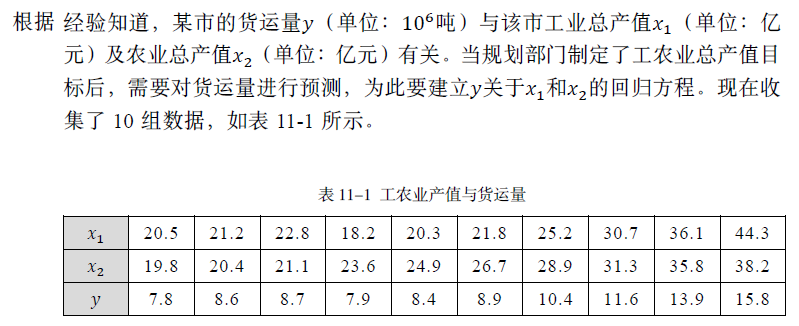

先来看一组数据

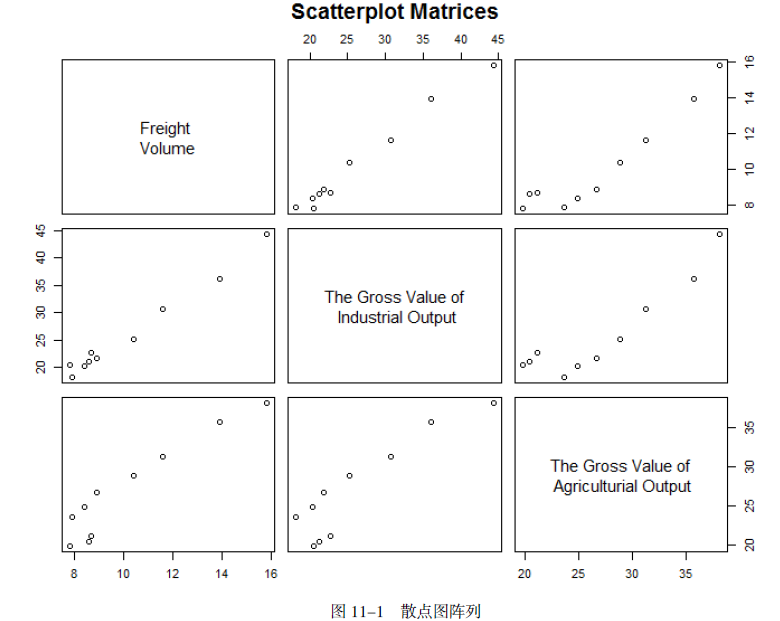

我们能否用这组数据来建立多元线性回归模型呢?现在这组数据的问题还不十分明显,我们不妨用最简单的交叉散点图来透视一下数据可能存在的问题。于是我们在R中绘制了下图:

从散点图中我们可以看出每个解释变量都与被解释变量有较明显的线性关系,而且这也是我们所希望看到的。但是两个解释变量之间似乎也呈现出了某种线性关系。事实上,如果计算两个解释变量之间的相关性系数,可知它们的线性相关系数高达 ,这也就意味着严重的多重共线性。在构建多元线性回归模型时,随着解释变量数目的增多,其中某两个解释变量之间产生多重共线性是很容易发生的情况。此时就需要考虑是否将其中某个变量从模型中剔除出去,甚至是重新考虑模型的构建。

但是这种视觉观察的方法仅仅能够作为定性研究的一种前导,最好能够有一种

订阅专栏 解锁全文

订阅专栏 解锁全文

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?