广义线性回归模型:

把

1.普通最小二乘法(Ordinary Least Squares)

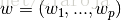

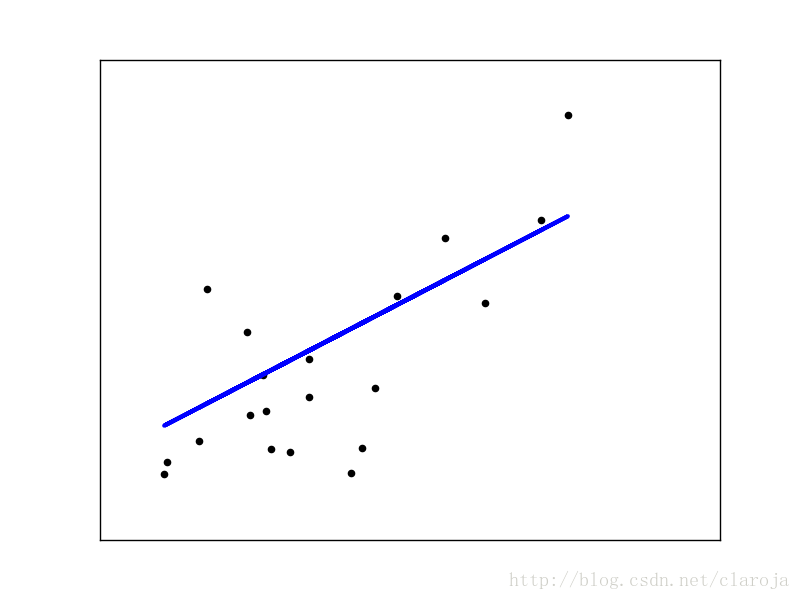

线性回归的目的就是是的预测值与实际值的残差平方和最小:

import matplotlib.pyplot as plt

import numpy as np

#载入数据集“datasets”

from sklearn import datasets, linear_model

#获取糖尿病的数据集

diabetes = datasets.load_diabetes()

#使用其中的一个特征,np.newaxis的作用是增加维度

diabetes_X = diabetes.data[:, np.newaxis, 2]

#将X变量数据集分割成训练集和测试集

diabetes_X_train = diabetes_X[:-20]

diabetes_X_test = diabetes_X[-20:]

#将Y目标变量分割成训练集和测试集

diabetes_y_train = diabetes.target[:-20]

diabetes_y_test = diabetes.target[-20:]

#创建线性回归对象

regr = linear_model.LinearRegression()

#使用训练数据来训练模型

regr.fit(diabetes_X_train, diabetes_y_train)

#查看相关系数

print('Coefficients: \n', regr.coef_)

#查看残差平方的均值(mean square error,MSE)

print("Residual sum of squares: %.2f"#%是格式化

% np.mean((regr.predict(diabetes_X_test) - diabetes_y_test) ** 2))

# Explained variance score: 1 is perfect prediction

# 解释方差得分(R^2),最好的得分是1:

# 系数R^2=1 - u/v, u是残差平方,u=(y_true - y_pred) ** 2).sum()

# v是离差平方和,v=(y_true - y_true.mean()) ** 2).sum()

print('Variance score: %.2f' % regr.score(diabetes_X_test, diabetes_y_test))

#画出测试的点

plt.scatter(diabetes_X_test, diabetes_y_test, color='black')

#画出预测的点

plt.plot(diabetes_X_test, regr.predict(diabetes_X_test), color='blue',

linewidth=3)

#删除X轴的标度

plt.xticks(())

#删除Y轴的标度

plt.yticks(())

plt.show()

普通最小二乘法计算复杂度

这种方法通过对X奇异值分解(singular value decomposition,SVD)来计算最小二乘的解,如果X是(n,p)的矩阵(n大于p),则代价为

http://sklearn.lzjqsdd.com/auto_examples/linear_model/plot_ols.html#example-linear-model-plot-ols-py

1084

1084

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?