这篇博客里,我们来介绍混合高斯模型和EM算法,也标志着进入到无监督学习新的篇章。EM算法会在混合模型里有应用。(其实之前还有一个k-means算法,但是这个算法比较简单,就不在博客里介绍了)

我们首先来介绍 EM算法的推导,然后介绍在混合高斯模型中的应用。

EM算法

EM算法大概的思路就是,对于没有标注的数据,我们会假设一个数据,然后通过不断地迭代,让我们假设的数据不断地趋近于正确的值。是不是听起来很像k-means算法呢?

我们在EM算法里,要关注的是他是怎么迭代的,以及如何保证他是收敛的

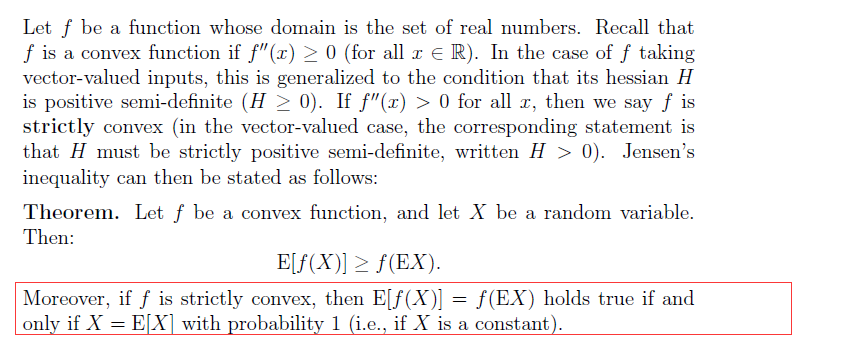

之所以能有EM算法,他的一大理论基础是 Jensen’s inequality詹森不等式

现在介绍这个詹森不等式

注意红框里的内容,这个是我们后面要应用的重点。

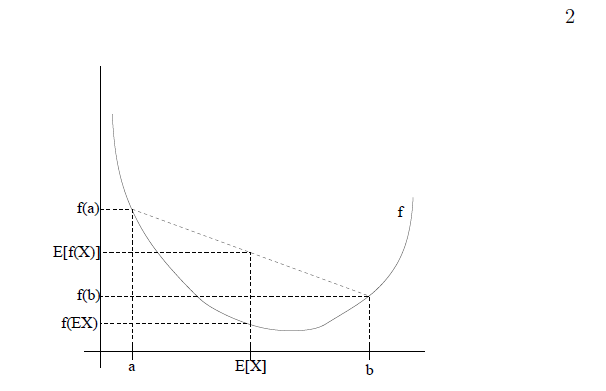

借助于下面的图来加强理解吧,没有可多讲的

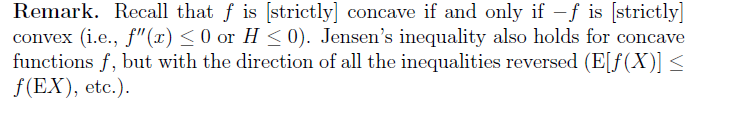

也就是说,如果我们的图形是一个凸函数(相对于上面的举例,往相反方向弯被),那我们的不等式要调过来,好理解吧!

有了这个理论基础之后,开始我们的EM算法

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3729

3729

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?