1. 简介

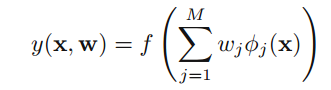

逻辑回归和Softmax回归是两个基础的分类模型,虽然听名字以为是回归模型,但实际我觉得他们也有一定的关系。逻辑回归,Softmax回归以及线性回归都是基于线性模型,它们固定的非线性的基函数(basis function)

其中,如果f(.)是非线性的激活函数(activation function),这就是一个分类模型;如果f(.)是恒等函数(identity),则是回归模型,现在可以发现它们三者的联系了吧。

下面主要谈谈逻辑回归,Softmax回归,前者主要处理二分类问题,而后者处理多分类问题,但事实上Softmax回归就是逻辑回归的一般形式。

2. 逻辑回归

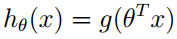

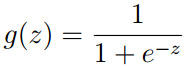

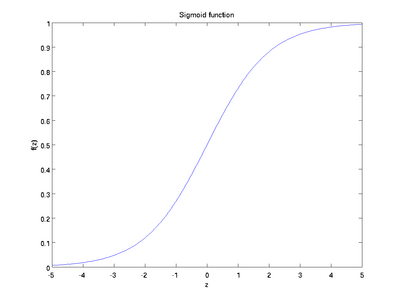

定义逻辑回归hypothesis为

其中,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1646

1646

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?