【机器学习算法实现】系列文章将记录个人阅读机器学习论文、书籍过程中所碰到的算法,每篇文章描述一个具体的算法、算法的编程实现、算法的具体应用实例。争取每个算法都用多种语言编程实现。所有代码共享至github:https://github.com/wepe/MachineLearning-Demo 欢迎交流指正!

(1)kNN算法_手写识别实例——基于Python和NumPy函数库

1、kNN算法简介

kNN算法,即K最近邻(k-NearestNeighbor)分类算法,是最简单的机器学习算法之一,算法思想很简单:从训练样本集中选择k个与测试样本“距离”最近的样本,这k个样本中出现频率最高的类别即作为测试样本的类别。下面的简介选自wiki百科:http://zh.wikipedia.org/wiki/%E6%9C%80%E8%BF%91%E9%84%B0%E5%B1%85%E6%B3%95

方法

- 目标:分类未知类别案例。

- 输入:待分类未知类别案例项目。已知类别案例集合D ,其中包含 j个已知类别的案例。

- 输出:项目可能的类别。

步骤

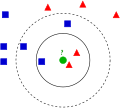

如下图

我们考虑样本为二维的情况下,利用knn方法进行二分类的问题。图中三角形和方形是已知类别的样本点,这里我们假设三角形为正类,方形为负类。图中圆形点是未知类别的数据,我们要利用这些已知类别的样本对它进行分类。

分类过程如下:

1 首先我们事先定下k值(就是指k近邻方法的k的大小,代表对于一个待分类的数据点,我们要寻找几个它的邻居)。这边为了说明问题,我们取两个k值,分别为3和5;

2 根据事先确定的距离度量公式(如:欧氏距离),得出待分类数据点和所有已知类别的样本点中,距离最近的k个样本。

3 统计这k个样本点中,各个类别的数量。如上图,如果我们选定k值为3,则正类样本(三角形)有2个,负类样本(方形)有1个,那么我们就把这个圆形数据点定为正类;而如果我们选择k值为5,则正类样本(三角形)有2个,负类样本(方形)有3个,那么我们这个数据点定为负类。即,根据k个样本中,数量最多的样本是什么类别,我们就把这

本文介绍了kNN算法的基础知识,并通过Python和NumPy库实现了手写识别的实例。详细讲解了kNN算法的步骤,探讨了其优缺点,以及k值选择的影响。同时,展示了使用NumPy的shape、tile、sum、argsort等函数进行数据处理的方法。

本文介绍了kNN算法的基础知识,并通过Python和NumPy库实现了手写识别的实例。详细讲解了kNN算法的步骤,探讨了其优缺点,以及k值选择的影响。同时,展示了使用NumPy的shape、tile、sum、argsort等函数进行数据处理的方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

893

893

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?