课程概述:

1.偏差/方差(Bias/variance)

2.经验风险最小化(Empirical Risk Minization,ERM)

3.联合界引理与Hoeffding不等式

4.一致收敛(Uniform Convergence)

一、偏差/方差

偏差与方差对应的仍然是过拟合与欠拟合的问题,本篇主要解决的问题就在于构建一个模型,对何时出现过拟合和欠拟合进行说明。

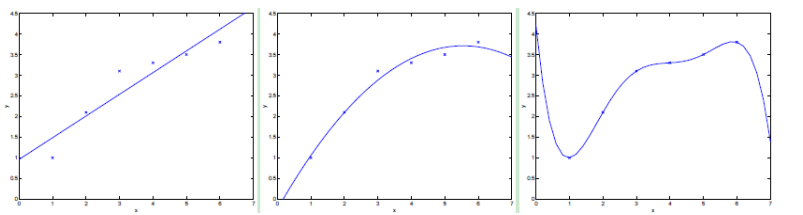

关于过拟合与欠拟合的问题,前面已经讲过,这里在稍微说一下,如下图:

上图中,左图为欠拟合,即没有很好的拟合所有的数据,有很大的泛化误差,这种情况对应于高偏差;

中间的图为较好的拟合;

右图为过拟合,即对实验数据集合的太好,这样当换一组数据时就可能有较大的误差,即不具有一般性,这种情况对应于高方差。

简而言之,欠拟合对应了高偏差,过拟合对应高方差。

二、经验风险最小化(Experience Risk Minimization,ERM)

首先,我们定义数据集:

其中

其次,分类模型为:

由定义可知,

这个模型和logi

本文详细介绍了斯坦福大学公开课机器学习课程中的经验风险最小化(ERM)概念,包括偏差/方差分析,ERM的定义及其与logistic回归、SVM的关系。此外,还探讨了一致收敛定理,利用联合界引理和Hoeffding不等式,揭示了样本数量、泛化误差和训练误差之间的关系,以及如何通过ERM找到偏差与方差的平衡点。

本文详细介绍了斯坦福大学公开课机器学习课程中的经验风险最小化(ERM)概念,包括偏差/方差分析,ERM的定义及其与logistic回归、SVM的关系。此外,还探讨了一致收敛定理,利用联合界引理和Hoeffding不等式,揭示了样本数量、泛化误差和训练误差之间的关系,以及如何通过ERM找到偏差与方差的平衡点。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

839

839

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?