一、前期准备

Andriod studio 4.2

linux系统

python3.8

安装paddlepaddle, 开始使用_飞桨-源于产业实践的开源深度学习平台下载对应版本

创建一个虚拟环境

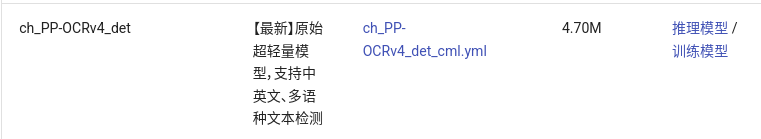

下载推理模型

二、转化步骤

1.打开andriod studio new->project->Empty Activity 激活虚拟环境

2.下载Paddle Lite Demo

git clone https://github.com/PaddlePaddle/Paddle-Lite-Demo.git

3.File->New->Import Project 打开Paddle-Lite-Demo\object_detection\android\app\cxx\ssd_mobilenetv1_detection_demo 点击运行

![]()

这一步时间会有点长,等一等,直到出现这两个文件

4.访问Android Demo官方页面,选择PaddleLite版本(我用的是v2.10)

git clone -b release/v2.10 https://github.com/PaddlePaddle/Paddle-Lite.git

5.接下来就可以转换了

编译转换工具:

cd Paddle-Lite

./lite/tools/build.sh build_optimize_tool

新建目录

mkdir -p /你的目录/Paddle-Lite/ch_PP-OCRv4_det_infer/nbmodel/

执行转换

cd build.opt/lite/api/

./opt \

--model_file=/你的路径/nbmodel/inference.pdmodel \

--param_file=/你的路径/nbmodel/inference.pdiparams \

--optimize_out=/你的路径/nbmodel/name \

--valid_targets=arm \

--optimize_out_type=naive_buffer

至此转换完成

734

734

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?