目录

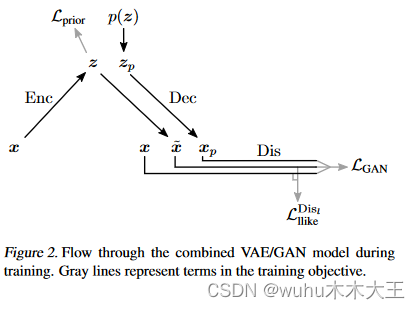

2.3.3基于p ( z )和q ( z | x )中的样本进行判别

摘要

我们提出了一种自动编码器,它利用学习到的表示来更好地度量数据空间中的相似性。通过将变分自编码器( Variational Autoencoder,VAE )与生成对抗网络( Generative Adversarial Network,GAN )相结合,我们可以利用GAN判别器中学习到的特征表示作为VAE重建目标的基础。因此,我们将元素级错误替换为特征级错误,以更好地捕捉数据分布,同时提供对翻译等的不变性。我们将我们的方法应用于人脸图像,并表明它在视觉保真度方面优于基于元素相似性度量的VAEs。此外,我们证明了该方法学习到了一个嵌入,其中的高层抽象视觉特征(例如戴眼镜)可以使用简单的算术进行修改。

github.com/andersbll/autoencoding_beyond_pixels

1.引言

深度架构已经允许广泛的判别模型扩展到大型和多样化的数据集。然而,生成式模型仍然存在图像、声音等复杂数据分布的问题。在这项工作中,我们表明目前使用的相似性度量为学习好的生成模型带来了障碍,并且我们可以通过使用学习到的相似性度量来改进生成模型。

在学习变分自编码器( Kingma &韦林, 2014 ;雷森德et al , 2014)等模型时,相似性度量的选择至关重要,因为它通过重构误差目标提供了训练信号的主要部分。对于这个任务,默认的是像平方误差这样的元素级度量。基于元素的度量方法虽然简单,但并不十分适合图像数据,因为它们没有对人类视觉感知的特性进行建模。例如,一个小的图像平移可能会导致一个大的像素误差,而人类几乎不会注意到这种变化。因此,我们主张使用图像的更高层次和足够不变的表示来衡量图像的相似性。我们希望为任务学习一个函数,而不是手工设计一个合适的度量来适应元素度量的问题。问题是如何学习这样的相似性度量?我们发现,通过联合训练一个VAE和一个生成对抗网络(古德费洛等, 2014),我们可以使用GAN判别器来度量样本相似度。我们通过将VAE与GAN结合来实现,如图1所示。通过让VAE解码器和GAN生成器共享参数并进行联合训练,将两者合二为一。对于VAE训练目标,我们将典型的基于元素的重构度量替换为在判别器中表示的基于特征的度量。

1.1贡献

1.我们将VAEs和GANs结合到一个无监督的生成模型中,该模型同时学习编码、生成和比较数据集样本。·

2.我们证明了使用学习的相似性度量训练的生成模型比使用元素误差度量训练的模型产生更好的图像样本。·

3.我们证明了无监督的训练结果产生了具有非纠缠变化因子( Bengio等, 2013)的潜在图像表示。在用视觉属性向量标记的人脸图像数据集上的实验说明了这一点,其中表明在学习的潜在空间中应用简单的算法产生反映这些属性变化的图像。

2.利用学习到的相似度进行自编码

在这一部分我们提供了VAEs和GANs的背景知识。然后,我们介绍了我们将这两种方法结合起来的方法,我们称之为VAE / GAN,正如我们将要描述的那样,我们提出的混合方法是为了改进VAE,所以它依赖于一个更有意义的、特征化的度量来衡量训练过程中的重建质量。

2.1变分自编码器

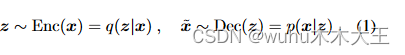

一个VAE由两个网络组成,分别将数据样本x编码为潜在表示z,并将潜在表示解码回数据空间:

VAE通过对潜在分布p ( z )施加先验来正则化编码器。典型地选择z∈N ( 0 , I)。VAE损失为减去期望对数似然(重构误差)和一个先验正则项之和:

2.2生成对抗网络

一个GAN由两个网络组成:生成器网络Gen ( z )将隐变量z映射到数据空间,判别器网络分配概率y = Dis(x) ∈ [0, 1],X是一个实际的训练样本,概率1 - y表示x通过模型x = Gen ( z )生成,其中z~p ( z )。GAN的目标是找到一个二分类器,在真实数据和生成数据之间提供尽可能好的区分,同时鼓励Gen拟合真实数据分布。因此,我们的目标是最大化/最小化二元交叉熵:

Dis / Gen,x为训练样本,其中z~p ( z )。

2.3超越了VAE / GAN的元素级重建误差

GAN的一个吸引人的特性是其判别器网络隐含地需要学习一个丰富的图像相似度度量,从而将其与"非意象化"区分开来。因此,我们提出利用这个观测来将判别器学习到的图像的属性转换为更抽象的VAE重建误差。最终结果将是一种结合了GAN作为高质量生成模型和VAE作为将数据编码器生成到潜在空间z的优势的方法。

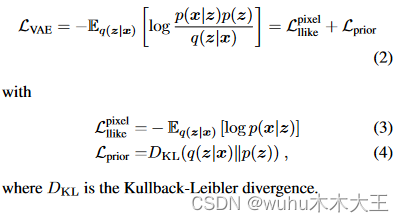

具体来说,由于对图像和其他具有不变性的信号而言,基于元素的重建误差是不够的,因此我们提出用GAN判别器表示的重建误差从公式3中替换VAE重建(期望对数似然值)误差项。为此,令Disl ( x )表示判别器第l层的隐藏表示。我们引入了具有均值Disl ( ' x )和单位协方差的Disl ( x )的高斯观测模型:

其中' x∈Dec ( z )是x的解码器中的样本。现在可以代替式( 1 )的VAE误差。式3同式7。我们用式8三重准则来训练我们的组合模型

值得注意的是,我们优化了VAE wrt。我们将LGAN视为一种风格误差,而重构误差可以用Gatys等( 2015 )的术语解释为内容误差。此外,由于Dec和Gen都是从z到x的映射,因此我们共享了两个(换句话说,我们在式5 中用Dec代替Gen)之间的参数。

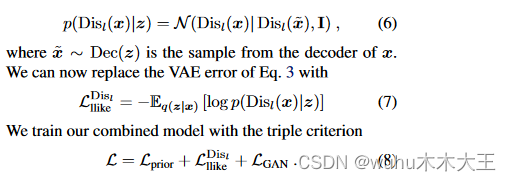

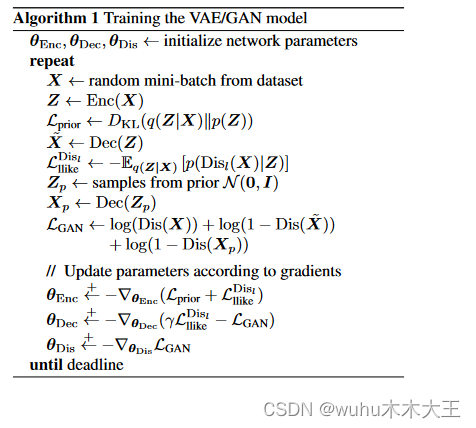

在实践中,我们在该模型的开发和训练过程中,对细节进行了观察。因此,我们在这一部分提供了一个实际考虑的清单。我们参考图2和Alg .①培训过程概述。

见图2。在训练过程中流经组合的VAE / GAN模型。灰线代表训练目标中的术语。

算法1:ΘEnc,θDec,θDis←初始化网络参数

重复:X←从数据集随机小批……

按照梯度Update参数

直到衰减

2.3.1将误差信号限制在相关网络中

利用方程8中的损失函数时,同时训练一个VAE和一个GAN。这是可能的,因为我们没有更新所有的网络参数,即组合损失。特别地,Dis不应该试图最小化LDisl llike,因为这样会使判别器崩溃到0。我们还观察到通过不将误差信号从LGAN反向传播到Enc可以得到更好的结果。

2.3.2比较Vae vs GAN

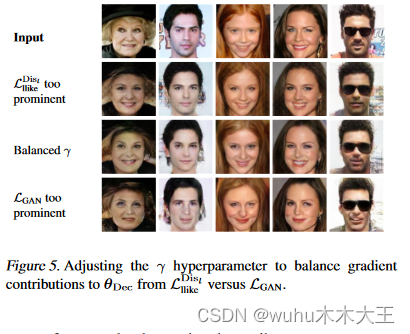

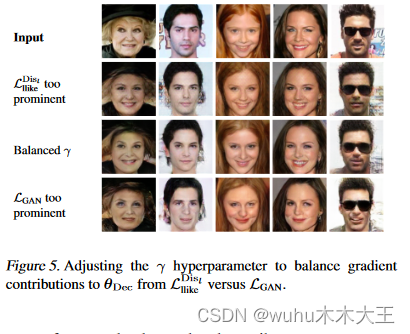

当Dec接收到来自LDisl llike和LGAN的误差信号时,我们使用一个参数γ来衡量重构和欺骗判别器的能力。这也可以解释为加权风格和内容。与将γ应用于整个模型(式( 8 ) )不同,我们只在更新Dec的参数时进行加权:

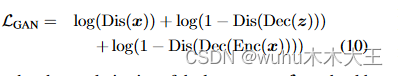

2.3.3基于p ( z )和q ( z | x )中的样本进行判别

在GAN目标中,除了我们的先验p ( z )样本外,使用q ( z | x ) (即编码器Enc)样本也可以得到更好的结果:

注意,隐空间Lprior的正则化应该使得来自p ( z )或q ( z | x )的样本集相似。然而,对于任意给定的样本x,negative负样本Dec ( Enc ( x ) )与x相似的可能性比Dec ( z )大得多。当根据LGAN进行更新时,我们猜测具有相似的正负样本会产生更有用的学习信号。

3.相关工作

众所周知,对于像图像这样的复杂数据分布,基于元素的距离度量是不够的。在计算机视觉领域,对图像进行预处理是一项重要的流行的解决方案,以提高对某些扰动的鲁棒性。预处理的例子是对比度归一化,处理梯度图像或直方图中聚集的像素统计。我们将这些操作作为度量工程的一种形式来考虑简单的元素距离度量的缺点。Wang & Bovik ( 2009 )对该问题进行了较为详细的讨论。

神经网络已经以Siamese架构(布罗姆利等, 1993 ; Chopra等, 2005)的形式应用于度量学习。学习到的距离度量在相似样本中最小化,在不相似样本中使用最大间隔代价最大化。然而,由于Siamese网络是在有监督的情况下训练的,我们无法直接将其应用于我们的问题。

在过去的一年中,已经提出了一些改进生成式模型中元素间距离的尝试。里奇韦等人( 2015 )将结构相似性指标应用于灰度图像的自编码器( Autoencoder,AE )重建度量。Yan et al ( 2015 )让一个VAE输出两个额外的图像来更明确地学习形状和边缘结构。Mansimov等人( 2015 )在他们的生成式模型中增加了一个基于GAN的锐化步骤。马蒂厄等人( 2015 )通过GAN和基于图像梯度的相似性度量补充了平方误差度量,以提高视频预测的图像清晰度。虽然所有这些扩展都能产生明显的清晰图像,但与深度学习方法相比,它们在捕获高级结构方面没有相同的潜力。

与AE直接建模数据集样本与潜在表示之间的关系不同,GAN学习间接生成样本。通过优化GAN生成器根据GAN判别器产生模仿数据集的样本,GAN通过构造避免了逐元的相似性度量。这可能是Denton等( 2015 )证明他们能够产生高质量图像的原因;雷德福et al . ( 2015 )。

最近,具有上采样的卷积网络已经显示出从潜在表示生成图像的有用性。这引起了人们对学习图像嵌入的兴趣,其中语义关系可以用简单的算术表示- -类似于Mikolov等人( 2013 )的word2vec模型的出人意料的结果。首先,Dosovitskiy等人( 2015 )使用监督训练来训练卷积网络,以生成给定所需椅子的高层信息的椅子。之后,库尔卡尼et al . ( 2015 );Yan et al . ( 2015 );Reed等人( 2015 )已经证明了具有解耦特征表示的编码器-解码器结构,但它们的训练方案依赖于监督信息。雷德福等人( 2015 )在训练后检查GAN的潜在空间,并找到与眼镜和微笑相对应的方向。然而,由于它们依赖于纯粹的GANs,它们无法编码图像,使得探索潜在空间具有挑战性。

我们学习到的相似性度量的思想部分源于Gatys等人( 2015 )的神经艺术风格网络,他们证明了深度卷积特征的表达能力。他们通过在预训练的卷积网络中优化图像,使其具有与主题图像相似的特征和与风格图像相似的特征相关性,从而获得了令人印象深刻的结果。在我们的VAE / GAN模型中,可以将LDisl llike视为内容,LGAN视为风格。然而,我们的风格项不是从特征相关性计算的,而是来自于错误信号。

4.实验

衡量生成模型的质量是具有挑战性的,因为目前的评估方法对于较大的自然图像( Theis et al , 2015)存在问题。在这项工作中,我们使用大小为64x64的图像,并专注于更多的定性评估,因为传统的对数似然度量没有捕获视觉保真度。事实上,我们已经尝试在训练完VAE / GAN模型并使用剩余的VAE计算基于像素的对数似然后,舍弃GAN判别器。该结果与普通的VAE模型(在CIFAR - 10数据集上)相比,还远没有竞争力。为了验证基于特征的相似性度量的思想,我们在CIFAR - 10上训练了一个GAN。训练完成后,我们通过在GAN判别器中向上传播图像来计算CIFAR - 10的特征表示。然后我们测量了k = 5的最近邻分类性能。使用基于特征的度量将误差从基于像素的误差66.02 %减小为33.73 %。

在这一部分中,我们研究了不同生成模型的性能:

1.基于逐元素高斯观测模型的VAE。

2.基于学习距离的VAE ( VAEDisl )。我们首先训练一个GAN,并使用判别器网络作为学习到的相似性度量。我们选择一个单层l,根据Disl进行相似性度量。选择l,使得比较是在3个卷积层和步长为2的下采样之后进行的。

3.VAE / GAN组合模型。该模型与VAEDisl类似,但我们也对Dec wrt LGAN进行了优化。人们可能怀疑从噪声初始化同时训练VAE和GAN是有问题的,因为Disl表示开始是数据的随机投影。然而,我们在这方面没有观察到不稳定性。

4.另一种VAE / GANDis0模型,其中VAE重建误差在像素空间中测量,LDis0llike = Lpixelllike。该模型旨在证实使用基于特征的相似性是有好处的,并且GAN不是单方面负责生成更自然的图像。·

5.A GAN。这种模式最近被证明能够生成高质量的图像(雷德福等, 2015)。”

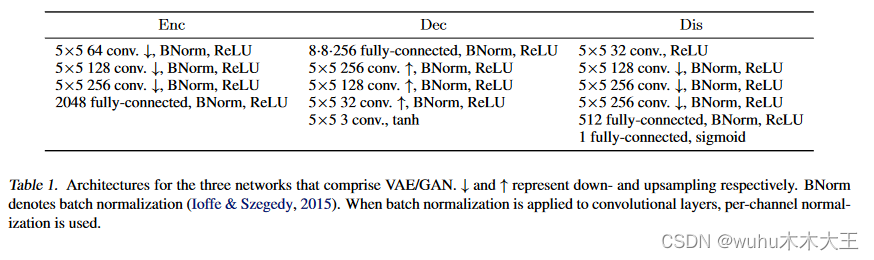

所有模型对Enc、Dec和Dis分别共享相同的体系结构。对于我们所有的实验,我们使用卷积架构,并在Dec使用向后卷积( aka .小数阶)与步长2来提升图像的尺度。后向卷积是通过翻转卷积方向来实现的,这样跨步会导致上采样。我们的模型使用RMSprop算法进行训练,学习率为0.0003,批次大小为64。在表1中我们列出了网络架构。我们参考我们的在线实现github。

表1:组成VAE / GAN三个网络的结构。↓和↑分别代表下采样和上采样。BNorm表示批量归一化( Ioffe &塞盖迪, 2015)。当批量归一化应用于卷积层时,使用逐通道归一化。

4.1CelebA 人脸数据集

我们将我们的方法应用于来自Celeb A数据集 ( Liu et al . , 2015)的人脸图像。该数据集由202,599张图像组成,标注了眼镜、刘海、苍白的皮肤等40个二值属性。我们将图像缩放和裁剪为64 × 64像素,只使用图像(而不是属性)进行无监督训练。

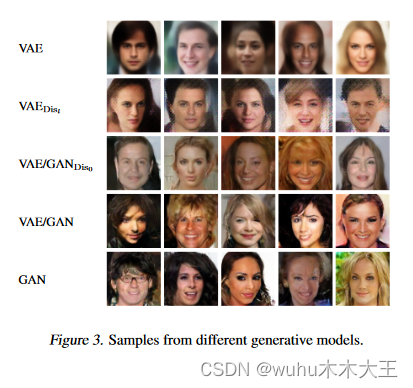

训练结束后,我们从p ( z )中抽取样本并进行传播,这些通过Dec生成新的图像,如图3所示。普通的VAE能够清晰地描绘出人脸的正面部分,但是离中心点较远的图像会变得模糊。这是因为该数据集使用正面地标对齐人脸。当我们移动距离对齐的部分太远时,由于无法假设像素对应关系,识别模型就会崩溃。由于VAEDisl将重建误差提升到像素级以上,即使在离中心点处也能获得更清晰的图像。然而,我们看到了严重的噪声伪影,我们认为这是由于Dis的严苛的下采样方案造成的。相比较而言,VAE / GANDis0、VAE / GAN和pure GAN生成的图像更清晰,具有更自然的纹理和人脸部位。

接下来,我们让VAEs重建来自单独测试集的图像。由于GAN模型缺乏编码器网络,因此无法进行重建。结果如图4所示,我们的结论与我们对随机样本的观察结果类似。然而,值得注意的是,VAE / GANDis0不能捕获与基于特征相似性的VAE / GAN相同的细节层次。此外,图5显示了γ超参数的影响,该参数平衡了LDisl llike和LGAN对θ Dec的梯度贡献。我们在两者之间寻求一种折中。如果LDisl llike过于突出,我们会从基于特征的重建中看到伪影。如果LGAN过于突出,我们会在重建中放松细节,例如嘴巴形状。

4.1.1视觉属性向量

受到使用简单算法(米科洛夫等, 2013)表达语义概念的嵌入学习尝试的启发,我们考察了训练好的VAE / GAN模型的潜在空间。其思想是在图像空间中寻找与特定视觉特征对应的潜在空间中的方向。

我们使用数据集的二进制属性来提取视觉属性向量。对于所有图像,我们使用编码器来计算潜在向量表示。对于每个属性,我们计算有属性图像的均值向量和没有属性图像的均值向量。然后,我们计算视觉属性向量作为两个均值向量之间的差值。这是一种非常简单的计算视觉属性向量的方法,这将会存在与高度相关的视觉属性的问题,例如化妆和佩戴口红。在图6中,我们展示了人脸图像以及在潜在表示中加入不同视觉属性向量后的重建结果。虽然,不完美的是,我们清楚地看到属性向量捕获了眼镜、刘海等语义概念。例如,当在人脸中添加刘海bangs时,头发颜色和头发纹理都与原始人脸相匹配。我们还看到,做一个男人与拥有一个胡子mustache是高度相关的,这是由数据集中的属性相关性引起的。相比较而言,普通VAE以同样的方式学习的视觉概念要少得多,见图7。

4.2属性相似度,野外标注面孔

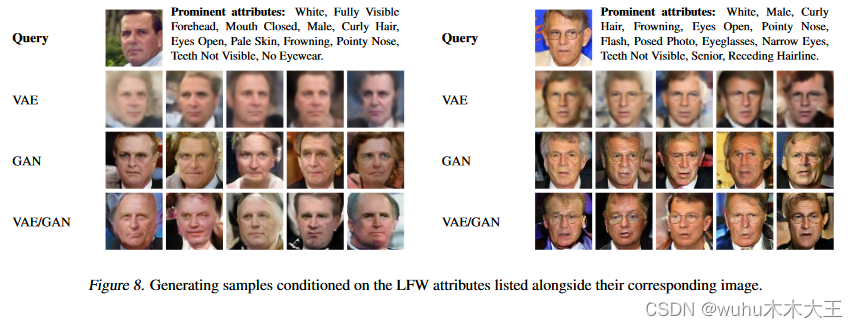

受Yan等人( 2015 )的属性相似性实验的启发,我们寻求对我们生成的图像进行更量化的评价。其思想是学习一个以人脸属性为条件的人脸图像生成模型。在测试时,我们通过从选择的属性配置中检索生成人脸图像,并让一个单独训练的回归器网络从生成的图像中预测属性。一个好的生成模型应该能够产生被回归模型正确识别的视觉属性。为了模拟原始实验,我们使用带有属性( Kumar et al , 2009)的LFW ( Labeled Faces in the Wild )图像。我们根据( Zhu et al , 2014)中的特征点对人脸图像进行对齐。此外,我们将图像裁剪并调整大小为64 × 64像素,并使用常见操作对数据集进行扩充。再次,我们参考了我们的在线实现,以获得更多的细节。

我们通过将属性向量串接到与( Mirza & Osindero , 2014)相似的Enc,Dec和Dis中输入的向量表示中,构建了条件VAE,GAN和VAE / GAN模型。对于Enc和Dis,将属性向量串接到顶层全连接层的输入。我们的回归网络具有与Enc几乎相同的架构。我们使用LFW训练集进行训练,在测试过程中,我们对测试集属性和样本人脸进行条件约束,通过回归网络进行传播。图8显示了通过对测试集的属性向量进行条件生成的人脸。我们报告了回归结果数见表2。与普通的VAE相比,VAE / GAN模型在视觉上产生了更好的属性,从而导致了更小的识别误差。GAN网络的表现非常差,我们猜测这是由训练( GAN模型由于采用极小极大目标函数,很难进行可靠训练)时的不稳定造成的。值得注意的是,我们的结果与Yan et al ( 2015 )的结果不具有直接可比性,因为我们无法获得他们的预处理方案和回归模型。

4.3针对有监督任务的无监督预训练

为了完整起见,我们报告了我们尝试在半监督的设置中评估VAE / GAN,通过无监督预训练,然后使用少量有标签的例子(对于CIFAR - 10和STL - 10数据集)进行微调。不幸的是,我们没有能够达到与最先进的( Rasmus et al , 2015 ; Zhao et al . , 2015)相媲美的结果。我们推测,对于VAE - GAN模型来说,类内差异可能太大,以至于无法学习到不同对象类的良好泛化。

5.讨论

元素距离度量的问题在文献中是众所周知的,并且已经进行了许多超越像素的尝试- -通常使用手工设计的度量。在深度学习的精神中,我们认为相似性度量仍然是另一个组成部分,它可以被能够捕获与数据分布相关的高级结构的学习模型所取代。在这项工作中,我们的主要贡献是学习和应用这种距离度量的无监督方案。通过学习到的距离度量,我们可以训练一个图像编码器-解码器网络,生成前所未有的视觉保真度的图像,如我们的实验所示。此外,我们表明我们的网络能够在输入数据分布中解开变化因素,并在潜在空间的高层表示中发现视觉属性。原则上,这使得我们可以使用一个很大的集合对未标记的图像进行训练,并使用少量的标记图像来发现潜在空间中的特征。

我们将我们的方法视为VAE框架的扩展。虽然,必须指出的是,我们生成的高质量图像是由于Dec作为了VAE解码器和GAN生成器的联合训练。这使得我们的方法更多的是VAE和GAN之间的混合,或者可以将我们的方法看作是GAN的扩展。

不明显的是,GAN的判别器网络提供了有用的相似性度量,因为它是为不同的任务训练的,即能够从真实样本中区分生成样本。然而,卷积特征对于迁移学习来说往往是出乎意料的好,正如我们所展示的,在我们的案例中足够好,可以提高图像的逐元的距离。有趣的是,如果距离度量中更好的特征可以改善模型,例如,通过使用在人脸上训练的Siamese网络提供的相似性度量,尽管在实际中Siamese网络并不适合我们的方法,因为它们需要有标记的数据。或者,人们可以研究使用预训练的前馈网络来测量相似性的效果。

总之,我们首次尝试了编码器-解码器模型的无监督学习以及相似性度量。我们的结果表明,我们的方法的视觉保真度与GAN具有竞争力,在这方面被认为是最先进的。因此,我们认为学习的相似性度量是将生成模型扩展到更复杂数据分布的一个有前途的步骤。

433

433

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?