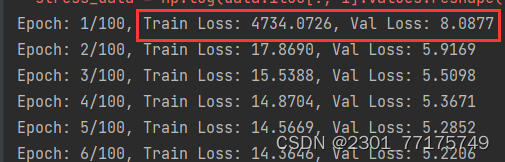

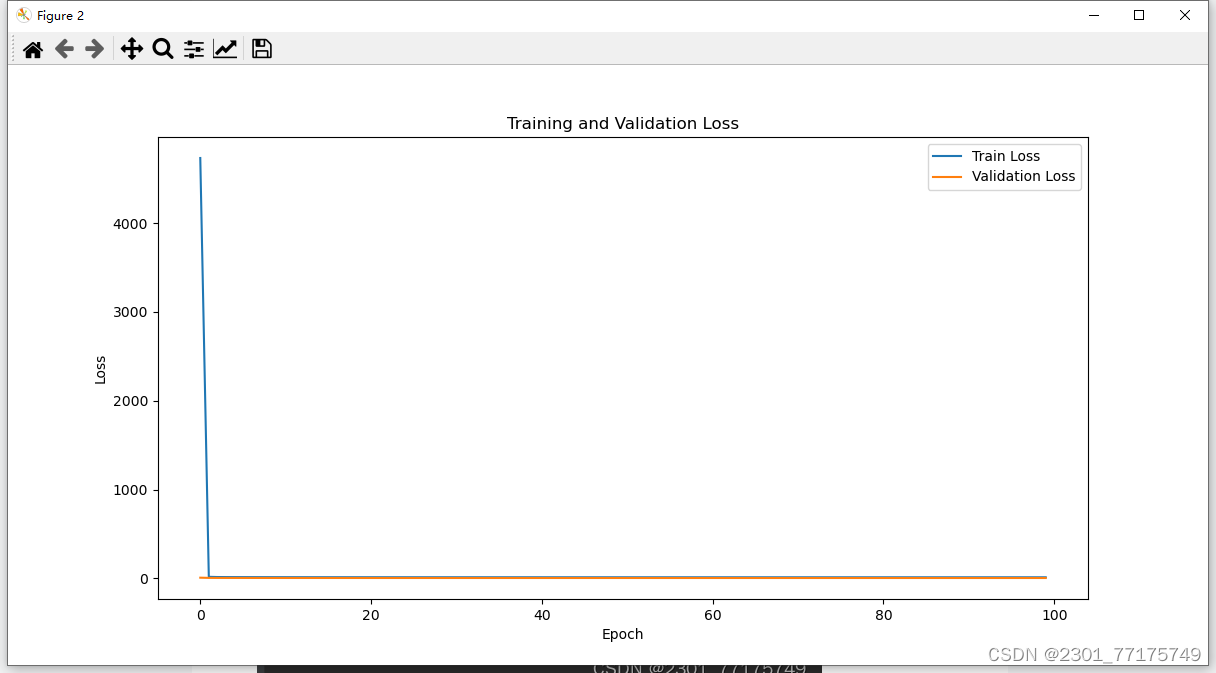

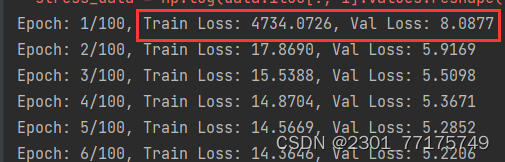

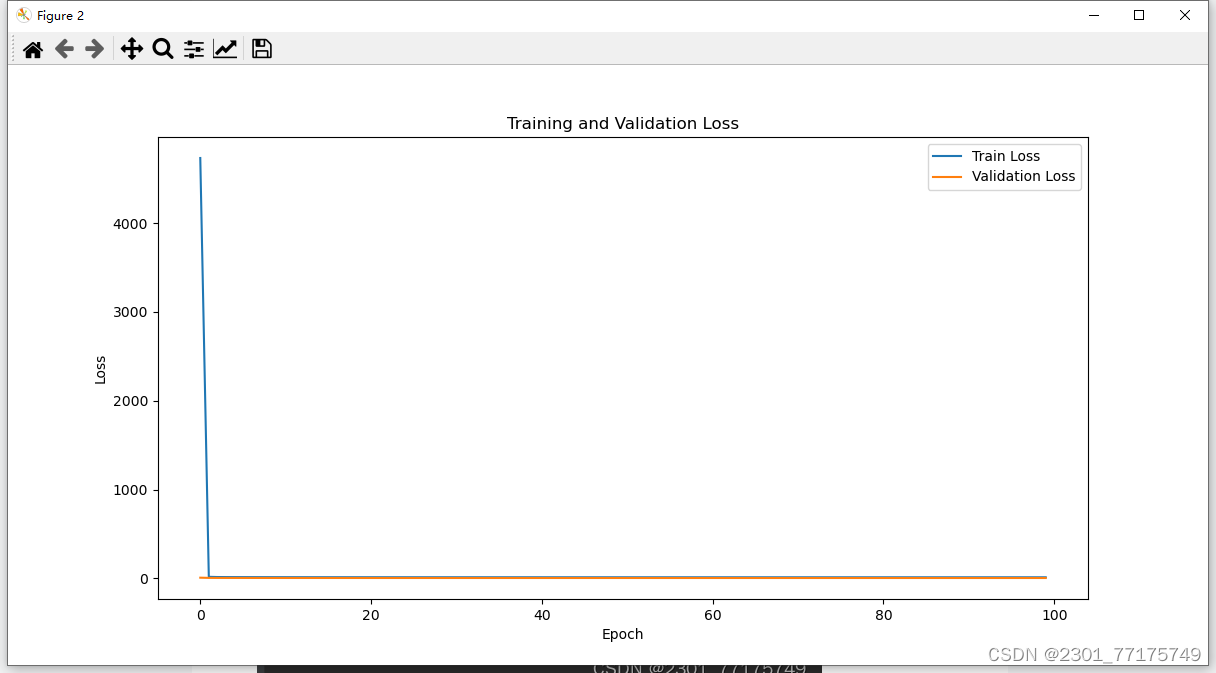

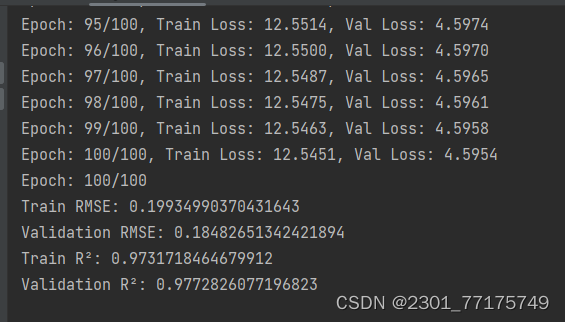

在训练LSTM模型当中,30000个样本划分训练集和验证集的比例为8:2,但是在epoch=1/100的时候为训练集与测试集的LOSS的差距太大

结果为:

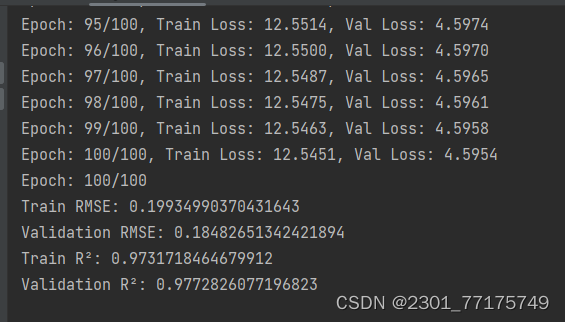

该怎么减小在epoch=1/100的时候,怎么减小训练集与测试集的LOSS的差距?和降低最终的在epoch=100/100的时候LOSS呢?

在训练LSTM模型当中,30000个样本划分训练集和验证集的比例为8:2,但是在epoch=1/100的时候为训练集与测试集的LOSS的差距太大

结果为:

该怎么减小在epoch=1/100的时候,怎么减小训练集与测试集的LOSS的差距?和降低最终的在epoch=100/100的时候LOSS呢?

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?