一、启动Hadoop集群

1.格式化

到/opt/server/hadoop/sbin文件目录下格式化HDFS文件(如果不会可以看后面哦)

(第一次部署才格式化,不需要每次都格式化,如果出错就删除data再格式化)

2.启动hadoop集群

①./start-dfs.sh (dfs集群)

② ./start-yarn.sh(yarn服务)

③./start-all.sh 全部启动

3.查看进程

jps

4.web网站访问

(1)ip+端口 例:192.168.229.112:9870

(2)第一次加载网页可能无法加载,我们可以采取以下这个方法

①关闭防火墙 : systemctl stop firewalld.service

②查看 : systemctl status firewalld.service

③防火墙失效设置 : systemctl disable firewalld.srvice

二、停止Hadoop集群

停止Hadoop

①./stop-dfs.sh (dfs集群)

②./stop-yarn.sh(yarn服务)

③./start-all.sh 全部启动

三、编辑脚本文件

1.切换目录和编辑hadoop.sh集群控制文件

①cd /opt/script 切换目录

②vim hadoop.sh 编辑hadoop.sh集群控制文件

2.脚本文件内容(wq保存)

#!/bin/bash

case $1 in

"start"){

/opt/server/hadoop/sbin/start-dfs.sh

/opt/server/hadoop/sbin/start-yarn.sh

};;

"stop"){

/opt/server/hadoop/sbin/stop-dfs.sh

/opt/server/hadoop/sbin/stop-yarn.sh

};;

esac

3.授权

①ll 查看脚本文件是否创建

② chmod 777 hadoop.sh 授权

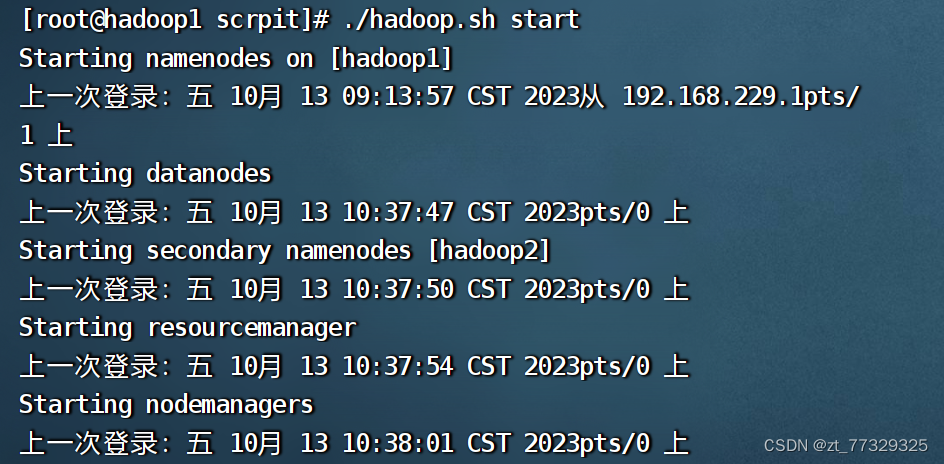

4.启动与停止Hadoop集群

①./hadoop.sh start 启动

②./hadoop.sh stop 停止

③jps 查看进程

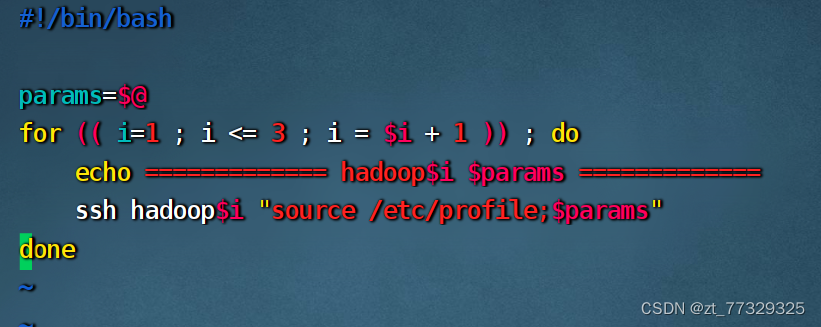

5.切换目录和编辑xcall.sh集群控制文件

①cd /opt/script 切换目录

②vim xcall.sh 编辑xcall.sh集群控制文件

6.xcall 脚本文件内容(wq保存)

#!/bin/bash

params=$@

for (( i=1 ; i <=3 ; i = $i + 1 )) ; do

echo =============== hadoop$i $params =============

ssh hadoop$i "source /etc/profile;$params"

done

7. 授权 ①ll 查看 ②chmod 777 xcall.sh 授权

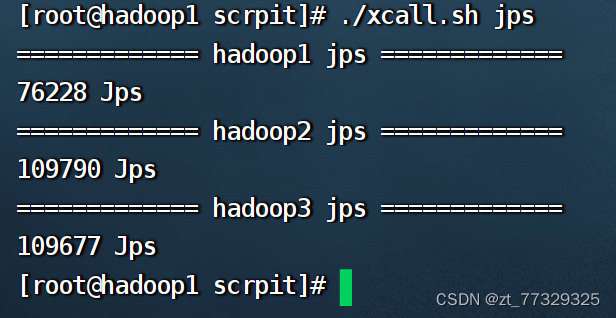

8.执行脚本

①./xcall.sh jps 查看进程

②./xcall.sh hostname 查看主机名

格式化操作步骤

1.修改配置环境变量

①vi /etc/profile 进入环境变量中添加HADOOP_HOME

②追加内容

export HADOOP_HOME=/opt/server/hadoop-3.2.2

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin③source /etc/profile 更新环境变量

④hadoop version 验证hadoop是否安装成功 2.配置hadoop参数

2.配置hadoop参数

①cd /opt/server/hadoop-3.2.2/etc/hadoop 切换目录

②配置core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<!-- 用于指定namenode地址在机器master上-->

<value>hdfs://hadoop1:8020</value>

</property>

<!-- 用于配置hadoop的数据目录-->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/server/hadoop-3.2.2/data</value>

</property>

</configuration>

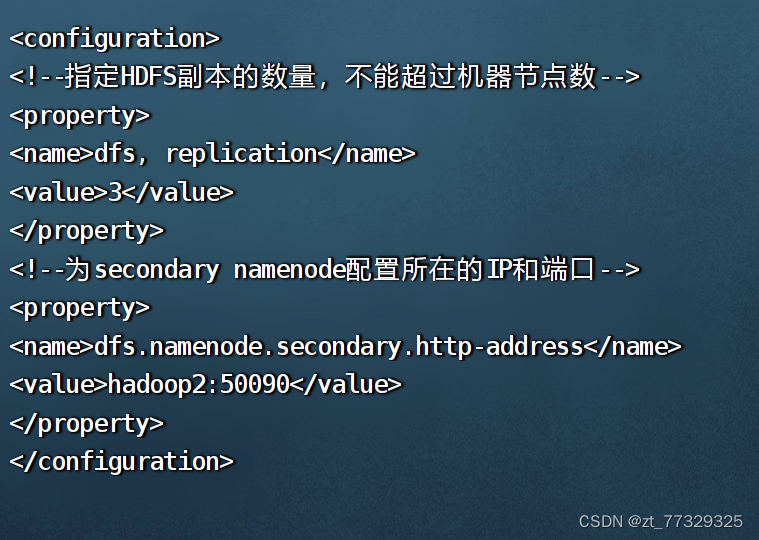

③配置hdfs-site.xml

<configuration>

<!--指定HDFS副本的数量,不能超过机器节点数-->

<property>

<name>dfs, replication</name>

<value>3</value>

</property>

<!--为secondary namenode配置所在的IP和端口-->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop2:50090</value>

</property>

</configuration>

④配置yarn-site.xml

<configuration>

<!-- 指定yarn集群的管理者(resourcemanger)的地址-->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop1</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

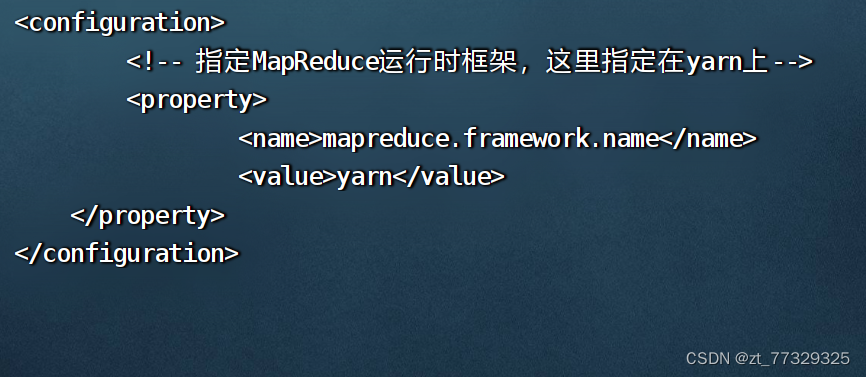

⑤配置mapred-site.xml

<configuration>

<!-- 指定MapReduce运行时框架,这里指定在yarn上-->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

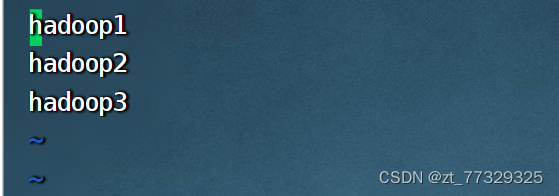

2.配置worker

①cd /local/soft/hadoop-3.2.2/etc/hadoop 切换目录

②vi worker 插入更写

3.编辑hadoop-env.sh

export JAVA_HOME=/opt/server/jdk1.8.0_144

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

export HDFS_NAMENODE_OPTS="-Dhadoop.security.logger=INFO,RFAS -Xmx1024m"

export HDFS_DATANODE_OPTS="-Dhadoop.security.logger=ERROR,RFAS -Xmx1024m"

4.永久关闭防火墙

①关闭防火墙 : systemctl stop firewalld.service

②查看 : systemctl status firewalld.service

③防火墙失效设置 : systemctl disable firewalld.srvice

5.分发Hadoop文件

①cd /lopt/server 切换目录

②scp -r /opt/server/ root@ip:/opt/ 分发到其他两台

6.集群格式化

①cd /opt/server/hadoop-3.2.2/sbin 切换目录

②hdfs namenode -format 格式化

③如果格式化失败就删除data重新格式化

7.集群启动

①cd /opt/server/hadoop-3.2.2/sbin

②./start-dfs.sh (dfs集群)

③ ./start-yarn.sh(yarn服务)

④./start-all.sh 全部启动

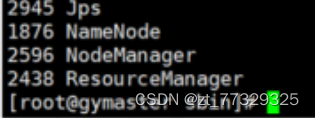

8.查看进程启动情况

jps

9.如果进程缺失可以查日志

①cd /opt/server/hadoop-3.2.2/logs 切换目录

②more +出错日志 (基本是配置文件和格式化错误)

谢谢观看

6796

6796

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?