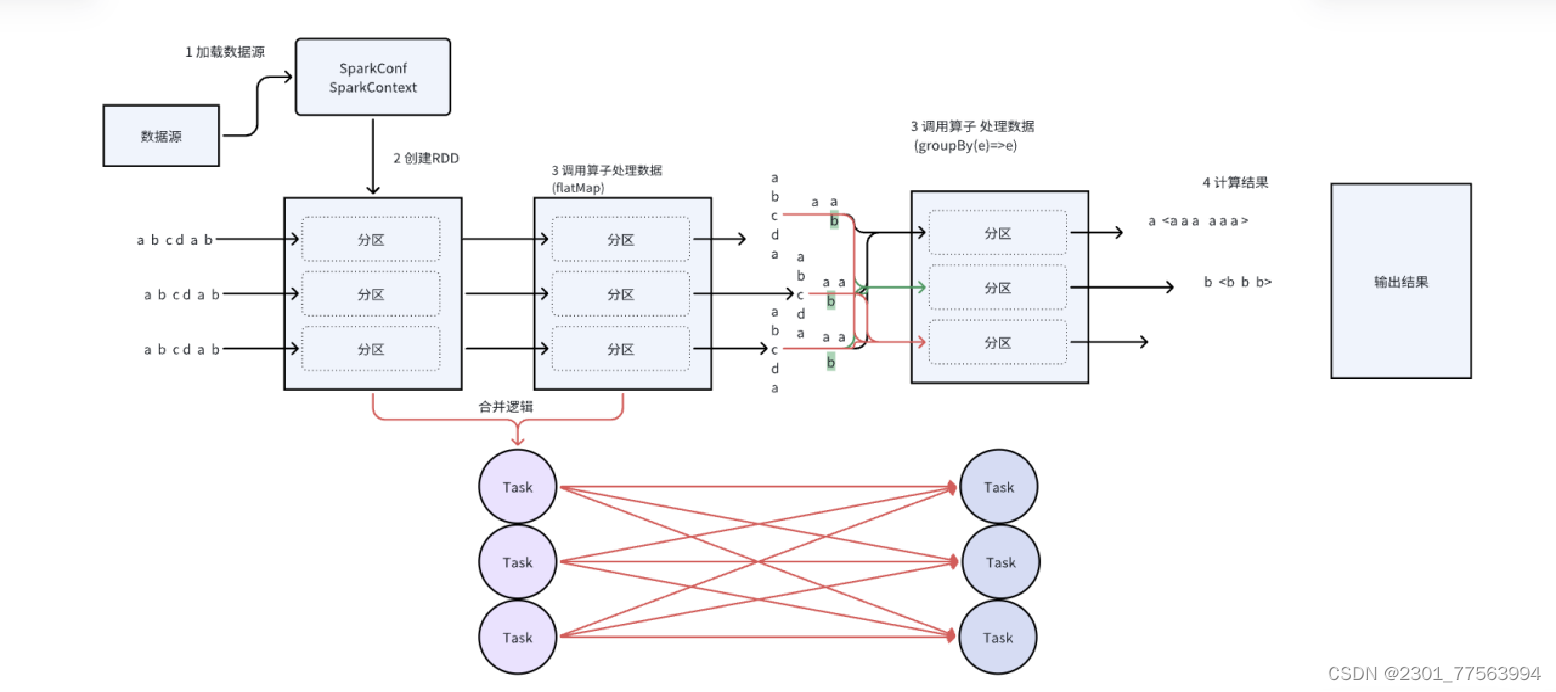

一、spark编程api套路

二、配置Spark运行环境

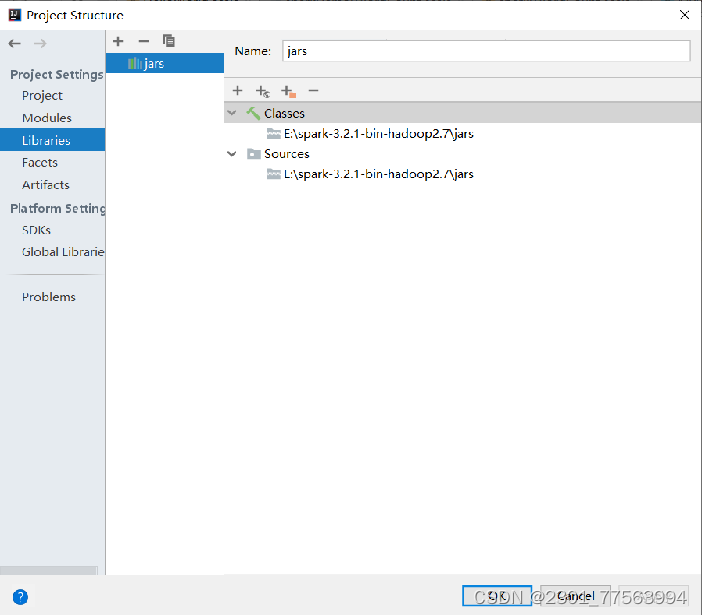

2.1配置Spark

- 选择“Libraries”选项,单击“+”按钮,选择“Java”选项

- 在弹出的界面中找到Spark安装目录下的jars文件夹,将整个文件夹导入,如图所示

- 点击“OK”

2.2编写Spark程序

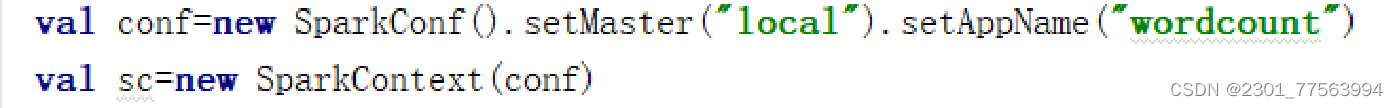

任何Spark程序都是以SparkContext对象开始的,因为SparkContext是Spark应用程序的上下文和入口,无论是Scala、Python、R程序,都是通过SparkContext对象的实例来创建RDD,Spark Shell中的sc就是SparkContext对象的实例。因此在实际Spark应用程序的开发中,在main方法中需要创建SparkContext对象,作为Spark应用程序的入口,并在Spark程序结束时关闭SparkContext对象。

- 初始化SparkContext需要一个SparkConf对象,SparkConf包含了Spark集群配置的各种参数,属性参数是一种键值对的格式,一般可以通过set(属性名,属性设置值)的方法修改属性。其中还包含了设置程序名setAppName、设置运行模式setMaster等方法。如下图所示

- SparkContext对象的实例创建完成后,就可以通过实例变量转化集合或者读取数据,计算过程中转化操作和行动操作的使用方法与在Shell环境中一致。

三、创建RDD

- RDD是一个容错的、只读的、可进行并行操作的数据结构,是一个分布在集群各个节点中的存放元素的集合。RDD的创建有3种不同的方法。

- 第一种是将程序中已存在的Seq集合(如集合、列表、数组)转换成RDD。

- 第二种是对已有RDD进行转换得到新的RDD,这两种方法都是通过内存中已有的集合创建RDD的。

- 第三种是直接读取外部存储系统的数据创建RDD。

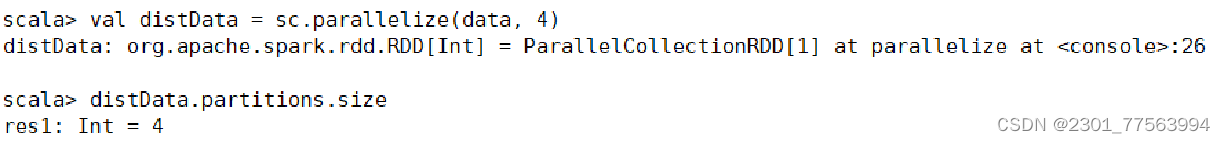

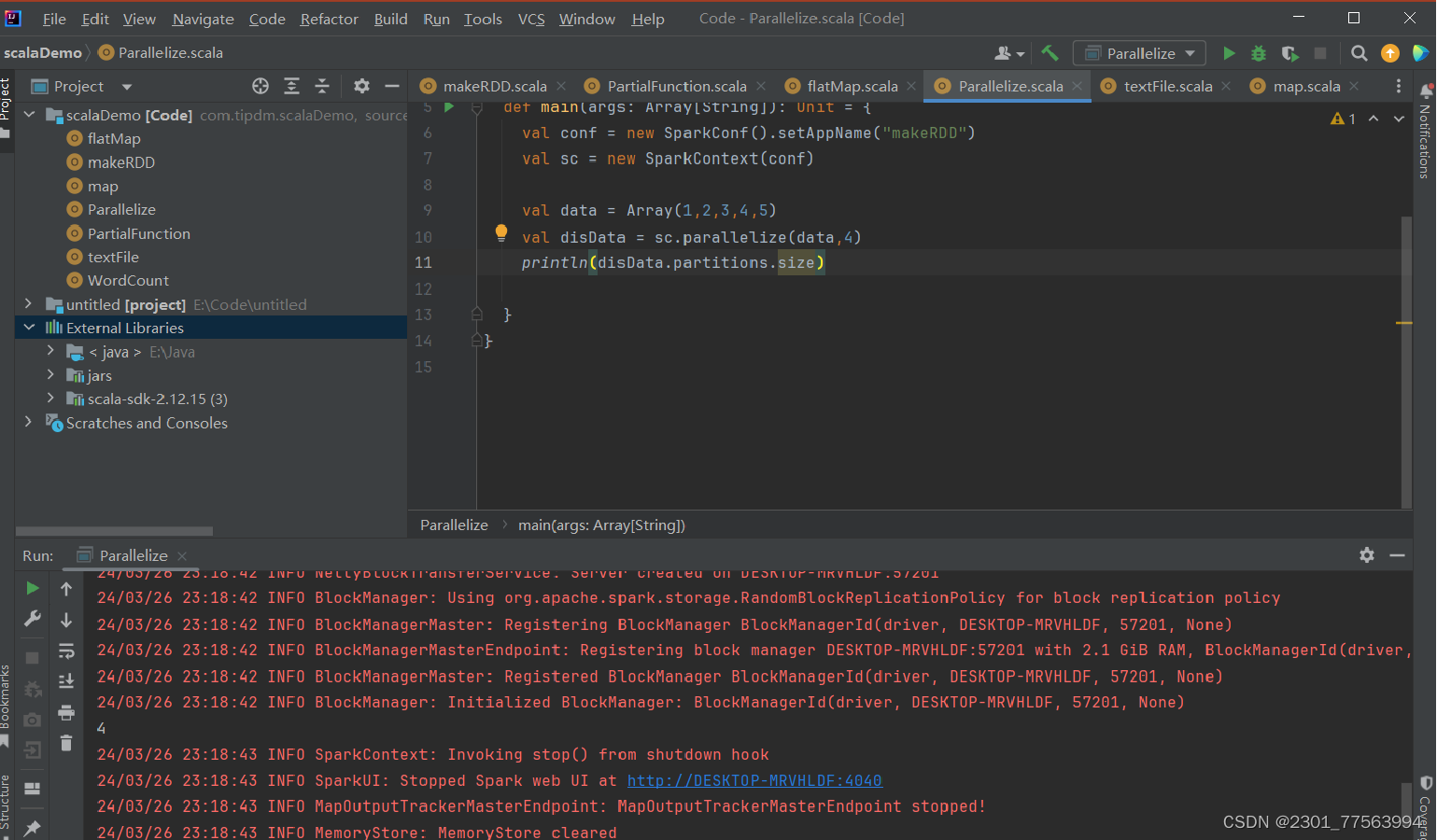

3.1 parallelize()

- parallelize()方法有两个输入参数,说明如下.

- 要转化的集合,必须是Seq集合。Seq表示序列,指的是一类具有一定长度的、可迭代访问的对象,其中每个数据元素均带有一个从0开始的、固定的索引。

- 分区数。若不设分区数,则RDD的分区数默认为该程序分配到的资源的CPU核心数。

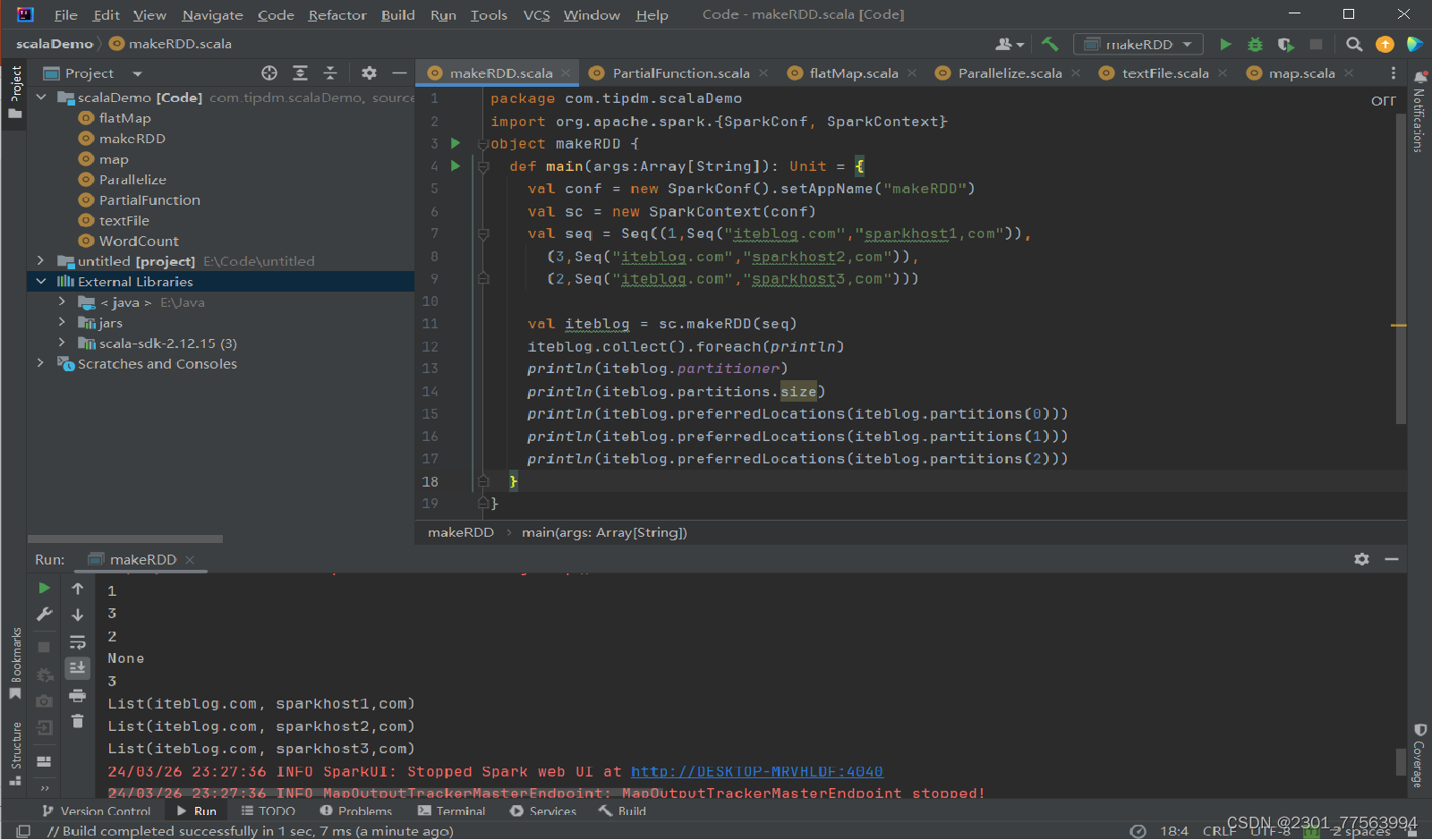

3.2 makeRDD

- makeRDD()方法有两种使用方式。

- 第一种方式的使用与parallelize()方法一致;

- 第二种方式是通过接收一个是Seq[(T,Seq[String])]参数类型创建RDD。

第二种方式生成的RDD中保存的是T的值,Seq[String]部分的数据会按照Seq[(T,Seq[String])]的顺序存放到各个分区中,一个Seq[String]对应存放至一个分区,并为数据提供位置信息,通过preferredLocations()方法可以根据位置信息查看每一个分区的值。调用makeRDD()时不可以直接指定RDD的分区个数,分区的个数与Seq[String]参数的个数是保持一致的。

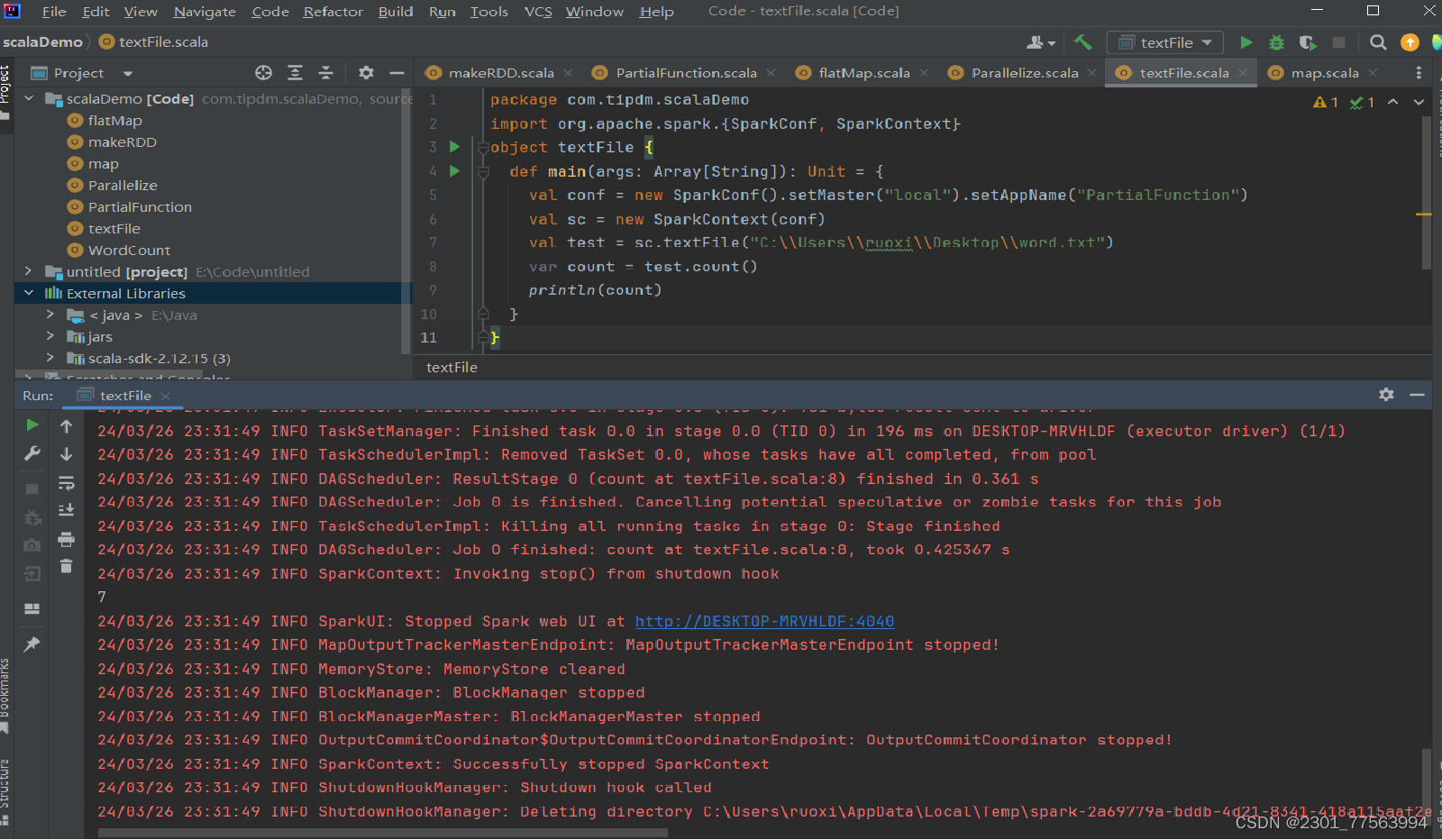

3.3 从外部储存系统中读取数据创建RDD

- 从外部存储系统中读取数据创建RDD是指直接读取存放在文件系统中的数据文件创建RDD。

- 从内存中读取数据创建RDD的方法常用于测试,从外部存储系统中读取数据创建RDD才是用于实践操作的常用方法。

- 从外部存储系统中读取数据创建RDD可以有很多种数据来源,可通过SparkContext对象的textFile()方法读取数据集,该方法支持多种类型的数据集,如目录、文本文件、压缩文件和通配符匹配的文件等,并且允许设定分区个数。

- 分别读取HDFS文件和Linux本地文件的数据并创建RDD,具体操作如下:

- 通过HDFS文件创建RDD

- 直接通过textFile()方法读取HDFS文件的位置即可。

- 通过Linux本地文件创建RDD 本地文件的读取也是通过sc.textFile("路径")的方法实现的,在路径前面加上“file://”表示从Linux本地文件系统读取。在IntelliJ IDEA开发环境中可以直接读取本地文件;但在spark-shell中,要求在所有节点的相同位置保存该文件才可以读取它。

四、方法

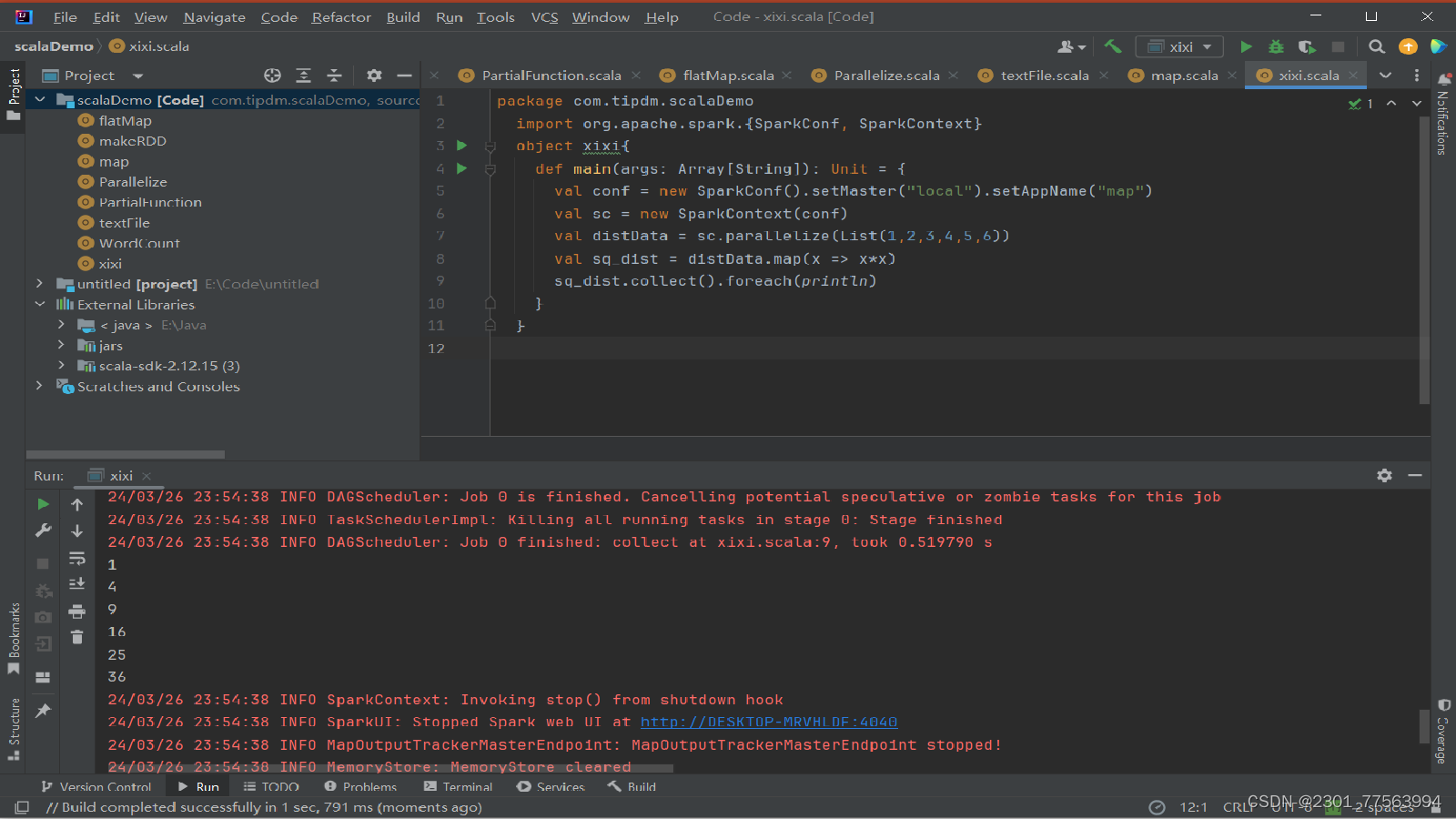

4.1 使用map()方法转换数据

- map()方法是一种基础的RDD转换操作,可以对RDD中的每一个数据元素通过某种函数进行转换并返回新的RDD。

- map()方法是转换操作,不会立即进行计算。

- 转换操作是创建RDD的第二种方法,通过转换已有RDD生成新的RDD。因为RDD是一个不可变的集合,所以如果对RDD数据进行了某种转换,那么会生成一个新的RDD。

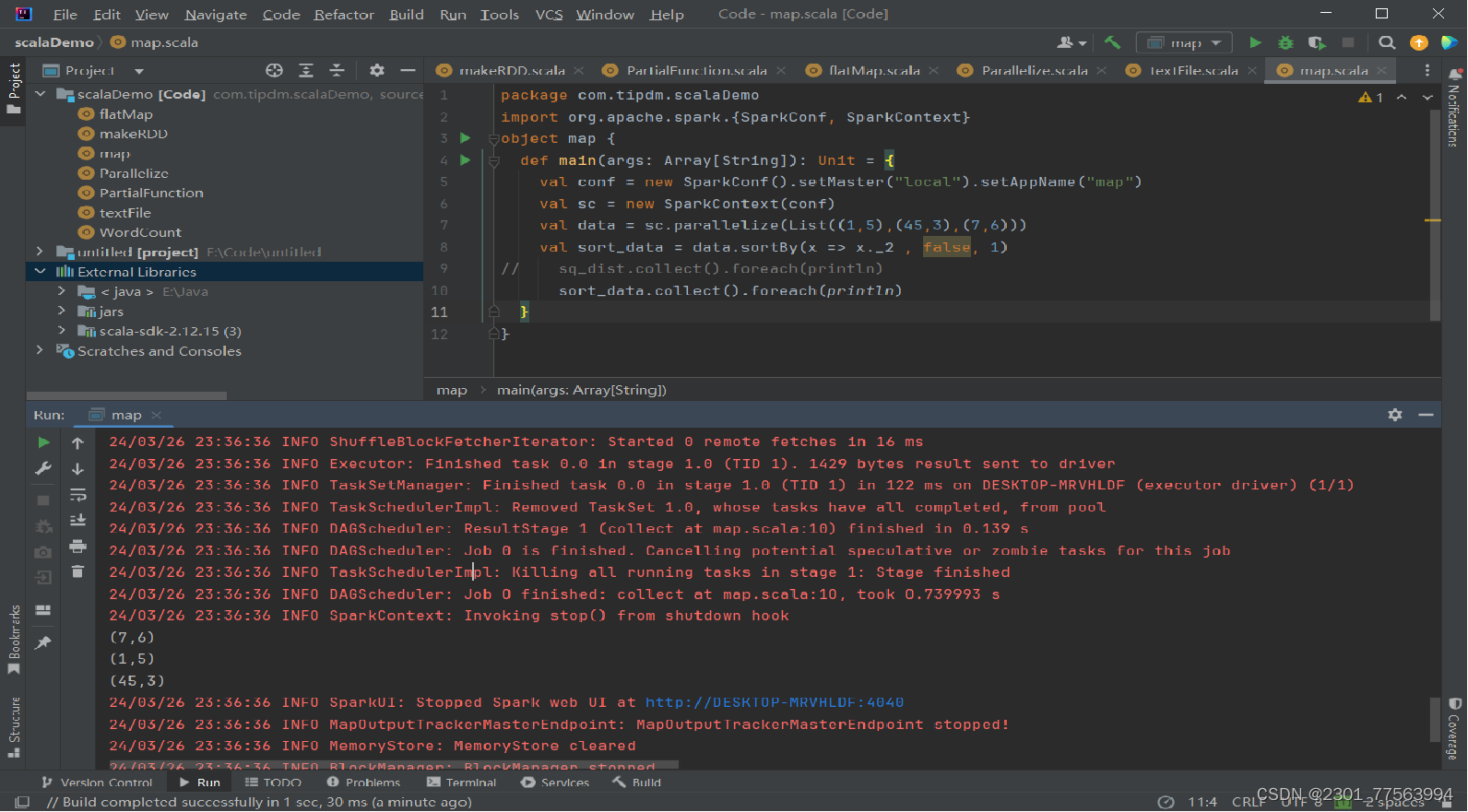

4.2 使用sorBy()方法进行排序

- sortBy()方法用于对标准RDD进行排序,有3个可输入参数,说明如下。

- 第1个参数是一个函数f:(T) => K,左边是要被排序对象中的每一个元素,右边返回的值是元素中要进行排序的值。

- 第2个参数是ascending,决定排序后RDD中的元素是升序的还是降序的,默认是true,即升序排序,如果需要降序排序那么需要将参数的值设置为false。

- 第3个参数是numPartitions,决定排序后的RDD的分区个数,默认排序后的分区个数和排序之前的分区个数相等,即this.partitions.size。

第一个参数是必须输入的,而后面的两个参数可以不输入。

4.3 使用collect()方法查询数据

- collect()方法是一种行动操作,可以将RDD中所有元素转换成数组并返回到Driver端,适用于返回处理后的少量数据。

- 因为需要从集群各个节点收集数据到本地,经过网络传输,并且加载到Driver内存中,所以如果数据量比较大,会给网络传输造成很大的压力。 因此,数据量较大时,尽量不使用collect()方法,否则可能导致Driver端出现内存溢出问题。

- collect()方法有以下两种操作方式。 collect:直接调用collect返回该RDD中的所有元素,返回类型是一个Array[T]数组。

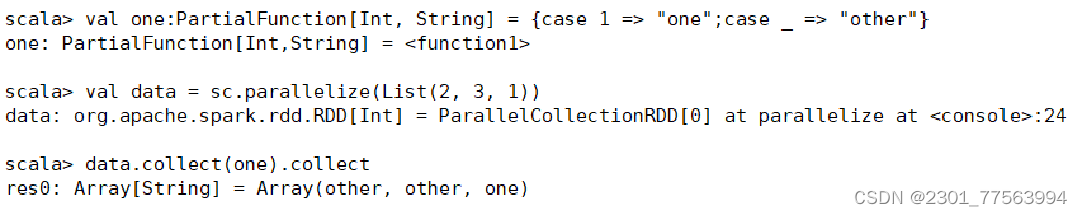

- collect[U: ClassTag](f: PartialFunction[T, U]):RDD[U]。这种方式需要提供一个标准的偏函数,将元素保存至一个RDD中。首先定义一个函数one,用于将collect方法得到的数组中数值为1的值替换为“one”,将其他值替换为“other”。

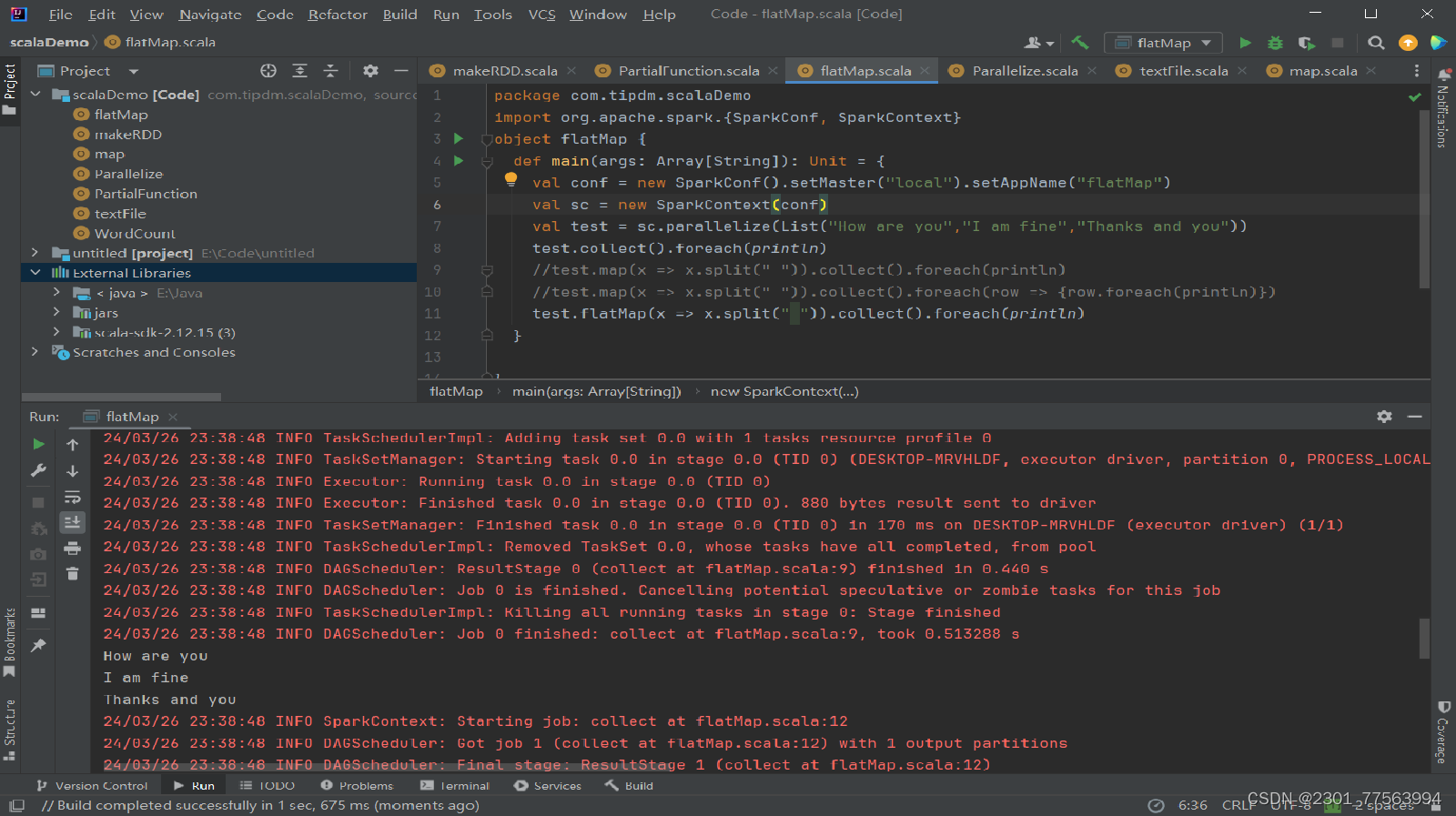

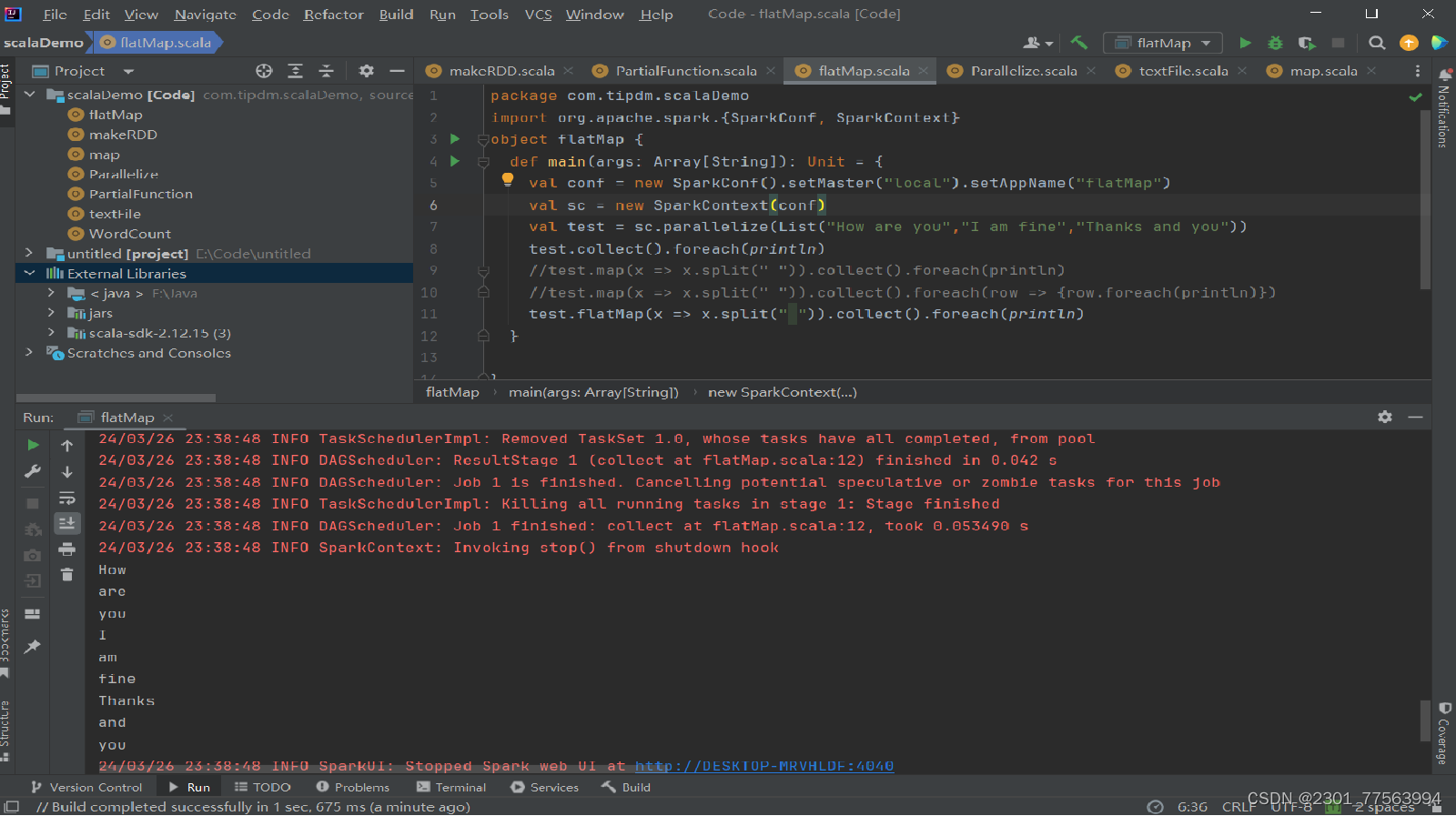

4.4使用flatMap()方法转换数据

- flatMap()方法将函数参数应用于RDD之中的每一个元素,将返回的迭代器(如数组、列表等)中的所有元素构成新的RDD。

- 使用flatMap()方法时先进行map(映射)再进行flat(扁平化)操作,数据会先经过跟map一样的操作,为每一条输入返回一个迭代器(可迭代的数据类型),然后将所得到的不同级别的迭代器中的元素全部当成同级别的元素,返回一个元素级别全部相同的RDD。 这个转换操作

- 通常用来切分单词。

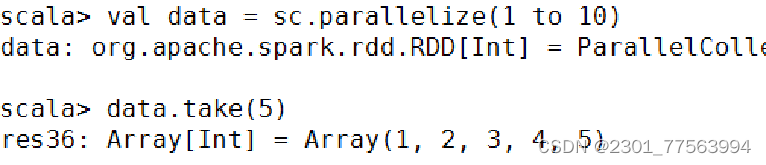

4.5使用take()方法查询某几个值

- take(N)方法用于获取RDD的前N个元素,返回数据为数组。

- take()与collect()方法的原理相似,collect()方法用于获取全部数据,take()方法获取指定个数的数据。 获取RDD的前5个元素。

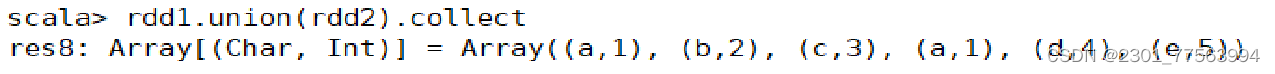

4.6使用union()方法合并多个RDD

- union()方法是一种转换操作,用于将两个RDD合并成一个,不进行去重操作,而且两个RDD中每个元素中的值的个数、数据类型需要保持一致。

- 使用union()方法合并两个RDD

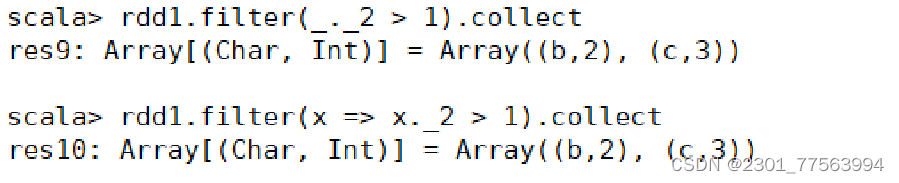

4.7使用filter()方法进行过滤

- filter()方法是一种转换操作,用于过滤RDD中的元素。

- filter()方法需要一个参数,这个参数是一个用于过滤的函数,该函数的返回值为Boolean类型。

- filter()方法将返回值为true的元素保留,将返回值为false的元素过滤掉,最后返回一个存储符合过滤条件的所有元素的新RDD。

- 创建一个RDD,并且过滤掉每个元组第二个值小于等于1的元素。

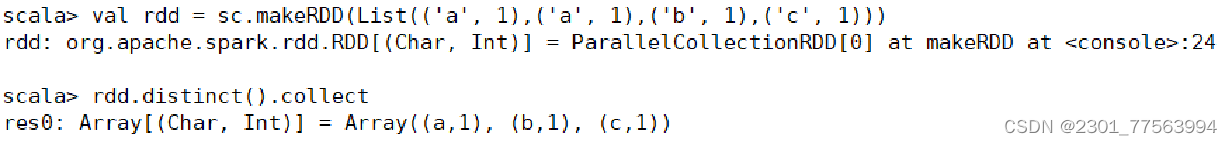

4.8使用distincture()方法进行去重

- distinct()方法是一种转换操作,用于RDD的数据去重,去除两个完全相同的元素,没有参数。

- 创建一个带有重复数据的RDD,并使用distinct()方法去重。

五、使用简单的集合操作

5.1 Spark中的集合操作常用方法(转换操作)

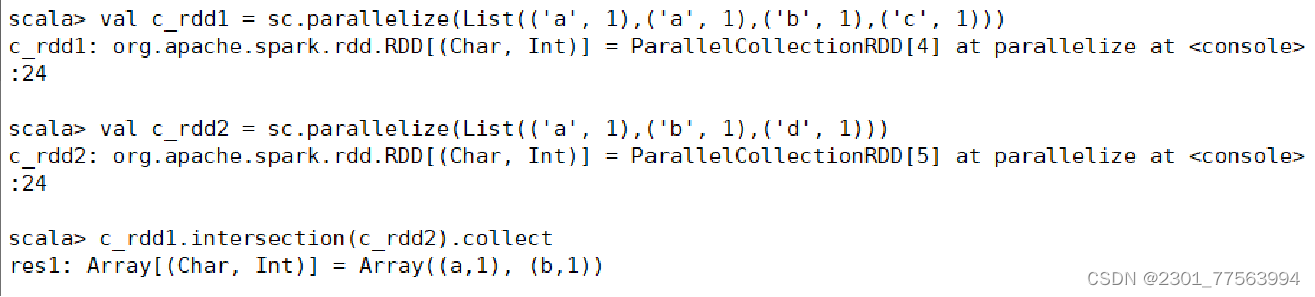

5.2 intersection()方法

- intersection()方法用于求出两个RDD的共同元素,即找出两个RDD的交集,参数是另一个RDD,先后顺序与结果无关。

- 创建两个RDD,其中有相同的元素,通过intersection()方法求出两个RDD的交集。

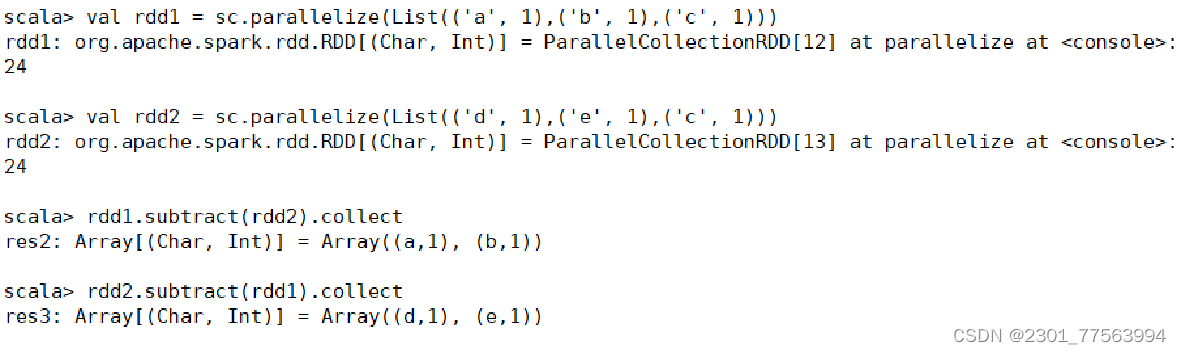

5.3 subtract()方法

- subtract()方法用于将前一个RDD中在后一个RDD出现的元素删除,可以认为是求补集的操作,返回值为前一个RDD去除与后一个RDD相同元素后的剩余值所组成的新的RDD。两个RDD的顺序会影响结果。

- 创建两个RDD,分别为rdd1和rdd2,包含相同元素和不同元素,通过subtract()方法求rdd1和rdd2彼此的补集。

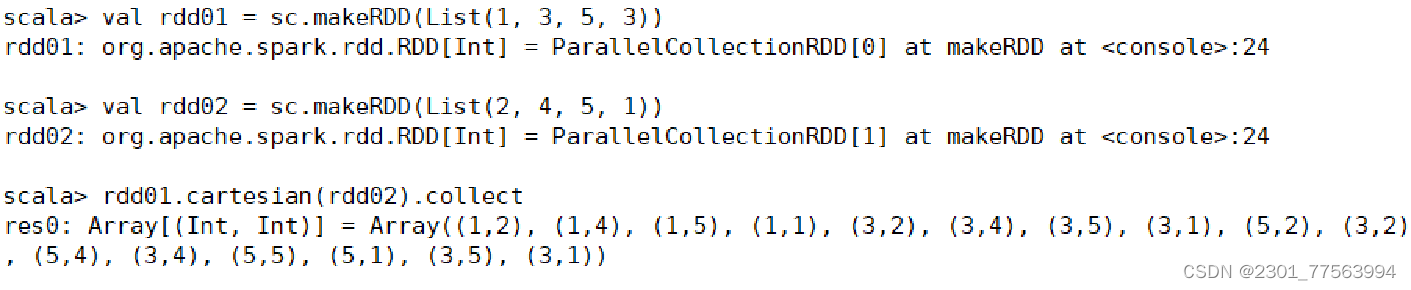

5.4 cartesian()方法

- cartesian()方法可将两个集合的元素两两组合成一组,即求笛卡儿积。

- 创建两个RDD,分别有4个元素,通过cartesian()方法求两个RDD的笛卡儿积。

六、了解键值对RDD

- Spark的大部分RDD操作都支持所有种类的单值RDD,但是有少部分特殊的操作只能作用于键值对类型的RDD。

- 顾名思义,键值对RDD由一组组的键值对组成,这些RDD被称为PairRDD。PairRDD提供了并行操作各个键或跨节点重新进行数据分组的操作接口。

- 例如,PairRDD提供了reduceByKey()方法,可以分别规约每个键对应的数据,还有join()方法,可以把两个RDD中键相同的元素组合在一起,合并为一个RDD。

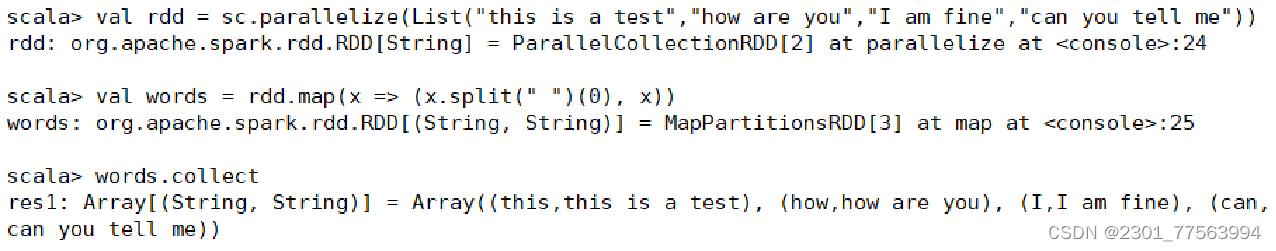

6.1 创建键值对RDD

- 有很多种创建键值对RDD的方式,很多存储键值对的数据格式会在读取时直接返回由其键值对组成的PairRDD。

- 当需要将一个普通的RDD转化为一个PairRDD时可以使用map函数来进行操作,传递的函数需要返回键值对。

6.2 使用键值对RDD的Keys和values方法

- 键值对RDD,包含键和值两个部分。

- Spark提供了两种方法,分别获取键值对RDD的键和值。

- keys方法返回一个仅包含键的RDD。

- values方法返回一个仅包含值的RDD。

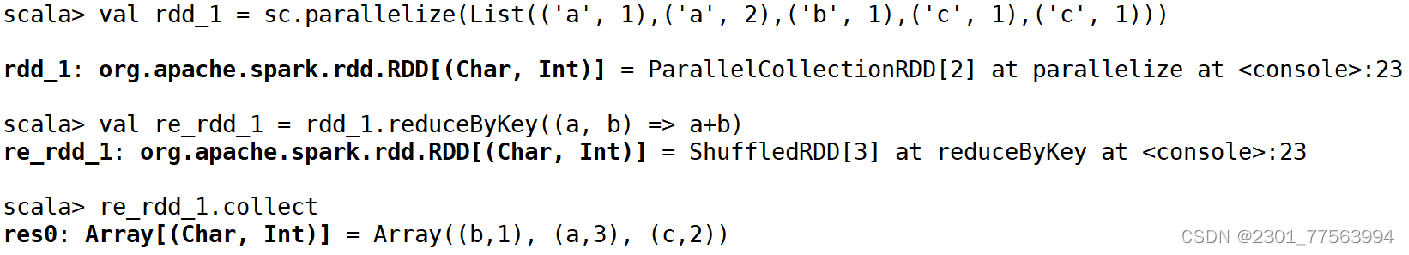

6.3使用键值对RDD的reduceByKey()方法

- 当数据集以键值对形式展现时,合并统计键相同的值是很常用的操作。

- reduceByKey()方法用于合并具有相同键的值,作用对象是键值对,并且只对每个键的值进行处理,当RDD中有多个键相同的键值对时,则会对每个键对应的值进行处理。

- reduceByKey()方法需要接收一个输入函数,键值对RDD相同键的值会根据函数进行合并并且创建一个新的RDD作为返回结果。

- 在进行处理时,reduceByKey()方法将相同键的前两个值传给输入函数,产生一个新的返回值,新产生的返回值与RDD中相同键的下一个值组成两个元素,再传给输入函数,直到最后每个键只有一个对应的值为止。reduceByKey()方法不是一种行动操作,而是一种转换操作。

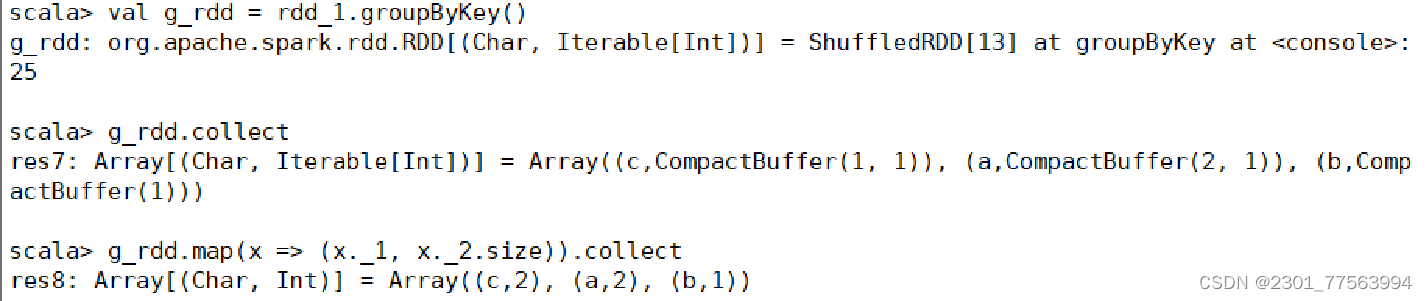

6.4 使用键值对RDD的groupByKey()方法

- groupByKey()方法用于对具有相同键的值进行分组,可以对同一组的数据进行计数、求和等操作。

- 对于一个由类型K的键和类型V的值组成的RDD,通过groupByKey()方法得到的RDD类型是[K,Iterable[V]]。

6.5 使用join()方法连接两个RDD

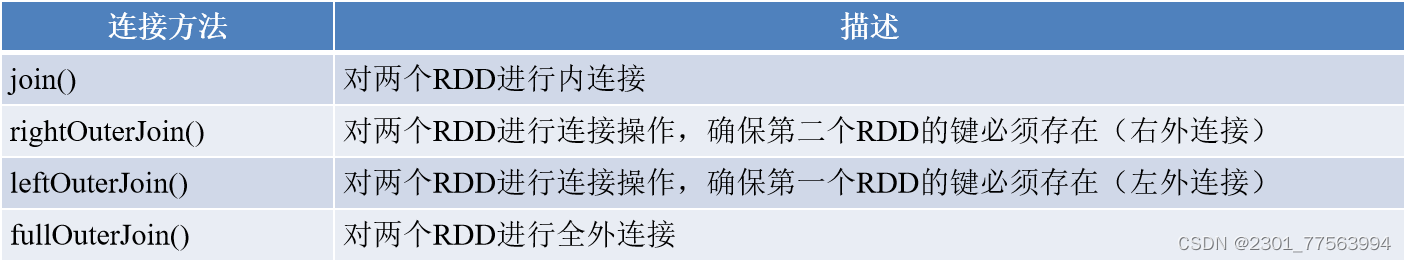

- 将有键的一组数据与另一组有键的数据根据键进行连接,是对键值对数据常用的操作之一。

- 与合并不同,连接会对键相同的值进行合并,连接方式多种多样,包含内连接、右外连接、左外连接、全外连接,不同的连接方式需要使用不同的连接方法。

- 连接方法如下表:

6.6 使用join()方法连接两个RDD

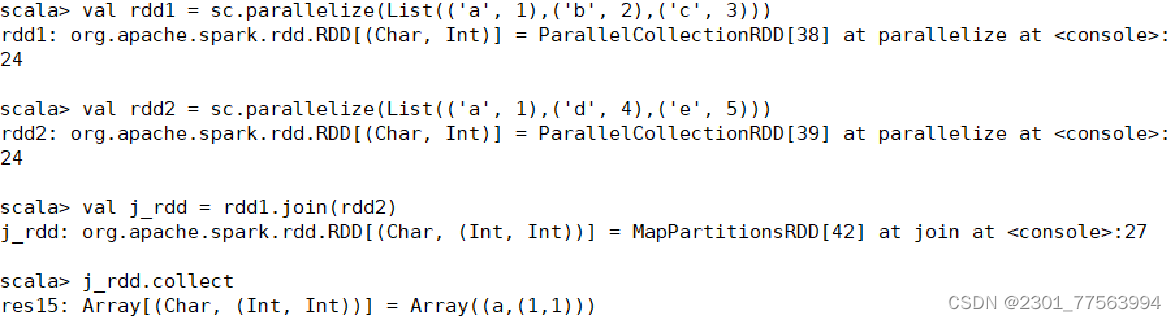

(1)join()方法

- join()方法用于根据键对两个RDD进行内连接,将两个RDD中键相同的数据的值存放在一个元组中,最后只返回两个RDD中都存在的键的连接结果。

- 例如,在两个RDD中分别有键值对(K,V)和(K,W),通过join()方法连接会返回(K,(V,W))。 创建两个RDD,含有相同键和不同的键,通过join()方法进行内连接。

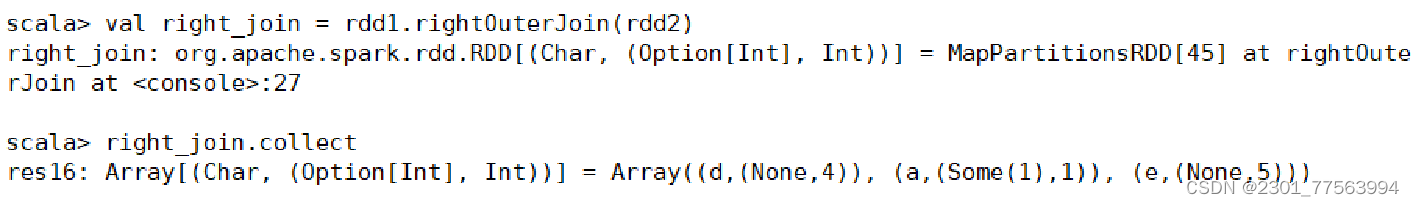

(2)rightOuterJoin()方法

- rightOuterJoin()方法用于根据键对两个RDD进行右外连接,连接结果是右边RDD的所有键的连接结果,不管这些键在左边RDD中是否存在。

- 在rightOuterJoin()方法中,如果在左边RDD中有对应的键,那么连接结果中值显示为Some类型值;如果没有,那么显示为None值。

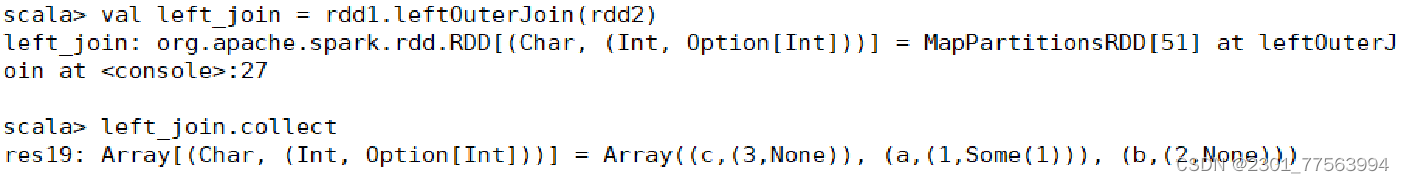

(3)leftOuterJoin()方法

- leftOuterJoin()方法用于根据键对两个RDD进行左外连接,与rightOuterJoin()方法相反,返回结果保留左边RDD的所有键。

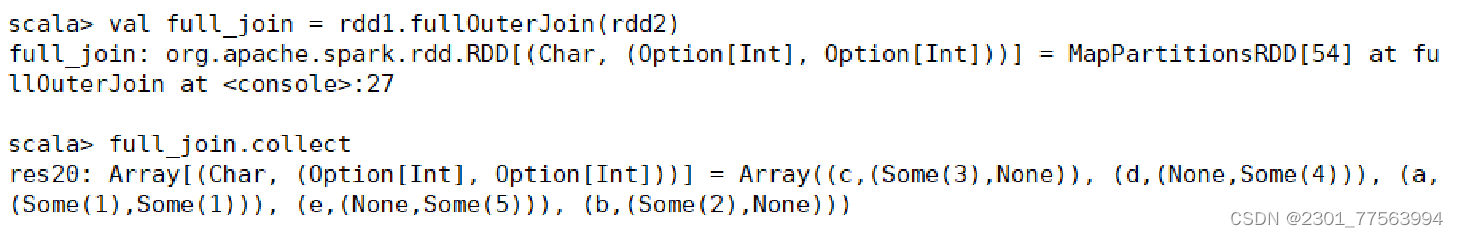

(4)fullOuterJoin()方法

- fullOuterJoin()方法用于对两个RDD进行全外连接,保留两个RDD中所有键的连接结果。

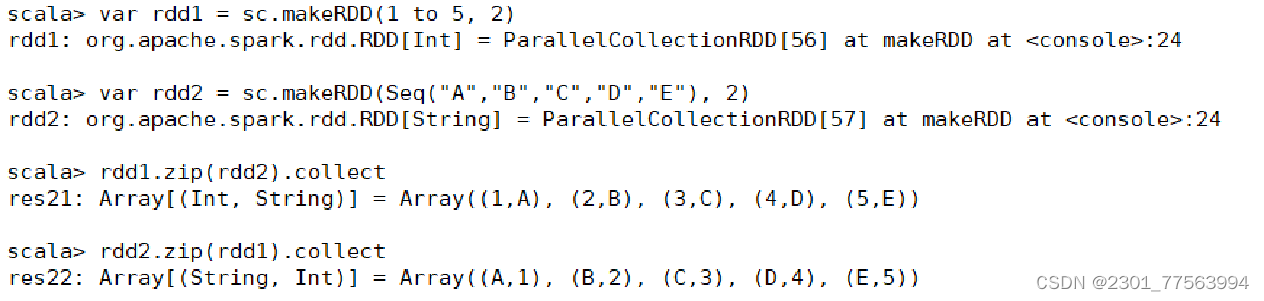

6.7 使用zip()方法组合两个RDD

- zip()方法用于将两个RDD组合成键值对RDD,要求两个RDD的分区数量以及元素数量相同,否则会抛出异常。

- 将两个RDD组合成Key/Value形式的RDD,这里要求两个RDD的partition数量以及元素数量都相同,否则会抛出异常。

6.8 使用combineByKey()方法合并相同键的值

- combineByKey()方法是Spark中一个比较核心的高级方法,键值对的其他一些高级方法底层均是使用combineByKey()方法实现的,如groupByKey()方法、reduceByKey()方法等。

- combineByKey()方法用于将键相同的数据聚合,并且允许返回类型与输入数据的类型不同的返回值。

- combineByKey()方法的使用方式如下:

combineByKey(createCombiner,mergeValue,mergeCombiners,numPartitions=None)

6.9 使用combineByKey()方法合并相同键的值

- combineByKey()方法接收3个重要的参数,具体说明如下.

- createCombiner:V=>C,V是键值对RDD中的值部分,将该值转换为另一种类型的值C,C会作为每一个键的累加器的初始值。

- mergeValue:(C,V)=>C,该函数将元素V聚合到之前的元素C(createCombiner)上(这个操作在每个分区内进行)。

- mergeCombiners:(C,C)=>C,该函数将两个元素C进行合并(这个操作在不同分区间进行)。

7 使用combineByKey()方法合并相同键的值

- 由于合并操作会遍历分区中所有的元素,因此每个元素(这里指的是键值对)的键只有两种情况:以前没出现过或以前出现过。对于这两种情况,3个参数的执行情况描述如下。

- 如果以前没出现过,则执行的是createCombiner()方法,createCombiner()方法会在新遇到的键对应的累加器中赋予初始值,否则执行mergeValue()方法。

- 对于已经出现过的键,调用mergeValue()方法进行合并操作,对该键的累加器对应的当前值(C)与新值(V)进行合并。

- 由于每个分区都是独立处理的,因此对于同一个键可以有多个累加器。如果有两个或更多的分区都有对应同一个键的累加器,就需要使用用户提供的mergeCombiners()方法对各个分区的结果(全是C)进行合并。

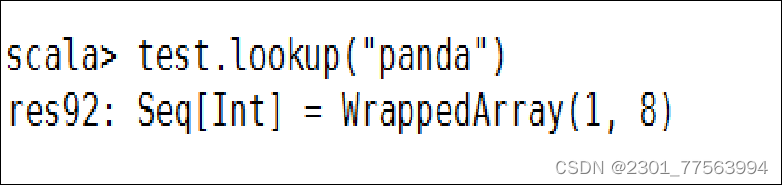

7.1 使用lookup()方法查找指定键的值

- lookup(key:K)方法作用于键值对RDD,返回指定键的所有值。

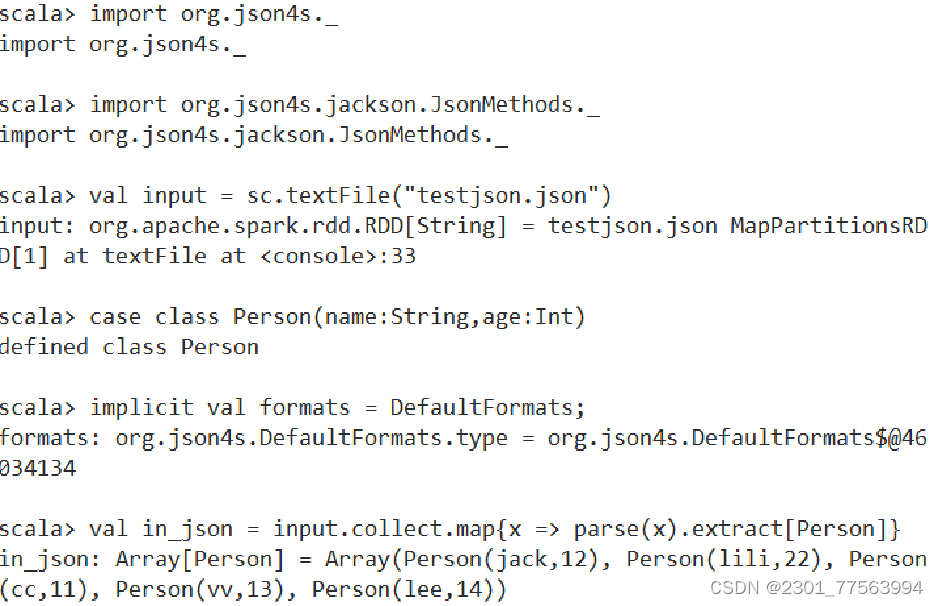

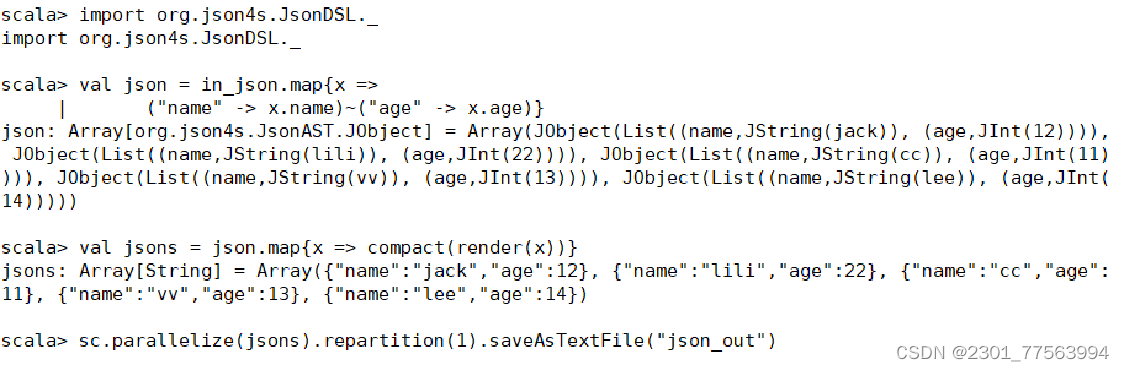

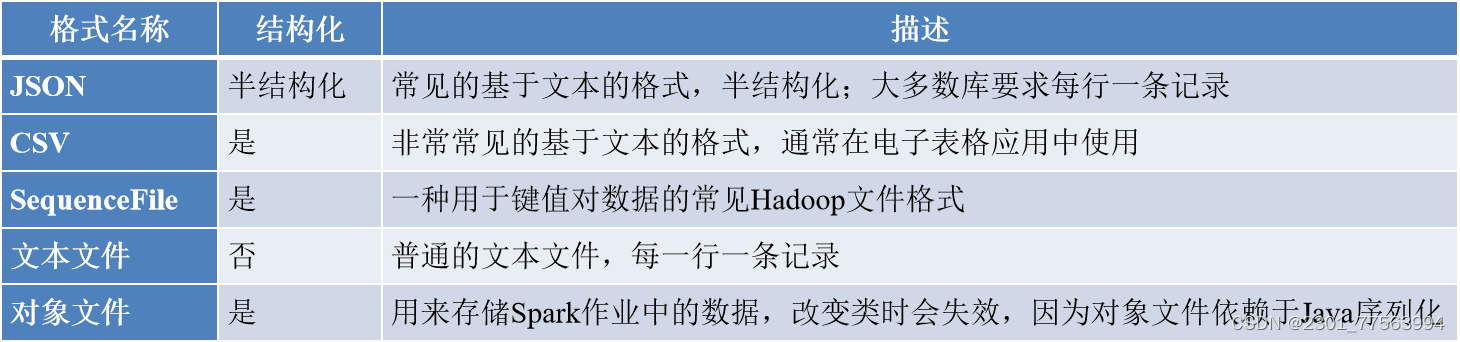

七、读取与存储JSON文件

7.1 Spark支持的一些常见文件格式。

7.2

(1)JSON文件的读取

(2)JSON文件的存储

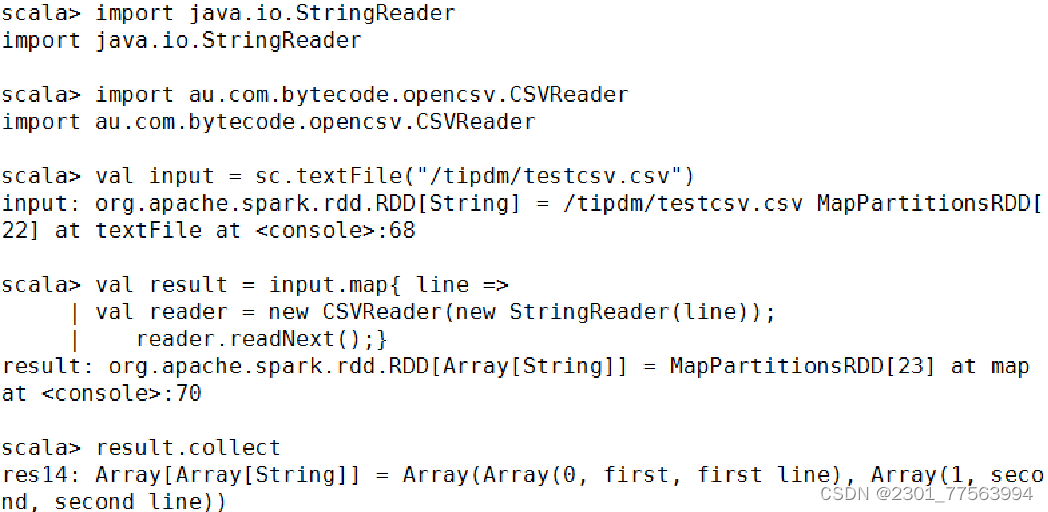

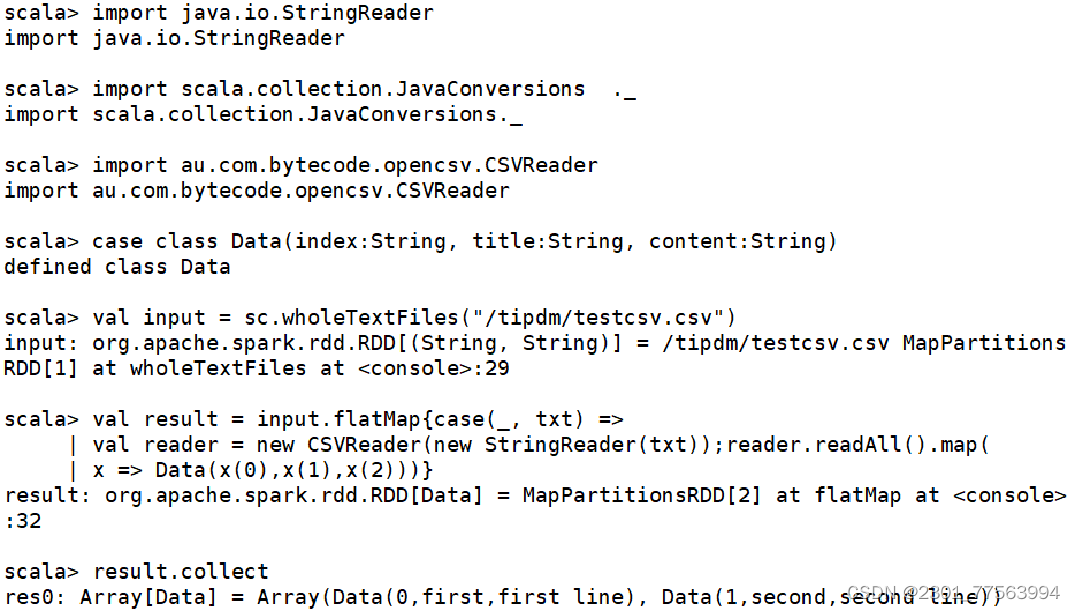

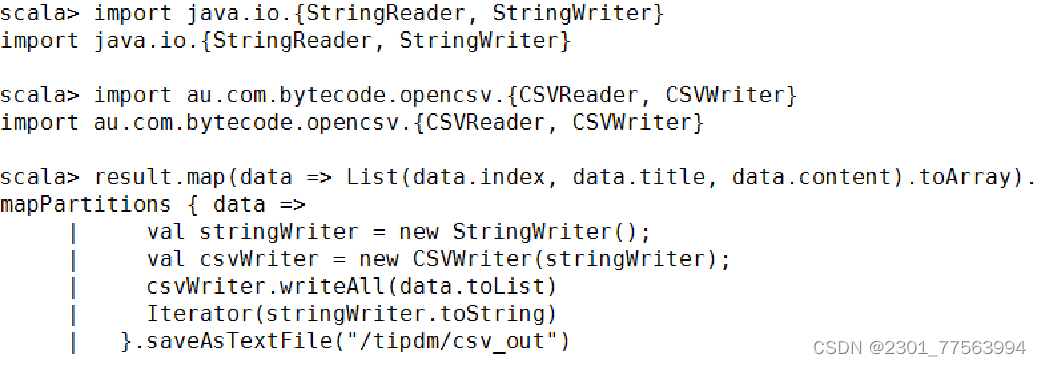

7.3 读取与存储CSV文件

(1)CSV文件的读取

(2)CSV文件的存储

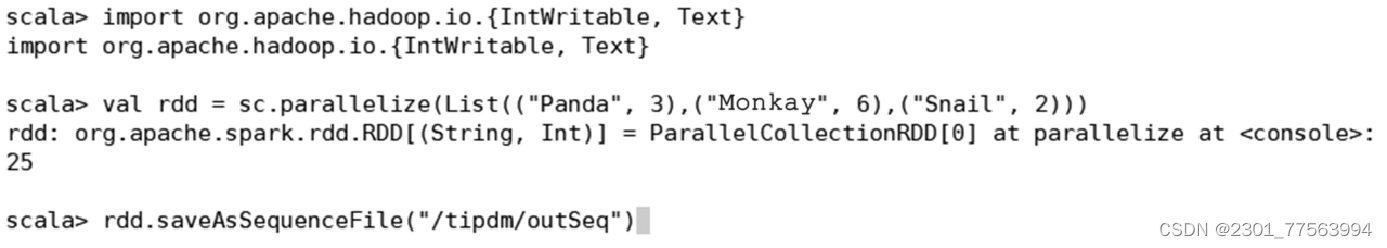

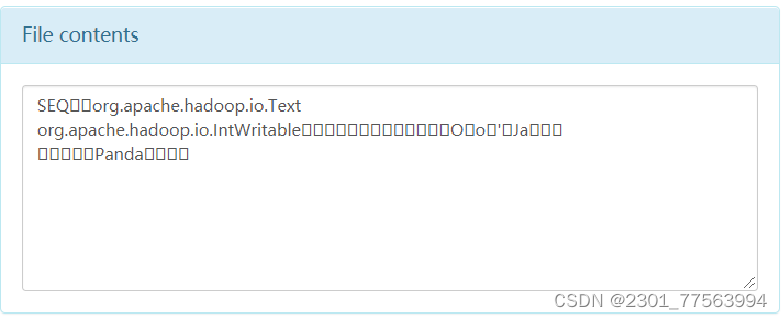

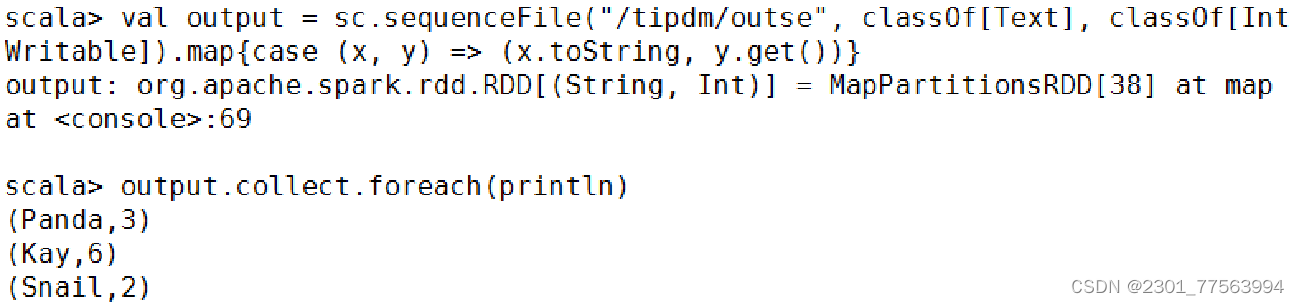

7.4 读取与存储SequenceFile文件

(1)SequenceFile文件的存储

(2)SequenceFile文件的读取

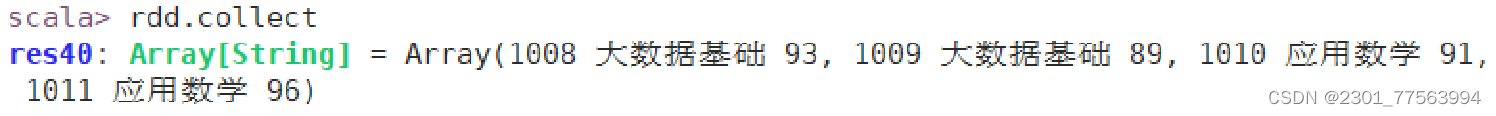

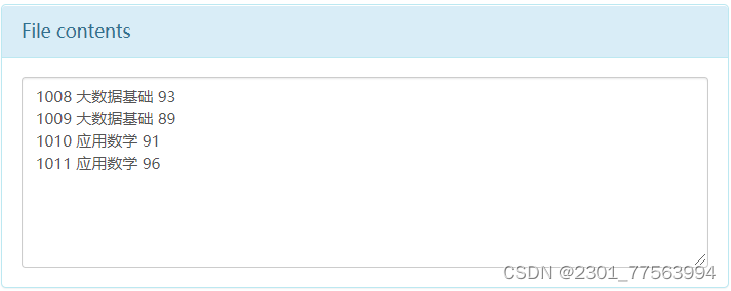

八、读取与存储文本文件

8.1

(1)文本文件的读取

通过textFile()方法即可直接读取,一条记录(一行)作为一个元素.

(2)文本文件的存储

(2)文本文件的存储

RDD数据可以直接调用saveAsTextFile()方法将数据存储为文本文件。

1107

1107

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?